使用mxnet实现卷积神经网络LeNet

1.LeNet模型

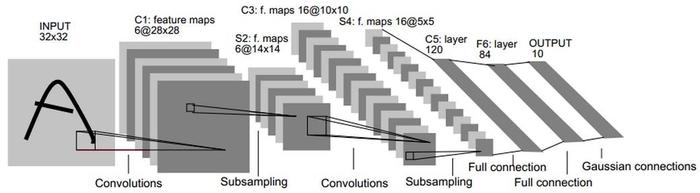

LeNet是一个早期用来识别手写数字的卷积神经网络,这个名字来源于LeNet论文的第一作者Yann LeCun。LeNet展示了通过梯度下降训练卷积神经网络可以达到手写数字识别在当时最先进的成果,这个尊基性的工作第一次将卷积神经网络推上舞台

上图就是LeNet模型,下面将对每层参数进行说明

1.1 input输入层

假设输入层数据shape=(32,32)

1.2 C1卷积层

- 卷积核大小: kernel_size=(5,5)

- 步幅:stride = 1

- 输出通道为6

- 可训练参数为: (5 * 5 + 1) * 6

- 激活函数:采用relu

输入层数据经过C1卷积层后将得到feature maps形状(6 * 28 * 28),注:28 = 32 -5 + 1

1.3 S2池化层

池化层(Max Pooling)窗口形状均为2*2,步幅度为2,输出feature maps为(6 *14 * 14),6为feature map的数量

1.4 C3卷积层

- 卷积核大小: kernel_size=(5,5)

- 步幅:stride = 1

- 输出通道为16

- 激活函数:采用relu得到feature maps为(16 * 10 * 10),(10*10)为每个feature map形状,16为feature map数量

1.5 S4池化层

池化层(Max Pooling)窗口形状依然均为2*2,步幅度为2,输出feature maps为(16 *5 * 5),16为feature map的数量

1.6 C5全链接层

- 输出120个神经元

- 激活函数:relu

1.7 F6全连接层

- 输出84个神经元

- 激活函数:relu

1.8 output

- 输出10个神经元

- 激活函数:无

2.用Mxnet实现LeNet模型

import mxnet as mx

from mxnet import autograd,init,nd

from mxnet.gluon import nn,Trainer

from mxnet.gluon import data as gdata

from mxnet.gluon import loss as gloss

import time

class LeNet_mxnet:

def __init__(self):

self.net = nn.Sequential()

self.net.add(nn.Conv2D(channels=6,kernel_size=5,activation='relu'),

nn.MaxPool2D(pool_size =(2,2),strides=(2,2)),

nn.Conv2D(channels=16,kernel_size=(5,5),strides=(1,1),padding=(0,0),activation='relu'),

nn.MaxPool2D(pool_size =(2,2),strides=(2,2)),

nn.Dense(units=120,activation='relu'),

nn.Dense(units=84,activation='relu'),

nn.Dense(units=10) #最后一个全连接层激活函数取决于损失函数

)

def train(self,train_iter,test_iter,n_epochs,ctx):

print('training on',ctx)

self.net.initialize(force_reinit=True,ctx=ctx,init=init.Xavier())

trainer_op = Trainer(self.net.collect_params(),'adam',{'learning_rate':0.01})

loss = gloss.SoftmaxCrossEntropyLoss()

accuracy_val = 0

for epoch in range(n_epochs):

train_loss_sum,train_acc_sum,n,start = 0.0,0.0,0,time.time()

for x_batch,y_batch in train_iter:

x_batch,y_batch = x_batch.as_in_context(ctx),y_batch.as_in_context(ctx)

with autograd.record():

y_hat = self.net(x_batch)

loss_val = loss(y_hat,y_batch).sum()

loss_val.backward()

trainer_op.step(n_batches)

y_batch = y_batch.astype('float32')

train_loss_sum += loss_val.asscalar()

train_acc_sum += (y_hat.argmax(axis=1) == y_batch).sum().asscalar()

n += y_batch.size

test_acc = self.accuracy_score(test_iter,ctx)

accuracy_val += self.accuracy_score(test_iter,ctx)

print('epoch:%d,train_loss:%.4f,train_acc:%.3f,test_acc:%.3f,time:%.1f sec'

%(epoch+1, train_loss_sum / n, train_acc_sum/ n,test_acc,time.time() - start))

def accuracy_score(self,data_iter,ctx):

acc_sum,n = nd.array([0],ctx=ctx),0

for x,y in data_iter:

x,y = x.as_in_context(ctx),y.as_in_context(ctx)

y = y.astype('float32')

acc_sum += (self.net(x).argmax(axis=1) == y).sum()

n += y.size

return acc_sum.asscalar() / n

def __call__(self,x):

return self.net(x)

def predict(self,x,ctx):

x = x.as_in_context(ctx)

return self.net(x).argmax(axis=1)

def print_info(self):

print(self.net[4].params)

3.使用mnist手写数字数据集进行测试

from tensorflow.keras.datasets import mnist

(x_train,y_train),(x_test,y_test) = mnist.load_data()

print(x_train.shape,y_train.shape)

print(x_test.shape,y_test.shape)

x_train = x_train.reshape(60000,1,28,28).astype('float32')

x_test = x_test.reshape(10000,1,28,28).astype('float32')

(60000, 28, 28) (60000,)

(10000, 28, 28) (10000,)

lenet_mxnet = LeNet_mxnet()

epochs = 10

n_batches = 500

train_iter = gdata.DataLoader(gdata.ArrayDataset(x_train,y_train),batch_size=n_batches)

test_iter = gdata.DataLoader(gdata.ArrayDataset(x_test,y_test),batch_size=n_batches)

lenet_mxnet.train(train_iter,test_iter,epochs,ctx=mx.gpu())

training on gpu(0)

epoch:1,train_loss:1.8267,train_acc:0.571,test_acc:0.896,time:3.0 sec

epoch:2,train_loss:0.2449,train_acc:0.924,test_acc:0.948,time:2.6 sec

epoch:3,train_loss:0.1563,train_acc:0.952,test_acc:0.954,time:2.6 sec

epoch:4,train_loss:0.1302,train_acc:0.961,test_acc:0.962,time:2.5 sec

epoch:5,train_loss:0.1169,train_acc:0.964,test_acc:0.958,time:2.5 sec

epoch:6,train_loss:0.1017,train_acc:0.969,test_acc:0.967,time:2.5 sec

epoch:7,train_loss:0.0855,train_acc:0.973,test_acc:0.964,time:3.3 sec

epoch:8,train_loss:0.0848,train_acc:0.973,test_acc:0.964,time:3.6 sec

epoch:9,train_loss:0.0767,train_acc:0.976,test_acc:0.963,time:3.5 sec

epoch:10,train_loss:0.0771,train_acc:0.977,test_acc:0.970,time:3.5 sec

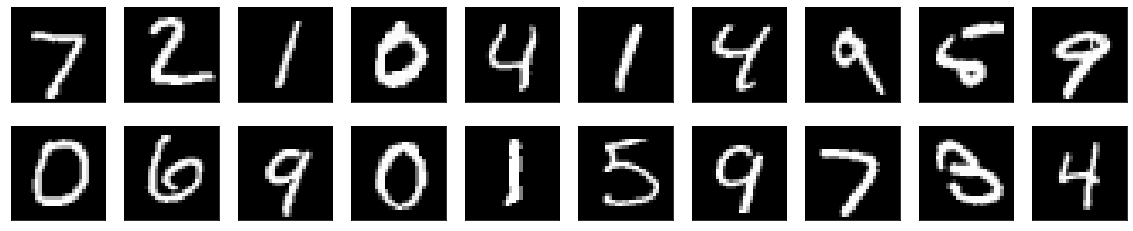

# 将预测结果可视化

import matplotlib.pyplot as plt

def plt_image(image):

n = 20

plt.figure(figsize=(20,4))

for i in range(n):

ax = plt.subplot(2,10,i+1)

plt.imshow(x_test[i].reshape(28,28))

plt.gray()

ax.get_xaxis().set_visible(False)

ax.get_yaxis().set_visible(False)

plt.show()

plt_image(x_test)

print('predict result:',lenet_mxnet.predict(nd.array(x_test[0:20]),ctx=mx.gpu()))

predict result:

[7. 2. 1. 0. 4. 1. 4. 9. 5. 9. 0. 6. 9. 0. 1. 5. 9. 7. 3. 4.]

<NDArray 20 @gpu(0)>

4. 附:需要注意的知识点

(1) 注意SoftmaxCrossEntropyLoss的使用,hybrid_forward源码说明,若from_logits为False时(默认为Flase),会先通过log_softmax计算各分类的概率,再计算loss,同样SigmoidBinaryCrossEntropyLoss也提供了from_sigmoid参数决定是否在hybrid_forward函数中要计算sigmoid函数,所以在创建模型最后一层的时候要特别注意是否要给激活函数

(2) 注意权重初始化选择

(3) 注意(y_hat.argmax(axis=1) == y_batch)操作时y_batch数据类型转换

(4) 上面的模型没有对数据集进行归一化处理,可以添加该步骤

使用mxnet实现卷积神经网络LeNet的更多相关文章

- MXNET:卷积神经网络

介绍过去几年中数个在 ImageNet 竞赛(一个著名的计算机视觉竞赛)取得优异成绩的深度卷积神经网络. LeNet LeNet 证明了通过梯度下降训练卷积神经网络可以达到手写数字识别的最先进的结果. ...

- TensorFlow+实战Google深度学习框架学习笔记(12)------Mnist识别和卷积神经网络LeNet

一.卷积神经网络的简述 卷积神经网络将一个图像变窄变长.原本[长和宽较大,高较小]变成[长和宽较小,高增加] 卷积过程需要用到卷积核[二维的滑动窗口][过滤器],每个卷积核由n*m(长*宽)个小格组成 ...

- MXNET:卷积神经网络基础

卷积神经网络(convolutional neural network).它是近年来深度学习能在计算机视觉中取得巨大成果的基石,它也逐渐在被其他诸如自然语言处理.推荐系统和语音识别等领域广泛使用. 目 ...

- 卷积神经网络LeNet Convolutional Neural Networks (LeNet)

Note This section assumes the reader has already read through Classifying MNIST digits using Logisti ...

- 卷积神经网络之LeNet

开局一张图,内容全靠编. 上图引用自 [卷积神经网络-进化史]从LeNet到AlexNet. 目前常用的卷积神经网络 深度学习现在是百花齐放,各种网络结构层出不穷,计划梳理下各个常用的卷积神经网络结构 ...

- 卷积神经网络详细讲解 及 Tensorflow实现

[附上个人git完整代码地址:https://github.com/Liuyubao/Tensorflow-CNN] [如有疑问,更进一步交流请留言或联系微信:523331232] Reference ...

- 经典卷积神经网络(LeNet、AlexNet、VGG、GoogleNet、ResNet)的实现(MXNet版本)

卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络,它的人工神经元可以响应一部分覆盖范围内的周围单元,对于大型图像处理有出色表现. 其中 文章 详解卷 ...

- 卷积神经网络的一些经典网络(Lenet,AlexNet,VGG16,ResNet)

LeNet – 5网络 网络结构为: 输入图像是:32x32x1的灰度图像 卷积核:5x5,stride=1 得到Conv1:28x28x6 池化层:2x2,stride=2 (池化之后再经过激活函数 ...

- 从LeNet到SENet——卷积神经网络回顾

从LeNet到SENet——卷积神经网络回顾 从 1998 年经典的 LeNet,到 2012 年历史性的 AlexNet,之后深度学习进入了蓬勃发展阶段,百花齐放,大放异彩,出现了各式各样的不同网络 ...

随机推荐

- CountDownLatch 源码分析

CountDownLatch 源码分析: 1:CountDownLatch数据结构 成员变量 Sync类型对象 private final Sync sync; Sync是继承AQS的一个类,Coun ...

- Ext.net SelectionModel RowSelection

<SelectionModel> <ext:RowSelectionModel ID="RowSelectionModel1308" runat="se ...

- 三、hexo+github搭建个人博客的主题配置

更换博客主题 主题可参考:https://hexo.io/themes/ hexo默认主题:Landscape 示例主题:Next 下载Next主题 进入Blog所在目录,输入下载命令 #进入Blog ...

- 10、VUE路由技术

1.前端路由 前端路由在很多开源的js类库框架中都得到支持,如AngularJS.Backbone.Vue.js等等. 前端路由和后端路由原理一样,是让所有的交互和展示在一个页面运行,以达到减少服务器 ...

- mini QQ(项目一)

一个多人聊天工具(C/S结构),实现了如下功能: 一个可视化窗口,支持鼠标点击事件 注册功能,用户可以注册自己的聊天账号, 注册信息包括: 账号名(可以用姓名来替代账号,支持中文), 密码(聊天框输入 ...

- webform 的路由

webform是怎么通过url找到对应handler的呢? mvc 和webapi的路由都是通过注册到RouteTable.Routes中,然后在urlroutingmodule中路由到对应route ...

- 玩透二叉树(Binary-Tree)及前序(先序)、中序、后序【递归和非递归】遍历

基础预热: 结点的度(Degree):结点的子树个数:树的度:树的所有结点中最大的度数:叶结点(Leaf):度为0的结点:父结点(Parent):有子树的结点是其子树的根节点的父结点:子结点/孩子结点 ...

- 详解Go变量类型的内存布局

定义 每当我们编写任何程序时,我们都需要在内存中存储一些数据/信息.数据存储在特定地址的存储器中.内存地址看起来像0xAFFFF(这是内存地址的十六进制表示). 现在,要访问数据,我们需要知道存储它的 ...

- JDK相关目录介绍

JDK安装后会在硬盘生成一个目录,这个目录被成为JDK安装目录 bin目录: 该目录里用于存放一些可执行文件 .例如:javac.exe(java编译器),java.exe(java运行工具),jar ...

- ES6 Set和Map集合(六)

一.Set集合创建Set实例:let set = new Set();1.特性:a.Set本身是一个构造函数,用来生成Set数据结构[类比数组结构]b.Set函数可以接受具有Iterable接口的数据 ...