Hadoop(16)-MapReduce框架原理-自定义FileInputFormat

1. 需求

将多个小文件合并成一个SequenceFile文件(SequenceFile文件是Hadoop用来存储二进制形式的key-value对的文件格式),SequenceFile里面存储着多个文件,存储的形式为文件路径+名称为key,文件内容为value

三个小文件

one.txt

yongpeng weidong weinan

sanfeng luozong xiaoming

two.txt

shuaige changmo zhenqiang

dongli lingu xuanxuan

three.txt

longlong fanfan

mazong kailun yuhang yixin

longlong fanfan

mazong kailun yuhang yixin

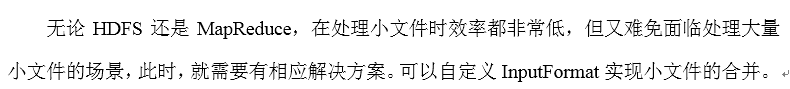

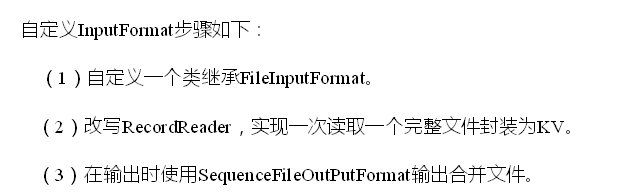

2. 需求分析

3.案例代码

1) 自定义RecordReader

package com.nty.inputformat; import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.InputSplit;

import org.apache.hadoop.mapreduce.RecordReader;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.input.FileSplit; import java.io.IOException; /**

* author nty

* date time 2018-12-11 9:10

*/

public class CustomRecordReader extends RecordReader<Text, BytesWritable> { /**

* 由于采用了FileInputFormat的输入方式,所以输入源3个文件,会分成三个切片,所以一个RecordReader只处理一个文件,一次读完

*/ //标记文件是否被读过,true表示没被读过

private boolean flag = true; private Text key = new Text();

private BytesWritable value = new BytesWritable(); //输入流

FSDataInputStream fis; private FileSplit fs; /**

* 初始化方法,只调用一次

* @param split

* @param context

* @throws IOException

* @throws InterruptedException

*/

public void initialize(InputSplit split, TaskAttemptContext context) throws IOException, InterruptedException {

//FileSplit是InputSplit的子类

fs = (FileSplit) split; //获取文件路径

Path path = fs.getPath(); //获取文件系统

FileSystem fileSystem = FileSystem.get(context.getConfiguration());

//FileSystem fileSystem = path.getFileSystem(context.getConfiguration()); //开流

fis = fileSystem.open(path);

} /**

* 读取下一组KV

* @return 读到了返回true,反之返回false

* @throws IOException

* @throws InterruptedException

*/

public boolean nextKeyValue() throws IOException, InterruptedException {

if(flag){

//读取文件进入key和value

String path = fs.getPath().toString();

key.set(path); //文件是一次性读完,bytes的长度不能为普遍的1024,当然这么写会涉及到大文件的问题,不做讨论.

byte[] bytes = new byte[(int) fs.getLength()];

fis.read(bytes);

value.set(bytes,0,bytes.length); //重新标记

flag = false; return true;

}

return false;

} /**

* 获取当前读到的key

* @return

* @throws IOException

* @throws InterruptedException

*/

public Text getCurrentKey() throws IOException, InterruptedException {

return this.key;

} /**

* 获取当前读到的value

* @return

* @throws IOException

* @throws InterruptedException

*/

public BytesWritable getCurrentValue() throws IOException, InterruptedException {

return this.value;

} /**

* 获取当前读取的进度

* @return

* @throws IOException

* @throws InterruptedException

*/

public float getProgress() throws IOException, InterruptedException {

//文件一次读完,只有0和1的进度,根据flag来判断

return flag ? 0f : 1f;

} /**

* 关闭资源

* @throws IOException

*/

public void close() throws IOException {

IOUtils.closeStream(fis);

}

}

2) 自定义Inputformat

package com.nty.inputformat; import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.InputSplit;

import org.apache.hadoop.mapreduce.JobContext;

import org.apache.hadoop.mapreduce.RecordReader;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat; import java.io.IOException; /**

* author nty

* date time 2018-12-11 9:09

*/

//需求中,key为文件路径+名称,所以key类型为Text,value为文件内容,用BytesWritable

public class CustomInputFormat extends FileInputFormat<Text, BytesWritable> { //最后输出的value为一个文件,所让文件不能被切分,返回false

@Override

protected boolean isSplitable(JobContext context, Path filename) {

return false;

} //返回自定义的 RecordReader

public RecordReader<Text, BytesWritable> createRecordReader(InputSplit split, TaskAttemptContext context) throws IOException, InterruptedException {

return new CustomRecordReader();

}

}

3) 编写Mapper类

package com.nty.inputformat; import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper; import java.io.IOException; /**

* author nty

* date time 2018-12-11 9:10

*/

public class CustomMapper extends Mapper<Text, BytesWritable, Text, BytesWritable> {

@Override

protected void map(Text key, BytesWritable value, Context context) throws IOException, InterruptedException {

context.write(key,value);

}

}

4) 编写Reducer类

package com.nty.inputformat; import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer; import java.io.IOException; /**

* author nty

* date time 2018-12-11 9:10

*/

public class CustomReducer extends Reducer<Text, BytesWritable, Text, BytesWritable> {

@Override

protected void reduce(Text key, Iterable<BytesWritable> values, Context context) throws IOException, InterruptedException {

for (BytesWritable value : values) {

context.write(key, value);

}

}

}

5) 编写Driver类

package com.nty.inputformat; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.BytesWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.lib.output.SequenceFileOutputFormat; /**

* author nty

* date time 2018-12-11 9:10

*/

public class CustomDriver { public static void main(String[] args) throws Exception{

//获取job

Configuration configuration = new Configuration();

Job job = Job.getInstance(configuration); //设置类

job.setJarByClass(CustomDriver.class);

//设置input和output

job.setInputFormatClass(CustomInputFormat.class);

job.setOutputFormatClass(SequenceFileOutputFormat.class); //设置Mapper和Reducer

job.setMapperClass(CustomMapper.class);

job.setReducerClass(CustomReducer.class); //设置Mapper和Reducer的输入输出

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(BytesWritable.class); job.setOutputKeyClass(Text.class);

job.setOutputValueClass(BytesWritable.class); //设置文件路径

FileInputFormat.setInputPaths(job, new Path("d:\\Hadoop_test"));

FileOutputFormat.setOutputPath(job, new Path("d:\\Hadoop_test_out"));

//提交

boolean b = job.waitForCompletion(true); System.exit(b ? 0 : 1); }

}

Hadoop(16)-MapReduce框架原理-自定义FileInputFormat的更多相关文章

- Hadoop(18)-MapReduce框架原理-WritableComparable排序和GroupingComparator分组

1.排序概述 2.排序分类 3.WritableComparable案例 这个文件,是大数据-Hadoop生态(12)-Hadoop序列化和源码追踪的输出文件,可以看到,文件根据key,也就是手机号进 ...

- Hadoop(12)-MapReduce框架原理-Hadoop序列化和源码追踪

1.什么是序列化 2.为什么要序列化 3.为什么不用Java的序列化 4.自定义bean对象实现序列化接口(Writable) 在企业开发中往往常用的基本序列化类型不能满足所有需求,比如在Hadoop ...

- Hadoop(20)-MapReduce框架原理-OutputFormat

1.outputFormat接口实现类 2.自定义outputFormat 步骤: 1). 定义一个类继承FileOutputFormat 2). 定义一个类继承RecordWrite,重写write ...

- Hadoop(15)-MapReduce框架原理-FileInputFormat的实现类

1. TextInputFormat 2.KeyValueTextInputFormat 3. NLineInputFormat

- Hadoop(17)-MapReduce框架原理-MapReduce流程,Shuffle机制,Partition分区

MapReduce工作流程 1.准备待处理文件 2.job提交前生成一个处理规划 3.将切片信息job.split,配置信息job.xml和我们自己写的jar包交给yarn 4.yarn根据切片规划计 ...

- Hadoop(13)-MapReduce框架原理--Job提交源码和切片源码解析

1.MapReduce的数据流 1) Input -> Mapper阶段 这一阶段的主要分工就是将文件切片和把文件转成K,V对 输入源是一个文件,经过InputFormat之后,到了Mapper ...

- Hadoop(19)-MapReduce框架原理-Combiner合并

1. Combiner概述 2. 自定义Combiner实现步骤 1). 定义一个Combiner继承Reducer,重写reduce方法 public class WordcountCombiner ...

- Hadoop(14)-MapReduce框架原理-切片机制

1.FileInputFormat切片机制 切片机制 比如一个文件夹下有5个小文件,切片时会切5个片,而不是一个片 案例分析 2.FileInputFormat切片大小的参数配置 源码中计算切片大小的 ...

- 【Hadoop】MapReduce自定义分区Partition输出各运营商的手机号码

MapReduce和自定义Partition MobileDriver主类 package Partition; import org.apache.hadoop.io.NullWritable; i ...

随机推荐

- App 图标设计 - 圆角透明效果(0 基础使用 PS)

App 图标设计 - 圆角透明效果(0 基础使用 PS) 方法: 如果你有些基础,就不必看图文教程了: 1.使用圆角矩形工具选中,设置圆角尺寸[例如:1024*1024 px(圆角:160 px)] ...

- 2017年秋季个人阅读计划 ---《掌握需求过程》第二版 pdf

这学期我们学习是软件需求分析,为了扩展视野,我们老师要求精读一本书,我根据老师推荐的书籍中找到了一本,名字叫做<掌握需求过程>,我大概浏览了一下这本书,这本书论述了软件开发中的重要课题—如 ...

- jquery validation表单验证插件。

这个是刚学的,觉得对以后挺有用的,就想把自己所学的分享一下. 校验规则: (1)required:true 必输字段 (2)number:true 必须输入合法的数字(负数,小数) (3)digits ...

- 32位Windows7 利用多余的不能识别的电脑内存 RAMDISK5.5教程

32位Windows7 利用多余的不能识别的电脑内存 RAMDISK5.5教程 环境:Windows7 32位 Ultimate 内存8GB 只能识别2.95GB内存 ramdisk5.5只适用于Wi ...

- C++易混淆概念

1. 引用和指针有什么区别? 本质:一个是别名,一个是地址1. 指针可以在运行时改变其所指向的值,引用一旦和某个对象绑定就不再改变2. 引用没有const, 指针有const 3. 从内存上看,指针会 ...

- 微信自定义菜单的emoji图标

微信公众号自定义菜单添加emoji表情图标 第一步:打开微信公众平台接口调试工具,点击前往接口调试工具: 第二步:把这段代码 {"button":[{"sub_butt ...

- Oracle重启操作步骤

有时候在服务中重启了oracle之后,数据库并不能正常访问,可以通过以下步骤: 在windows服务中启动数据库服务: 在windows命令窗口中输入命令:sqlplus /nolog 在sql> ...

- Linux sudo详解

sudo:控制用户对系统命令的使用权限,root允许的操作.通过sudo可以提高普通用户的操作权限,不过这个权限是需要进行配置才可使用. 常用的命令展示 配置sudo的2种方式 1. visodu 编 ...

- PHP设计模式系列 - 工厂模式

工厂模式 提供获取某个对象实例的一个接口,同时使调用代码避免确定实例化基类的步骤. 工厂模式 实际上就是建立一个统一的类实例化的函数接口.统一调用,统一控制. 工厂模式是php项目开发中,最常用的设计 ...

- kafka for Windows

1,保证,安装好java环境,zookeeper,并且运行zookeeper. 2,下载kafka,并解压到磁盘 下载链接http://mirrors.hust.edu.cn/apache/kafka ...