hbase和mapreduce开发 WordCount

代码:

/**

* hello world by world 测试数据

* @author a

*

*/

public class DefinedMapper extends Mapper<LongWritable, Text, Text, LongWritable>{

@Override

protected void map(LongWritable key, Text value, Mapper<LongWritable, Text, Text, LongWritable>.Context context)

throws IOException, InterruptedException {

long num=1L;

if(null!=value){

String strValue=value.toString();

String arrValue[]=strValue.split(" ");

if(arrValue.length==4){

for(int i=0;i<arrValue.length;i++){

context.write(new Text(arrValue[i].toString()), new LongWritable(num));

}

}

}

}

}

public class DefinedReduce extends TableReducer{

@Override

protected void reduce(Object arg0, Iterable values, Context arg2) throws IOException, InterruptedException {

if(null!=values){

long num=0l;

Iterator<LongWritable> it=values.iterator();

while(it.hasNext()){

LongWritable count=it.next();

num+=Long.valueOf(count.toString());

}

Put put=new Put(String.valueOf(arg0).getBytes());//设置行键

put.add("context".getBytes(), "count".getBytes(), String.valueOf(num).getBytes());

arg2.write(arg0, put);

}

}

}

package com.zhang.hbaseandmapreduce; import java.io.IOException; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.hbase.HBaseConfiguration;

import org.apache.hadoop.hbase.HColumnDescriptor;

import org.apache.hadoop.hbase.HTableDescriptor;

import org.apache.hadoop.hbase.client.HBaseAdmin;

import org.apache.hadoop.hbase.mapreduce.TableOutputFormat;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat; public class HBaseAndMapReduce {

public static void createTable(String tableName){

Configuration conf=HBaseConfiguration.create();

HTableDescriptor htable=new HTableDescriptor(tableName);

HColumnDescriptor hcol=new HColumnDescriptor("context");

try {

HBaseAdmin admin=new HBaseAdmin(conf);

if(admin.tableExists(tableName)){

System.out.println(tableName+" 已经存在");

return;

}

htable.addFamily(hcol);

admin.createTable(htable);

System.out.println(tableName+" 创建成功");

} catch (IOException e) {

e.printStackTrace();

} }

public static void main(String[] args) {

String tableName="workCount";

Configuration conf=new Configuration();

conf.set(TableOutputFormat.OUTPUT_TABLE, tableName);

conf.set("hbase.zookeeper.quorum", "192.168.177.124:2181");

createTable(tableName);

try {

Job job=new Job(conf);

job.setJobName("hbaseAndMapReduce");

job.setJarByClass(HBaseAndMapReduce.class);//jar的运行主类

job.setOutputKeyClass(Text.class);//mapper key的输出类型

job.setOutputValueClass(LongWritable.class);//mapper value的输出类型

job.setMapperClass(DefinedMapper.class);

job.setReducerClass(DefinedReduce.class);

job.setInputFormatClass(org.apache.hadoop.mapreduce.lib.input.TextInputFormat.class);

job.setOutputFormatClass(TableOutputFormat.class);

FileInputFormat.addInputPath(job, new Path("/tmp/dataTest/data.text"));

System.exit(job.waitForCompletion(true) ? 0:1);

} catch (Exception e) {

e.printStackTrace();

} } }

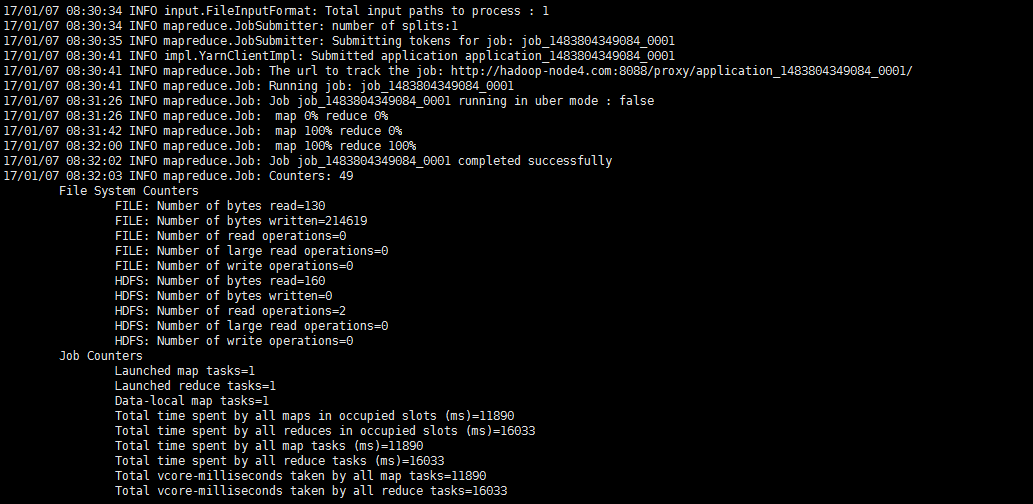

[root@node4 Desktop]# hadoop jar hbaseAndMapR.jar com.zhang.hbaseandmapreduce.HBaseAndMapReduce

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(LongWritable.class);

(1)2017-01-07 06:53:33,493 INFO org.apache.hadoop.yarn.server.nodemanager.containermanager.monitor.ContainersMonitorImpl: Memory usage of ProcessTree 14615 for container-id container_1483797859000_0001_01_000001: 80.9 MB of 2 GB physical memory used; 1.7 GB of 4.2 GB virtual memory used

(2)Detected pause in JVM or host machine (eg GC): pause of approximately 3999ms

(3)AttemptID:attempt_1462439785370_0055_m_000001_0 Timed out after 600 secs

MB of 1 GB physical memory used; 812.3 MB of 2.1 GB virtual memory used

<property>

<name>mapred.task.timeout</name>

<value>180000</value>

</property>

# The maximum amount of heap to use. Default is left to JVM default.

export HBASE_HEAPSIZE=2G

# Uncomment below if you intend to use off heap cache. For example, to allocate 8G of

# offheap, set the value to "8G".

export HBASE_OFFHEAPSIZE=2G

hbase和mapreduce开发 WordCount的更多相关文章

- HBase概念学习(七)HBase与Mapreduce集成

这篇文章是看了HBase权威指南之后,依据上面的解说搬下来的样例,可是略微有些不一样. HBase与mapreduce的集成无非就是mapreduce作业以HBase表作为输入,或者作为输出,也或者作 ...

- 基于 Eclipse 的 MapReduce 开发环境搭建

文 / vincentzh 原文连接:http://www.cnblogs.com/vincentzh/p/6055850.html 上周末本来要写这篇的,结果没想到上周末自己环境都没有搭起来,运行起 ...

- Hadoop MapReduce开发最佳实践(上篇)

body{ font-family: "Microsoft YaHei UI","Microsoft YaHei",SimSun,"Segoe UI& ...

- 【Hadoop学习之八】MapReduce开发

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk8 hadoop-3.1.1 伪分布式:HDFS和YARN 伪分 ...

- Hbase框架原理及相关的知识点理解、Hbase访问MapReduce、Hbase访问Java API、Hbase shell及Hbase性能优化总结

转自:http://blog.csdn.net/zhongwen7710/article/details/39577431 本blog的内容包含: 第一部分:Hbase框架原理理解 第二部分:Hbas ...

- [转] Hadoop MapReduce开发最佳实践(上篇)

前言 本文是Hadoop最佳实践系列第二篇,上一篇为<Hadoop管理员的十个最佳实践>. MapRuduce开发对于大多数程序员都会觉得略显复杂,运行一个WordCount(Hadoop ...

- hadoop程序MapReduce之WordCount

需求:统计一个文件中所有单词出现的个数. 样板:word.log文件中有hadoop hive hbase hadoop hive 输出:hadoop 2 hive 2 hbase 1 MapRedu ...

- HBase设计与开发

HBase设计与开发 @(HBase) 适合HBase应用的场景 成熟的数据分析主题,查询模式已经确定且不会轻易改变. 传统数据库无法承受负载. 简单的查询模式. 基本概念 行健:是hbase表自带的 ...

- MaxCompute Studio提升UDF和MapReduce开发体验

原文链接:http://click.aliyun.com/m/13990/ UDF全称User Defined Function,即用户自定义函数.MaxCompute提供了很多内建函数来满足用户的计 ...

随机推荐

- Python的网络编程[6] -> Modbus 协议 -> Modbus 的基本理论与 Python 实现

Modbus协议 / Modbus Protocol 目录 Modbus 协议简介 Modbus RTU协议 Modbus TCP协议与 Python 实现 Modbus 功能码 Modbus TCP ...

- luogu P1041 传染病控制

题目背景 近来,一种新的传染病肆虐全球.蓬莱国也发现了零星感染者,为防止该病在蓬莱国大范围流行,该国政府决定不惜一切代价控制传染病的蔓延.不幸的是,由于人们尚未完全认识这种传染病,难以准确判别病毒携带 ...

- POJ 2836 Rectangular Covering(状压DP)

[题目链接] http://poj.org/problem?id=2836 [题目大意] 给出二维平面的一些点,现在用一些非零矩阵把它们都包起来, 要求这些矩阵的面积和最小,求这个面积和 [题解] 我 ...

- IOS8设备连接XCODE6真机调试报错"Could not inspect the application package"

每次真机调试都要运行2次才行,解决办法:把product name改成英文就行了.

- Android开发实践:Java层与Jni层的数组传递

转载:http://www.linuxidc.com/Linux/2014-03/97561.htm Android开发中,经常会在Java代码与Jni层之间传递数组(byte[]),一个典型的应用是 ...

- tiny4412 串口驱动分析四 --- 修改默认的串口输出

作者:彭东林 邮箱:pengdonglin137@163.com 开发板:tiny4412ADK+S700 4GB Flash 主机:Wind7 64位 虚拟机:Vmware+Ubuntu12_04 ...

- ios开发 Socket通信

Socket描述了一个IP.端口对.它简化了程序员的操作,知道对方的IP以及PORT就可以给对方发送消息,再由服务器端来处理发送的这些消息.所以,Socket一定包含了通信的双发,即客户端(Clien ...

- crossapp里的位置设置

crossapp里有Frame.Center,这两种都是可以用来确定一个view的位置和大小. 不同点:Frame定位是以View的左上角为参照点,Center是以View的中心点为参照点 注意cro ...

- 机器学习&深度学习资料(转载)

转自 飞鸟各投林 <Brief History of Machine Learning> 介绍:这是一篇介绍机器学习历史的文章,介绍很全面,从感知机.神经网络.决策树.SVM.Adaboo ...

- git学习资料及心得

1. 阮一峰的(简单易懂,实用性佳) http://www.ruanyifeng.com/blog/2015/12/git-cheat-sheet.html http://www.ruanyifeng ...