sklearn中模型抽取

特征抽取sklearn.feature_extraction 模块提供了从原始数据如文本,图像等众抽取能够被机器学习算法直接处理的特征向量。

1.特征抽取方法之 Loading Features from Dicts

measurements=[

{'city':'Dubai','temperature':33.},

{'city':'London','temperature':12.},

{'city':'San Fransisco','temperature':18.},

] from sklearn.feature_extraction import DictVectorizer

vec=DictVectorizer()

print(vec.fit_transform(measurements).toarray())

print(vec.get_feature_names()) #[[ 1. 0. 0. 33.]

#[ 0. 1. 0. 12.]

#[ 0. 0. 1. 18.]] #['city=Dubai', 'city=London', 'city=San Fransisco', 'temperature']

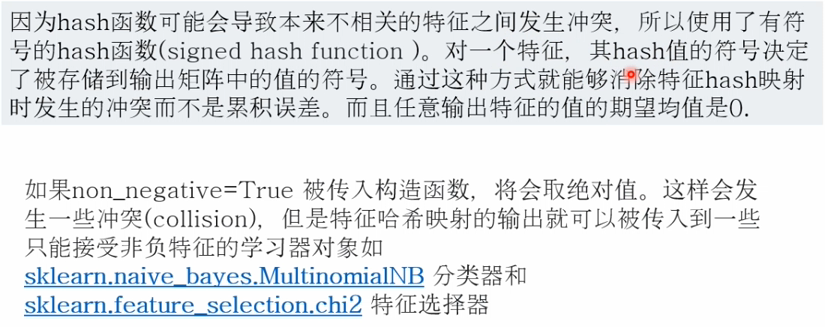

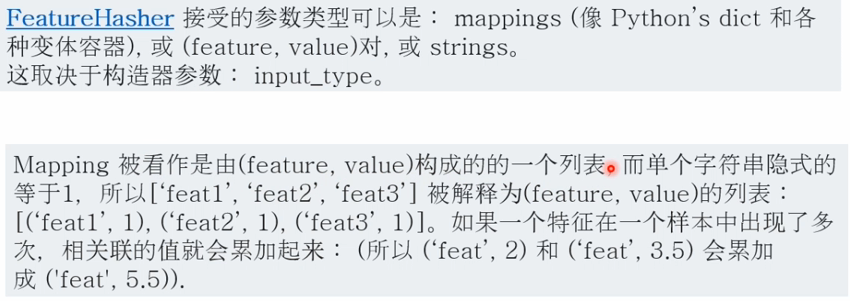

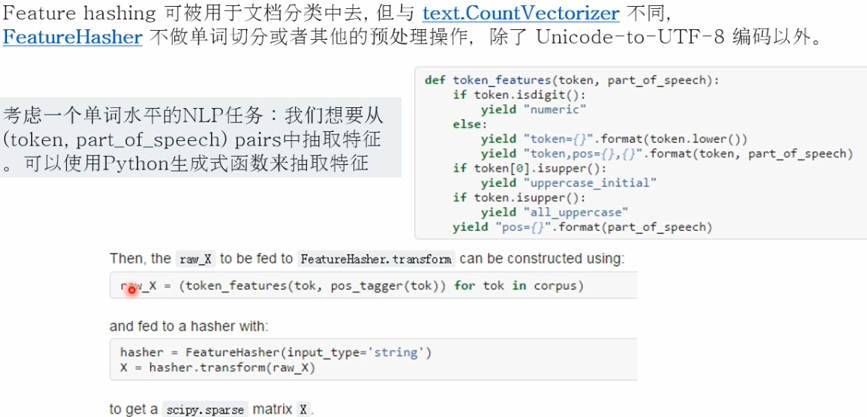

2.特征抽取方法之 Features hashing

3.特征抽取方法之 Text Feature Extraction

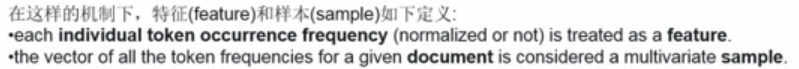

词袋模型 the bag of words represenatation

#词袋模型

from sklearn.feature_extraction.text import CountVectorizer

#查看默认的参数

vectorizer=CountVectorizer(min_df=1)

print(vectorizer) """

CountVectorizer(analyzer='word', binary=False, decode_error='strict',

dtype=<class 'numpy.int64'>, encoding='utf-8', input='content',

lowercase=True, max_df=1.0, max_features=None, min_df=1,

ngram_range=(1, 1), preprocessor=None, stop_words=None,

strip_accents=None, token_pattern='(?u)\\b\\w\\w+\\b',

tokenizer=None, vocabulary=None) """ corpus=["this is the first document.",

"this is the second second document.",

"and the third one.",

"Is this the first document?"]

x=vectorizer.fit_transform(corpus)

print(x) """

(0, 1) 1

(0, 2) 1

(0, 6) 1

(0, 3) 1

(0, 8) 1

(1, 5) 2

(1, 1) 1

(1, 6) 1

(1, 3) 1

(1, 8) 1

(2, 4) 1

(2, 7) 1

(2, 0) 1

(2, 6) 1

(3, 1) 1

(3, 2) 1

(3, 6) 1

(3, 3) 1

(3, 8) 1

"""

默认是可以识别的字符串至少为2个字符

analyze=vectorizer.build_analyzer()

print(analyze("this is a document to anzlyze.")==

(["this","is","document","to","anzlyze"])) #True

在fit阶段被analyser发现的每一个词语都会被分配一个独特的整形索引,该索引对应于特征向量矩阵中的一列

print(vectorizer.get_feature_names()==(

["and","document","first","is","one","second","the","third","this"]

))

#True

print(x.toarray())

"""

[[0 1 1 1 0 0 1 0 1]

[0 1 0 1 0 2 1 0 1]

[1 0 0 0 1 0 1 1 0]

[0 1 1 1 0 0 1 0 1]]

"""

获取属性

print(vectorizer.vocabulary_.get('document'))

#1

对于一些没有出现过的字或者字符,则会显示为0

vectorizer.transform(["somthing completely new."]).toarray()

"""

[[0 1 1 1 0 0 1 0 1]

[0 1 0 1 0 2 1 0 1]

[1 0 0 0 1 0 1 1 0]

[0 1 1 1 0 0 1 0 1]]

"""

在上边的语料库中,第一个和最后一个单词是一模一样的,只是顺序不一样,他们会被编码成相同的特征向量,所以词袋表示法会丢失了单词顺序的前后相关性信息,为了保持某些局部的顺序性,可以抽取2个词和一个词

bigram_vectorizer=CountVectorizer(ngram_range=(1,2),token_pattern=r"\b\w+\b",min_df=1)

analyze=bigram_vectorizer.build_analyzer()

print(analyze("Bi-grams are cool!")==(['Bi','grams','are','cool','Bi grams',

'grams are','are cool'])) #True

x_2=bigram_vectorizer.fit_transform(corpus).toarray()

print(x_2) """

[[0 0 1 1 1 1 1 0 0 0 0 0 1 1 0 0 0 0 1 1 0]

[0 0 1 0 0 1 1 0 0 2 1 1 1 0 1 0 0 0 1 1 0]

[1 1 0 0 0 0 0 0 1 0 0 0 1 0 0 1 1 1 0 0 0]

[0 0 1 1 1 1 0 1 0 0 0 0 1 1 0 0 0 0 1 0 1]]

"""

sklearn中模型抽取的更多相关文章

- sklearn 中模型保存的两种方法

一. sklearn中提供了高效的模型持久化模块joblib,将模型保存至硬盘. from sklearn.externals import joblib #lr是一个LogisticRegressi ...

- sklearn中模型评估和预测

一.模型验证方法如下: 通过交叉验证得分:model_sleection.cross_val_score(estimator,X) 对每个输入数据点产生交叉验证估计:model_selection.c ...

- sklearn保存模型的两种方式

sklearn 中模型保存的两种方法 一. sklearn中提供了高效的模型持久化模块joblib,将模型保存至硬盘. from sklearn.externals import joblib # ...

- 第十三次作业——回归模型与房价预测&第十一次作业——sklearn中朴素贝叶斯模型及其应用&第七次作业——numpy统计分布显示

第十三次作业——回归模型与房价预测 1. 导入boston房价数据集 2. 一元线性回归模型,建立一个变量与房价之间的预测模型,并图形化显示. 3. 多元线性回归模型,建立13个变量与房价之间的预测模 ...

- sklearn中的模型评估-构建评估函数

1.介绍 有三种不同的方法来评估一个模型的预测质量: estimator的score方法:sklearn中的estimator都具有一个score方法,它提供了一个缺省的评估法则来解决问题. Scor ...

- sklearn中的KMeans算法

1.聚类算法又叫做“无监督分类”,其目的是将数据划分成有意义或有用的组(或簇).这种划分可以基于我们的业务需求或建模需求来完成,也可以单纯地帮助我们探索数据的自然结构和分布. 2.KMeans算法将一 ...

- 机器学习实战基础(二十四):sklearn中的降维算法PCA和SVD(五) PCA与SVD 之 重要接口inverse_transform

重要接口inverse_transform 在上周的特征工程课中,我们学到了神奇的接口inverse_transform,可以将我们归一化,标准化,甚至做过哑变量的特征矩阵还原回原始数据中的特征矩阵 ...

- Python 3 利用 Dlib 19.7 和 sklearn机器学习模型 实现人脸微笑检测

0.引言 利用机器学习的方法训练微笑检测模型,给一张人脸照片,判断是否微笑: 使用的数据集中69张没笑脸,65张有笑脸,训练结果识别精度在95%附近: 效果: 图1 示例效果 工程利用pytho ...

- sklearn中的Pipeline

在将sklearn中的模型持久化时,使用sklearn.pipeline.Pipeline(steps, memory=None)将各个步骤串联起来可以很方便地保存模型. 例如,首先对数据进行了PCA ...

随机推荐

- CSS:教程

ylbtech-CSS:教程 1.返回顶部 1. CSS 教程 通过使用 CSS 我们可以大大提升网页开发的工作效率! 在我们的 CSS 教程中,您会学到如何使用 CSS 同时控制多重网页的样式和布局 ...

- react-loadable路由懒加载

load.js import Loadable from 'react-loadable'; import './styles/load.styl' // 按需加载组件 export default ...

- VIM查找空格

匹配1到多个空格 /\s\+ 或者开启very magic模式 /\v\s+

- Spring Boot Dubbo 应用启停源码分析

作者:张乎兴 来源:Dubbo官方博客 背景介绍 Dubbo Spring Boot 工程致力于简化 Dubbo | grep tid | grep -v "daemon" tid ...

- hdu6290奢侈的旅行

高玩小Q不仅喜欢玩寻宝游戏,还喜欢一款升级养成类游戏.在这个游戏的世界地图中一共有n个城镇,编号依次为1到n. 这些城镇之间有m条单向道路,第i 条单项道路包含四个参数ui,vi,ai,bi,表示一条 ...

- UncategorizedSQLException异常处理办法

如题,先贴console org.springframework.jdbc.UncategorizedSQLException: StatementCallback; uncategorized SQ ...

- Kettle使用kettle.properties

kettle.properties 是一个变量文件,这个文件我使用的最多的地方是保存 “数据库连接” 用户名和密码. 如果不用这个文件,那么使用“数据库连接”时,需要硬编码写到文件里. 有一天dba告 ...

- Operator '?:' has lower precedence than '*'; '*' will be evaluated first

1.项目中用宏的时候,遇到如下警告 Operator '?:' has lower precedence than '*'; '*' will be evaluated first 2.错误原因 *操 ...

- ./vimrc代码解析全

""""""""""""""""&quo ...

- mysql和postgresql查询数据库中哪些表包含某个字段

想知道数据库中哪表含有edu_status字段 mysql> select table_name,column_name from information_schema.columns wh ...