[Kafka] - Kafka Java Consumer实现(二)

Kafka提供了两种Consumer API,分别是:High Level Consumer API 和 Lower Level Consumer API(Simple Consumer API)

High Level Consumer API:高度抽象的Kafka消费者API;将底层具体获取数据、更新offset、设置偏移量等操作屏蔽掉,直接将操作数据流的处理工作提供给编写程序的人员。优点是:操作简单;缺点:可操作性太差,无法按照自己的业务场景选择处理方式。(入口类:ConsumerConnector)

Lower Level Consumer API:通过直接操作底层API获取数据的方式获取Kafka中的数据,需要自行给定分区、偏移量等属性。优点:可操作性强;缺点:代码相对而言比较复杂。(入口类:SimpleConsumer)

这里主要将High Level Consumer API使用Java代码实现并测试:

Lower Level Consumer API详见博客:[Kafka] - Kafka Java Consumer实现(一)

========================================================================

一、JavaKafkaConsumerHighAPI:使用Kafka High Level Consumer API多线程读取数据的相关API实现,具体代码如下:

- import kafka.consumer.*;

- import kafka.javaapi.consumer.ConsumerConnector;

- import kafka.message.MessageAndMetadata;

- import kafka.serializer.StringDecoder;

- import kafka.utils.VerifiableProperties;

- import java.util.HashMap;

- import java.util.List;

- import java.util.Map;

- import java.util.Properties;

- import java.util.concurrent.ExecutorService;

- import java.util.concurrent.Executors;

- import java.util.concurrent.TimeUnit;

- /**

- * 自定义简单Kafka消费者, 使用高级API

- * Created by gerry on 12/21.

- */

- public class JavaKafkaConsumerHighAPI implements Runnable {

- /**

- * Kafka数据消费对象

- */

- private ConsumerConnector consumer;

- /**

- * Kafka Topic名称

- */

- private String topic;

- /**

- * 线程数量,一般就是Topic的分区数量

- */

- private int numThreads;

- /**

- * 线程池

- */

- private ExecutorService executorPool;

- /**

- * 构造函数

- *

- * @param topic Kafka消息Topic主题

- * @param numThreads 处理数据的线程数/可以理解为Topic的分区数

- * @param zookeeper Kafka的Zookeeper连接字符串

- * @param groupId 该消费者所属group ID的值

- */

- public JavaKafkaConsumerHighAPI(String topic, int numThreads, String zookeeper, String groupId) {

- // 1. 创建Kafka连接器

- this.consumer = Consumer.createJavaConsumerConnector(createConsumerConfig(zookeeper, groupId));

- // 2. 数据赋值

- this.topic = topic;

- this.numThreads = numThreads;

- }

- @Override

- public void run() {

- // 1. 指定Topic

- Map<String, Integer> topicCountMap = new HashMap<String, Integer>();

- topicCountMap.put(this.topic, this.numThreads);

- // 2. 指定数据的解码器

- StringDecoder keyDecoder = new StringDecoder(new VerifiableProperties());

- StringDecoder valueDecoder = new StringDecoder(new VerifiableProperties());

- // 3. 获取连接数据的迭代器对象集合

- /**

- * Key: Topic主题

- * Value: 对应Topic的数据流读取器,大小是topicCountMap中指定的topic大小

- */

- Map<String, List<KafkaStream<String, String>>> consumerMap = this.consumer.createMessageStreams(topicCountMap, keyDecoder, valueDecoder);

- // 4. 从返回结果中获取对应topic的数据流处理器

- List<KafkaStream<String, String>> streams = consumerMap.get(this.topic);

- // 5. 创建线程池

- this.executorPool = Executors.newFixedThreadPool(this.numThreads);

- // 6. 构建数据输出对象

- int threadNumber = 0;

- for (final KafkaStream<String, String> stream : streams) {

- this.executorPool.submit(new ConsumerKafkaStreamProcesser(stream, threadNumber));

- threadNumber++;

- }

- }

- public void shutdown() {

- // 1. 关闭和Kafka的连接,这样会导致stream.hashNext返回false

- if (this.consumer != null) {

- this.consumer.shutdown();

- }

- // 2. 关闭线程池,会等待线程的执行完成

- if (this.executorPool != null) {

- // 2.1 关闭线程池

- this.executorPool.shutdown();

- // 2.2. 等待关闭完成, 等待五秒

- try {

- if (!this.executorPool.awaitTermination(5, TimeUnit.SECONDS)) {

- System.out.println("Timed out waiting for consumer threads to shut down, exiting uncleanly!!");

- }

- } catch (InterruptedException e) {

- System.out.println("Interrupted during shutdown, exiting uncleanly!!");

- }

- }

- }

- /**

- * 根据传入的zk的连接信息和groupID的值创建对应的ConsumerConfig对象

- *

- * @param zookeeper zk的连接信息,类似于:<br/>

- * hadoop-senior01.ibeifeng.com:2181,hadoop-senior02.ibeifeng.com:2181/kafka

- * @param groupId 该kafka consumer所属的group id的值, group id值一样的kafka consumer会进行负载均衡

- * @return Kafka连接信息

- */

- private ConsumerConfig createConsumerConfig(String zookeeper, String groupId) {

- // 1. 构建属性对象

- Properties prop = new Properties();

- // 2. 添加相关属性

- prop.put("group.id", groupId); // 指定分组id

- prop.put("zookeeper.connect", zookeeper); // 指定zk的连接url

- prop.put("zookeeper.session.timeout.ms", "400"); //

- prop.put("zookeeper.sync.time.ms", "200");

- prop.put("auto.commit.interval.ms", "1000");

- // 3. 构建ConsumerConfig对象

- return new ConsumerConfig(prop);

- }

- /**

- * Kafka消费者数据处理线程

- */

- public static class ConsumerKafkaStreamProcesser implements Runnable {

- // Kafka数据流

- private KafkaStream<String, String> stream;

- // 线程ID编号

- private int threadNumber;

- public ConsumerKafkaStreamProcesser(KafkaStream<String, String> stream, int threadNumber) {

- this.stream = stream;

- this.threadNumber = threadNumber;

- }

- @Override

- public void run() {

- // 1. 获取数据迭代器

- ConsumerIterator<String, String> iter = this.stream.iterator();

- // 2. 迭代输出数据

- while (iter.hasNext()) {

- // 2.1 获取数据值

- MessageAndMetadata value = iter.next();

- // 2.2 输出

- System.out.println(this.threadNumber + ":" + ":" + value.offset() + value.key() + ":" + value.message());

- }

- // 3. 表示当前线程执行完成

- System.out.println("Shutdown Thread:" + this.threadNumber);

- }

- }

- }

二、JavaKafkaConsumerHighAPITest:测试类

- /**

- * Created by ibf on 12/21.

- */

- public class JavaKafkaConsumerHighAPITest {

- public static void main(String[] args) {

- String zookeeper = "192.168.187.146:2181";

- String groupId = "group1";

- String topic = "test2";

- int threads = 1;

- JavaKafkaConsumerHighAPI example = new JavaKafkaConsumerHighAPI(topic, threads, zookeeper, groupId);

- new Thread(example).start();

- // 执行10秒后结束

- int sleepMillis = 600000;

- try {

- Thread.sleep(sleepMillis);

- } catch (InterruptedException e) {

- e.printStackTrace();

- }

- // 关闭

- example.shutdown();

- }

- }

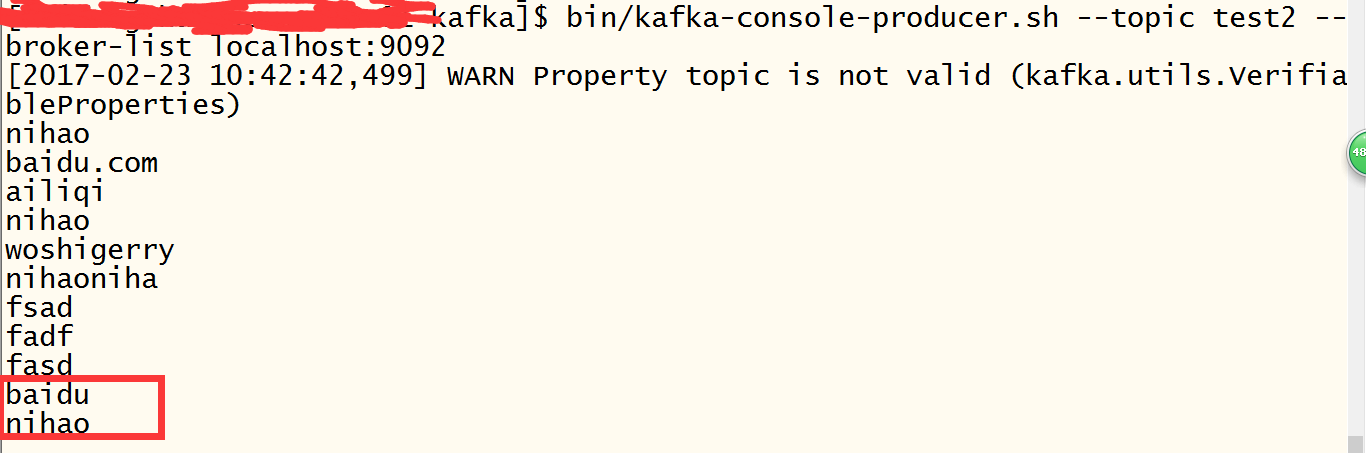

三、运行测试截图

Kafka相关命令可以参考博客[Kafka] - Kafka基本操作命令, 测试截图如下:

至此,开发基本完成

========================================================

四、Kafka Pom文件依赖

- <properties>

- <kafka.version>0.8.2.1</kafka.version>

- </properties>

- <dependencies>

- <dependency>

- <groupId>org.apache.kafka</groupId>

- <artifactId>kafka_2.10</artifactId>

- <version>${kafka.version}</version>

- </dependency>

- </dependencies>

[Kafka] - Kafka Java Consumer实现(二)的更多相关文章

- [Kafka] - Kafka Java Consumer实现(一)

Kafka提供了两种Consumer API,分别是:High Level Consumer API 和 Lower Level Consumer API(Simple Consumer API) H ...

- 关于Kafka java consumer管理TCP连接的讨论

本篇是<关于Kafka producer管理TCP连接的讨论>的续篇,主要讨论Kafka java consumer是如何管理TCP连接.实际上,这两篇大部分的内容是相同的,即consum ...

- Java进阶专题(二十一) 消息中间件架构体系(3)-- Kafka研究

前言 Kafka 是一款分布式消息发布和订阅系统,具有高性能.高吞吐量的特点而被广泛应用与大数据传输场景.它是由 LinkedIn 公司开发,使用 Scala 语言编写,之后成为 Apache 基金会 ...

- Kafka Java consumer动态修改topic订阅

前段时间在Kafka QQ群中有人问及此事——关于Java consumer如何动态修改topic订阅的问题.仔细一想才发现这的确是个好问题,因为如果简单地在另一个线程中直接持有consumer实例然 ...

- kafka集群和zookeeper集群的部署,kafka的java代码示例

来自:http://doc.okbase.net/QING____/archive/19447.html 也可参考: http://blog.csdn.net/21aspnet/article/det ...

- kafka原理和实践(二)spring-kafka简单实践

系列目录 kafka原理和实践(一)原理:10分钟入门 kafka原理和实践(二)spring-kafka简单实践 kafka原理和实践(三)spring-kafka生产者源码 kafka原理和实践( ...

- zookeeper+kafka集群安装之二

zookeeper+kafka集群安装之二 此为上一篇文章的续篇, kafka安装需要依赖zookeeper, 本文与上一篇文章都是真正分布式安装配置, 可以直接用于生产环境. zookeeper安装 ...

- Kafka设计解析(十三)Kafka消费组(consumer group)

转载自 huxihx,原文链接 Kafka消费组(consumer group) 一直以来都想写一点关于kafka consumer的东西,特别是关于新版consumer的中文资料很少.最近Kafka ...

- 4 kafka集群部署及kafka生产者java客户端编程 + kafka消费者java客户端编程

本博文的主要内容有 kafka的单机模式部署 kafka的分布式模式部署 生产者java客户端编程 消费者java客户端编程 运行kafka ,需要依赖 zookeeper,你可以使用已有的 zo ...

随机推荐

- 170609、Nginx配置文件详细说明

在此记录下Nginx服务器nginx.conf的配置文件说明, 部分注释收集与网络. #运行用户 user www-data; #启动进程,通常设置成和cpu的数量相等 worker_processe ...

- Java编程思想第四版勘误

坊间传说这本书翻译得很烂,我倒觉得还好.虽然看原文更准确,但是如果在具备一定编程思维和基础.能够看出来疑问的情况下,还是看中文更快一些,而且这本书本身也不适合初学者看.当然,错误和不通顺还是有的,而且 ...

- avaScript 的基础学习(一)

JavaScript概述 JavaScript由三部分组成: JavaScript的基础 JS的引入方式: JS的数据类型: 运算符: 流程控制: JavaScript的对象 BOM对象 DOM Ev ...

- 人人网张铁安:Feed系统架构分析(转)

原文:http://www.csdn.net/article/2010-07-26/277273 继成功举办首期TUP活动后,日前在北京丽亭华苑酒店鸿运二厅,由CSDN和<程序员> 杂志联 ...

- linux 下创建虚拟环境 python

virtualenv是一个可以在同一计算机中隔离多个python版本的工具.有时,两个不同的项目可能需要不同版本的python,如 python2.7 / python3.6 ,但是如果都装到一起,经 ...

- pathmunge

pathmunge是linux系统redhat系列版本系统变量/etc/profile中的函数 判断当前系统的PATH中是否有该命令的目录,如果没有,则判断是要将该目录放于PATH之前还是之后 pat ...

- Mysql varchar 把默认值设置为null和空的区别

'\0',这个表示空,需要消耗存储空间的.NULL,则表示连这个\0都没有. NULL,你可以近似理解为变量未赋值(定义了变量,但是未使用,变量不指向具体存储空间,因此,理论上不消耗存储空间),同时, ...

- Linux内核之vmlinux与vmlinuz

因为是初次系统的学习Linux内核,过程中遇到了一些常常出现的名词.似曾相识,但对他们的含义又不是非常清楚.因此,将搜索到的内容进行一下汇总. 1.vmlinux vmlinux是一个包括linu ...

- java-基础-【三】try/catch/finally

原文地址: https://my.oschina.net/bieber/blog/703251 一.单层的try/catch public int test(int a,int b){ try{ re ...

- Java-idea-PMD源文件级别潜在bug查看

一.概述 PMD(Project Manager Design)是一种开源分析Java代码错误的工具.与其他分析工具不同的是,PMD通过静态分析获知代码错误.也就是说,在不运行Java程序的情况下报告 ...