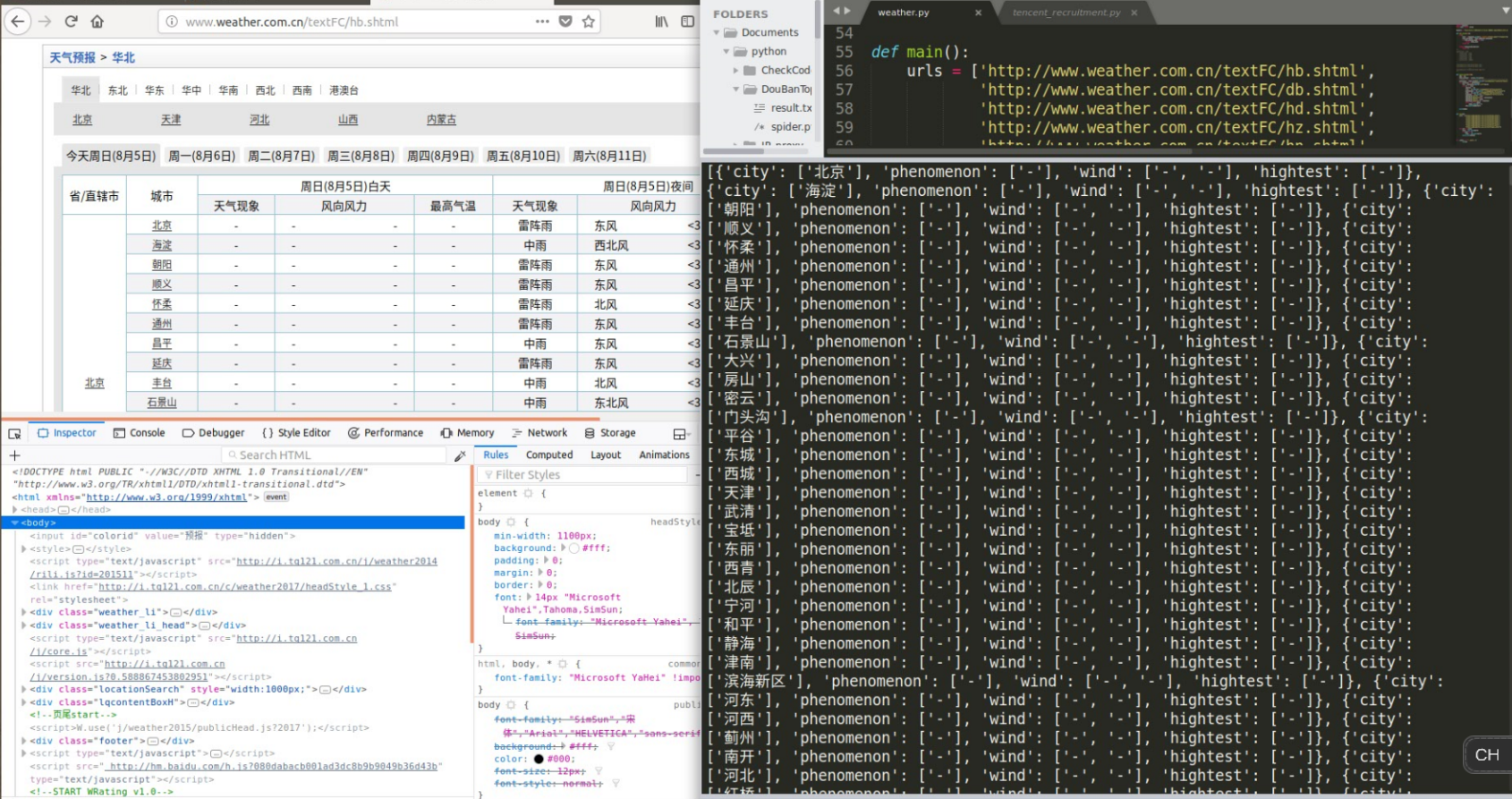

爬虫_中国天气网_文字天气预报(xpath)

import requests

from lxml import etree headers = 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36' def get_html(url):

try:

html = requests.get(url, headers={'User-Agent':'headers'})

html.encoding = html.apparent_encoding

if html.status_code == 200:

return html.text

return 0 except RequestsException:

return 0

'''

conMintab: 华北

conMintab2 北京

conMintab2 天津

conMintab2 河北

conMintab2 山西

conMintab2 内蒙古 //div[@class="conMidtab"][1] 今天

//div[@class="conMidtab"][2] 明天

...

//div[@class="conMidtab"][7] 最后一天

''' def parse_html(html):

wea = []

html_element = etree.HTML(html)

# !!!!! trs = html_element.xpath('//div[@class="conMidtab"][1]//tr')[2:]

provinces = html_element.xpath('//div[@class="conMidtab"][1]//div[@class="conMidtab2"]')

for province in provinces:

trs = province.xpath('.//tr')[2:]

for tr in trs:

weather = {}

city = tr.xpath('.//td[@width="83"]/a/text()')

phenomenon = tr.xpath('.//td[@width="89"]/text()')

wind = tr.xpath('.//td[@width="162"]//text()')

hightest = tr.xpath('.//td[@width="92"]/text()')

weather['city'] = city

weather['phenomenon'] = phenomenon

weather['wind'] = wind

weather['hightest'] = hightest

while '\n' in wind:

wind.remove('\n')

wea.append(weather) print(wea) def main():

urls = ['http://www.weather.com.cn/textFC/hb.shtml',

'http://www.weather.com.cn/textFC/db.shtml',

'http://www.weather.com.cn/textFC/hd.shtml',

'http://www.weather.com.cn/textFC/hz.shtml',

'http://www.weather.com.cn/textFC/hn.shtml',

'http://www.weather.com.cn/textFC/xb.shtml',

'http://www.weather.com.cn/textFC/xn.shtml',

'http://www.weather.com.cn/textFC/gat.shtml']

for url in urls:

html = get_html(url)

if html == 0:

html = get_html(url)

parse_html(html) if __name__ == '__main__':

main()

。。港澳台的格式不太一样,暂时不想管他们了

。。运行结果的话,我爬取得是当日白天的天气,现在晚上了,数据都没有了(一开始还以为是代码改错了,还一直撤销)

爬虫_中国天气网_文字天气预报(xpath)的更多相关文章

- 微信小程序_(案例)简单中国天气网首页

Demo:简单中国天气网首页 Page({ data:{ name:"CynicalGary", temp:"4", low:"-1°C", ...

- 爬虫-通过本地IP地址从中国天气网爬取当前城市天气情况

1.问题描述 最近在做一个pyqt登录校园网的小项目,想在窗口的状态栏加上当天的天气情况,用爬虫可以很好的解决我的问题. 2.解决思路 考虑到所处位置的不同,需要先获取本地城市地址,然后作为中 ...

- 轻奢当道业绩逆势增长 Kate Spade联手韩国衣恋开拓中国市场_商场报道_中国时尚品牌网

轻奢当道业绩逆势增长 Kate Spade联手韩国衣恋开拓中国市场_商场报道_中国时尚品牌网 轻奢当道业绩逆势增长 Kate Spade联手韩国衣恋开拓中国市场

- 孙弘与Masa Maso 做互联网最贵的衬衫(2)_人物对话_中国时尚品牌网

孙弘与Masa Maso 做互联网最贵的衬衫(2)_人物对话_中国时尚品牌网 孙弘与Masa Maso 做互联网最贵的衬衫(2)

- 中国天气网-天气预报接口api

中国天气网地址:http://www.weather.com.cn 请求服务 : 查询实时天气信息 http://www.weather.com.cn/data/sk/101110101.html 在 ...

- 天气预报接口api(中国天气网)

中国天气weather.comhttp://m.weather.com.cn/data/101110101.html(六天预报) http://www.weather.com.cn/data/sk/1 ...

- C#获取中国天气网免费天气预报信息

中国天气网接口地址:”http://wthrcdn.etouch.cn/WeatherApi?citykey=” + weatherCityCode(为城市code); 下面是转化过程中我们需要用到的 ...

- 初识python 之 爬虫:爬取中国天气网数据

用到模块: 获取网页并解析:import requests,html5lib from bs4 import BeautifulSoup 使用pyecharts的Bar可视化工具"绘制图表& ...

- 中国天气网API接口

http://www.weather.com.cn/data/sk/101010100.html http://www.weather.com.cn/data/cityinfo/101010100.h ...

随机推荐

- Python学习第九篇——while和for的区别

pets = ['dog','cat','dog','goldfish','cat','rabbit','cat'] print(pets) for pet in pets: print(pet) # ...

- 爬虫——xpath

1.什么是xpath? Xpath,全称XML Path Language,即XML路径语言.它是一门在XML之后查找信息的语言,也同样适用于HTML文档的搜索.在做爬虫的时候,我们用XPath语言来 ...

- MYSQL mydumper & myloader

第三方逻辑备份工具myduper和myloader | xiaoyu的数据库小窝-技术交流http://www.dbaxiaoyu.com/archives/1643 myloader原理0 - ze ...

- react组件传值传方法

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- HDU 5782 Cycle —— KMP

题目:Cycle 链接:http://acm.hdu.edu.cn/showproblem.php?pid=5782 题意:给出两个字符串,判断两个字符串的每一个前缀是否循环相等(比如abc 和 ca ...

- .Net MVC4 log4net的配置

一.首先在使用log4net记录日志的时候,我们要引用log4net.dll文件 二.在web.config中添加一下配置代码 <configSections> <!-- For m ...

- vue cli3 vue.config.js 配置详情

module.exports = { // 基本路径 baseUrl: process.env.NODE_ENV === 'production' ? '/' : '/', ...

- java中级——集合框架【4】-Collections

Collections 首先我们要知道Collections是一个类,容器的工具类,就如同Arrays是数组的工具类 反转 reverse 使List中的数据发生发转 package cn.jse.c ...

- Hbase获取流程

1\\.客户端chou操作 2.服务器dauncaozuo操作 3\存储优化

- k8s使用Glusterfs动态生成pv

一.环境介绍 [root@k8s-m ~]# cat /etc/hosts127.0.0.1 localhost localhost.localdomain localhost4 localhost4 ...