爬虫 - 请求库之requests

介绍

使用requests可以模拟浏览器的请求,比起python内置的urllib模块,requests模块的api更加便捷(本质就是封装了urllib3)

注意:requests库发送请求将网页内容下载下来以后,并不会执行js代码,这需要我们自己分析目标站点然后发起新的request请求

安装

>: pip3 install requests

使用

各种请求方式:常用的就是requests.get()和requests.post()

>>> import requests

>>> r = requests.get('https://api.github.com/events')

>>> r = requests.post('http://httpbin.org/post', data = {'key':'value'})

>>> r = requests.put('http://httpbin.org/put', data = {'key':'value'})

>>> r = requests.delete('http://httpbin.org/delete')

>>> r = requests.head('http://httpbin.org/get')

>>> r = requests.options('http://httpbin.org/get')

基于GET请求

基本请求

import requests response = requests.get(

url='https://www.目标网址.com'

)

response.encoding = 'utf-8'

# 以文本形式打印响应内容

print(response.text)

# 写入文本

with open('xxx.html', 'w') as f:

f.write(response.text)

携带参数的GET请求

HTTP默认的请求方法就是GET

* 没有请求体

* 数据必须在1K之内!

* GET请求数据会暴露在浏览器的地址栏中 GET请求常用的操作:

1. 在浏览器的地址栏中直接给出URL,那么就一定是GET请求

2. 点击页面上的超链接也一定是GET请求

3. 提交表单时,表单默认使用GET请求,但可以设置为POST

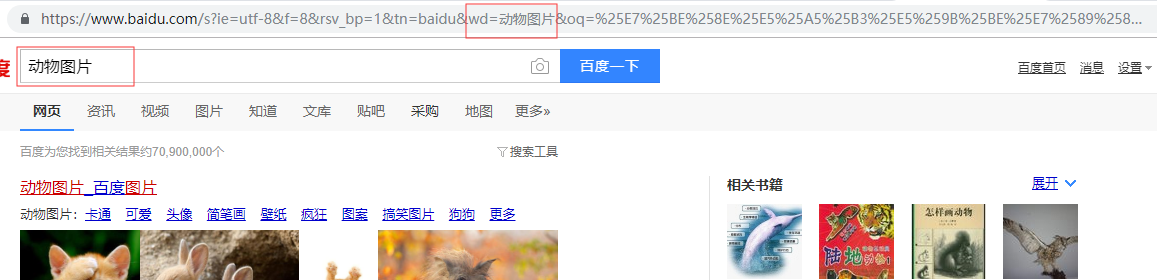

分析请求参数key=vules

携带参数请求方式一: url拼接

import requests

response = requests.get(

url='https://www.baidu.com/s?wd=动物图片',

# 请求头信息

headers = {

'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36'

}

)

response.encoding = 'utf-8'

print(response.text)

with open('动物图片1.html', 'w') as f:

f.write(response.text) 携带参数请求方式二: params

import requests

response = requests.get(

url='https://www.baidu.com/s',

headers = {

'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36'

},

params={

'wd': '动物图片'

}

)

response.encoding = 'utf-8'

print(response.text)

with open('动物图片2.html', 'w') as f:

f.write(response.text)

基于POST请求

POST请求

(1). 数据不会出现在地址栏中

(2). 数据的大小没有上限

(3). 有请求体

(4). 请求体中如果存在中文,会使用URL编码! #!!!requests.post()用法与requests.get()完全一致,特殊的是requests.post()有一个data参数,用来存放请求体数据

模拟浏览器的登录行为

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/62.0.3202.75 Safari/537.36',

'Referer': 'http://www.aa7a.cn/user.php?&ref=http%3A%2F%2Fwww.aa7a.cn%2F',

}

res = requests.post('http://www.aa7a.cn/user.php',

headers=headers,

data={

'username': 'xxxx@qq.com',

'password': 'xxx',

'captcha': '验证码',

'remember': 1,

'ref': 'http://www.aa7a.cn/',

'act': 'act_login'

}

)

#如果登录成功,cookie会存在于res对象中

cookie=res.cookies.get_dict()

#携带cookies向首页发送get请求

res=requests.get('http://www.aa7a.cn/',headers=headers,

cookies=cookie,

)

if 'xxxxx@qq.com' in res.text:

print("登录成功")

else:

print("没有登录")

'''

一 目标站点分析

浏览器输入https://github.com/login

然后输入错误的账号密码,抓包

发现登录行为是post提交到:https://github.com/session

而且请求头包含cookie

而且请求体包含:

commit:Sign in

utf8:✓

authenticity_token:lbI8IJCwGslZS8qJPnof5e7ZkCoSoMn6jmDTsL1r/m06NLyIbw7vCrpwrFAPzHMep3Tmf/TSJVoXWrvDZaVwxQ==

login:egonlin

password:123 二 流程分析

先GET:https://github.com/login拿到初始cookie与authenticity_token

返回POST:https://github.com/session, 带上初始cookie,带上请求体(authenticity_token,用户名,密码等)

最后拿到登录cookie ```

ps:如果密码时密文形式,则可以先输错账号,输对密码,然后到浏览器中拿到加密后的密码,github的密码是明文

``` ''' import requests

import re #第一次请求

r1=requests.get('https://github.com/login')

r1_cookie=r1.cookies.get_dict() #拿到初始cookie(未被授权)

authenticity_token=re.findall(r'name="authenticity_token".*?value="(.*?)"',r1.text)[0] #从页面中拿到CSRF TOKEN #第二次请求:带着初始cookie和TOKEN发送POST请求给登录页面,带上账号密码

data={

'commit':'Sign in',

'utf8':'✓',

'authenticity_token':authenticity_token,

'login':'317828332@qq.com',

'password':'alex3714'

}

r2=requests.post('https://github.com/session',

data=data,

cookies=r1_cookie

) login_cookie=r2.cookies.get_dict() #第三次请求:以后的登录,拿着login_cookie就可以,比如访问一些个人配置

r3=requests.get('https://github.com/settings/emails',

cookies=login_cookie) print('317828332@qq.com' in r3.text) #True 自动登录github(自己处理cookie信息)

补充

response属性

import requests

response = requests.get(url='http://www.jianshu.com') print(response.text)

print(response.content) # 二进制的页面信息 print(response.status_code) # 响应状态码

print(response.headers)

print(response.cookies)

print(response.cookies.get_dict())

print(response.cookies.items()) print(response.url)

print(response.history) print(response.encoding)

编码问题

response.encoding = 'utf-8'

获取二进制数据

import requests

response=requests.get('https://timgsa.baidu.com/timg?image&quality=80&size=b9999_10000&sec=1509868306530&di=712e4ef3ab258b36e9f4b48e85a81c9d&imgtype=0&src=http%3A%2F%2Fc.hiphotos.baidu.com%2Fimage%2Fpic%2Fitem%2F11385343fbf2b211e1fb58a1c08065380dd78e0c.jpg')

with open('a.jpg','wb') as f:

f.write(response.content)

下载大数据文件

#stream参数:一点一点的取,比如下载视频时,如果视频100G,用response.content然后一下子写到文件中是不合理的

import requests

response=requests.get('https://gss3.baidu.com/6LZ0ej3k1Qd3ote6lo7D0j9wehsv/tieba-smallvideo-transcode/1767502_56ec685f9c7ec542eeaf6eac93a65dc7_6fe25cd1347c_3.mp4',

stream=True)

with open('b.mp4','wb') as f:

for line in response.iter_content():

f.write(line)

获取二进制流

解析json

#解析json

import requests

response=requests.get('http://httpbin.org/get') import json

res1=json.loads(response.text) #太麻烦 res2=response.json() #直接获取json数据 print(res1 == res2) #True

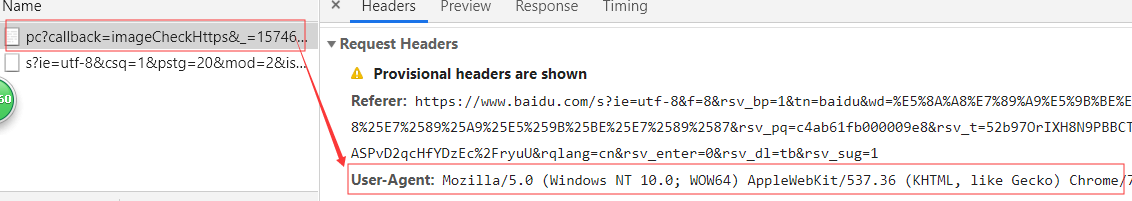

获取请求头中的UA

添加headers(浏览器会识别请求头,不加可能会被拒绝访问,比如访问

通常我们在发送请求时都需要带上请求头,请求头是将自身伪装成浏览器的关键,常见的有用的请求头如下

Host

Referer #大型网站通常都会根据该参数判断请求的来源

User-Agent #客户端

Cookie #Cookie信息虽然包含在请求头里,但requests模块有单独的参数来处理他,headers={}内就不要放它了

获取浏览器的 User-Agent

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36'

}

import requests

response = requests.get(

url='https://www.baidu.com/s',

headers = headers,

params={

'wd': '动物图片'

}

)

response.encoding = 'utf-8'

print(response.text)

print(response.status_code) # 200 打印响应状态码

高级用法

SSL

#证书验证(大部分网站都是https)

import requests

respone=requests.get('https://www.12306.cn') #如果是ssl请求,首先检查证书是否合法,不合法则报错,程序终端 #改进1:去掉报错,但是会报警告

import requests

respone=requests.get('https://www.12306.cn',verify=False) #不验证证书,报警告,返回200

print(respone.status_code) #改进2:去掉报错,并且去掉警报信息

import requests

from requests.packages import urllib3

urllib3.disable_warnings() #关闭警告

respone=requests.get('https://www.12306.cn',verify=False)

print(respone.status_code) #改进3:加上证书

#很多网站都是https,但是不用证书也可以访问,大多数情况都是可以携带也可以不携带证书

#知乎\百度等都是可带可不带

#有硬性要求的,则必须带,比如对于定向的用户,拿到证书后才有权限访问某个特定网站

import requests

respone=requests.get('https://www.12306.cn',

cert=('/path/server.crt',

'/path/key'))

print(respone.status_code)

使用代理

#官网链接: http://docs.python-requests.org/en/master/user/advanced/#proxies #代理设置:先发送请求给代理,然后由代理帮忙发送(封ip是常见的事情)

import requests

proxies={

'http':'http://egon:123@localhost:9743',#带用户名密码的代理,@符号前是用户名与密码

'http':'http://localhost:9743',

'https':'https://localhost:9743',

}

respone=requests.get('https://www.12306.cn',

proxies=proxies) print(respone.status_code) #支持socks代理,安装:pip install requests[socks]

import requests

proxies = {

'http': 'socks5://user:pass@host:port',

'https': 'socks5://user:pass@host:port'

}

respone=requests.get('https://www.12306.cn',

proxies=proxies) print(respone.status_code)

超时设置

#超时设置

#两种超时:float or tuple

#timeout=0.1 #代表接收数据的超时时间

#timeout=(0.1,0.2)#0.1代表链接超时 0.2代表接收数据的超时时间 import requests

respone=requests.get('https://www.baidu.com',

timeout=0.0001)

认证设置

#官网链接:http://docs.python-requests.org/en/master/user/authentication/ #认证设置:登陆网站是,弹出一个框,要求你输入用户名密码(与alter很类似),此时是无法获取html的

# 但本质原理是拼接成请求头发送

# r.headers['Authorization'] = _basic_auth_str(self.username, self.password)

# 一般的网站都不用默认的加密方式,都是自己写

# 那么我们就需要按照网站的加密方式,自己写一个类似于_basic_auth_str的方法

# 得到加密字符串后添加到请求头

# r.headers['Authorization'] =func('.....') #看一看默认的加密方式吧,通常网站都不会用默认的加密设置

import requests

from requests.auth import HTTPBasicAuth

r=requests.get('xxx',auth=HTTPBasicAuth('user','password'))

print(r.status_code) #HTTPBasicAuth可以简写为如下格式

import requests

r=requests.get('xxx',auth=('user','password'))

print(r.status_code)

异常处理

#异常处理

import requests

from requests.exceptions import * #可以查看requests.exceptions获取异常类型 try:

r=requests.get('http://www.baidu.com',timeout=0.00001)

except ReadTimeout:

print('===:')

# except ConnectionError: #网络不通

# print('-----')

# except Timeout:

# print('aaaaa') except RequestException:

print('Error')

eg:

#爬取视频

#https://www.pearvideo.com/category_loading.jsp?reqType=5&categoryId=1&start=48&mrd=0.9993282952193101&filterIds=1625835,1625642,1625837,1625841,1625870,1625869,1625813,1625844,1625801,1625856,1625857,1625847,1625838,1625827,1625787

#https://www.pearvideo.com/category_loading.jsp?reqType=5&categoryId=1&start=0

#获取视频

import re

res=requests.get('https://www.pearvideo.com/category_loading.jsp?reqType=5&categoryId=1&start=0') reg_text='<a href="(.*?)" class="vervideo-lilink actplay">' obj=re.findall(reg_text,res.text)

print(obj)

for url in obj:

url='https://www.pearvideo.com/'+url

res1=requests.get(url)

obj1=re.findall('srcUrl="(.*?)"',res1.text)

print(obj1[0])

name=obj1[0].rsplit('/',1)[1]

print(name)

res2=requests.get(obj1[0])

with open(name,'wb') as f:

for line in res2.iter_content():

f.write(line)

爬虫 - 请求库之requests的更多相关文章

- 爬虫请求库之requests库

一.介绍 介绍:使用requests可以模拟浏览器的请求,比之前的urllib库使用更加方便 注意:requests库发送请求将网页内容下载下来之后,并不会执行js代码,这需要我们自己分析目标站点然后 ...

- 爬虫——请求库之requests

阅读目录 一 介绍 二 基于GET请求 三 基于POST请求 四 响应Response 五 高级用法 一 介绍 #介绍:使用requests可以模拟浏览器的请求,比起之前用到的urllib,reque ...

- 爬虫请求库——requests

请求库,即可以模仿浏览器对网站发起请求的模块(库). requests模块 使用requests可以模拟浏览器的请求,requests模块的本质是封装了urllib3模块的功能,比起之前用到的urll ...

- [python爬虫]Requests-BeautifulSoup-Re库方案--Requests库介绍

[根据北京理工大学嵩天老师“Python网络爬虫与信息提取”慕课课程编写 文章中部分图片来自老师PPT 慕课链接:https://www.icourse163.org/learn/BIT-10018 ...

- python爬虫之路——初识爬虫三大库,requests,lxml,beautiful.

三大库:requests,lxml,beautifulSoup. Request库作用:请求网站获取网页数据. get()的基本使用方法 #导入库 import requests #向网站发送请求,获 ...

- 2.请求库之requests

requests模块阅读目录: 介绍 基于GET请求 基于POST请求 响应Response 高级用法 一.介绍 #介绍:使用requests可以模拟浏览器的请求,比起之前用到的urllib,requ ...

- 第二篇:请求库之requests,selenium

requests模块 一.介绍 #介绍:使用requests可以模拟浏览器的请求,比起之前用到的urllib,requests模块的api更加便捷(本质就是封装了urllib3) #注意:reques ...

- 爬虫请求库 requests

requests模块 阅读目录 一 介绍 二 基于GET请求 三 基于POST请求 四 响应Response 五 高级用法 一 介绍 #介绍:使用requests可以模拟浏览器的请求,比起之前用到 ...

- 爬虫----爬虫请求库requests

一 介绍 介绍:---------------------------------------------使用requests可以模拟浏览器的请求,比起之前用到的urllib,requests模块的a ...

随机推荐

- Sqlserver (转载)事物与锁

1 概述 本篇文章简要对事物与锁的分析比较详细,因此就转载了. 2 具体内容 并发可以定义为多个进程同时访问或修改共享数据的能力.处于活动状态而互不干涉的并发用户进程的数量越多,数据库系统的并 ...

- JVM 堆内存设置原理

堆内存设置 原理 JVM堆内存分为2块:Permanent Space 和 Heap Space. Permanent 即 持久代(Permanent Generation),主要存放的是Java类定 ...

- Spark学习(2) RDD编程

什么是RDD RDD(Resilient Distributed Dataset)叫做分布式数据集,是Spark中最基本的数据抽象,它代表一个不可变.可分区.弹性.里面的元素可并行计算的集合 RDD允 ...

- linux安装 uwsgi 测试 test.py 不显示hello world 的解决办法

一般部署项目到服务器,会安装uwsgi,但是很多教程在安装它的时候会让你测试一下安装好了没,于是就有很多像我一样懵逼的少年掉进一个坑里出不来,很久.很久... 那就是最后浏览器输入ip:8000端口后 ...

- 2. Spark GraphX解析

2.1 存储模式 2.1.1 图存储模式 巨型图的存储总体上有边分割和点分割两种存储方式 1)边分割(Edge-Cut):每个顶点都存储一次,但有的边会被打断分到两台机器上.这样做的好处是节省存储空间 ...

- (六)pdf的构成之文件体(pages对象)

页面树(pages) 通过页面树访问文档的页面,页面树定义PDF文档中的所有页面.树包含表示PDF文档页面的节点,可以是两种类型:中间节点和叶节点.中间节点也称为页面树节点,而叶节点称为页面对象.最简 ...

- golang 之 context包

概述 context是Go中广泛使用的程序包,由Google官方开发,在1.7版本引入.它用来简化在多个go routine传递上下文数据.(手动/超时)中止routine树等操作,比如,官方 ...

- CF241E Flights 差分约束

传送门 差分约束永远是Itst最烂的图论知识点没有之一qwq 先用dfs把在\(1\)到\(N\)的路径上的所有点都拿出来,其他的点和边状态任意都不会影响答案. 然后考虑设\(dis_i\)表示从\( ...

- sqoop与hbase导入导出数据

环境:sqoop1.4.6+hadoop2.6+hbase1.1+mysql5.7 说明: 1.文中的导入导出的表结构借鉴了网上的某篇博客 2.mysql导入hbase可以直接通过sqoop进行 3. ...

- P1018 乘积最大(DP)

题目 P1018 乘积最大 解析 区间DP 设\(f[i][j]\)表示选\(i\)个数,插入\(j\)个乘号时的最大值 设\(num[i][j]\)是\(s[i,j]\)里的数字 转移方程就是\(f ...