MSD_radix_sort

一、这次是在上一次尝试基础上进行的,预期是达到上次性能的9倍。

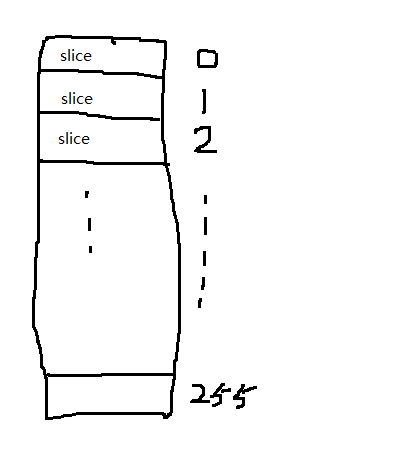

MSD的基本手法就是不断切片。

每一步都是把整体数据切割成256片,如上图所示,实际情况切片未必均匀,有的slice内可能一个元素也没有。

接下来对于每个切片怎么办呢?

答案是继续切,对于特殊数据来讲,切片过程可以很快结束,这样就可以实现比LSD更快的速度。

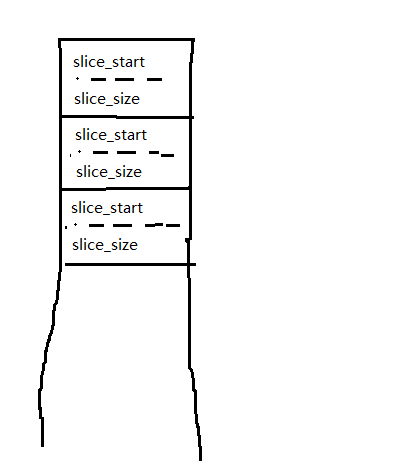

这里面最困难的地方就是如何存储每个slice的头和尾。

如果采用下述方式,应该是行不通的。

这个方式需要做数组元素插入,还要跟踪中间数据,因此没具体考虑。

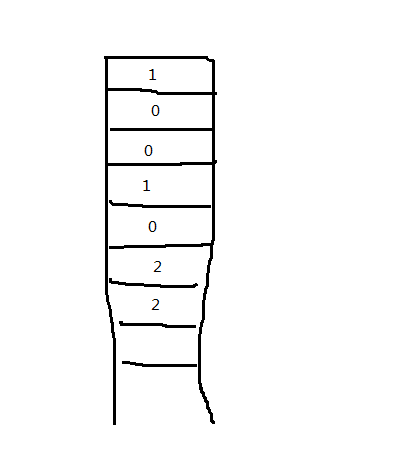

我真正采用的是下表:

表中第一项表示第一个元素开启一个类别,紧跟的0表示此元素和上面的1是同一类。

至于2表明在切片过程中是一个孤立的元素,后续就没必要再切片了。

这个方式可以大大简化编码。

二、伪代码。

for each slice

if slice-tag == continue;

if slice-tag ==

slice it;

update bookkeeping

int main(){

HANDLE heap = NULL;

Bucket bucket[BUCKETSLOTCOUNT];

PageList * pageListPool;

int plpAvailable = ;

int * pages = NULL;

int * pagesAvailable = NULL;

int * objIdx;

unsigned short * s;

__int8 * classifier = NULL;

time_t timeBegin;

time_t timeEnd;

heap = HeapCreate(HEAP_NO_SERIALIZE|HEAP_GENERATE_EXCEPTIONS, *, );

if (heap != NULL){

pages = (int * )HeapAlloc(heap, , (TFSI/PAGEGRANULAR + BUCKETSLOTCOUNT + ) * PAGEAMOUNT);

pageListPool = (PageList *)HeapAlloc(heap, , (TFSI/PAGEGRANULAR + ) * sizeof(PageList));

s = (unsigned short *)HeapAlloc(heap, , TFSI*sizeof(unsigned short));

objIdx = (int *)HeapAlloc(heap, , TFSI * sizeof(int));

classifier = (__int8 *)HeapAlloc(heap, , (TFSI+)*sizeof(__int8));

}

MakeSure(pages != NULL && pageListPool != NULL && objIdx != NULL && classifier != NULL);

for(int i=; i<TFSI; i++) objIdx[i]=i;

timeBegin = clock();

for (int i=; i<TFSI; i++) s[i] = rand();

timeEnd = clock();

printf("\n%f(s) consumed in generating numbers", (double)(timeEnd-timeBegin)/CLOCKS_PER_SEC);

SecureZeroMemory(classifier, TFSI*sizeof(__int8));

classifier[] = ;

classifier[TFSI] = ;

timeBegin = clock();

bool no_need_further_processing = false;

for (int t=sizeof(short)-; t>=; t--){

int bucketIdx;

int slice_pointer = ;

int slice_base = ;

int flagCounter = ;

if (no_need_further_processing) break;

//classifier: 1 new catagory

//classifier: 2 completed catagory process

while (slice_pointer < TFSI){

if (classifier[slice_pointer] == ){

slice_base = slice_pointer;

classifier[slice_base] = ;

while (classifier[slice_pointer] == ){

slice_pointer++;

flagCounter++;

}

classifier[slice_base] = ;

if (flagCounter == TFSI) no_need_further_processing = true;

continue;

}

if (classifier[slice_pointer] == ){

FillMemory(pages, (TFSI/PAGEGRANULAR + BUCKETSLOTCOUNT + ) * PAGEAMOUNT, 0xff);

SecureZeroMemory(pageListPool, (TFSI/PAGEGRANULAR + ) * sizeof(PageList));

pagesAvailable = pages;

plpAvailable = ;

for(int i=; i<; i++){

bucket[i].currentPagePtr = pagesAvailable;

bucket[i].offset = ;

bucket[i].pl.PagePtr = pagesAvailable;

bucket[i].pl.next = NULL;

pagesAvailable += PAGEGRANULAR;

bucket[i].currentPageListItem = &(bucket[i].pl);

}

slice_base = slice_pointer;

classifier[slice_base] = ;

while (classifier[slice_pointer] == ){

//for each slice element, push_back to pages;

unsigned char * cell = (unsigned char *)&s[objIdx[slice_pointer]];

bucketIdx = cell[t];

//save(bucketIdx, objIdx[i]);

bucket[bucketIdx].currentPagePtr[ bucket[bucketIdx].offset ] = objIdx[slice_pointer];

bucket[bucketIdx].offset++;

if (bucket[bucketIdx].offset == PAGEGRANULAR){

bucket[bucketIdx].currentPageListItem->next = &pageListPool[plpAvailable];

plpAvailable++;

bucket[bucketIdx].currentPageListItem->next->PagePtr = pagesAvailable;

bucket[bucketIdx].currentPageListItem->next->next = NULL;

bucket[bucketIdx].currentPagePtr = pagesAvailable;

bucket[bucketIdx].offset = ;

pagesAvailable += PAGEGRANULAR;

bucket[bucketIdx].currentPageListItem = bucket[bucketIdx].currentPageListItem->next;

}

slice_pointer++;

}

classifier[slice_base] = ;

//update classifier;

//update objIdx index

int start = slice_base;

for (int i=; i<; i++){

PageList * p;

p = &(bucket[i].pl);

//classifier: 1 new catagory

//classifier: 2 complete catagory process

classifier[start] = ;

int counters = ;

while (p){

for (int t=; t<PAGEGRANULAR; t++){

int idx = p->PagePtr[t];

if (idx != TERMINATOR){

objIdx[start] = idx;

start++;

counters++;

}

if (idx == TERMINATOR) break;

}

p = p->next;

}

if (counters == ) classifier[start-] = ;

}

//update objIdx index

} //if (classifier[slice_pointer] == 1)

} //while (slice_pointer < TFSI)

} //for (int t=sizeof(short)-1; t>=0; t--)

timeEnd = clock();

printf("\n%f(s) consumed in generating results", (double)(timeEnd-timeBegin)/CLOCKS_PER_SEC);

//for(int i=0; i<TFSI; i++) printf("%d\n", s[objIdx[i]]);

HeapFree(heap, , pages);

HeapFree(heap, , pageListPool);

HeapFree(heap, , s);

HeapFree(heap, , objIdx);

HeapFree(heap, , classifier);

HeapDestroy(heap);

return ;

}

三、测试

1024*1024*100 个短整型。

时间 5.438s

看到这里就知道杯具了,比LSD还慢。

如果应用到二维表,会更惨不忍睹。试了下果然如此。

四、讨论

如果哪位有更好的方法,欢迎讨论。

或者,基数排序只是一个花瓶?

MSD_radix_sort的更多相关文章

- 读写ini文件

C# 使用文件流来读写ini文件 背景 之前采用ini文件作为程序的配置文件,觉得这种结构简单明了,配置起来也挺方便.然后操作方式是通过WindowsAPI,然后再网上找到一个基于WindowsAPI ...

随机推荐

- linux学习3(vim)

一.文档编辑 1. vi和vim命令 Vim的打开文件的方式(4种,要求掌握的就前三种): 1. vim 文件路径 ...

- java从笨鸟到菜鸟

链接别人的笔记 http://www.cnblogs.com/cugwx/p/3536840.html

- Autel MaxiSys Pro Description

Autel MaxiSys pro MS908P is an evolutionary smart solution for specialized automotive diagnosis and ...

- hdu 6288(二分法加精度处理问题)

题目链接:http://acm.hdu.edu.cn/showproblem.php?pid=6288 题意:给出a,b,k,n可满足(n^a)*(⌈log2n⌉)^b<=k ,求最大的n值三个 ...

- SQL SERVER linked server Login failed for user 'NT AUTHORITY\ANONYMOUS LOGON'

昨天创建了一个View, 这个view是一系列的表达式(CTE)组成,封装了好多的业务逻辑,简化下语句如下 ;with CTE AS( ...) SELECT a.company_id ,b.comp ...

- yarn/mapreduce工作机制及mapreduce客户端代码编写

首先需要知道的就是在老版本的hadoop中是没有yarn的,mapreduce既负责资源分配又负责业务逻辑处理.为了解耦,把资源分配这块抽了出来,形成了yarn,这样不仅mapreudce可以用yar ...

- 修改虚拟机IP地址

Linux环境下IP地址配置文件路径: vim /etc/sysconfig/network-scripts/ifcfg-eth0 DEVICE="eth0" BOOTPROTO ...

- linux 访问 windows 共享文件夹

http://www.01happy.com/linux-access-windows-shares-folders/

- xftp的使用教程

使用xftp来上传,下载文件到linux主机 首先,我们要下载一个xftp,因为官网是英文的,还需要邮件激活,在这里我把程序下载好 此时已经安装完成,点击finish,打开软件登录SSH账号,这里以默 ...

- 高精度运算——java

java大法 java的框架. import java.io.*; import java.util.*; import java.math.*; public class Main{ public ...