Pyspark笔记一

1. pyspark读csv文件后无法显示中文

#pyspark读取csv格式时,不能显示中文

df = spark.read.csv(r"hdfs://mymaster:8020/user/root/data_spark.csv", schema=schema) #解决方法,加入encoding='gbk',即

df = spark.read.csv(r"hdfs://mymaster:8020/user/root/data_spark.csv", schema=schema, encoding='gbk')

2. 查看和修改默认编码格式

import sys

#查看默认编码格式

print(sys.getdefaultencoding()) #修改编码格式

sys.setdefaultencoding('utf8') #参考:https://blog.csdn.net/abc_321a/article/details/81945577

3. pyspark导入spark

原因:python中没有默认的sparksession,需要导入

#方法

from pyspark import SparkContext

from pyspark.sql.session import SparkSession sc = SparkContext('local', 'test')

spark = SparkSession(sc)

#之后即可以使用spark

#参考:https://blog.csdn.net/zt7524/article/details/98173650

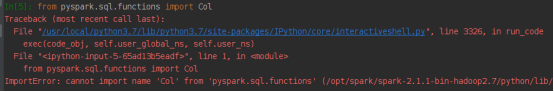

4. Pyspark引入col函数出错,ImportError: cannot import name 'Col' from 'pyspark.sql.functions'

#有人建议的是,不过我用的时候会报错

from pyspark.sql.functions import col #后来测试了一种方式可以用

from pyspark.sql import Row, column #也试过另一个参考,不过要更新pyspark包之类的,于是暂时没有用该方法,也就是安装pyspark-stubs包:pip install pyspark-stubs

#参考:http://isunix.github.io/blog/2019/06/04/pysparkzhong-yin-ru-colhan-shu-de-fang-shi/

#参考:https://stackoverflow.com/questions/40163106/cannot-find-col-function-in-pyspark

#参考:https://pypi.org/project/pyspark-stubs/

5. Exception: Python in worker has different version 2.6 than that in driver 3.7, PySpark cannot run with different minor versions.

#我是在Red hat环境下,装了两个python版本,于是报错

# 解决方案:在环境中加入想用的python版本

import os

os.environ["PYSPARK_PYTHON"]="/usr/bin/python3"

#参考:https://blog.csdn.net/wmh13262227870/article/details/77992608

6. 在Red hat上使用pip3 安装pandas的时候出错:pip is configured with locations that require TLS/SSL, however the ssl module in Python is not available.

原因:python 3.7版本会出现这个问题,是因为openssl的版本比较低

方法:必须先升级openssl,然后重新编译或者安装python,顺序要注意

升级openssl和编译python可参考:https://www.cnblogs.com/jasonLiu2018/articles/10730605.html

注意:./configure --prefix=/usr/local/python3 --with-openssl=/usr/local/openssl 是先cd到python解压后的目录,再使用的,例如解压目录是当前目录的:Python-3.7.0,则先在命令行执行 cd Python-3.7.0,进入该目录,执行上述./configure代码,/usr/local/python3是python将要安装的目录,/usr/local/openssl是openssl已安装的目录;然后直接依次:make, make install重装python。

升级openssl可参考:

https://www.cnblogs.com/caibao666/p/9698842.html

https://www.cnblogs.com/mqxs/p/9103031.html

Pyspark笔记一的更多相关文章

- PySpark笔记

spark源码位置:https://github.com/apache/spark Spark Core核心RDD及编程 什么是RDD:1.是一个抽象类不能直接使用,在子类中实现抽象方法是一个抽象类不 ...

- Spark调研笔记第4篇 - PySpark Internals

事实上.有两个名为PySpark的概念.一个是指Sparkclient内置的pyspark脚本.而还有一个是指Spark Python API中的名为pyspark的package. 本文仅仅对第1个 ...

- pyspark学习笔记

记录一些pyspark常用的用法,用到的就会加进来 pyspark指定分区个数 通过spark指定最终存储文件的个数,以解决例如小文件的问题,比hive方便,直观 有两种方法,repartition, ...

- pyspark 学习笔记

from pyspark.sql import SparkSession spark = SparkSession \ .builder \ .appName("Python Spark S ...

- 【原】Learning Spark (Python版) 学习笔记(三)----工作原理、调优与Spark SQL

周末的任务是更新Learning Spark系列第三篇,以为自己写不完了,但为了改正拖延症,还是得完成给自己定的任务啊 = =.这三章主要讲Spark的运行过程(本地+集群),性能调优以及Spark ...

- Spark.ML之PipeLine学习笔记

地址: http://spark.apache.org/docs/2.0.0/ml-pipeline.html Spark PipeLine 是基于DataFrames的高层的API,可以方便用户 ...

- Spark调研笔记第2篇 - 怎样通过Sparkclient向Spark提交任务

在上篇笔记的基础上,本文介绍Sparkclient的基本配置及Spark任务提交方式. 1. Sparkclient及基本配置 从Spark官网下载的pre-built包中集成了Sparkclient ...

- Spark 基本函数学习笔记一

Spark 基本函数学习笔记一¶ spark的函数主要分两类,Transformations和Actions. Transformations为一些数据转换类函数,actions为一些行动类函数: ...

- 大数据学习——spark笔记

变量的定义 val a: Int = 1 var b = 2 方法和函数 区别:函数可以作为参数传递给方法 方法: def test(arg: Int): Int=>Int ={ 方法体 } v ...

随机推荐

- Python - Django - simple_tag 和 inclusion_tag

simple_tag: simple_tag 和自定义 filter 类似,但可以接收更多更灵活的参数 在 app01/templatetags/ 目录下创建 mysimple_tag.py mysi ...

- 【计算机视觉】OpenCV篇(5) - 仿射变换与透视变换

参考: 图像处理的仿射变换与透视变换(https://www.imooc.com/article/27535) http://ex2tron.wang/opencv-python-extra-warp ...

- idea中报Can't start Git: git.exe The path to Git executable is probably not valid. Fix it

解决办法,点解Fix it,或者File ----setting------version control-------git,设置git的可执行文件路径就可以了 设置好了git的安装路径的可运行文件 ...

- JSON和JSONP具体是干神马的呢? (含jQuery实例)

说到AJAX就会不可避免的面临两个问题,第一个是AJAX以何种格式来交换数据?第二个是跨域的需求如何解决?这两个问题目前都有不同的解决方案,比如数据可以用自定义字符串或者用XML来描述,跨域可以通过服 ...

- 安卓app和苹果app共用一个二维码

应项目要求,现在安卓app和苹果app共用一个二维码,对外提供下载: <html> <head> <meta http-equiv="Content-Type& ...

- top命令常用

top 使用时的命令: Ctrl+L擦除并且重写屏幕. h或者?显示帮助画面,给出一些简短的命令总结说明. k 终止一个进程.系统将提示用户输入需要终止的进程PID,以及需要发送给该进程什么样的信号. ...

- box-shadow 用法总结

一.基础知识 box-shadow 属性向框添加一个或多个阴影. 语法 box-shadow: offset-x offset-y blur spread color inset; box-shado ...

- Duration和Period的区别--通俗易懂

在jdk1.8以后,对表示日期时间的类型进行了重新分类,这里出现了2个新的类,Duraction 和Period Duraction表示:时间的区间,用来度量秒和纳秒之间的时间值 Period表示:一 ...

- 如何理解MVC

在面试的时候,MVC这个概念考的次数很多,有许多人只能把三个字母解释成三个单词:model,view,controller,但是如果往深处说就说不出来什么东西了,对这个概念模糊不清,今天闲来无事看了一 ...

- javascript常用小案例

常用javascript小案例 样式调节 //注: 这个可以控制td中的字段成行显示 #modelInfos td,th { white-space: nowrap; } //文本输入框随着内容尺寸往 ...