Appendix 1- LLN and Central Limit Theorem

1. 大数定律(LLN)

设Y1,Y2,……Yn是独立同分布(iid,independently identically distribution)的随机变量,A = SY /n = (Y1+...+Yn)/n。若将Y1,Y2……Yn看做是随机变量Y的n次采样,那么A是Y的采样平均。

因为 ,故 . It is important to understand that the variance of the sum increases with n and the variance of the normalized sum (the sample average, A) decreases with n.

弱大数定律与强大数定律:

两种不同的收敛形式,即几乎必然收敛(converge almost surely, 简称a.s.收敛)和依概率收敛(converge in probability, 简称i.p.收敛). 在概率空间中,a.s.收敛强于i.p.

- 两者前提条件一样:要求iid分布并期望存在。

- 弱大数定律表示样本均值“依概率收敛”于总体均值,即大概率会收敛,但无法保证是否存在某个n使之不收敛。

- 强大数定律表示样本均值“几乎处处收敛”,比弱大数定律强。

T是信源发出的长为n序列,相当于独立事件发生n次。

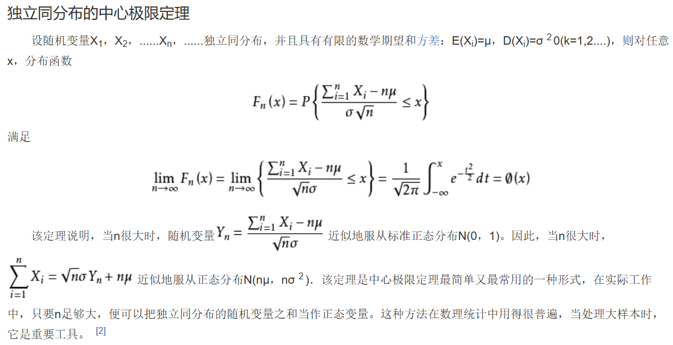

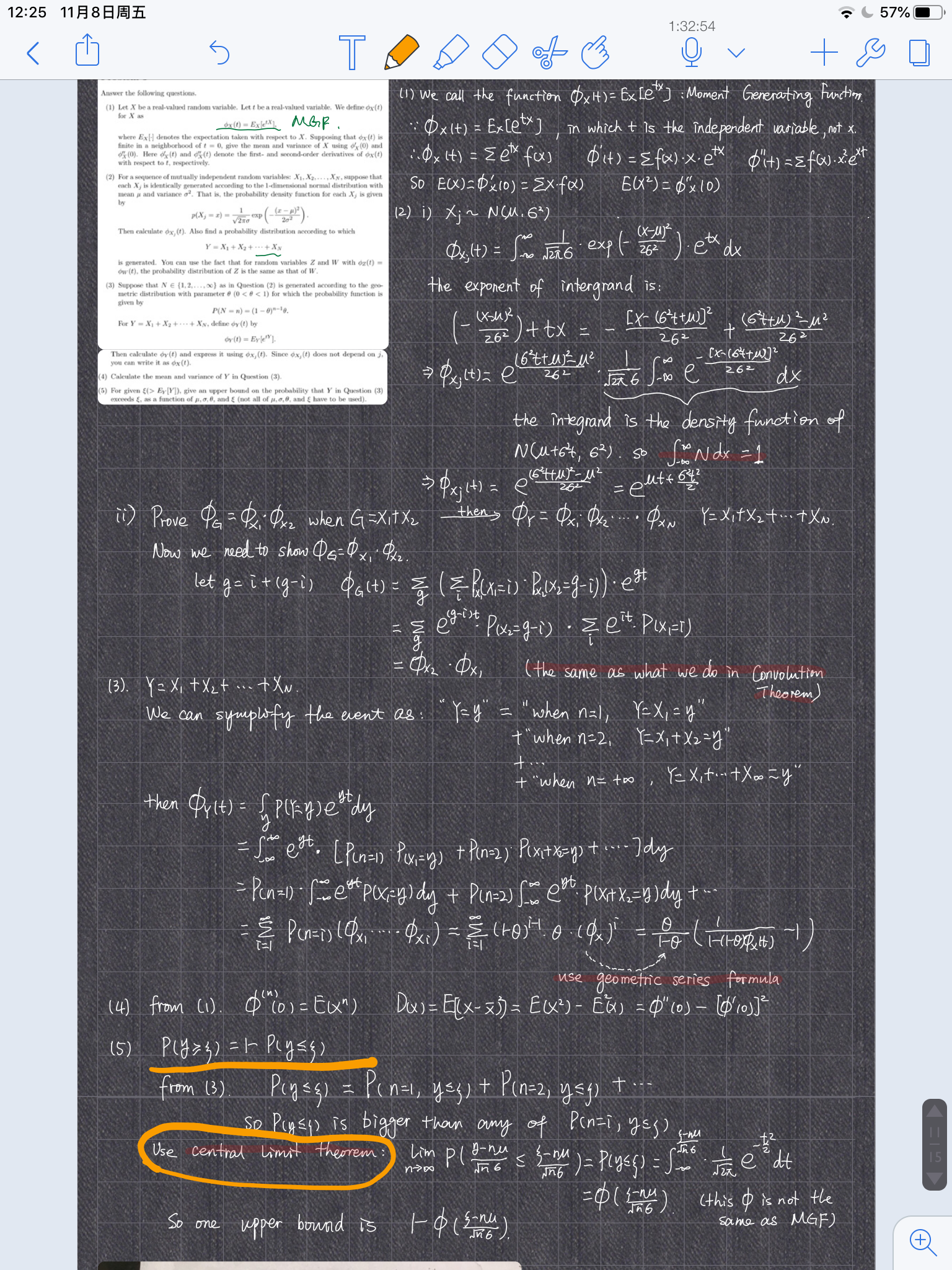

2. 中心极限定理

中心极限定理central limit theorem是说:

- 样本的平均值约等于总体的平均值。

- 不管总体是什么分布,任意一个总体的样本平均值都会围绕在总体的整体平均值周围,并且呈正态分布。前提条件:要求iid分布,期望方差都有限并存在。

Appendix 1- LLN and Central Limit Theorem的更多相关文章

- Law of large numbers and Central limit theorem

大数定律 Law of large numbers (LLN) 虽然名字是 Law,但其实是严格证明过的 Theorem weak law of large number (Khinchin's la ...

- 加州大学伯克利分校Stat2.2x Probability 概率初步学习笔记: Section 4 The Central Limit Theorem

Stat2.2x Probability(概率)课程由加州大学伯克利分校(University of California, Berkeley)于2014年在edX平台讲授. PDF笔记下载(Acad ...

- Sampling Distributions and Central Limit Theorem in R(转)

The Central Limit Theorem (CLT), and the concept of the sampling distribution, are critical for unde ...

- 【概率论】6-3:中心极限定理(The Central Limit Theorem)

title: [概率论]6-3:中心极限定理(The Central Limit Theorem) categories: - Mathematic - Probability keywords: - ...

- Sampling Distribution of the Sample Mean|Central Limit Theorem

7.3 The Sampling Distribution of the Sample Mean population:1000:Scale are normally distributed with ...

- 中心极限定理(Central Limit Theorem)

中心极限定理:每次从总体中抽取容量为n的简单随机样本,这样抽取很多次后,如果样本容量很大,样本均值的抽样分布近似服从正态分布(期望为 ,标准差为 ). (注:总体数据需独立同分布) 那么样本容量n应 ...

- 中心极限定理 | central limit theorem | 大数定律 | law of large numbers

每个大学教材上都会提到这个定理,枯燥地给出了定义和公式,并没有解释来龙去脉,导致大多数人望而生畏,并没有理解它的美. <女士品茶>有感 待续~ 参考:怎样理解和区分中心极限定理与大数定律?

- (main)贝叶斯统计 | 贝叶斯定理 | 贝叶斯推断 | 贝叶斯线性回归 | Bayes' Theorem

2019年08月31日更新 看了一篇发在NM上的文章才又明白了贝叶斯方法的重要性和普适性,结合目前最火的DL,会有意想不到的结果. 目前一些最直觉性的理解: 概率的核心就是可能性空间一定,三体世界不会 ...

- Understanding the Effective Receptive Field in Deep Convolutional Neural Networks

Understanding the Effective Receptive Field in Deep Convolutional Neural Networks 理解深度卷积神经网络中的有效感受野 ...

随机推荐

- BZOJ 2982 combination 脑子+组合数学

可以发现,整个数列构成一个树形结构,并且是个完全二叉堆(小根堆). 并且这个堆的形态在给定$n$后是固定的,第1个位置上显然只能放1. 对子树的根来说,他自己是所分得的数集中最小的那个,所以从剩下$s ...

- qt install (1)

直接在命令行安装 sudo apt-get install qt5-default qtcreator 命令行安装的卸载 sudo apt-get remove qt5-default qtcreat ...

- 微信打开手机内置浏览器跳转手机默认浏览器打开html网页

微信上进行的网页宣传.游戏传播.APP下载各类活动很多,但是各位朋友肯定经常会遇到一些特殊需求,网页需要在手机默认浏览器打开而不是微信内置浏览器.这个问题怎么解决呢? 斗在微信营销的浪潮中 解决方案: ...

- layer是一款近年来备受青睐的web弹层组件

layer.closeAll(); //疯狂模式,关闭所有层 layer.closeAll('dialog'); //关闭信息框 layer.closeAll('page'); //关闭所有页面层 l ...

- Java中二维数组

二维数组:(其实是一个一维数组,它的每一个元素又是一个一维数组), 可以看做是一张表格. 初始化: 动态初始化 int[ ][ ] arr = new int[3][2]; 定义了一个二维数组,其中 ...

- C/C++程序基础-C++与C有什么不同

1:C和C++的联系和区别? 答:C是一个结构化语言,它的重点在于算法和数据结构.对于语言本身而言,C是C++的子集.C程序的设计首先要考虑的是如何通过一个过程,对输入进行运算处理,得到输出.对于C+ ...

- Guava中Lists.partition(List, size) 方法懒划分/懒分区

目录 Guava中Lists.partition(List, size) 方法懒划分/懒分区 背景 分析 总结 Guava中Lists.partition(List, size) 方法懒划分/懒分区 ...

- 最大生成树+map实现技巧

POJ2263 //#include<bits/stdc++.h> #include<iostream> #include<cstdio> #include< ...

- 深度学习变革视觉计算总结(CCF-GAIR)

孙剑博士分享的是<深度学习变革视觉计算>,分别从视觉智能.计算机摄影学和AI计算三个方面去介绍. 他首先回顾了深度学习发展历史,深度学习发展到今天并不容易,过程中遇到了两个主要障碍: 第一 ...

- 【MyBatis】从一千万记录中批量删除八百万条,耗时4m7s

批量删除主要借助了MySql的limit函数,其次用了in删除. 代码如下: package com.hy.action; import java.io.Reader; import java.uti ...