做一个logitic分类之鸢尾花数据集的分类

做一个logitic分类之鸢尾花数据集的分类

Iris 鸢尾花数据集是一个经典数据集,在统计学习和机器学习领域都经常被用作示例。数据集内包含 3 类共 150 条记录,每类各 50 个数据,每条记录都有 4 项特征:花萼长度、花萼宽度、花瓣长度、花瓣宽度,可以通过这4个特征预测鸢尾花卉属于(iris-setosa, iris-versicolour, iris-virginica)中的哪一品种。

首先我们来加载一下数据集。同时大概的展示下数据结构和数据摘要。

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

data = pd.read_csv('./data/iris.csv')

print(data.head())

print(data.info())

print(data['Species'].unique())

Unnamed: 0 Sepal.Length Sepal.Width Petal.Length Petal.Width Species

0 1 5.1 3.5 1.4 0.2 setosa

1 2 4.9 3.0 1.4 0.2 setosa

2 3 4.7 3.2 1.3 0.2 setosa

3 4 4.6 3.1 1.5 0.2 setosa

4 5 5.0 3.6 1.4 0.2 setosa

<class 'pandas.core.frame.DataFrame'>

RangeIndex: 150 entries, 0 to 149

Data columns (total 6 columns):

Unnamed: 0 150 non-null int64

Sepal.Length 150 non-null float64

Sepal.Width 150 non-null float64

Petal.Length 150 non-null float64

Petal.Width 150 non-null float64

Species 150 non-null object

dtypes: float64(4), int64(1), object(1)

memory usage: 7.2+ KB

None

['setosa' 'versicolor' 'virginica']

通过上述数据的简单摘要,我们可以得到鸢尾花一共有三类:

- setosa

- versicolor

- virginica

我们分别用0,1,2来表示['setosa' 'versicolor' 'virginica']

整理

首先,我们对数据集进行一个简单的整理。我们需要把分类替换成0,1,2

其次,我们把数据集分成两个分类,一个用来训练我们的logitic算法的参数,另外一个用来测试我们的训练的结果

以下是代码:

# 数值替换

data.loc[data['Species']=='setosa','Species']=0

data.loc[data['Species']=='versicolor','Species']=1

data.loc[data['Species']=='virginica','Species']=2

print(data)

Unnamed: 0 Sepal.Length Sepal.Width Petal.Length Petal.Width Species

0 1 5.1 3.5 1.4 0.2 0

1 2 4.9 3.0 1.4 0.2 0

2 3 4.7 3.2 1.3 0.2 0

3 4 4.6 3.1 1.5 0.2 0

4 5 5.0 3.6 1.4 0.2 0

.. ... ... ... ... ... ...

145 146 6.7 3.0 5.2 2.3 2

146 147 6.3 2.5 5.0 1.9 2

147 148 6.5 3.0 5.2 2.0 2

148 149 6.2 3.4 5.4 2.3 2

149 150 5.9 3.0 5.1 1.8 2

[150 rows x 6 columns]

#分割训练集和测试集

train_data = data.sample(frac=0.6,random_state=0,axis=0)

test_data = data[~data.index.isin(train_data.index)]

train_data = np.array(train_data)

test_data = np.array(test_data)

train_label = train_data[:,5:6].astype(int)

test_label = test_data[:,5:6].astype(int)

print(train_label[:1])

print(test_label[:1])

train_data = train_data[:,1:5]

test_data = test_data[:,1:5]

print(np.shape(train_data))

print(np.shape(train_label))

print(np.shape(test_data))

print(np.shape(test_label))

[[2]]

[[0]]

(90, 4)

(90, 1)

(60, 4)

(60, 1)

我们需要把label编程1ofN的样式

经过上述两步的操作,我们可以看到数据集被分成两个部分。我们接下来对数据进行logitic分类。

train_label_onhot = np.eye(3)[train_label]

test_label_onhot = np.eye(3)[test_label]

train_label_onhot = train_label_onhot.reshape((90,3))

test_label_onhot = test_label_onhot.reshape((60,3))

print(train_label_onhot[:3])

[[0. 0. 1.]

[0. 1. 0.]

[1. 0. 0.]]

分类

思路

我选选择先易后难的方法来处理这个问题:

如果我们有两个分类0或者1的话,我们需要判断特征值X(N维)是否可以归为某个分类。我们的步骤如下:

- 初始化参数w(1,N)和b(1)

- 计算 \(z = \sum_{i=0}^{n}w*x + b\)

- 带入\(\sigma\)函数得到\(\hat{y}=\sigma(z)\)

现在有多个分类, 我们就需要使用one-to-many的方法去计算。简单的理解,在本题中,一共有3个分类。我们需要计算\(\hat{y}_1\)来表明这个东西是分类1或者不是分类1的概率 \(\hat{y}_2\)是不是分类2的概率,\(\hat{y}_3\)是不是分类3的概率。然后去比较这三个分类那个概率最大,就是哪个的概率。

比较属于哪个概率大的算法,我们用softmat。就是计算\(exp(\hat{y}_1)\),\(exp(\hat{y}_2)\),\(exp(\hat{y}_3)\),然后得到属于三个分类的概率分别是

- p1=\(\frac{exp(\hat{y}_1)}{\sum_{i=0}{3}(\hat{y}_i)}\)

- p1=\(\frac{exp(\hat{y}_2)}{\sum_{i=0}{3}(\hat{y}_i)}\)

- p1=\(\frac{exp(\hat{y}_3)}{\sum_{i=0}{3}(\hat{y}_i)}\)

我们根据上述思想去计算一条记录,代码如下:

def sigmoid(s):

return 1. / (1 + np.exp(-s))

w = np.random.rand(4,3)

b = np.random.rand(3)

def get_result(w,b):

z = np.matmul(train_data[0],w) +b

y = sigmoid(z)

return y

y = get_result(w,b)

print(y)

[0.99997447 0.99966436 0.99999301]

上述代码是我们只求一条记录的代码,下面我们给他用矩阵化修改为一次计算全部的训练集的\(\hat{y}\)

def get_result_all(data,w,b):

z = np.matmul(data,w)+ b

y = sigmoid(z)

return y

y=get_result_all(train_data,w,b)

print(y[:10])

[[0.99997447 0.99966436 0.99999301]

[0.99988776 0.99720719 0.9999609 ]

[0.99947512 0.98810796 0.99962362]

[0.99999389 0.99980632 0.999999 ]

[0.9990065 0.98181945 0.99931113]

[0.99999094 0.9998681 0.9999983 ]

[0.99902719 0.98236513 0.99924728]

[0.9999761 0.99933525 0.99999313]

[0.99997542 0.99923594 0.99999312]

[0.99993082 0.99841774 0.99997519]]

接下来我们要求得一个损失函数,来计算我们得到的参数和实际参数之间的偏差,关于分类的损失函数,请看这里

单个分类的损失函数如下:

\]

损失函数的导数求法如下

当 \(y_i=0\)时

w的导数为:

\]

化简得到

\]

b的导数为

\]

化简得到

\]

当\(y_i\)=1时

w的导数

\]

化简

\]

b的导数

\]

综合起来可以得到

\]

\]

我们只需要根据以下公式不停的调整w和b,就是机器学习的过程

\]

\]

下面我们来写下代码:

learning_rate = 0.0001

def eval(data,label, w,b):

y = get_result_all(data,w,b)

y = y.argmax(axis=1)

y = np.eye(3)[y]

count = np.shape(data)[0]

acc = (count - np.power(y-label,2).sum()/2)/count

return acc

def train(step,w,b):

y = get_result_all(train_data,w,b)

loss = -1*(train_label_onhot * np.log(y) +(1-train_label_onhot)*np.log(1-y)).sum()

dw = np.matmul(np.transpose(train_data),y - train_label_onhot)

db = (y - train_label_onhot).sum(axis=0)

w = w - learning_rate * dw

b = b - learning_rate * db

return w, b,loss

loss_data = {'step':[],'loss':[]}

train_acc_data = {'step':[],'acc':[]}

test_acc_data={'step':[],'acc':[]}

for step in range(3000):

w,b,loss = train(step,w,b)

train_acc = eval(train_data,train_label_onhot,w,b)

test_acc = eval(test_data,test_label_onhot,w,b)

loss_data['step'].append(step)

loss_data['loss'].append(loss)

train_acc_data['step'].append(step)

train_acc_data['acc'].append(train_acc)

test_acc_data['step'].append(step)

test_acc_data['acc'].append(test_acc)

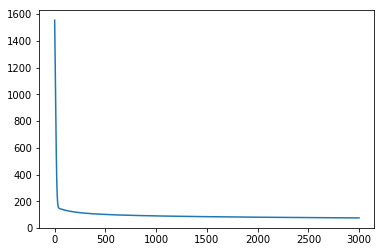

plt.plot(loss_data['step'],loss_data['loss'])

plt.show()

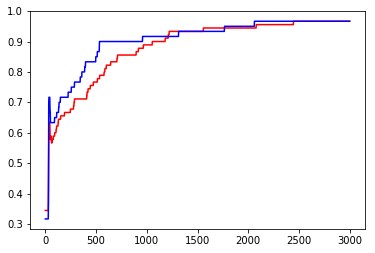

plt.plot(train_acc_data['step'],train_acc_data['acc'],color='red')

plt.plot(test_acc_data['step'],test_acc_data['acc'],color='blue')

plt.show()

print(test_acc_data['acc'][-1])

![png]

![png]

0.9666666666666667

从上述运行结果中来看,达到了96.67%的预测准确度。还不错!

做一个logitic分类之鸢尾花数据集的分类的更多相关文章

- 实验一 使用sklearn的决策树实现iris鸢尾花数据集的分类

使用sklearn的决策树实现iris鸢尾花数据集的分类 要求: 建立分类模型,至少包含4个剪枝参数:max_depth.min_samples_leaf .min_samples_split.max ...

- Python实现鸢尾花数据集分类问题——基于skearn的NaiveBayes

Python实现鸢尾花数据集分类问题——基于skearn的NaiveBayes 代码如下: # !/usr/bin/env python # encoding: utf-8 __author__ = ...

- Python实现鸢尾花数据集分类问题——基于skearn的LogisticRegression

Python实现鸢尾花数据集分类问题——基于skearn的LogisticRegression 一. 逻辑回归 逻辑回归(Logistic Regression)是用于处理因变量为分类变量的回归问题, ...

- Python实现鸢尾花数据集分类问题——基于skearn的SVM

Python实现鸢尾花数据集分类问题——基于skearn的SVM 代码如下: # !/usr/bin/env python # encoding: utf-8 __author__ = 'Xiaoli ...

- Python实现鸢尾花数据集分类问题——使用LogisticRegression分类器

. 逻辑回归 逻辑回归(Logistic Regression)是用于处理因变量为分类变量的回归问题,常见的是二分类或二项分布问题,也可以处理多分类问题,它实际上是属于一种分类方法. 概率p与因变量往 ...

- [机器学习 ]PCA降维--两种实现 : SVD或EVD. 强力总结. 在鸢尾花数据集(iris)实做

PCA降维--两种实现 : SVD或EVD. 强力总结. 在鸢尾花数据集(iris)实做 今天自己实现PCA,从网上看文章的时候,发现有的文章没有搞清楚把SVD(奇异值分解)实现和EVD(特征值分解) ...

- 机器学习——logistic回归,鸢尾花数据集预测,数据可视化

0.鸢尾花数据集 鸢尾花数据集作为入门经典数据集.Iris数据集是常用的分类实验数据集,由Fisher, 1936收集整理.Iris也称鸢尾花卉数据集,是一类多重变量分析的数据集.数据集包含150个数 ...

- ML.NET 示例:多类分类之鸢尾花分类

写在前面 准备近期将微软的machinelearning-samples翻译成中文,水平有限,如有错漏,请大家多多指正. 如果有朋友对此感兴趣,可以加入我:https://github.com/fei ...

- 探索sklearn | 鸢尾花数据集

1 鸢尾花数据集背景 鸢尾花数据集是原则20世纪30年代的经典数据集.它是用统计进行分类的鼻祖. sklearn包不仅囊括很多机器学习的算法,也自带了许多经典的数据集,鸢尾花数据集就是其中之一. 导入 ...

随机推荐

- Logback配置文件这么写,TPS提高10倍

通过阅读本篇文章将了解到 1.日志输出到文件并根据LEVEL级别将日志分类保存到不同文件 2.通过异步输出日志减少磁盘IO提高性能 3.异步输出日志的原理 配置文件logback-spring.xml ...

- 《机器学习技法》---核型SVM

(本文内容和图片来自林轩田老师<机器学习技法>) 1. 核技巧引入 如果要用SVM来做非线性的分类,我们采用的方法是将原来的特征空间映射到另一个更高维的空间,在这个更高维的空间做线性的SV ...

- Yii2 基础模板前后台登录分离

1.用GII 生成一个模块(modules)名字为 admin 2.在./config/web.php 中加入如下配置 'modules' => [ 'admin' => [ 'class ...

- Flutter学习笔记(21)--TextField文本框组件和Card卡片组件

如需转载,请注明出处:Flutter学习笔记(21)--TextField文本框组件和Card卡片组件 今天来学习下TextField文本框组件和Card卡片组件. 只要是应用程序就少不了交互,基本上 ...

- CSS布局:元素垂直居中

CSS布局之元素垂直居中 本文将依次介绍在不同条件下实现垂直居中的多种方法及简单原理 Tip:下文中说的适用场景只是举了几个简单的例子方便读者理解.实际应用场景太复杂,生搬硬套容易出错.最重要的是掌握 ...

- Codeforces 936B

题意略. 思路: 图论里掺杂了一些动态规划. 有几个注意点: 1.dp时状态的设计:因为我们要寻求的是出度为0并且可以从起点走奇数步抵达的点,由于同一个点可以通过多种方式到达. 并且我们在获得奇数步点 ...

- 终于跑通分布式事务框架tcc-transaction的示例项目

1.背景 前段时间在看项目代码的时候,发现有些接口的流程比较长,在各个服务里面都有通过数据库事务保证数据的一致性,但是在上游的controller层并没有对一致性做保证. 网上查了下,还没找到基于Go ...

- mybatis 源码分析(七)KeyGenerator 详解

一.KeyGenerator 概述 在平时开发的时候经常会有这样的需求,插入数据返回主键,或者插入数据之前需要获取主键,这样的需求在 mybatis 中也是支持的,其中主要的逻辑部分就在 KeyGen ...

- filter修改post参数

前景:公司项目web渗透测试中提出管理登录时,传输密码不能为明文,需要加密传输,但是迫于系统架构,后端代码不能修改,只能在filter中解密参数. 1.前端加密处理: <script type= ...

- MySql优化相关概念的理解笔记

MySQL架构 查询执行流程 查询执行的流程是怎样的: 连接1.1客户端发起一条Query请求,监听客户端的‘连接管理模块’接收请求1.2将请求转发到‘连接进/线程模块’1.3调用‘用户模块’来进行授 ...