如何通过 Docker 部署 Logstash 同步 Mysql 数据库数据到 ElasticSearch

在开发过程中,我们经常会遇到对业务数据进行模糊搜索的需求,例如电商网站对于商品的搜索,以及内容网站对于内容的关键字检索等等。对于这些高级的搜索功能,显然数据库的 Like 是不合适的,通常我们采用 ElasticSearch 来完成数据的搜索和分析,有了这个利器,我们可以轻松应对上述场景,实现关键字搜索等功能。

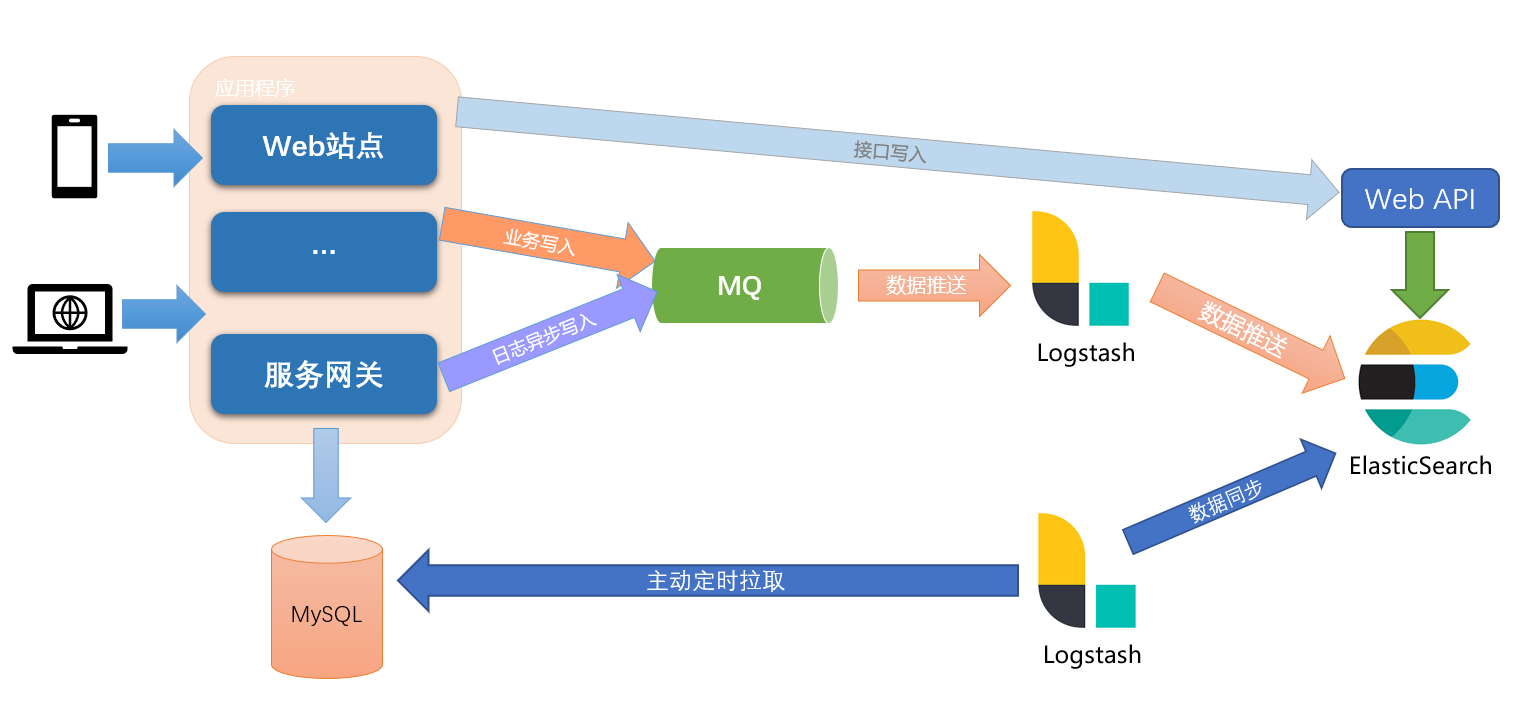

不过,由于增加了 ElasticSearch 作为搜索引擎,随之而来的问题就是,如何将业务中的数据同步到 ElasticSearch 中,主要有两种方式:

- 业务双写(具有侵入性)

- 数据库同步

由于业务双写需要更改业务代码,一般不建议采用此种方式,除非有强一致性要求,或者对业务侵入不敏感的系统可以采取此种方式:

- 强一致性:同步通过HTTP请求写入 ElasticSearch

- 最终一致性:

- 可采取业务写入日志,后端通过日志流数据过滤写入 ElasticSearch(ELK标准模式,推荐)

- 另一种方案就是同步写入 MQ,后端通过消费MQ异步写入 ElasticSearch

本文主要讨论非代码侵入的数据库同步方式,主要采用的是通过 LogStash 定时扫描数据库来增量同步数据的方案。

数据库脚本

数据库表结构中,需要有一个时间类型的字段作为增量更新的标识字段(例如 lastupdatetime),当该条数据更新时,必须同时更新该字段。

CREATE TABLE user (

`id` int(11) NOT NULL,

`name` varchar(50) NOT NULL,

`age` int(11) NOT NULL,

`createtime` datetime(0) NOT NULL,

`lastupdatetime` datetime(0) NOT NULL,

PRIMARY KEY (`id`) USING BTREE

)

INSERT INTO `user` VALUES(1,"jack",18,Now(),Now())

INSERT INTO `user` VALUES(2,"William",18,Now(),Now())

SELECT * from `user`

查询结果:

| id | name | age | createtime | lastupdatetime |

|---|---|---|---|---|

| 1 | jack | 18 | 2019-10-24 10:31:14 | 2019-10-24 10:31:14 |

| 2 | William | 18 | 2019-10-24 10:31:49 | 2019-10-24 10:31:49 |

LogStash 配置信息

logstash docker 安装脚本:

mkdir /opt/logstashsync/

mkdir /opt/logstashsync/pipeline

vi /opt/logstashsync/pipeline/logstash.conf

input {

jdbc {

jdbc_driver_library => "/app/mysql-connector-java-8.0.18.jar"

jdbc_driver_class => "com.mysql.jdbc.Driver"

jdbc_connection_string => "jdbc:mysql://192.168.10.102:3306/synctest"

jdbc_user => "root"

jdbc_password => "123456"

tracking_column => "unix_ts_in_secs"

use_column_value => true

schedule => "*/5 * * * * *"

statement => "SELECT *, UNIX_TIMESTAMP(lastupdatetime) AS unix_ts_in_secs FROM user WHERE (UNIX_TIMESTAMP(lastupdatetime) > :sql_last_value AND lastupdatetime < NOW()) ORDER BY lastupdatetime ASC"

}

}

filter {

mutate {

copy => { "id" => "[@metadata][_id]"}

remove_field => ["id", "@version", "unix_ts_in_secs"]

}

}

output {

elasticsearch {

hosts => "192.168.10.102:9200"

index => "syncuser"

timeout => 300

document_id => "%{[@metadata][_id]}"

}

}

上述配置说明:

- jdbc_driver_library:logstash的镜像中并不包含 jdbc connector,需要在官方网站中下载下来之后,在容器启动时映射到容器中,可点此下载。

- tracking_column:用于跟踪 Logstash从MySQL读取的最后最后一条数据的 lastupdatetime 的值,并默认持久化到磁盘文件 .logstash_jdbc_last_run 中。该值用于在下一次循环同步时,同步的起始值,从而达到增量同步的作用,存储在 .logstash_jdbc_last_run 在 SQL 语句中可以以 :sql_last_value 访问。

- schedule:设置多久循环同步一次,以cron语法指定,我们当前设置的是5秒一次循环。

- statement:执行同步的SQL语句。值得注意的是where条件中为什么要这么写,可以参考 https://www.elastic.co/blog/how-to-keep-elasticsearch-synchronized-with-a-relational-database-using-logstash 文章中给定的解释。

- 重要: 关于上述配置中的 [@metadata][_id],在同步过程中,必须使用数据库数据id作为 ElasticSearch 中的文档 _id,这样当数据库中该条数据有修改时,ElasticSearch 中的文档才会相应的同步修改,否则会以一条新的数据插入 ElasticSearch,导致数据同步错误。

有了上述配置,我们把 Logstath 的 docker 容器跑起来:

docker run -d \

-v /opt/logstashsync/config/logstash.yml:/usr/share/logstash/config/logstash.yml \

-v /opt/logstashsync/pipeline/logstash.conf:/usr/share/logstash/pipeline/logstash.conf \

-v /opt/logstashsync/mysql-connector-java-8.0.18.jar:/app/mysql-connector-java-8.0.18.jar \

--name=logstash \

logstash:6.7.1

注意:上述脚本可以看到,我们将本地 /opt/logstashsync/ 目录下的 mysql-connector-java-8.0.18.jar 映射到了容器的 /app 目录下,对应在上述 logstash.conf 中的配置的 jdbc_driver_library 的值

通过查看 Logstash 容器运行日志,我们可以看到如下日志内容,说明该容易已经按照我们预期的每5s同步一次数据库:

[2019-10-25T06:27:59,056][INFO ][logstash.inputs.jdbc ] (0.039651s) SELECT *, UNIX_TIMESTAMP(lastupdatetime) AS unix_ts_in_secs FROM user WHERE (UNIX_TIMESTAMP(lastupdatetime) > 0 AND lastupdatetime < NOW()) ORDER BY lastupdatetime ASC

[2019-10-25T06:28:05,154][INFO ][logstash.inputs.jdbc ] (0.004232s) SELECT *, UNIX_TIMESTAMP(lastupdatetime) AS unix_ts_in_secs FROM user WHERE (UNIX_TIMESTAMP(lastupdatetime) > 1571913109 AND lastupdatetime < NOW()) ORDER BY lastupdatetime ASC

[2019-10-25T06:28:10,230][INFO ][logstash.inputs.jdbc ] (0.002832s) SELECT *, UNIX_TIMESTAMP(lastupdatetime) AS unix_ts_in_secs FROM user WHERE (UNIX_TIMESTAMP(lastupdatetime) > 1571913109 AND lastupdatetime < NOW()) ORDER BY lastupdatetime ASC

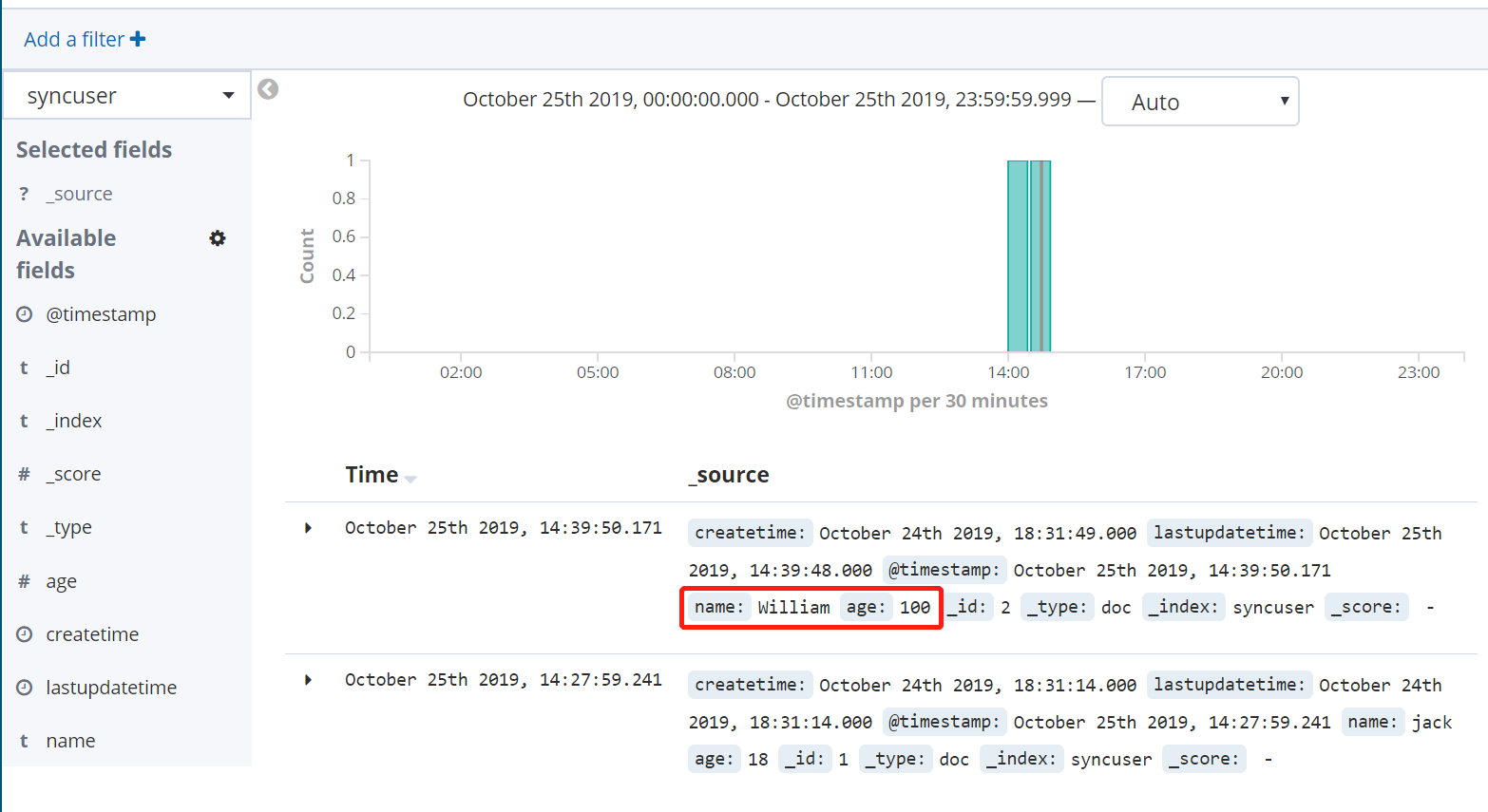

通过Kibana查询同步结果

在 Kibana 中创建 syncuser index,即可以查看到已经同步的数据:

尝试对数据库数据做更新操作,将名为 William 的用户年龄修改为100(记得同时要更新lastupdatetime 字段):

UPDATE `user` SET age=100, lastupdatetime=NOW() WHERE `name`='William';

SELECT * from `user`

再次查看 Kibana 中的数据,可以看到该数据已经成功同步:

结语

根据上述过程,我们完成了简单的单表数据定时同步至 ElasticSearch 过程,但是在实际使用过程中,需要注意以下问题:

- sql语句需要考虑每次同步最大条数。大多数情况下,数据库可能已经存在大量数据,如果不做控制,可能会导致 Logstash 刚启动时一次同步的数据量过大,发生异常,采取的方式可以在 SQL 语句中增加每次获取最大条数限制。

- 增量更新的标识字段,既然是通过>号方式判断,那么如果id是自增主键,也可以采用 int 类型的主键字段,这样可以减少在数据库中创建 lastupdatetime 索引。但如果不是主键,则需要谨慎使用,具体原因请仔细参考上述配置说明中 statement 给出的链接。

- 由于增量同步机制所致,所有数据库中的删除操作应该以软删除的方式进行,即增加 is_delete 字段,否则如果硬删除会导致该条数据状态无法同步至 ElasticSearch,当然在查询 ElasticSearch 时,也应该增加该条件,排除已经删除的数据。

如何通过 Docker 部署 Logstash 同步 Mysql 数据库数据到 ElasticSearch的更多相关文章

- 使用logstash同步mysql数据库信息到ElasticSearch

本文介绍如何使用logstash同步mysql数据库信息到ElasticSearch. 1.准备工作 1.1 安装JDK 网上文章比较多,可以参考:https://www.dalaoyang.cn/a ...

- Logstash同步mysql数据库信息到ES

@font-face{ font-family:"Times New Roman"; } @font-face{ font-family:"宋体"; } @fo ...

- 使用canal增量同步mysql数据库信息到ElasticSearch

本文介绍如何使用canal增量同步mysql数据库信息到ElasticSearch.(注意:是增量!!!) 1.简介 1.1 canal介绍 Canal是一个基于MySQL二进制日志的高性能数据同步系 ...

- 使用go-mysql-elasticsearch同步mysql数据库信息到ElasticSearch

本文介绍如何使用go-mysql-elasticsearch同步mysql数据库信息到ElasticSearch. 1.go-mysql-elasticsearch简介 go-mysql-elasti ...

- 几篇关于MySQL数据同步到Elasticsearch的文章---第四篇:使用go-mysql-elasticsearch同步mysql数据库信息到ElasticSearch

文章转载自: https://www.cnblogs.com/dalaoyang/p/11018541.html 1.go-mysql-elasticsearch简介 go-mysql-elastic ...

- 使用logstash同步MySQL数据到ES

使用logstash同步MySQL数据到ES 版权声明:[分享也是一种提高]个人转载请在正文开头明显位置注明出处,未经作者同意禁止企业/组织转载,禁止私自更改原文,禁止用于商业目的. https:// ...

- centos7配置Logstash同步Mysql数据到Elasticsearch

Logstash 是开源的服务器端数据处理管道,能够同时从多个来源采集数据,转换数据,然后将数据发送到您最喜欢的“存储库”中.个人认为这款插件是比较稳定,容易配置的使用Logstash之前,我们得明确 ...

- Elasticsearch的快速使用——Spring Boot使用Elastcisearch, 并且使用Logstash同步mysql和Elasticsearch的数据

我主要是给出一些方向,很多地方没有详细说明.当时我学习的时候一直不知道怎么着手,花时间找入口点上比较多,你们可以直接顺着方向去找资源学习. 如果不是Spring Boot项目,那么根据Elastics ...

- 在Linux环境下,将Solr部署到tomcat7中,导入Mysql数据库数据, 定时更新索引

什么是solr solr是基于Lucene的全文搜索服务器,对Lucene进行了扩展优化. 准备工作 首先,去下载以下软件包: JDK8:jdk-8u60-linux-x64.tar.gz TOMCA ...

随机推荐

- 松软科技课堂:数据库-主键(PrimaryKey)

主键就是一个表中每个数据行的唯一标识.不会有重复值的列才能当主键.一个表可以没有主键,但是会非常难以处理,因此没有特殊理由表都要设定主键 主键有两种选用策略:业务主键和逻辑主键.业务主键是使用有业务意 ...

- 使用broker进行Datagurd主备切换报ORA-12514异常

在使用Datagurd broker进行Datagurd主备切换时报ORA-12514监听异常, 详细信息如下: DGMGRL> switchover to xiaohe; Performing ...

- 将maven项目到入到idea中

一,前言 在文章将maven项目导入到eclipse中中我将新建的项目到入到了eclipse中了,因为最近也在尝试idea,那么就顺便也到入idea中. maven项目的话,我就使用在文章使用命令行创 ...

- Wordpress对接小程序配置过程

最近发现一个很棒的开源项目-WordPress版微信小程序 https://github.com/iamxjb/winxin-app-watch-life.net,详细看了下介绍非常棒,不仅支持的功 ...

- 自定义构建基于.net core 的基础镜像

先说一个问题 首先记录一个问题,今天在用 Jenkins 构建项目的时候突然出现包源的错误: /usr/share/dotnet/sdk/2.2.104/NuGet.targets(114,5): e ...

- redis分布式锁-WATCH锁(废弃)

使用watch构建锁的代码结构.(最着负载不断增加,系统完成一次加锁操作,重试次数不断加大) pine=conn.pineline while pine.watch if xxx pine.unwat ...

- SpringBoot数据聚合(spring-boot-data-aggregator-starter)

背景 接口开发是后端开发中最常见的场景, 可能是RESTFul接口, 也可能是RPC接口. 接口开发往往是从各处捞出数据, 然后组装成结果, 特别是那些偏业务的接口. 例如, 我现在需要实现一个接口, ...

- .Net Core 商城微服务项目系列(十三):搭建Log4net+ELK+Kafka日志框架

之前是使用NLog直接将日志发送到了ELK,本篇将会使用Docker搭建ELK和kafka,同时替换NLog为Log4net. 一.搭建kafka 1.拉取镜像 //下载zookeeper docke ...

- 使用 BeanDefinition 描述 Spring Bean

什么是BeanDefinition 在Java中,一切皆对象.在JDK中使用java.lang.Class来描述类这个对象. 在Spring中,存在bean这样一个概念,那Spring又是怎么抽象be ...

- Locomotion和Navigation的区别

Locomotion和navigation两者都是移动.漫游的意思.但是locomotion是一个比navigation更大的概念,它指的是所有的第一人称视角的变换(first-person moti ...