RNN总结

RNN既可以表述为循环神 经网络(recurrent neural network),也可以表述为递归神经网络(recursive neural network),前者一般用于处理以时间序列为输入的问题(比如把一个句子看成词组成的序列),每次向循环神经网络输入一个词,知道整个句子输入结束。后者一般用于处理图结构或树结构问题(比如为了处理歧义问题,我们构造语法树为输入,而不是循环输入每一个词)。

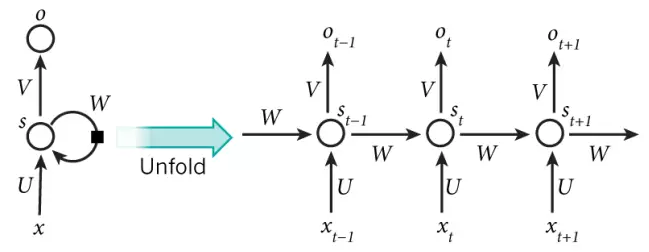

下图是循环神经网络的展开

图1

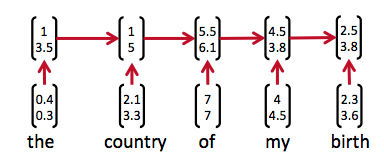

下面是一个句子对上图的应用

图2

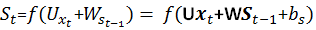

可以这样理解:将所有用到的英文词向量化之后,the表示为(0.4,0.3),对应图1中的x输入,经过神经元计算之后输出为(1,3.5),神经元内部的计算方式为:

函数f通常是诸如tanh或者ReLU的非线性函数,U,x,St-1都为向量且U、V、W都是待训练参数。输出O可以选择softmax函数,其表达式如下

这里的变量i对应图1中的变量t,可见

也就是说循环神经网络所有输出之和为1,输出O的计算公式为

其中V和St都是向量。也就是说神经元先计算隐状态St,然后计算输出Ot

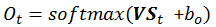

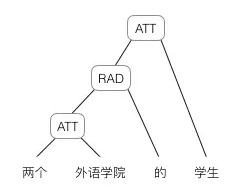

下面以树结构为例来说明递归神经网络的输入与计算

1.将句子分词之后,给每个词一个向量,这里词的向量化可以采用one-hot或者其他一些向量化工具,比如Google的gensim

2.将词按照树形结构输入,以图3为例

图3

2.1 首先计算“两个”和“外语学院”的父节点的向量,计算方法是:假设“两个”的词向量表示为c1,“外语学院”的词向量表示为c2,那么父节点对应的向量P为

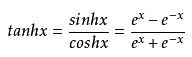

其中W和b是训练好的参数,tanh是双曲正切函数,表达式为

2.2 依次迭代计算各个父节点对应的向量,最终得到根节点对应向量。

因为是以语法树输入的,所以对于歧义问题有较好的处理能力,比如图3中的句子也可以用图4的语法树来表示:

图4

事实上,图3与图4对应的根节点向量完全不同,因为词向量的输入顺序是不一样的。

在得到根节点向量后,我们就可以去完成一些更高级的任务,比如计算语义相似度或者情感分析等。

RNN总结的更多相关文章

- RNN求解过程推导与实现

RNN求解过程推导与实现 RNN LSTM BPTT matlab code opencv code BPTT,Back Propagation Through Time. 首先来看看怎么处理RNN. ...

- 在RNN中使用Dropout

dropout在前向神经网络中效果很好,但是不能直接用于RNN,因为RNN中的循环会放大噪声,扰乱它自己的学习.那么如何让它适用于RNN,就是只将它应用于一些特定的RNN连接上. LSTM的长期记 ...

- RNN 入门学习资料整理

建议按序阅读 1. RNN的一些简单概念介绍 A guide to recurrent neural networks and backpropagation Deep learning:四十九(RN ...

- lecture7-序列模型及递归神经网络RNN

Hinton 第七课 .这里先说下RNN有recurrent neural network 和 recursive neural network两种,是不一样的,前者指的是一种人工神经网络,后者指的是 ...

- RNN 入门教程 Part 4 – 实现 RNN-LSTM 和 GRU 模型

转载 - Recurrent Neural Network Tutorial, Part 4 – Implementing a GRU/LSTM RNN with Python and Theano ...

- RNN 入门教程 Part 3 – 介绍 BPTT 算法和梯度消失问题

转载 - Recurrent Neural Networks Tutorial, Part 3 – Backpropagation Through Time and Vanishing Gradien ...

- RNN 入门教程 Part 2 – 使用 numpy 和 theano 分别实现RNN模型

转载 - Recurrent Neural Networks Tutorial, Part 2 – Implementing a RNN with Python, Numpy and Theano 本 ...

- RNN 入门教程 Part 1 – RNN 简介

转载 - Recurrent Neural Networks Tutorial, Part 1 – Introduction to RNNs Recurrent Neural Networks (RN ...

- CNN & RNN 及一些常识知识(不断扩充中)

参考: http://blog.csdn.net/iamrichardwhite/article/details/51089199 一.神经网络的发展历史 五六十年代,提出感知机 八十年代,提出多层感 ...

- 循环神经网络(RNN, Recurrent Neural Networks)介绍(转载)

循环神经网络(RNN, Recurrent Neural Networks)介绍 这篇文章很多内容是参考:http://www.wildml.com/2015/09/recurrent-neur ...

随机推荐

- PostgreSQL数据库创建只读用户总结

好久没有弄,有点忘了,今天有客户问这个问题,发现几个SQL还解决不了,于是总结一下: --以超级用户登录数据库,创建用户: postgres=# create user test_read_only ...

- Alpha阶段敏捷冲刺---Day4

一.Daily Scrum Meeting照片 二.今天冲刺情况反馈 今天我们上完课后在禹洲楼教室外进行我们的每日立会.开会的内容主要是对昨天遇到的困难做了一些交流,并且定下今天的任务是完成排行榜界面 ...

- linux下如何删除十字符libudev.so病毒文件

服务器不停的向外发包,且CPU持续100%,远程登录后查看发现有一长度为10的随机字符串进程,kill掉,会重新生成另外长度为10的字符串进程.删除文件也会重复生成,非常痛苦.查阅crond相关日志, ...

- Linux下你需要了解的10个网络和监控命令

我下面列出来的10个基础的每个linux用户都应该知道的网络和监控命令.网络和监控命令类似于这些: hostname, ping, ifconfig, iwconfig, netstat, nsloo ...

- liunx服务程序的安装及配置

1.系统运行级别:

- CAN中如何计算波特率并配置波特率

//设置波特率 CAN_InitStructure.CAN_SJW=tsjw; //同步宽度 CAN_InitStructure.CAN_BS1=tbs1; //时间段1 CAN_InitStruct ...

- https://wenku.baidu.com/view/35c88b375acfa1c7aa00ccca.html--swot

https://wenku.baidu.com/view/35c88b375acfa1c7aa00ccca.html

- oracle for in 学习

oracle for in 是对于进行循环的数据处理时比较方便的 因为我们平时的操作经常会碰到进行循环的数据操作 以下为建立的例子 1. begin for item in 2..10 loop d ...

- hibernate 1-1(具体解释)

版权声明:本文为博主原创文章,未经博主同意不得转载. https://blog.csdn.net/qilixiang012/article/details/27870343 域模型 关系数据模型: 依 ...

- mibox open ports

root@dredd:/data/data/berserker.android.apps.sshdroid/home # netstat -lnpActive Internet connections ...