PytorchZerotoAll学习笔记(二)--梯度下降之手动求导

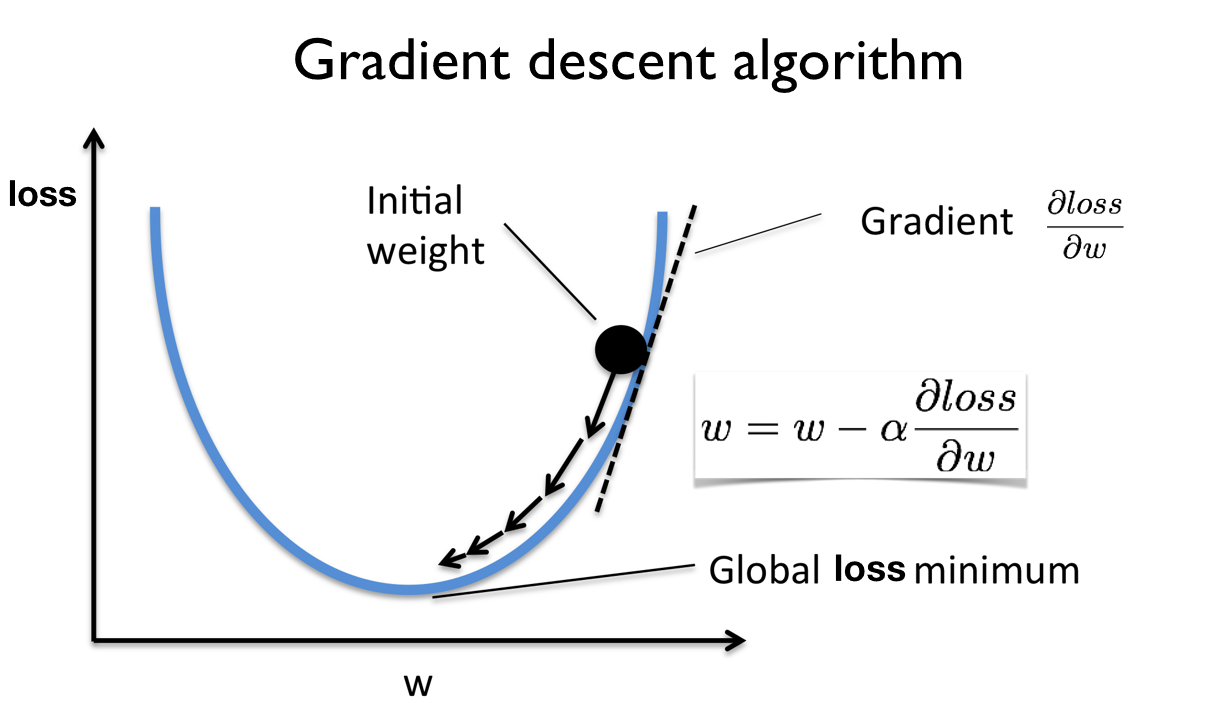

梯度下降算法:

待优化的损失值为 loss,那么我们希望预测的值能够很接近真实的值 y_pred ≈ y_label

我们的样本有n个,那么损失值可以由一下公式计算得出:

要使得loss的值尽可能的小,才会让预测的值接近于标签值:

这里 arg 是(argument的缩写),数学中我们常常会遇到求最大最小值问题,通常会用argmax(F)、argmin(F)来求F函数的极值。

上述公式中的argmin就是去求我们的loss的最小值的w的参数的。

那么问题来了,argmin使用什么方式来去优化我们的F函数呢?

梯度下降优化算法:(梯度下降顾名思义就是根据梯度来优化我们的loss使其减小的)

这里涉及到基本的微分思想(求偏导数)

Y = W × X

dY/dX的值等于W, dY/dW的值为X

step1 : 求出loss的梯度值

step2: 更新W的值(迭代使得loss最小)

我们来看一下python的代码(手动求导):

x_data = [1.0, 2.0, 3.0]

y_data = [2.0, 4.0, 6.0] w = 1.0 # a random guess: random value # our model forward pass def forward(x):

return x * w # Loss function

def loss(x, y):

y_pred = forward(x)

return (y_pred - y) * (y_pred - y) # compute gradient (计算梯度的值)

def gradient(x, y): # d_loss/d_w

return 2 * x * (x * w - y) # Before training

print("predict (before training)", 4, forward(4)) # Training loop

for epoch in range(10):

for x_val, y_val in zip(x_data, y_data):

#计算梯度

grad = gradient(x_val, y_val)

# 更新W的值,0.01是学习率,换个意思就是w每次更新的步长是多少

w = w - 0.01 * grad

print("\tgrad: ", x_val, y_val, round(grad, 2))

l = loss(x_val, y_val) print("progress:", epoch, "w=", round(w, 2), "loss=", round(l, 2)) # After training

print("predict (after training)", "4 hours", forward(4))

#控制台输出的结果

predict (before training) 4 4.0

grad: 1.0 2.0 -2.0

grad: 2.0 4.0 -7.84

grad: 3.0 6.0 -16.23

progress: 0 w= 1.26 loss= 4.92

grad: 1.0 2.0 -1.48

grad: 2.0 4.0 -5.8

grad: 3.0 6.0 -12.0

progress: 1 w= 1.45 loss= 2.69

grad: 1.0 2.0 -1.09

grad: 2.0 4.0 -4.29

grad: 3.0 6.0 -8.87

progress: 2 w= 1.6 loss= 1.47

grad: 1.0 2.0 -0.81

grad: 2.0 4.0 -3.17

grad: 3.0 6.0 -6.56

progress: 3 w= 1.7 loss= 0.8

grad: 1.0 2.0 -0.6

grad: 2.0 4.0 -2.34

grad: 3.0 6.0 -4.85

progress: 4 w= 1.78 loss= 0.44

grad: 1.0 2.0 -0.44

grad: 2.0 4.0 -1.73

grad: 3.0 6.0 -3.58

progress: 5 w= 1.84 loss= 0.24

grad: 1.0 2.0 -0.33

grad: 2.0 4.0 -1.28

grad: 3.0 6.0 -2.65

progress: 6 w= 1.88 loss= 0.13

grad: 1.0 2.0 -0.24

grad: 2.0 4.0 -0.95

grad: 3.0 6.0 -1.96

progress: 7 w= 1.91 loss= 0.07

grad: 1.0 2.0 -0.18

grad: 2.0 4.0 -0.7

grad: 3.0 6.0 -1.45

progress: 8 w= 1.93 loss= 0.04

grad: 1.0 2.0 -0.13

grad: 2.0 4.0 -0.52

grad: 3.0 6.0 -1.07

progress: 9 w= 1.95 loss= 0.02

predict (after training) 4 hours 7.804863933862125

PytorchZerotoAll学习笔记(二)--梯度下降之手动求导的更多相关文章

- JDBC学习笔记二

JDBC学习笔记二 4.execute()方法执行SQL语句 execute几乎可以执行任何SQL语句,当execute执行过SQL语句之后会返回一个布尔类型的值,代表是否返回了ResultSet对象 ...

- WPF的Binding学习笔记(二)

原文: http://www.cnblogs.com/pasoraku/archive/2012/10/25/2738428.htmlWPF的Binding学习笔记(二) 上次学了点点Binding的 ...

- AJax 学习笔记二(onreadystatechange的作用)

AJax 学习笔记二(onreadystatechange的作用) 当发送一个请求后,客户端无法确定什么时候会完成这个请求,所以需要用事件机制来捕获请求的状态XMLHttpRequest对象提供了on ...

- [Firefly引擎][学习笔记二][已完结]卡牌游戏开发模型的设计

源地址:http://bbs.9miao.com/thread-44603-1-1.html 在此补充一下Socket的验证机制:socket登陆验证.会采用session会话超时的机制做心跳接口验证 ...

- JMX学习笔记(二)-Notification

Notification通知,也可理解为消息,有通知,必然有发送通知的广播,JMX这里采用了一种订阅的方式,类似于观察者模式,注册一个观察者到广播里,当有通知时,广播通过调用观察者,逐一通知. 这里写 ...

- java之jvm学习笔记二(类装载器的体系结构)

java的class只在需要的时候才内转载入内存,并由java虚拟机的执行引擎来执行,而执行引擎从总的来说主要的执行方式分为四种, 第一种,一次性解释代码,也就是当字节码转载到内存后,每次需要都会重新 ...

- Java IO学习笔记二

Java IO学习笔记二 流的概念 在程序中所有的数据都是以流的方式进行传输或保存的,程序需要数据的时候要使用输入流读取数据,而当程序需要将一些数据保存起来的时候,就要使用输出流完成. 程序中的输入输 ...

- 《SQL必知必会》学习笔记二)

<SQL必知必会>学习笔记(二) 咱们接着上一篇的内容继续.这一篇主要回顾子查询,联合查询,复制表这三类内容. 上一部分基本上都是简单的Select查询,即从单个数据库表中检索数据的单条语 ...

- NumPy学习笔记 二

NumPy学习笔记 二 <NumPy学习笔记>系列将记录学习NumPy过程中的动手笔记,前期的参考书是<Python数据分析基础教程 NumPy学习指南>第二版.<数学分 ...

随机推荐

- .net core 实践笔记(二)--EF连接Azure Sql

** 温馨提示:如需转载本文,请注明内容出处.** 本文链接:https://www.cnblogs.com/grom/p/9902098.html 笔者使用了常见的三层架构,Api展示层注入了Swa ...

- makefile中的一些参数说明

#obj = main.o sub.o add.o div.o mul.osrc = $(wildcard *.c) #搜索.c文件 可以加路径 obj = $(patsubst %.c, %.o, ...

- 物联网通信 - RESTDemo示例程序(C#版本)

技术:wcf+http post+json(.net4.0 + jdk1.8) 运行环境:vs2010+java 概述Server开放RESTful API接口,供应用程序/移动App/嵌入式qt通过 ...

- 实验吧 Fair Play

知识点:playfair密码以前没见过 Playfair密码(英文:Playfair cipher 或 Playfair square)是一种使用一个关键词方格来加密字符对的加密法,1854年由查尔斯 ...

- 分别给Python类和实例增加属性和方法

#定义一个类Student class Student(object): pass #给类增加一个属性name Student.name = 'xm' print Student.name # xm ...

- 学习Emmet

学习Emmet 在进行Web开发时,就免不了需要编写html文件,如何快速(偷懒^-^)的进行编写html,是个大问题,上网找了一下,发现了一个好东西 ,视频教程可以看下小马技术Emmet爆速开发, ...

- ubuntu下pycharm快捷方式创建

终端输入:sudo gedit /usr/share/applications/Pycharm.desktop 粘贴模板: [Desktop Entry] Type=Application Name= ...

- 20155216 2016-2017-2 《Java程序设计》第九周学习总结

20155216 2016-2017-2 <Java程序设计>第九周学习总结 教材学习内容总结 JDBC架构 JDBC API的使用 JDBC连接数据库 1.导入JDBC包: 添加impo ...

- 第六周课上测试-3-ch02补充作业

实验要求: 编写一个程序 "week0603学号.c",运行下面代码: short int v = -学号后四位 unsigned short uv = (unsigned sho ...

- Error running 'Tomcat 7': Unable to open debugger port (127.0.0.1:9342)

这个只需要把java虚拟机进程结束掉就行了