Pytorch循环神经网络LSTM时间序列预测风速

#时间序列预测分析就是利用过去一段时间内某事件时间的特征来预测未来一段时间内该事件的特征。这是一类相对比较复杂的预测建模问题,和回归分析模型的预测不同,时间序列模型是依赖于事件发生的先后顺序的,同样大小的值改变顺序后输入模型产生的结果是不同的。

#时间序列模型最常用最强大的的工具就是递归神经网络(recurrent neural network, RNN)。相比与普通神经网络的各计算结果之间相互独立的特点,RNN的每一次隐含层的计算结果都与当前输入以及上一次的隐含层结果相关。通过这种方法,RNN的计算结果便具备了记忆之前几次结果的特点。

#LSTM(Long Short-Term Memory)模型是一种RNN的变型,可以处理rnn模型的局限性

#这里实现pytorch的LSTM来预测未来的风速的模型

#导包(都用得到)

import torch

from torch.autograd import Variable

import torch.nn as nn

import pandas as pd

from pandas import DataFrame

import matplotlib.pyplot as plt

import numpy as np

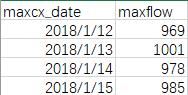

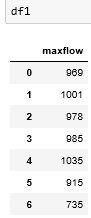

#原始数据

#时间序列问题,时间的那一列是不代入训练或者测试的,所以时间列可以删除。是用前几行的预测下一行的。通俗点[1,2,3,4,5,6,7],可以通过1,2,3预测出4,。然后2,3,4预测出5.训练的时候跟时间列没关系

df1 = pd.read_excel(r'D:\Personal\Desktop\cs3h.xlsx')

df1

#一、数据准备

datas = df1.values

#归一化处理,这一步必不可少,不然后面训练数据误差会很大,模型没法用

max_value = np.max(datas)

min_value = np.min(datas)

scalar = max_value - min_value

datas = list(map(lambda x: x / scalar, datas))

#数据集和目标值赋值,dataset为数据,look_back为以几行数据为特征维度数量

def creat_dataset(dataset,look_back):

data_x = []

data_y = []

for i in range(len(dataset)-look_back):

data_x.append(dataset[i:i+look_back])

data_y.append(dataset[i+look_back])

return np.asarray(data_x), np.asarray(data_y) #转为ndarray数据

#以2为特征维度,得到数据集

dataX, dataY = creat_dataset(datas,2)

train_size = int(len(dataX)*0.7)

x_train = dataX[:train_size] #训练数据

y_train = dataY[:train_size] #训练数据目标值

x_train = x_train.reshape(-1, 1, 2) #将训练数据调整成pytorch中lstm算法的输入维度

y_train = y_train.reshape(-1, 1, 1) #将目标值调整成pytorch中lstm算法的输出维度

#将ndarray数据转换为张量,因为pytorch用的数据类型是张量

x_train = torch.from_numpy(x_train)

y_train = torch.from_numpy(y_train)

二、创建LSTM模型

class RNN(nn.Module):

def __init__(self):

super(RNN,self).__init__() #面向对象中的继承

self.lstm = nn.LSTM(2,6,2) #输入数据2个特征维度,6个隐藏层维度,2个LSTM串联,第二个LSTM接收第一个的计算结果

self.out = nn.Linear(6,1) #线性拟合,接收数据的维度为6,输出数据的维度为1

def forward(self,x):

x1,_ = self.lstm(x)

a,b,c = x1.shape

out = self.out(x1.view(-1,c)) #因为线性层输入的是个二维数据,所以此处应该将lstm输出的三维数据x1调整成二维数据,最后的特征维度不能变

out1 = out.view(a,b,-1) #因为是循环神经网络,最后的时候要把二维的out调整成三维数据,下一次循环使用

return out1

rnn = RNN()

#参数寻优,计算损失函数

optimizer = torch.optim.Adam(rnn.parameters(),lr = 0.02)

loss_func = nn.MSELoss()

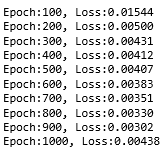

#三、训练模型

for i in range(1000):

var_x = Variable(x_train).type(torch.FloatTensor)

var_y = Variable(y_train).type(torch.FloatTensor)

out = rnn(var_x)

loss = loss_func(out,var_y)

optimizer.zero_grad()

loss.backward()

optimizer.step()

if (i+1)%100==0:

print('Epoch:{}, Loss:{:.5f}'.format(i+1, loss.item()))

#损失值

#四、模型测试

#准备测试数据

dataX1 = dataX.reshape(-1,1,2)

dataX2 = torch.from_numpy(dataX1)

var_dataX = Variable(dataX2).type(torch.FloatTensor)

pred = rnn(var_dataX)

pred_test = pred.view(-1).data.numpy() #转换成一维的ndarray数据,这是预测值

dataY为真实值

#五、画图检验

plt.plot(pred.view(-1).data.numpy(), 'r', label='prediction')

plt.plot(dataY, 'b', label='real')

plt.legend(loc='best')

百分之七十是训练数据的目标值和真实目标值,剩下的为预测的目标值和真实目标值之间关系

Pytorch循环神经网络LSTM时间序列预测风速的更多相关文章

- 循环神经网络LSTM RNN回归:sin曲线预测

摘要:本篇文章将分享循环神经网络LSTM RNN如何实现回归预测. 本文分享自华为云社区<[Python人工智能] 十四.循环神经网络LSTM RNN回归案例之sin曲线预测 丨[百变AI秀]& ...

- 十 | 门控循环神经网络LSTM与GRU(附python演练)

欢迎大家关注我们的网站和系列教程:http://panchuang.net/ ,学习更多的机器学习.深度学习的知识! 目录: 门控循环神经网络简介 长短期记忆网络(LSTM) 门控制循环单元(GRU) ...

- Kesci: Keras 实现 LSTM——时间序列预测

博主之前参与的一个科研项目是用 LSTM 结合 Attention 机制依据作物生长期内气象环境因素预测作物产量.本篇博客将介绍如何用 keras 深度学习的框架搭建 LSTM 模型对时间序列做预测. ...

- (数据科学学习手札40)tensorflow实现LSTM时间序列预测

一.简介 上一篇中我们较为详细地铺垫了关于RNN及其变种LSTM的一些基本知识,也提到了LSTM在时间序列预测上优越的性能,本篇就将对如何利用tensorflow,在实际时间序列预测任务中搭建模型来完 ...

- 循环神经网络-LSTM

LSTM(Long Short-Term Memory)是长短期记忆网络,是一种时间递归神经网络,适合于处理和预测时间序列中间隔和延迟相对较长的重要事件. LSTM能够很大程度上缓解长期依赖的问题. ...

- LSTM时间序列预测及网络层搭建

一.LSTM预测未来一年某航空公司的客运流量 给你一个数据集,只有一列数据,这是一个关于时间序列的数据,从这个时间序列中预测未来一年某航空公司的客运流量.数据形式: 二.实战 1)数据下载 你可以go ...

- 循环神经网络-LSTM进阶

基础的LSTM模型,单隐层,隐层单神经元,而实际中一般需要更为复杂的网络结构, 下面借用手写数字的经典案例构造比较复杂的LSTM模型,并用代码实现. 单隐层,隐层多神经元 # -*- coding:u ...

- 深度学习 循环神经网络 LSTM 示例

最近在网上找到了一个使用LSTM 网络解决 世界银行中各国 GDP预测的一个问题,感觉比较实用,毕竟这是找到的唯一一个可以正确运行的程序. #encoding:UTF-8 import pandas ...

- keras-anomaly-detection 代码分析——本质上就是SAE、LSTM时间序列预测

keras-anomaly-detection Anomaly detection implemented in Keras The source codes of the recurrent, co ...

随机推荐

- MySQL 数据库中删除重复数据的方法

演示数据,仅供参考 查询表结构: mysql> desc test; +-------+------------------+------+-----+---------+----------- ...

- 一个简单的 WPF 程序,用于显示实时时间

直接贴代码了: TimeShowerWindow.xaml <Window x:Class="HelloWorld.TimeShowerWindow" xmlns=" ...

- Prometheus K8S中部署Alertmanager

Prometheus K8S中部署Alertmanager 设置告警和通知的主要步骤如下:一.部署Alertmanager二.配置Prometheus与Alertmanager通信三.配置告警 1. ...

- 【转载】什么是NVMe?

什么是NVMe? [转载]什么是NVMe:http://storage.it168.com/a2018/0921/5045/000005045252.shtml NVMe是Non-Volatile M ...

- 动态ALV表实例-移动类型汇总

TABLES:MSEG,MAKT. "定义结构 TYPES:BEGIN OF TY_DATA, MJAHR LIKE MSEG-MJAHR, "物料凭证的年份 MBLNR LIKE ...

- Delphi - 操作Excel数据公式的实现

procedure TF_SMP_FT_NEW.RzBitBtn_StartToChangeClick(Sender: TObject); var i, j, ni, nj, iRows, iCol, ...

- EntityUtils.toString(entity)处理字符集问题解决

爬取51Job和猎聘网的信息,想处理字符集问题(51job为gbk,猎聘为utf-8), 找到两个网站字符集信息都在同一标签下 就想先把网页保存成String,解析一遍获取字符集,然后将网页转换成对应 ...

- CTF必备技能丨Linux Pwn入门教程——环境配置

说在前面 这是一套Linux Pwn入门教程系列,作者依据Atum师傅在i春秋上的Pwn入门课程中的技术分类,并结合近几年赛事中出现的一些题目和文章整理出一份相对完整的Linux Pwn教程. 问:为 ...

- android studio学习----gradle多渠道打包

由于国内Android市场众多渠道,为了统计每个渠道的下载及其它数据统计,就需要我们针对每个渠道单独打包,如果让你打几十个市场的包岂不烦死了,不过有了Gradle,这再也不是事了. 友盟多渠道打包 废 ...

- Linux 和 Windows多线程函数对应表

Linux Pthread API Windows SDK 库对应 API 创建 pthread_create CreateThread 退出 pthread_exit ThreadExit 等待 p ...