Coursera台大机器学习技法课程笔记07-Blending and Bagging

这一节讲如何将得到的feature或hypothesis组合起来用于预测。

1. 林老师给出了几种方法

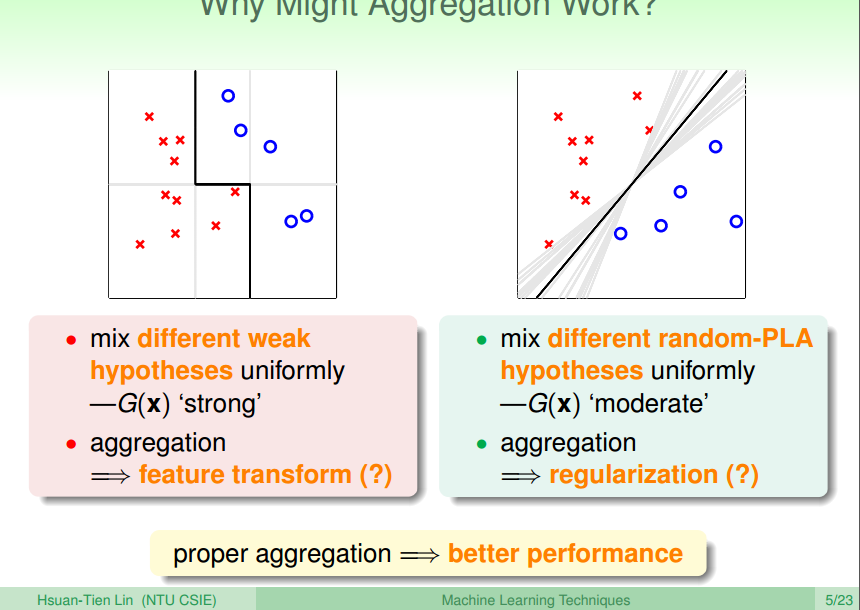

在选择g时,需要选择一个很强的g来确保Eval最小,但如果每个g都很弱该怎么办呢

这个时候可以选择Aggregation的方式将这些若g组合起来,组合起来的G,既能feature transform又能regularization这一对矛盾的性质。

2.接着讲了用uniform blending的方式来classification或regression,并推导了使用uniform blending的好处:Eout更小

接着解释了上述不等式的物理意义:一个算法的期望表现,等于consensus的表现加上consensus期望的偏差,通过uniform blending来消除variance。

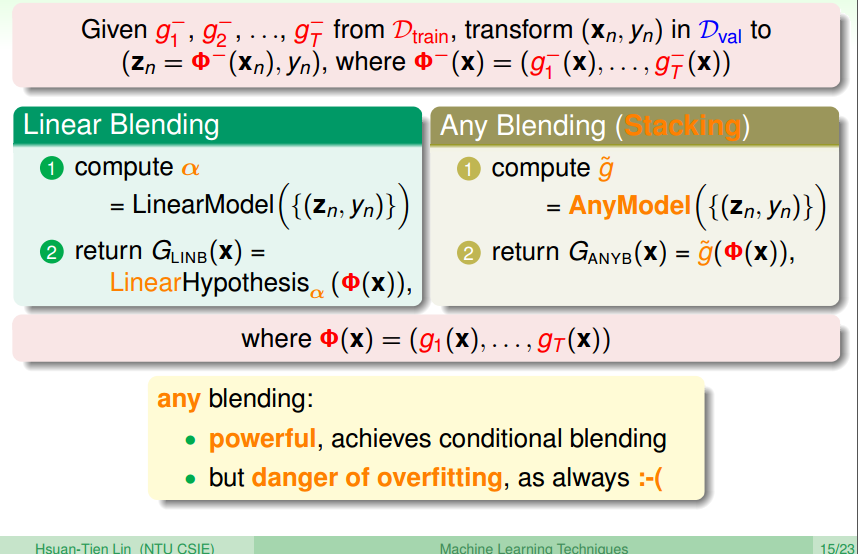

3.接下来讲的是linear blending.

采用这种方式的一个问题是overfitting。对此,林老师的建议是,选择的时候,blending要在validation上做。

下面仍然是介绍如何避免overfitting,可以用非线性model,但没听懂,泪。。。。

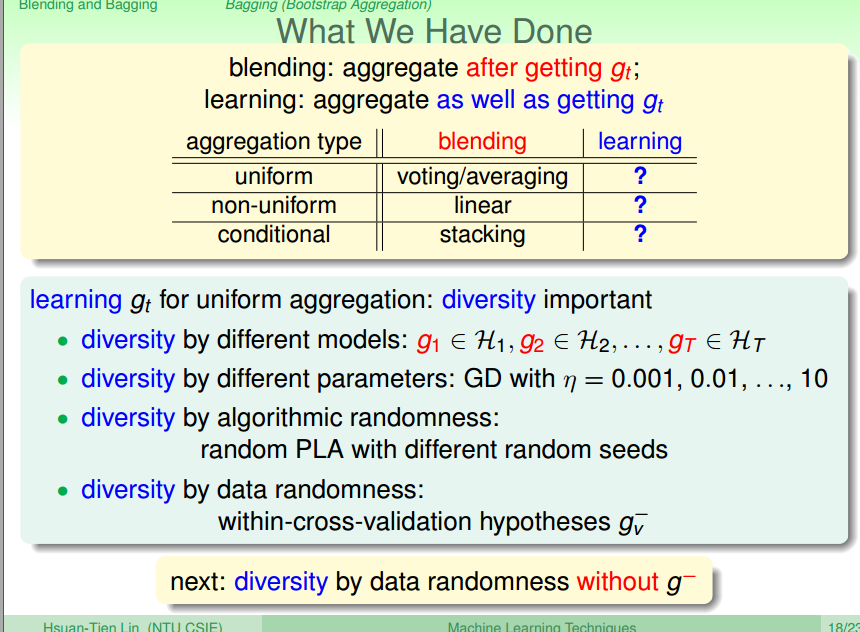

4.接下来讲的是如何得到不同的g。

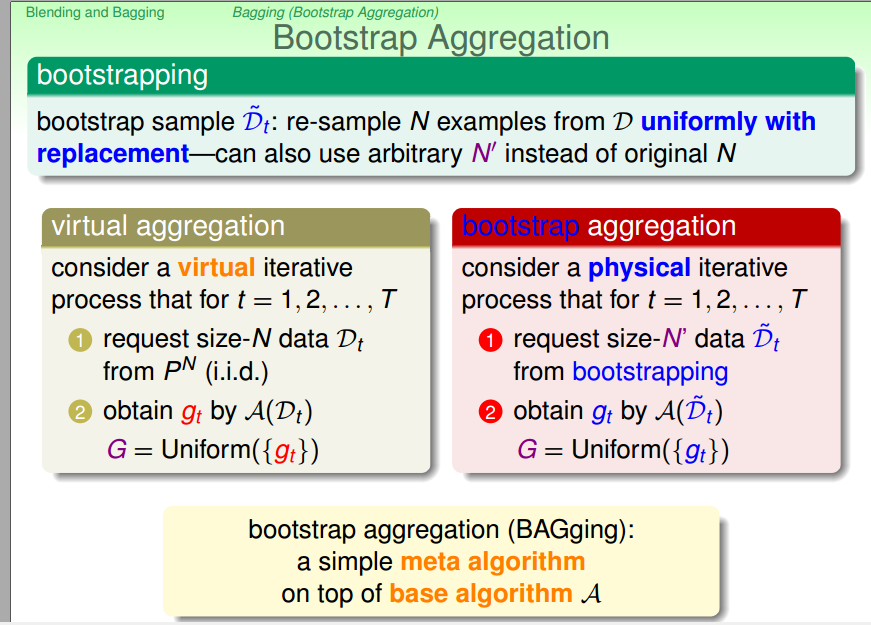

接下来介绍了一种方法bootstrapping:为了得到不同的g,对数据资料进行放回抽取,对每小份资料进行学习得到g

这位博主也总结了下,可参考:http://blog.csdn.net/lg1259156776/article/details/46821389

Coursera台大机器学习技法课程笔记07-Blending and Bagging的更多相关文章

- Coursera台大机器学习技法课程笔记01-linear hard SVM

极其淡腾的一学期终于过去了,暑假打算学下台大的这门机器学习技法. 第一课是对SVM的介绍,虽然之前也学过,但听了一次感觉还是很有收获的.这位博主总结了个大概,具体细节还是 要听课:http://www ...

- Coursera台大机器学习技法课程笔记14-Radial Basis Function Network

将Radial Basis Function与Network相结合.实际上衡量两个点的相似性:距离越近,值越大. 将神经元换为与距离有关的函数,就是RBF Network: 可以用kernel和RBF ...

- Coursera台大机器学习技法课程笔记03-Kernel Support Vector Machine

这一节讲的是核化的SVM,Andrew Ng的那篇讲义也讲过,讲的也不错. 首先讲的是kernel trick,为了简化将低维特征映射高维特征后的计算,使用了核技巧.讲义中还讲了核函数的判定,即什么样 ...

- Coursera台大机器学习技法课程笔记11-Gradient Boosted Decision Tree

将Adaboost和decision tree相结合,需要注意的地主是,训练时adaboost需要改变资料的权重,如何将有权重的资 料和decision tree相结合呢?方法很类似于前面讲过的bag ...

- Coursera台大机器学习技法课程笔记10-Random forest

随机森林就是要将这我们之前学的两个算法进行结合:bagging能减少variance(通过g们投票),而decision tree的variance很大,资料不同,生成的树也不同. 为了得到不同的g, ...

- Coursera台大机器学习技法课程笔记08-Adaptive Boosting

将分类器组合的过程中,将重点逐渐聚焦于那些被错分的样本点,这种做法背后的数学原因,就是这讲的内容. 在用bootstraping生成g的过程中,由于抽样对不同的g就生成了不同的u,接下来就是不断的调整 ...

- Coursera台大机器学习技法课程笔记04-Soft-Margin Support Vector Machine

之前的SVM非常的hard,要求每个点都要被正确的划分,这就有可能overfit,为此引入了Soft SVM,即允许存在被错分的点,将犯的错放在目 标函数中进行优化,非常类似于正则化. 将Soft S ...

- Coursera台大机器学习技法课程笔记02-Dual Support Vector Machine

这节课讲的是SVM的对偶问题,比较精彩的部分:为何要使用拉格朗日乘子以及如何进行对偶变换. 参考:http://www.cnblogs.com/bourneli/p/4199990.html http ...

- Coursera台大机器学习技法课程笔记05-Kernel Logistic Regression

这一节主要讲的是如何将Kernel trick 用到 logistic regression上. 从另一个角度来看soft-margin SVM,将其与 logistic regression进行对比 ...

随机推荐

- Solr7.1---Getting Start

目前最新版的Solr是7.1.0 有个我还不清楚的地方是,为何5.5.X或者6.6.X版本还在更新,给我的感觉好像每一个大版本都有自己的维护团队.不管了. 首先-系统要求 JDK1.8+ 解压Solr ...

- 获取Methods成员方法类

位于java.lang.reflect.Method包中 getModifiers() 成员方法的修饰符 getName() 成员方法的名字 getReturnType() 成员方法的声明类型 get ...

- 即将上线的Kafka 集群(用CM部署的)无法使用“--bootstrap-server”进行消费,怎么破?

即将上线的Kafka 集群(用CM部署的)无法使用“--bootstrap-server”进行消费,怎么破? 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.报错:org.a ...

- 源码分析之CountDownLatch

https://www.cnblogs.com/leesf456/p/5406191.html

- POJ - 1836 Alignment (动态规划)

https://vjudge.net/problem/POJ-1836 题意 求最少删除的数,使序列中任意一个位置的数的某一边都是递减的. 分析 任意一个位置的数的某一边都是递减的,就是说对于数h[i ...

- Java图片比对

在自动化测试中,除了普通的值验证,经常还有一些图片验证,比如图片的匹配率,输出图片的差异图片等.本文主要用到了BufferedImage类来操作图片比对和输出差异图片,大体的思路如下: 1. 通过Im ...

- 打包pyinstaller

安装:pip3 install pyinstaller 了解几个常用命令 参数 用处 -F 将程序打包成一个文件 -w 去除黑框 -i 添加程序图标 我们将需要打包的test.py文件放到桌面上,之后 ...

- text-decoration和text-indent和text-shadow

text-decoration 属性规定添加到文本的修饰,规定划线的位置. <html> <head> <style type="text/css"& ...

- [C++]指针和指向数组的指针[一维数组与指针]

1.一维数组与指针 形如:int型 数组 a[10] 1)&a[0] 地址常量;地址类型:int *型 ; 存储数组a的首地址 ...

- uboot 如何向内核传递参数

a.uboot 向内核传递的参数有两种类型 1.一个是bootargs 2.一个是环境参数, 而环境参数的设置靠的是 Y:\junda\JdLinuxApp\A1801_uboot\source\u- ...