【Dual Support Vector Machine】林轩田机器学习技法

这节课内容介绍了SVM的核心。

首先,既然SVM都可以转化为二次规划问题了,为啥还有有Dual啥的呢?原因如下:

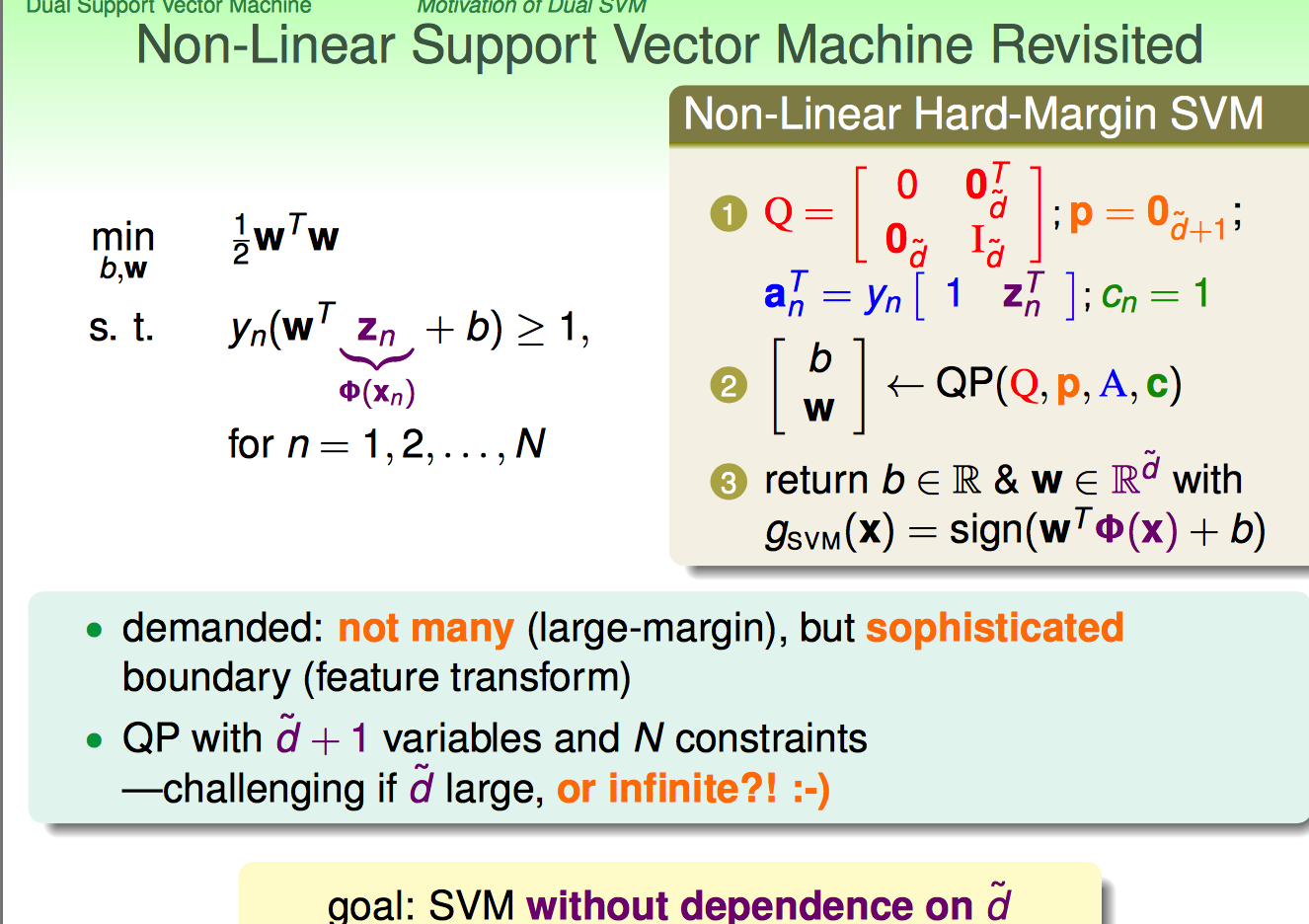

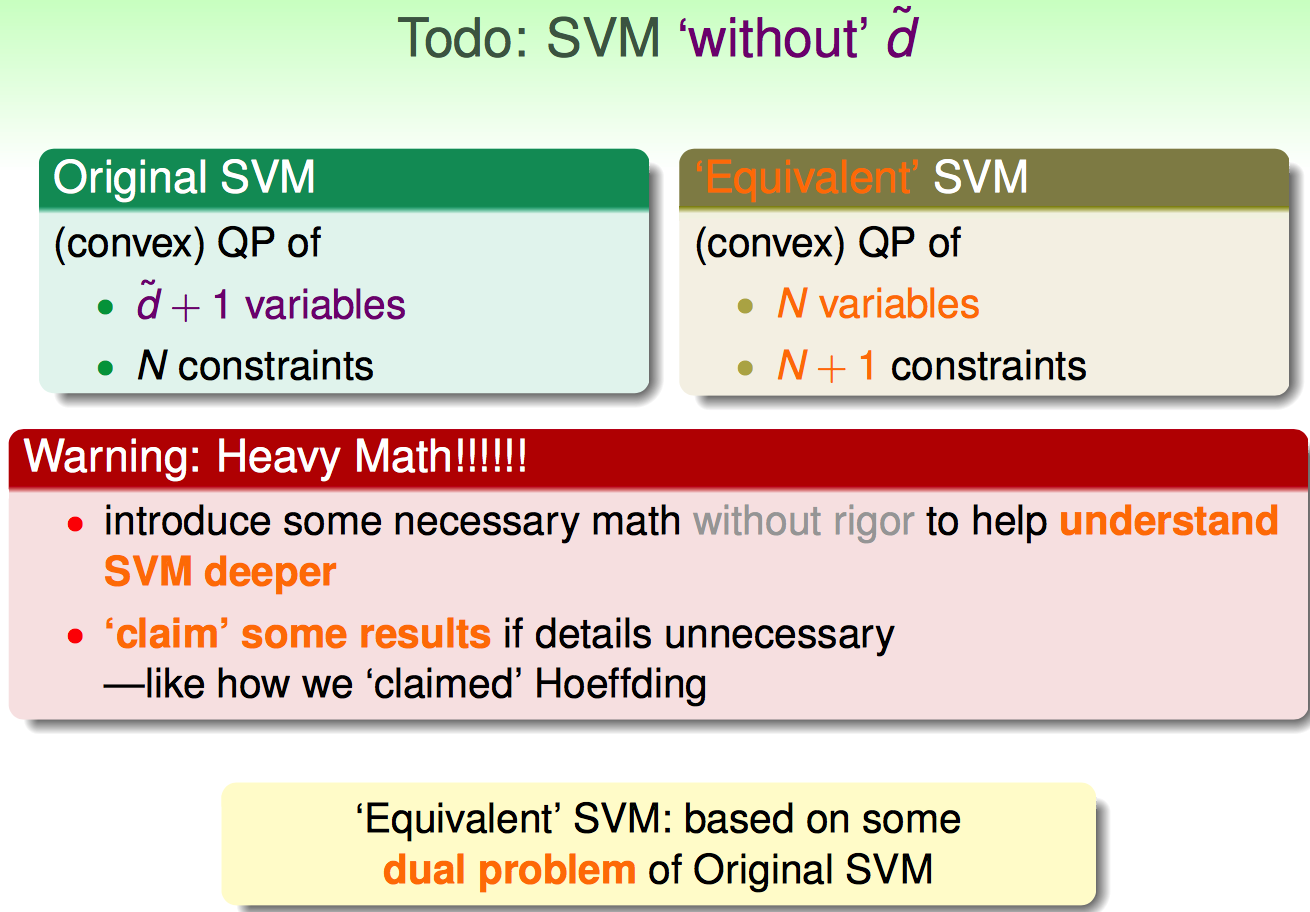

如果x进行non-linear transform后,二次规划算法需要面对的是d`+1维度的N个变量,以及N个约束

如果d`的维度超大,那么二次规划解起来的代价就太大了。因此,SVM的精髓就在于做了如下的问题转化:

不需要问太深奥的数学,知道为啥要dual的motivation就可以了。

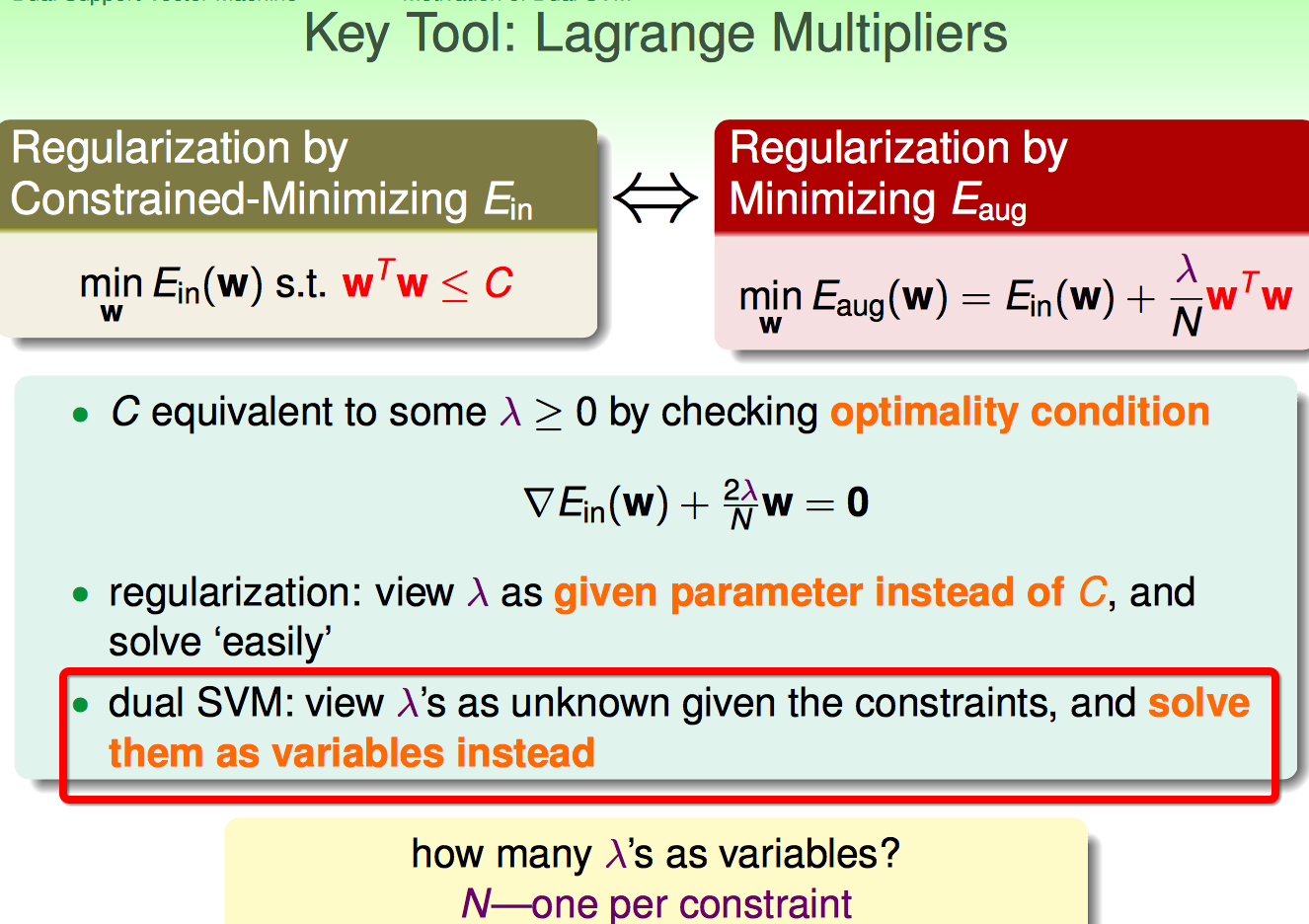

这里再次搬出前人的智慧:Lagrange Multipliers

但是这里跟ridge regression不太一样:一个约束条件配一个拉格朗日乘子;每个乘子是未知的,需要求解的变量。

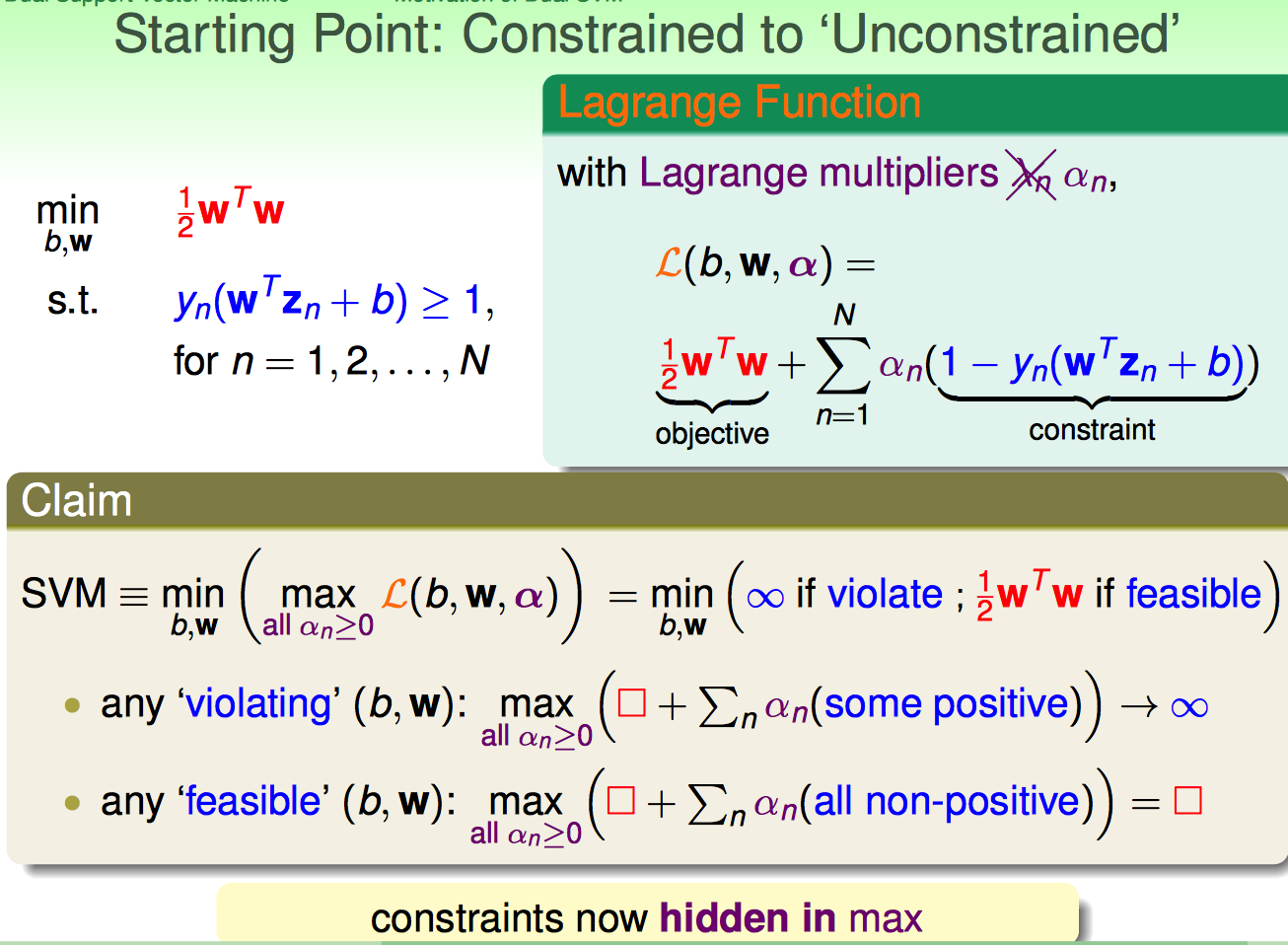

如上图,首先把原问题的N个不等式约束条件,通过拉格朗日乘子给弄到等式中。

问题困惑:原来的目标函数是min (b,W) 0.5W'W,而且还是min;为啥用Lagrange Fucntion转换后,还搞出来一个max呢?背后的原因是啥呢?

我的理解:这里max的目的是把违背约束条件的(b,W)的值无限放大

(1)违背约束条件:alpha后面的值是正数,那么max必然是alpha取无限大的情况;这样经过外层的min操作,必然过滤掉了

(2)符合约束条件:alpha后面的值是非正,那么max必然是alpha取零的情况;这样min里面剩下的项就是原目标函数了;

综合(1)(2)来看,拉格朗日乘子起到这样的作用:

a. 把不等式约束给弄到等式中

b. 把违背约束的项目给弄到无限大

c. 如果符合约束条件,等式中的拉格朗日项目就没有了;这样剩下的自然就是原来需要min的目标函数

综合b,c来看,拉格朗日乘子用一种特殊的方式把违背约束条件的(b,W)给排除了,把符合约束条件的(b,W)给留在了候选集合中。

这样转换后的问题就跟原问题等价了;约束条件藏在了max里面。

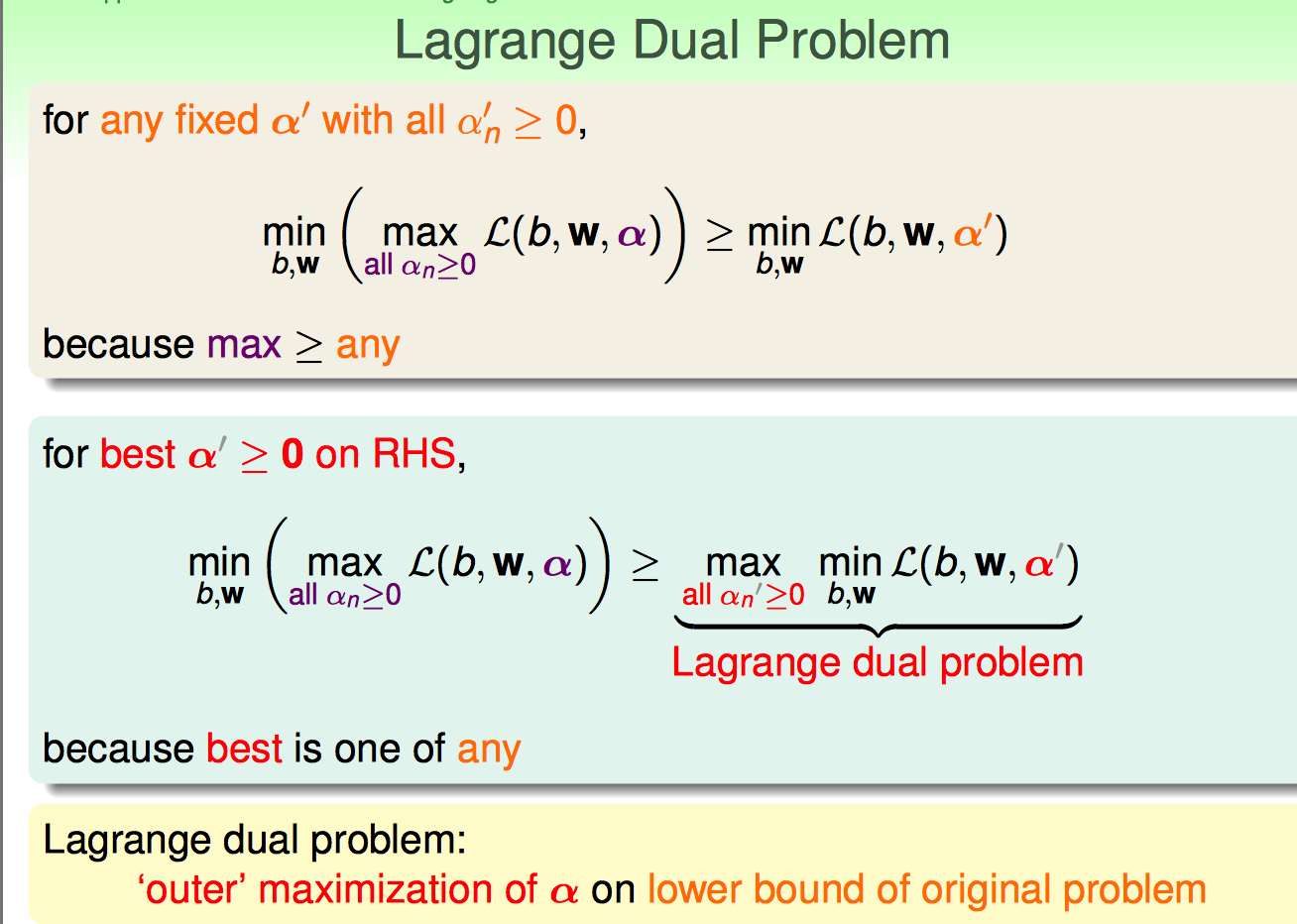

接下需要进一步转化:

交换min和max的顺序:

(1)原来的max里面(b,W)是受到约束条件限制的

(2)交换min和max后,(b,W)可以不受到约束条件限制

转换后的问题,叫Lagrange dual problem。

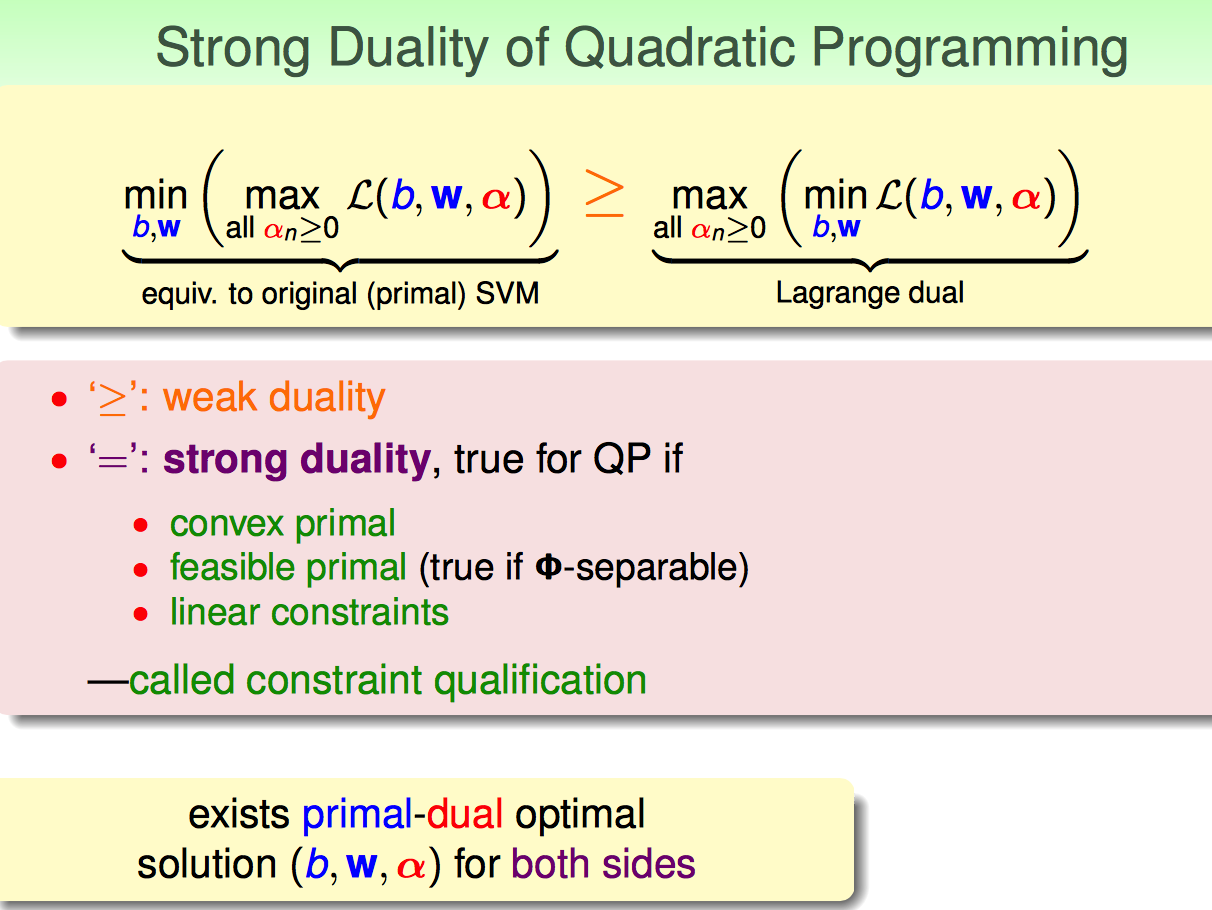

光大于等于还不行,最好能等于:

要想是强对偶问题,QP需要满足:

(1)原问题是convex的

(2)原问题是feasible的(即线性可分)

(3)约束条件是线性的

于是,就可以放心大胆地取等号了。

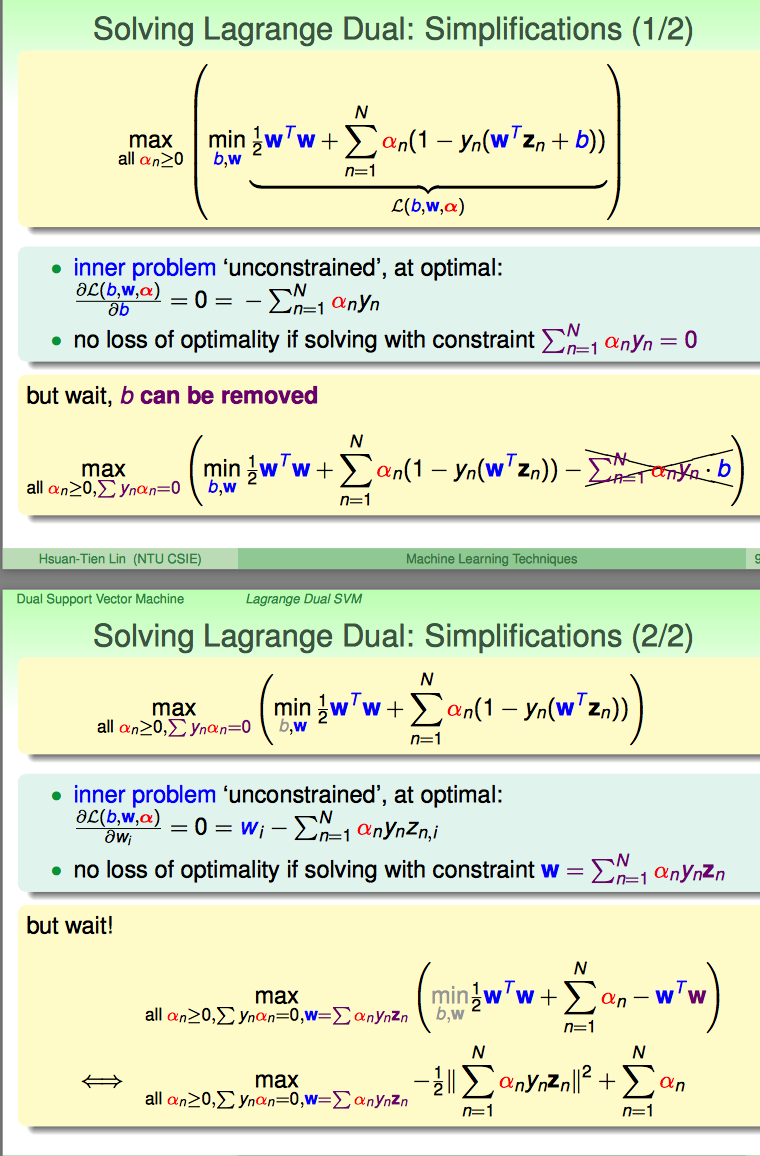

分别对b和W求导,获得梯度为零的条件。

通过梯度为0的条件,把min里的b和W都替换掉了;由于min的变量是(b,W),但现在变量只剩下alpha了,所以min也可以直接去掉了。

这里涉及到一些矩阵微分的内容(http://blog.sciencenet.cn/blog-849193-653656.html)

关于b的梯度求解很直观。

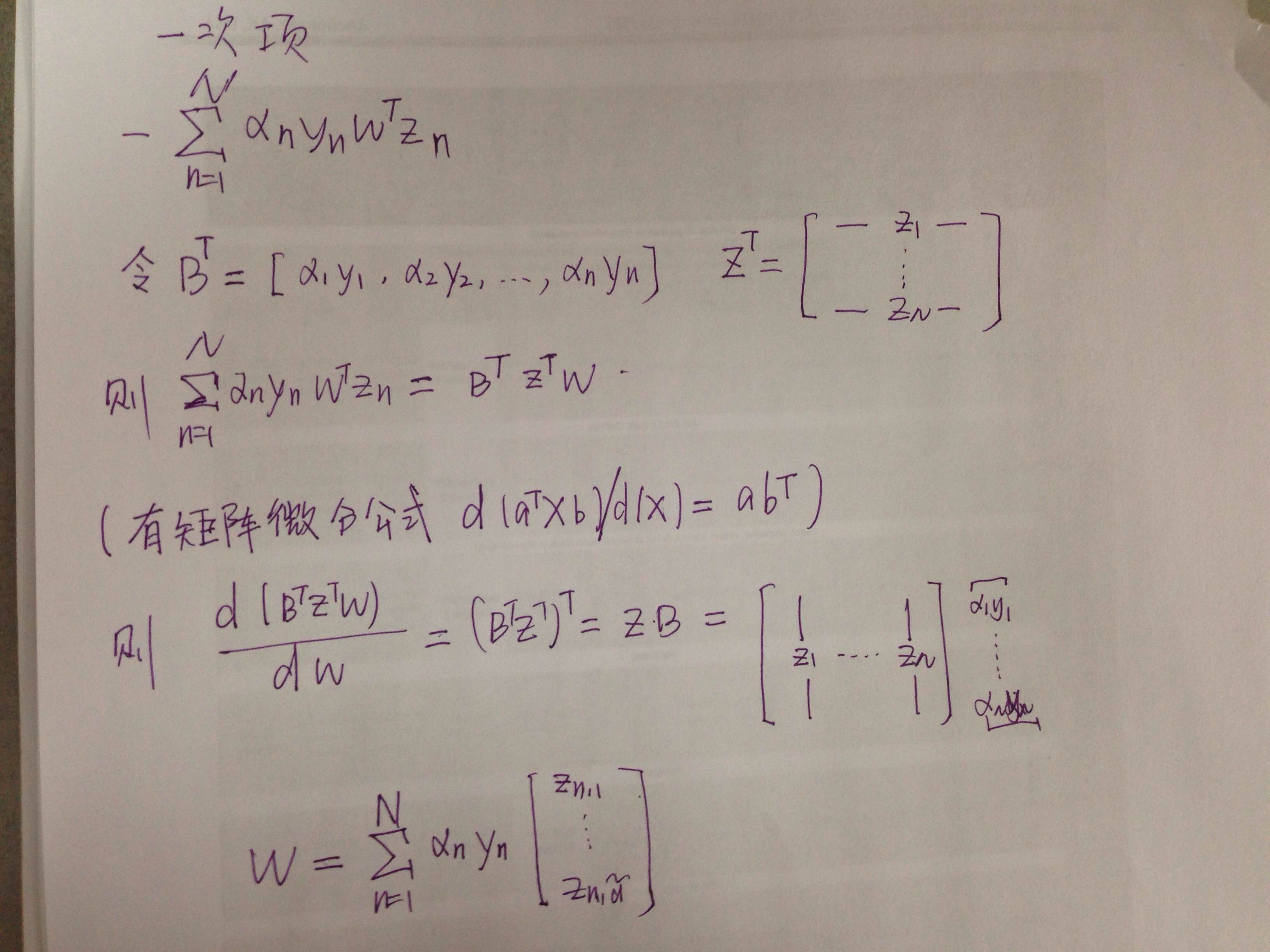

关于W的梯度求解,可以转化成矩阵向量表示。

(1)二次项求导的结果就是W

(2)一次项求导可以做如下的变换,以及最终的表达式如下。

这样W就完全用y,z,alpha表示出来了;另外,从这可以看出来W其实是输入向量Z的线性组合,每个Zn前面的系数就是alphan yn。

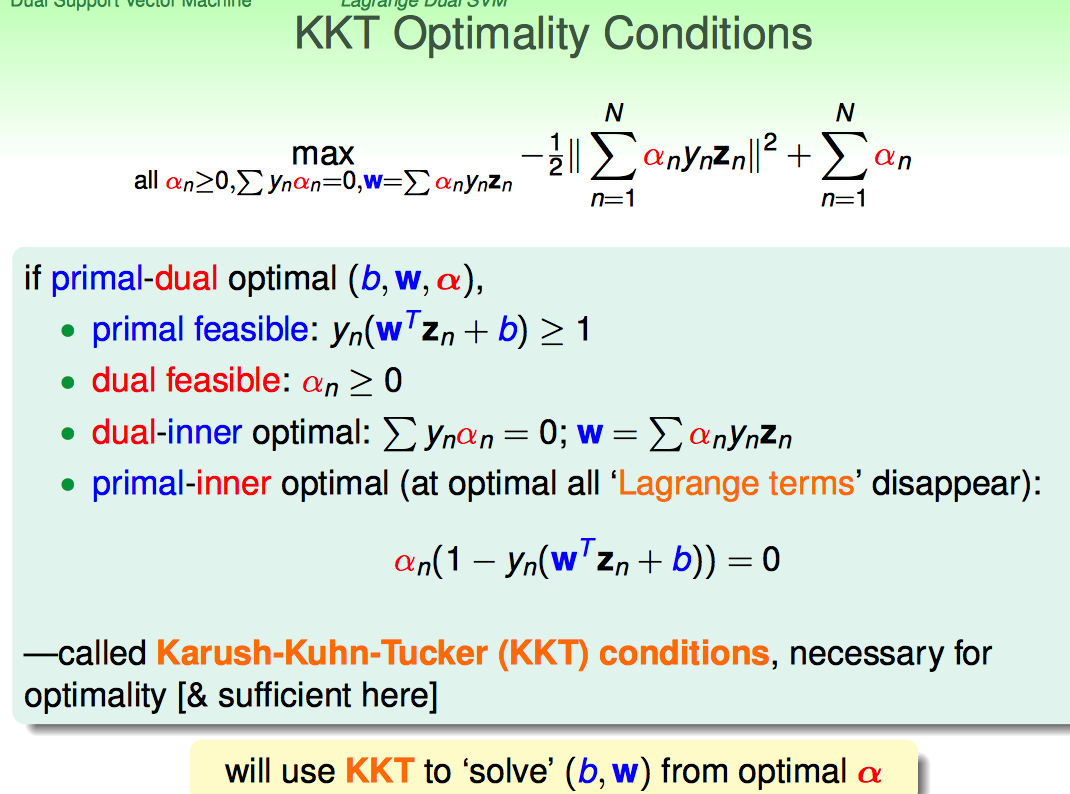

以上一系列转化的背后是KKT条件。

有了KKT条件,只要求出来最优的alpha就相当于间接求出来了(b,W).

KKT里面后两个条件比较重要:

(1)dual problem的inner部分要满足梯度为0(即取得最优化的值)

(2)原问题取得最优化值的同时,其中的拉格朗日乘子必须disappear

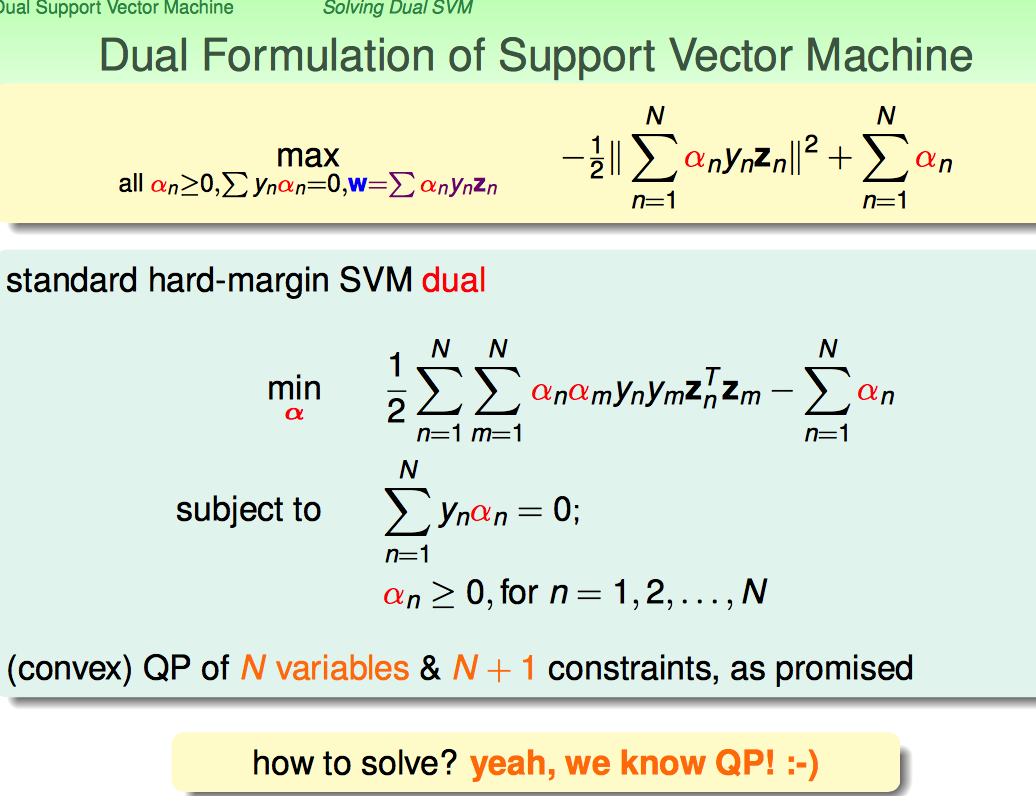

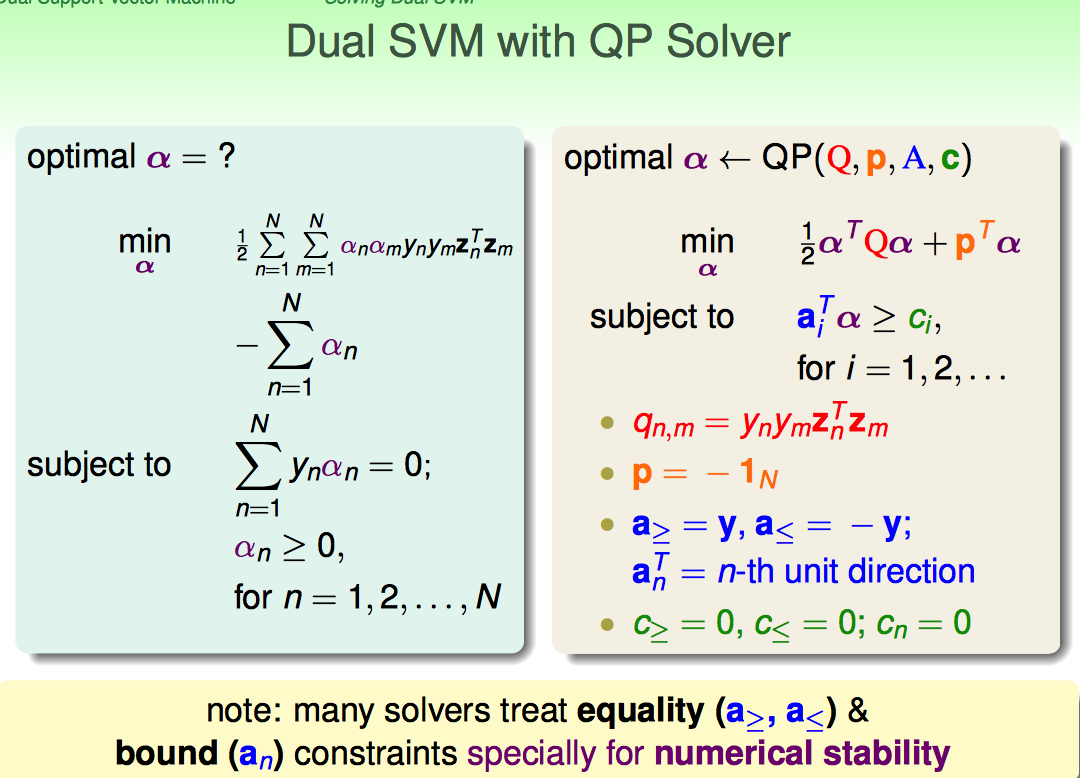

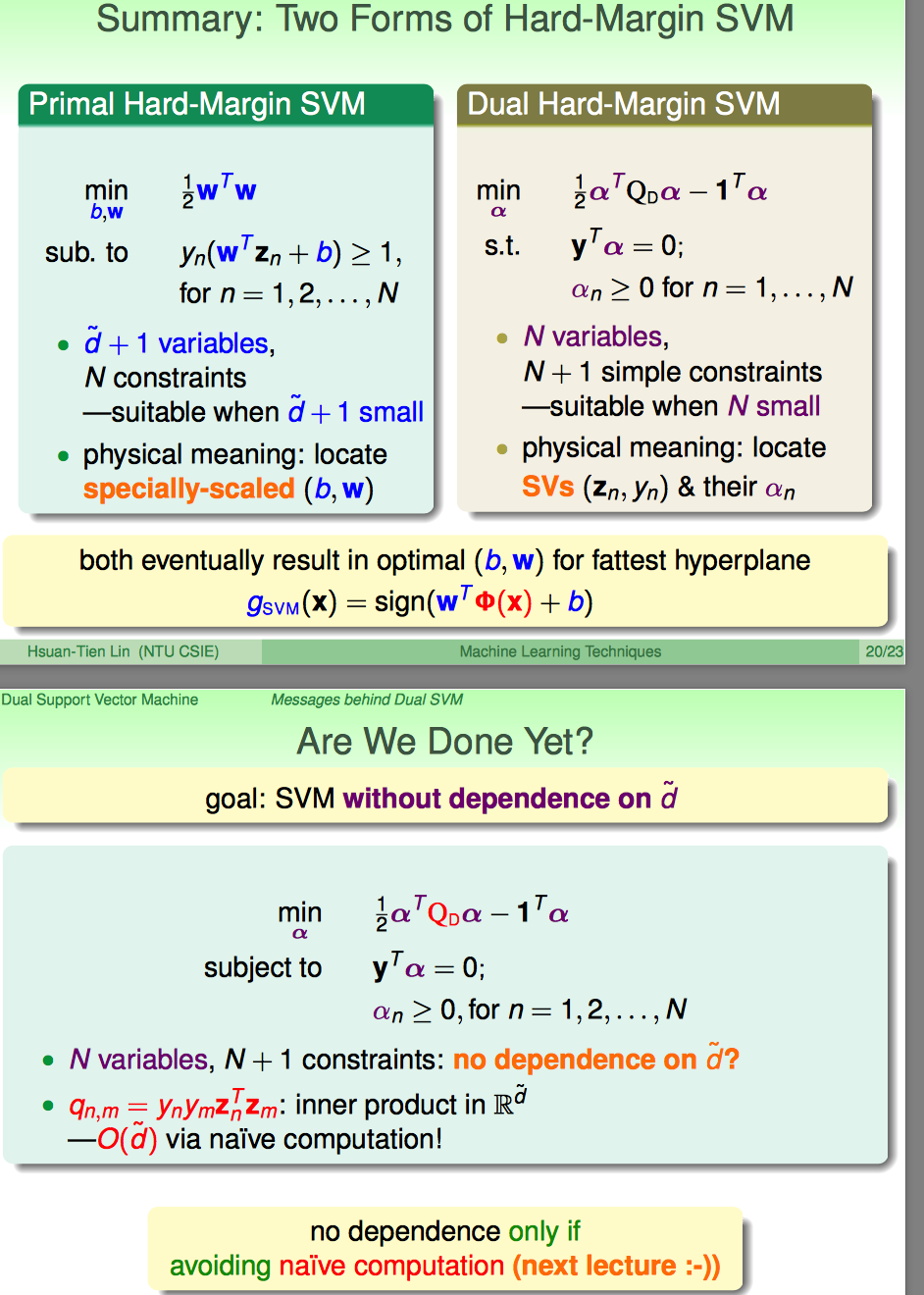

最终,转化为对偶问题后的最优化问题,就保持了N个变量(alpha),N+1个约束条件。对比原问题,变量的维度控制在了1(原来的维度是d`+1)。

直接套用QP Solver即可

目标函数:

(1)二次项系数qn,m = ynymZn'Zm

(2)一次项系数-IN

约束条件:

(1)等于0的情况可以用“大于等于∩小于等于”来代替

(2)对于alphan大于等0的情况,用n那个单位方向向量做系数([1,0.....] [0,1,0,....], .... , [0,....,0,1])

这里提到了一个东西:输入变量d`+1维度的代价哪去了?其实,转化到了qn,m中去了。

其实到这里,还是对为何要转成dual problem不十分确定,只能说是计算的代价发生了变化。

转化后约束条件的系数变得简单了,但是样本维度N一般都会大于输入维度d'很多啊,相当于目标函数复杂了一些。这样计算代价真的降低了么?

估计要想明白这个问题,还得看看QP问题是怎么求解的,后续再看吧。

总之,这里的Q矩阵依然是个N×N的矩阵,如果N很大占用的内存非常多,因此需要把特殊的求解工具才能搞定。

前面一大堆推导,后面的结论就是:

(1)最后只有alpha大于0的点被成为支撑向量(SV)

(2)最终W由所有支撑向量决定

(3)任意一个支撑向量都可以算出来b

这里回顾了之前讲过线性分类模型:W都可以看成输入数据的线性组合;SVM之所以好,是因为W只用支撑向量的线性组合就可以表示了。

这里留了一个问题:如果输入数据经过比较复杂的tranform了,还是比较难搞的,怎么能让算法摆脱d'的限制?

【Dual Support Vector Machine】林轩田机器学习技法的更多相关文章

- 【Linear Support Vector Machine】林轩田机器学习技法

首先从介绍了Large_margin Separating Hyperplane的概念. (在linear separable的前提下)找到largest-margin的分界面,即最胖的那条分界线.下 ...

- 【Support Vector Regression】林轩田机器学习技法

上节课讲了Kernel的技巧如何应用到Logistic Regression中.核心是L2 regularized的error形式的linear model是可以应用Kernel技巧的. 这一节,继续 ...

- 【Matrix Factorization】林轩田机器学习技法

在NNet这个系列中讲了Matrix Factorization感觉上怪怪的,但是听完第一小节课程就明白了. 林首先介绍了机器学习里面比较困难的一种问题:categorical features 这种 ...

- 【Deep Learning】林轩田机器学习技法

这节课的题目是Deep learning,个人以为说的跟Deep learning比较浅,跟autoencoder和PCA这块内容比较紧密. 林介绍了deep learning近年来受到了很大的关注: ...

- 【Radial Basis Function Network】林轩田机器学习技法

这节课主要讲述了RBF这类的神经网络+Kmeans聚类算法,以及二者的结合使用. 首先回归的了Gaussian SVM这个模型: 其中的Gaussian kernel又叫做Radial Basis F ...

- 【Neural Network】林轩田机器学习技法

首先从单层神经网络开始介绍 最简单的单层神经网络可以看成是多个Perception的线性组合,这种简单的组合可以达到一些复杂的boundary. 比如,最简单的逻辑运算AND OR NOT都可以由多 ...

- 【Random Forest】林轩田机器学习技法

总体来说,林对于random forest的讲解主要是算法概况上的:某种程度上说,更注重insights. 林分别列举了Bagging和Decision Tree的各自特点: Random Fores ...

- 【Decision Tree】林轩田机器学习技法

首先沿着上节课的AdaBoost-Stump的思路,介绍了Decision Tree的路数: AdaBoost和Decision Tree都是对弱分类器的组合: 1)AdaBoost是分类的时候,让所 ...

- 【Adaptive Boosting】林轩田机器学习技法

首先用一个形象的例子来说明AdaBoost的过程: 1. 每次产生一个弱的分类器,把本轮错的样本增加权重丢入下一轮 2. 下一轮对上一轮分错的样本再加重学习,获得另一个弱分类器 经过T轮之后,学得了T ...

随机推荐

- CRM, C4C和Hybris的后台作业

CRM 使用事务码SM36查看CRM系统的后台作业: 举一些例子: ABAP_TEXT_INDEX这个job执行的report是ABAP_DOCU_CREATE_TEXT_INDEX: 负责填充buf ...

- linux lnmp搭建

1.安装nginx: yum install gcc -y yum install -y pcre pcre-devel yum install -y zlib zlib-devel yum inst ...

- C# 驱动的mongodb的分页查询简单示例

/// <summary> /// mongodb分页查询 /// </summary> /// <typeparam name="T">< ...

- 4. NBU文件备份与恢复,图形界面&字符界面操作

一. 图形界面文件备份与恢复 1.1 文件备份 待补充 1.2 Windows文件恢复 (1) 打开恢复客户端 (2) 检查设置 (3) 查询可恢复信息 (4) 选取恢复时间点和文件 (5) 选择恢 ...

- PHP APC安装与使用

先要解决一下httpd-devel依赖库问题 yum install cyrus-sasl-devel db4-devel openldap apr apr-util apr-util-devel p ...

- 2017.9.27 JavaWeb 属性的设置和获取

3.4.3新属性的设置和获取 对于getpParamter方法是通过参数传递获得数据, 设置数据的方法格式: void request.setAttribute("key",Ob ...

- cuda数组的拷贝

原文链接 简单描述一下自己要做的事情:(1)CPU三维的vector--->(2)CPU三维数组--->(3)转换到GPU中的三维数组--->(4)转换到CPU中的三维数组,而其中问 ...

- deep learning书的阅读

最近坚持读书,虽然大多数读的都是一些闲书,传记.历史或者散文之类的书籍,但是也读了点专业书.闲书是散时间读的,放车里,有时间就拿起来读读,专业书则更多的靠得是专注.因为我给自己的规定是一定时间内读完几 ...

- parameter server

http://zeromq.org ZeroMQ \zero-em-queue\, \ØMQ\: Ø Connect your code in any language, on any platfo ...

- JavaSE 面试题总结

一. JavaSE 4 1. 面向对象的特征有哪些方面 4 2. String是最基本的数据类型吗? 4 3. super()与this()的区别? 4 4. JAVA的事件委托机制和垃圾回收机制 4 ...