Lucene.net入门学习

Lucene.net入门学习(结合盘古分词)

Lucene简介

Lucene是apache软件基金会4 jakarta项目组的一个子项目,是一个开放源代码的全文检索引擎工具包,即它不是一个完整的全文检索引擎,而是一个全文检索引擎的架构,提供了完整的查询引擎和索引引擎,部分文本分析引擎(英文与德文两种西方语言)。Lucene的目的是为软件开发人员提供一个简单易用的工具包,以方便的在目标系统中实现全文检索的功能,或者是以此为基础建立起完整的全文检索引擎。

Lucene.net简介

Lucene.net是Lucene的.net移植版本,是一个开源的全文检索引擎开发包,即它不是一个完整的全文检索引擎,而是一个全文检索引擎的架构,提供了完整的查询引擎和索引引擎。开发人员可以基于Lucene.net实现全文检索的功能。

Lucene.net工作原理

Lucene.net提供的服务需要两部分:索引文件的写入和索引文件的读取。

1写入流程

源数据字符串经过analyzer处理,将源中需要搜索的信息加入Document的各个字段中,并把需要索引的字段起来并存储。

将索引写入存储器,存储器可以是内存或磁盘。

2读出流程

用户提供搜索关键词,经过analyzer处理。(我们下面代码采用的是盘古分词 ,其相关分词原理 可以再它的官网上可以看到 http://pangusegment.codeplex.com/)

对处理后的关键词搜索索引找出对应的Document,用户根据需要从找到的Document中提取需要的Field。

Lucene.net安装

大家可以去官网看下:https://www.nuget.org/packages/Lucene.Net/3.0.3

盘古分词安装

盘古分词主页:http://pangusegment.codeplex.com/

下载:http://pangusegment.codeplex.com/downloads/get/144143

Lucene.net结合盘古分词使用

http://pangusegment.codeplex.com/downloads/get/144145

大家可以看到相关使用的案列

Lucene.net创建索引(结合盘古分词)

/*code 释迦苦僧*/

class Program

{

static void Main(string[] args)

{

Stopwatch sw = new Stopwatch();//加入时间统计

//获取 数据列表

PostBll bll = new PostBll();

IList<PostInfo> posts = bll.GetAllPost();

Console.WriteLine(posts.Count);

//创建Lucene索引文件

string IndexDic = @"D:\Lucene\post\";

sw.Start();

IndexWriter writer = new IndexWriter(FSDirectory.Open(IndexDic), new PanGuAnalyzer(), true, IndexWriter.MaxFieldLength.LIMITED);

foreach (PostInfo item in posts)

{

Document doc = new Document();

Field postid = new Field("PostId", item.PostId.ToString(), Field.Store.YES, Field.Index.ANALYZED, Field.TermVector.NO);

Field title = new Field("Title", item.Title.ToString(), Field.Store.YES, Field.Index.ANALYZED, Field.TermVector.NO);

Field postscore = new Field("PostScore", item.PostScore.ToString(), Field.Store.YES, Field.Index.ANALYZED, Field.TermVector.NO);

doc.Add(postid);

doc.Add(title);

doc.Add(postscore);

writer.AddDocument(doc);

}

writer.Optimize();

writer.Commit();

sw.Stop();

Console.Write("建立" + posts.Count + "索引,花费: " + sw.Elapsed);

Console.ReadLine();

}

}

如代码所示:

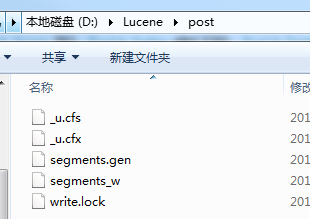

D:\Lucene\post\ 存储Lucene.net生成的索引文件,如下图

这些索引存储文件存储了PostInfo表中 PostId,Title,PostScore 三个字段信息。

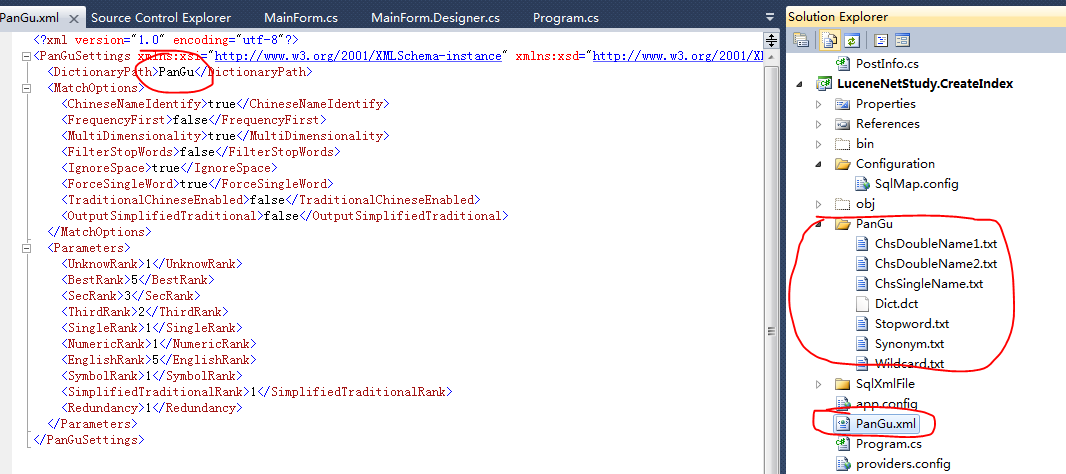

需要注意的是:使用盘古分词操作时,需要将PanGu.xml和盘古分词自带的分词文件放入项目中,如下图:

Lucene.net执行搜索(结合盘古分词)

namespace LuceneNetStudy.Search

{

/*code 释迦苦僧*/

public partial class MainForm : Form

{

private string IndexDic = @"D:\Lucene\post\"; public MainForm()

{

InitializeComponent();

} private void btnSearch_Click(object sender, EventArgs e)

{

/*开启搜索用的后台线程*/

BackgroundWorker backWorker = new BackgroundWorker();

backWorker.DoWork += new DoWorkEventHandler(backWorker_DoWork);

backWorker.RunWorkerAsync(txtKey.Text.Trim());

} void backWorker_DoWork(object sender, DoWorkEventArgs e)

{

string key = e.Argument as string; List<PostInfo> result = new List<PostInfo>();

/*加入时间统计*/

Stopwatch sw = new Stopwatch();

sw.Start(); /*创建 Lucene.net 搜索实例*/

IndexSearcher search = new IndexSearcher(FSDirectory.Open(IndexDic), true); /*为搜索实例 加入搜索分词规则 来源 盘古分词*/

key = GetKeyWordsSplitBySpace(key, new PanGuTokenizer());

BooleanQuery bq = new BooleanQuery();

if (!string.IsNullOrEmpty(key))

{

/*如果搜索关键字不为空 知道关键字搜索列为Title*/

QueryParser queryParser = new MultiFieldQueryParser(Lucene.Net.Util.Version.LUCENE_30, new string[] { "Title" }, new PanGuAnalyzer());

Query query = queryParser.Parse(key);

bq.Add(query, Occur.MUST);

} /*指定排序方式 按 PostScore 字段来排序*/

List<SortField> sorts = new List<SortField>();

SortField sf = new SortField("PostScore", SortField.DOUBLE, true);

sorts.Add(sf);

Sort sort = new Sort(sorts.ToArray());

TopFieldDocs docs = search.Search(bq, null, search.MaxDoc, sort);

int allCount = docs.TotalHits;

/*获取匹配的前10条*/

ScoreDoc[] hits = TopDocs(0, 10, docs);

foreach (ScoreDoc sd in hits)//遍历搜索到的结果

{

try

{

Document doc = search.Doc(sd.Doc);

var model = new PostInfo();

model.PostId = Guid.Parse(doc.Get("PostId"));

model.PostScore = double.Parse(doc.Get("PostScore"));

model.Title = doc.Get("Title");

result.Add(model);

}

catch

{ }

}

search.Close();

search.Dispose();

sw.Stop();

if (result != null)

{

Invoke(new MethodInvoker(delegate()

{

lblRunTime.Text = "花费: " + sw.Elapsed; txtResult.Text = "";

foreach (PostInfo info in result)//遍历搜索到的结果

{

txtResult.Text += info.PostScore + "\t" + info.Title + "\r\n";

}

}));

}

} public static ScoreDoc[] TopDocs(int start, int limit, TopFieldDocs docs)

{

int endIndex = 0;

int hc = docs.TotalHits;

if (hc - start > limit)

{

endIndex = start + limit;

}

else

{

endIndex = hc;

} List<ScoreDoc> dl = new List<ScoreDoc>();

var da = docs.ScoreDocs;

for (int i = start; i < endIndex; i++)

{

dl.Add(da[i]);

}

return dl.ToArray();

} static public string GetKeyWordsSplitBySpace(string keywords, PanGuTokenizer ktTokenizer)

{

StringBuilder result = new StringBuilder();

/*执行分词操作 一个关键字可以拆分为多个次和单个字*/

ICollection<WordInfo> words = ktTokenizer.SegmentToWordInfos(keywords); foreach (WordInfo word in words)

{

if (word == null)

{

continue;

} result.AppendFormat("{0} ", word.Word);

} return result.ToString().Trim();

}

}

}

这是咱这两天的学习成果,研究还不是很透彻,希望能给大家带来些了解,点个赞吧。

作者:释迦苦僧 出处:http://www.cnblogs.com/woxpp/p/3972233.html 本文版权归作者和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文连接。

Lucene.net入门学习的更多相关文章

- Lucene.net入门学习系列(2)

Lucene.net入门学习系列(2) Lucene.net入门学习系列(1)-分词 Lucene.net入门学习系列(2)-创建索引 Lucene.net入门学习系列(3)-全文检索 在使用Luce ...

- Lucene.net入门学习系列(1)

Lucene.net入门学习系列(1) Lucene.net入门学习系列(1)-分词 Lucene.net入门学习系列(2)-创建索引 Lucene.net入门学习系列(3)-全文检索 这几天在公 ...

- Lucene.net入门学习(结合盘古分词)

Lucene简介 Lucene是apache软件基金会4 jakarta项目组的一个子项目,是一个开放源代码的全文检索引擎工具包,即它不是一个完整的全文检索引擎,而是一个全文检索引擎的架构,提供了完整 ...

- Lucene.net入门学习(结合盘古分词)(转载)

作者:释迦苦僧 出处:http://www.cnblogs.com/woxpp/p/3972233.html 本文版权归作者和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显 ...

- 【转载】Lucene.Net入门教程及示例

本人看到这篇非常不错的Lucene.Net入门基础教程,就转载分享一下给大家来学习,希望大家在工作实践中可以用到. 一.简单的例子 //索引Private void Index(){ Index ...

- Elasticsearch7.X 入门学习第五课笔记---- - Mapping设定介绍

原文:Elasticsearch7.X 入门学习第五课笔记---- - Mapping设定介绍 版权声明:本文为博主原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明. 本 ...

- Elasticsearch7.X 入门学习第一课笔记----基本概念

原文:Elasticsearch7.X 入门学习第一课笔记----基本概念 版权声明:本文为博主原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明. 本文链接:https: ...

- vue入门学习(基础篇)

vue入门学习总结: vue的一个组件包括三部分:template.style.script. vue的数据在data中定义使用. 数据渲染指令:v-text.v-html.{{}}. 隐藏未编译的标 ...

- Hadoop入门学习笔记---part4

紧接着<Hadoop入门学习笔记---part3>中的继续了解如何用java在程序中操作HDFS. 众所周知,对文件的操作无非是创建,查看,下载,删除.下面我们就开始应用java程序进行操 ...

随机推荐

- HDoj-1879-畅通project-并查集

继续畅通project Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 32768/32768 K (Java/Others) Tota ...

- SSH-Struts(两)—调节器(ActionServlet)

第一部分介绍的博客Struts架构,下一节介绍中特定成分,这个博客是写Struts控制器ActionServlet. 扮演的角色 ActionServlet类是Struts的控制中心,全部来自于浏览器 ...

- HDU 2082-找单词(母函数)

找单词 Time Limit: 1000/1000 MS (Java/Others) Memory Limit: 32768/32768 K (Java/Others) Total Submis ...

- HDU 4292Food(网络流的最大流量)

职务地址:HDU 4292 水题. 因为每一个人仅仅能有1份,所以须要拆点限制流量.建图方法为,建一源点与汇点.将食物与源点相连,权值为食物额数量,将饮料与汇点相连,权值为饮料数量..然后将人进行拆点 ...

- Java代码优化(转)

前言 代码优化,一个很重要的课题.可能有些人觉得没用,一些细小的地方有什么好修改的,改与不改对于代码的运行效率有什么影响呢?这个问题我是这么考虑的,就像大海里面的鲸鱼一样,它吃一条小虾米有用吗?没用, ...

- 如何用Excel直接查询Oracle中的数据(转)

将Oracle中查询的数据保存为Excel文件,通常使用的是PL/SQL Developer. 其实,Excel可直接写SQL语句查询Oracle中数据,在这里,用到ODBC驱动.详细步骤如下: 一. ...

- oracle rac常用的命令

oracle rac常用的命令 节点层:olsnodes 网络层: oifcfg 集群层:crsctl,ocrcheck,ocrdump,ocrconfig 应用层:srvctl,onsctl,crs ...

- DropDownListFor使用ViewData进行绑定的示例

特别注意,经实践: 此方法的ViewBag的名称必须和new SelectList()中的最后一个参数,即下拉框的默认值的名称必须相同,如: ViewBag.Title = WebConst.UnSe ...

- 经Apache将tomcat转用80port这两个域名

一般用tomcat通告Java web项目采用www.xxx.com:8080/appname/xxxservlet要访问一个简单的服务,这会'暴漏'应用程序名称(当然,你也可以摆脱),它看起来并不规 ...

- OCP-1Z0-051-标题决心-文章5称号

5. Which SQL statements would display the value 1890.55 as $1,890.55? (Choose three .) A. SELECT TO_ ...