WebRTC音频通话升级为视频通话

我们有时候在音频通话过程中,想要改成视频通话。如果挂断当前通话再重新发起视频通话就会显得比较麻烦。

因此很多app提供了将音频通话升级成视频通话的功能,同时也有将视频通话降为音频通话的功能。

本文演示的是在本地模拟音频通话,并且将音频通话升级为视频通话。

准备

界面很简单,2个video加上几个按钮。

<video id="localVideo" playsinline autoplay muted></video>

<video id="remoteVideo" playsinline autoplay></video>

<div>

<button id="startBtn">开始</button>

<button id="callBtn">Call</button>

<button id="upgradeBtn">升级为视频通话</button>

<button id="hangupBtn">挂断</button>

</div>

用的是本地的adapter

<script src="../../src/js/adapter-2021.js"></script>

js

先来把元素拿到

const startBtn = document.getElementById('startBtn');

const callBtn = document.getElementById('callBtn');

const upgradeToVideoBtn = document.getElementById('upgradeBtn');

const hangupBtn = document.getElementById('hangupBtn');

const localVideo = document.getElementById('localVideo'); // 本地预览

const remoteVideo = document.getElementById('remoteVideo'); // 接收方

监听器

设置一些监听

localVideo.addEventListener('loadedmetadata', function () {

console.log(`localVideo 宽高: ${this.videoWidth}px, ${this.videoHeight}px`);

});

remoteVideo.addEventListener('loadedmetadata', function () {

console.log(`remoteVideo 宽高: ${this.videoWidth}px, ${this.videoHeight}px`);

});

let startTime;

remoteVideo.onresize = () => {

console.log(`remoteVideo onresize 宽高: ${remoteVideo.videoWidth}x${remoteVideo.videoHeight}`);

if (startTime) {

const elapsedTime = window.performance.now() - startTime;

console.log(`建立连接耗时: ${elapsedTime.toFixed(3)}ms`);

startTime = null;

}

};

startBtn.onclick = start;

callBtn.onclick = call;

upgradeToVideoBtn.onclick = upgrade;

hangupBtn.onclick = hangup;

打一些状态变化的log

function onCreateSessionDescriptionError(error) {

console.log(`rustfisher.com:创建会话描述失败, session description err: ${error.toString()}`);

}

function onIceStateChange(pc, event) {

if (pc) {

console.log(`rustfisher.com:${getName(pc)} ICE状态: ${pc.iceConnectionState}`);

console.log('rustfisher.com:ICE状态变化: ', event);

}

}

function onAddIceCandidateSuccess(pc) {

console.log(`rustfisher.com:${getName(pc)} addIceCandidate success 添加ICE候选成功`);

}

function onAddIceCandidateError(pc, error) {

console.log(`rustfisher.com:${getName(pc)} 添加ICE候选失败 failed to add ICE Candidate: ${error.toString()}`);

}

function onSetLocalSuccess(pc) {

console.log(`rustfisher.com:${getName(pc)} setLocalDescription 成功`);

}

function onSetSessionDescriptionError(error) {

console.log(`rustfisher.com:设置会话描述失败: ${error.toString()}`);

}

function onSetRemoteSuccess(pc) {

console.log(`rustfisher.com:${getName(pc)} 设置远程描述成功 setRemoteDescription complete`);

}

// 辅助方法

function getName(pc) {

return (pc === pc1) ? 'pc1' : 'pc2';

}

function getOtherPc(pc) {

return (pc === pc1) ? pc2 : pc1;

}

开始

获取本地的音频数据流,交给localVideo

function gotStream(stream) {

console.log('获取到了本地数据流');

localVideo.srcObject = stream;

localStream = stream;

callBtn.disabled = false;

}

function start() {

console.log('请求本地数据流 纯音频');

startBtn.disabled = true;

navigator.mediaDevices

.getUserMedia({ audio: true, video: false })

.then(gotStream)

.catch(e => alert(`getUserMedia() error: ${e.name}`));

}

call

发起音频呼叫

function call() {

callBtn.disabled = true;

upgradeToVideoBtn.disabled = false;

hangupBtn.disabled = false;

console.log('开始呼叫...');

startTime = window.performance.now();

const audioTracks = localStream.getAudioTracks();

if (audioTracks.length > 0) {

console.log(`使用的音频设备: ${audioTracks[0].label}`);

}

const servers = null; // 就在本地测试

pc1 = new RTCPeerConnection(servers);

console.log('创建本地节点 pc1');

pc1.onicecandidate = e => onIceCandidate(pc1, e);

pc2 = new RTCPeerConnection(servers);

console.log('rustfisher.com:创建模拟远端节点 pc2');

pc2.onicecandidate = e => onIceCandidate(pc2, e);

pc1.oniceconnectionstatechange = e => onIceStateChange(pc1, e);

pc2.oniceconnectionstatechange = e => onIceStateChange(pc2, e);

pc2.ontrack = gotRemoteStream;

localStream.getTracks().forEach(track => pc1.addTrack(track, localStream));

console.log('rustfisher.com:将本地数据流交给pc1');

console.log('rustfisher.com:pc1开始创建offer');

pc1.createOffer(offerOptions).then(onCreateOfferSuccess, onCreateSessionDescriptionError);

}

function gotRemoteStream(e) {

console.log('获取到远程数据流', e.track, e.streams[0]);

remoteVideo.srcObject = null;

remoteVideo.srcObject = e.streams[0];

}

function onIceCandidate(pc, event) {

getOtherPc(pc)

.addIceCandidate(event.candidate)

.then(() => onAddIceCandidateSuccess(pc), err => onAddIceCandidateError(pc, err));

console.log(`${getName(pc)} ICE candidate:\n${event.candidate ? event.candidate.candidate : '(null)'}`);

}

function onCreateOfferSuccess(desc) {

console.log(`pc1提供了offer\n${desc.sdp}`);

console.log('pc1 setLocalDescription start');

pc1.setLocalDescription(desc).then(() => onSetLocalSuccess(pc1), onSetSessionDescriptionError);

console.log('pc2 setRemoteDescription start');

pc2.setRemoteDescription(desc).then(() => onSetRemoteSuccess(pc2), onSetSessionDescriptionError);

console.log('pc2 createAnswer start');

pc2.createAnswer().then(onCreateAnswerSuccess, onCreateSessionDescriptionError);

}

function onCreateAnswerSuccess(desc) {

console.log(`rustfisher.com:pc2应答成功: ${desc.sdp}`);

console.log('pc2 setLocalDescription start');

pc2.setLocalDescription(desc).then(() => onSetLocalSuccess(pc2), onSetSessionDescriptionError);

console.log('pc1 setRemoteDescription start');

pc1.setRemoteDescription(desc).then(() => onSetRemoteSuccess(pc1), onSetSessionDescriptionError);

}

- 创建RTCPeerConnection

- 设置

onicecandidate监听ICE候选 - 设置

oniceconnectionstatechange监听ICE连接状态变化 - 接收方监听

ontrack - 发送方pc1

addTrack将当前数据流添加进去 - 发送方pc1创建offer

createOffer - pc1创建好offer后,接收方pc2应答

createAnswer

升级到视频通话

upgrade()方法处理升级操作

function upgrade() {

upgradeToVideoBtn.disabled = true;

navigator.mediaDevices

.getUserMedia({ video: true })

.then(stream => {

console.log('rustfisher.com:获取到了视频流');

const videoTracks = stream.getVideoTracks();

if (videoTracks.length > 0) {

console.log(`video device: ${videoTracks[0].label}`);

}

localStream.addTrack(videoTracks[0]);

localVideo.srcObject = null; // 重置视频流

localVideo.srcObject = localStream;

pc1.addTrack(videoTracks[0], localStream);

return pc1.createOffer();

})

.then(offer => pc1.setLocalDescription(offer))

.then(() => pc2.setRemoteDescription(pc1.localDescription))

.then(() => pc2.createAnswer())

.then(answer => pc2.setLocalDescription(answer))

.then(() => pc1.setRemoteDescription(pc2.localDescription));

}

发送方去获取音频数据流getUserMedia。

将音频轨道添加进localStream,并且发送方也要添加轨道 pc1.addTrack。

创建offer createOffer

后面就是接收方pc2应答

挂断

简单的挂断功能如下

function hangup() {

console.log('rustfisher.com:挂断');

pc1.close();

pc2.close();

pc1 = null;

pc2 = null;

const videoTracks = localStream.getVideoTracks();

videoTracks.forEach(videoTrack => {

videoTrack.stop();

localStream.removeTrack(videoTrack);

});

localVideo.srcObject = null;

localVideo.srcObject = localStream;

hangupBtn.disabled = true;

callBtn.disabled = false;

}

主要是把呼出方的流关闭掉

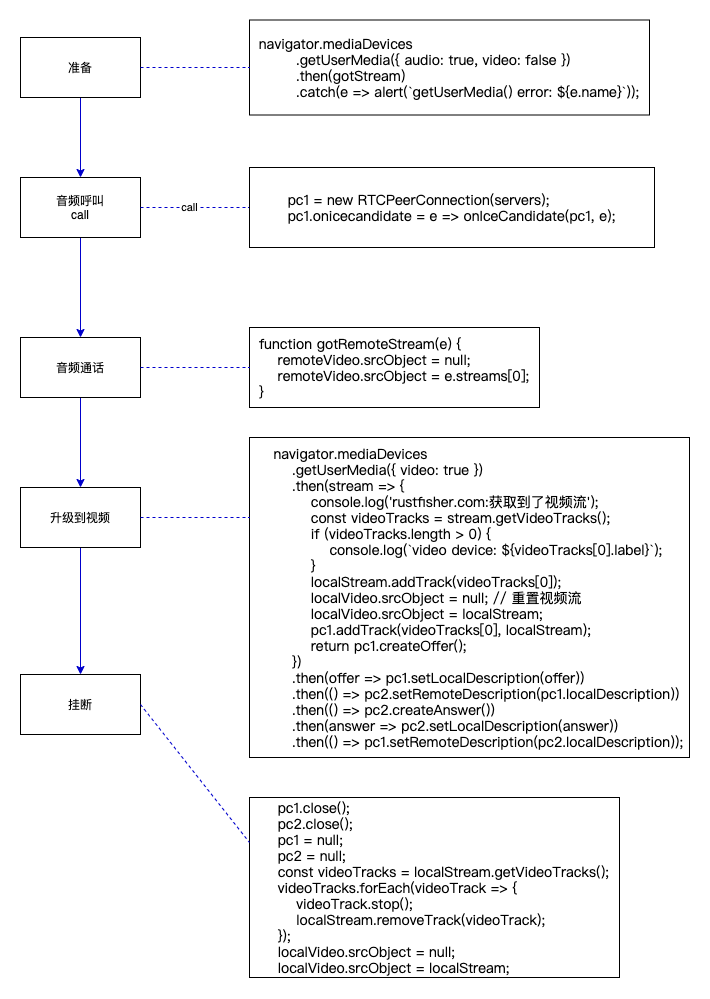

代码流程描述图

将用户的操作(按钮)和主要代码对应起来

效果预览

效果预览请参考WebRTC音频通话升级到视频通话

WebRTC音频通话升级为视频通话的更多相关文章

- WebRTC VoiceEngine综合应用示例(二)——音频通话的基本流程(转)

下面将以实现一个音频通话功能为示例详细介绍VoiceEngine的使用,在文末将附上相应源码的下载地址.这里参考的是voiceengine\voe_cmd_test. 第一步是创建VoiceEngin ...

- AliIAC 智能音频编解码器:在有限带宽条件下带来更高质量的音频通话体验

随着信息技术的发展,人们对实时通信的需求不断增加,并逐渐成为工作生活中不可或缺的一部分.每年海量的音视频通话分钟数对互联网基础设施提出了巨大的挑战.尽管目前全球的互联网用户绝大多数均处于良好的网络状况 ...

- 单独编译和使用webrtc音频回声消除模块(附完整源码+测试音频文件)

单独编译和使用webrtc音频降噪模块(附完整源码+测试音频文件) 单独编译和使用webrtc音频增益模块(附完整源码+测试音频文件) 说实话很不想写这篇文章,因为这和我一贯推崇的最好全部编译并使用w ...

- 单独编译和使用webrtc音频降噪模块(附完整源码+测试音频文件)

单独编译和使用webrtc音频增益模块(附完整源码+测试音频文件) 单独编译和使用webrtc音频回声消除模块(附完整源码+测试音频文件) webrtc的音频处理模块分为降噪ns,回音消除aec,回声 ...

- 单独编译和使用webrtc音频增益模块(附完整源码+测试音频文件)

webrtc的音频处理模块分为降噪ns和nsx,回音消除aec,回声控制acem,音频增益agc,静音检测部分.另外webrtc已经封装好了一套音频处理模块APM,如果不是有特殊必要,使用者如果要用到 ...

- WebRTC音频预处理单元APM的整体编译及使用

正文 行的gnu静态库链接路径是针对NDK版本 r8d 的,如读者版本不匹配,请自行找到 libgnustl_static.a 静态库的路径进行替换. 3)本示例并不打算编译 WebRTC 的测试工程 ...

- WebRTC 音频采样算法 附完整C++示例代码

之前有大概介绍了音频采样相关的思路,详情见<简洁明了的插值音频重采样算法例子 (附完整C代码)>. 音频方面的开源项目很多很多. 最知名的莫过于谷歌开源的WebRTC, 其中的音频模块就包 ...

- WebRTC 音频算法 附完整C代码

WebRTC提供一套音频处理引擎, 包含以下算法: AGC自动增益控制(Automatic Gain Control) ANS噪音抑制(Automatic Noise Suppression) AEC ...

- webrtc 音频一点相关知识

采样频率: 44.1kHz ,它的意思是每秒取样44100次 .8kHz 8000次, 16kHz 160000次 比特率: 比特率是大家常听说的一个名词,数码录音一般使用16比特 ...

随机推荐

- freeswitch verto communicator客户端

概述 我们在web客户端使用sip协议时用的比较多的是sipml5库和jssip库. 但是sip协议比较重,又复杂,所以freeswitch内部就自定义了一个verto协议,方便在web页面上使用音视 ...

- Mybatis类型转换BUG

案例:mybatis框架的使用中是否遇到过前台传入数据后mybatis后台并不执行sql的情况呢? 比如:前台传入一个状态var flag //空字符,0,1 然后你用int接收,到mybatis框架 ...

- freeswitch APR库哈希表

概述 freeswitch的核心源代码是基于apr库开发的,在不同的系统上有很好的移植性. 哈希表在开发中应用的非常广泛,主要场景是对查询效率要求较高的逻辑,是典型的空间换时间的数据结构实现. 大多数 ...

- Codeforces 1499G - Graph Coloring(带权并查集+欧拉回路)

Codeforces 题面传送门 & 洛谷题面传送门 一道非常神仙的题 %%%%%%%%%%%% 首先看到这样的设问,做题数量多一点的同学不难想到这个题.事实上对于此题而言,题面中那个&quo ...

- 洛谷 P6672 - [清华集训2016] 你的生命已如风中残烛(组合数学)

洛谷题面传送门 题解里一堆密密麻麻的 Raney 引理--蒟蒻表示看不懂,因此决定写一篇题解提供一个像我这样的蒟蒻能理解的思路,或者说,理解方式. 首先我们考虑什么样的牌堆顺序符合条件.显然,在摸牌任 ...

- mysql 不等于 符号写法

今天在写sql语句的时候,想确认下mysql的不等于运算符是用什么符号表示的 经过测试发现mysql中用<>与!=都是可以的,但sqlserver中不识别!=,所以建议用<> ...

- kubernetes部署 kube-apiserver服务

kubernetes部署 kube-apiserver 组件 本文档讲解使用 keepalived 和 haproxy 部署一个 3 节点高可用 master 集群的步骤. kube-apiserve ...

- vue-baidu-map相关随笔

一,使用vue-baidu-map 1.下载相关包依赖 npm i vue-baidu-map 2.在main.js中import引入相关包依赖,在main.js中添加如下代码: import B ...

- Mybatis相关知识点(一)

MyBatis入门 (一)介绍 MyBatis 本是apache的一个开源项目iBatis, 2010年这个项目由apache software foundation 迁移到了google code, ...

- ssh : connect to host XXX.XXX.XXX.XXX port : 22 connect refused

初学者 写博客 如有不对之处请多多指教 我是要在俩个主机的俩个虚拟机上 用scp (security copy)进行文件远程复制. 但是 终端 提示 ssh : connect to host XXX ...