k8s安装部署过程个人总结及参考文章

以下是本人安装k8s过程

一、单机配置

1. 环境准备

| 主机名 | IP | 配置 |

|---|---|---|

| master1 | 192.168.1.181 | 1C 4G |

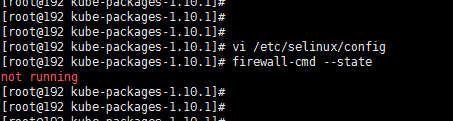

关闭所有节点的seliux以及firewalld

sed -i 's/SELINUX=enforcing/SELINUX=disabled/g' /etc/selinux/config

setenforce

systemctl disable firewalld

systemctl stop firewalld

2. 安装docker

使用文件docker-packages.tar,每个节点都要安装。

tar -xvf docker-packages.tar

cd docker-packages

rpm -Uvh * 或者 yum install local *.rpm 进行安装

docker version #安装完成查看版本

启动docker,并设置为开机自启

systemctl start docker && systemctl enable docker

输入docker info,==记录Cgroup Driver==

Cgroup Driver: cgroupfs

docker和kubelet的cgroup driver需要一致,如果docker不是cgroupfs,则执行

cat << EOF > /etc/docker/daemon.json

{

"exec-opts": ["native.cgroupdriver=cgroupfs"]

}

EOF

systemctl daemon-reload && systemctl restart docker

3. 安装kubeadm,kubectl,kubelet

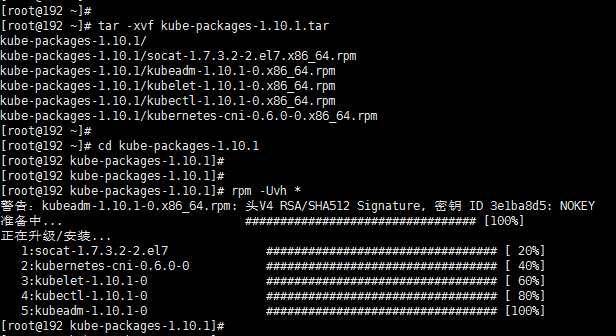

使用文件kube-packages-1.10.1.tar,每个节点都要安装

kubeadm是集群部署工具

kubectl是集群管理工具,通过command来管理集群

kubelet的k8s集群每个节点的docker管理服务

tar -xvf kube-packages-1.10..tar

cd kube-packages-1.10.

rpm -Uvh * 或者 yum install local *.rpm 进行安装

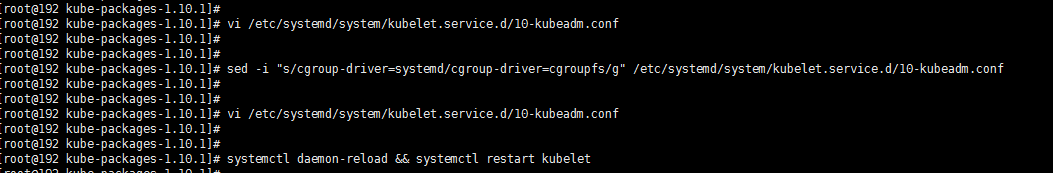

在所有kubernetes节点上设置kubelet使用cgroupfs,与dockerd保持一致,否则kubelet会启动报错

默认kubelet使用的cgroup-driver=systemd,改为cgroup-driver=cgroupfs

sed -i "s/cgroup-driver=systemd/cgroup-driver=cgroupfs/g" /etc/systemd/system/kubelet.service.d/-kubeadm.conf

重设kubelet服务,并重启kubelet服务systemctl daemon-reload && systemctl restart kubelet

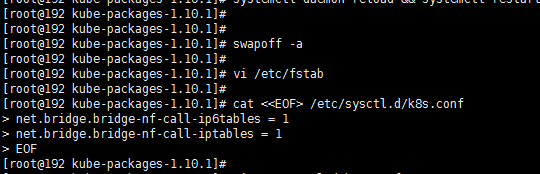

关闭swap,及修改iptables,不然后面kubeadm会报错

swapoff -a

vi /etc/fstab #swap一行注释

cat <<EOF > /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables =

net.bridge.bridge-nf-call-iptables =

EOF

sysctl --system

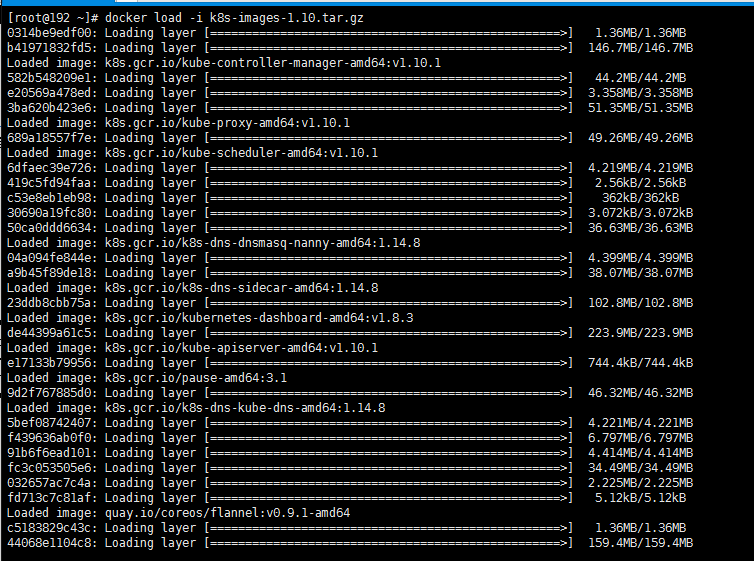

4. 导入镜像

使用文件k8s-images-1.10.tar.gz,每个节点都要执行

节点较少,就不搭建镜像仓库服务了,后续要用的应用镜像,每个节点都要导入

docker load -i k8s-images-1.10.tar.gz

一共11个镜像,分别是

k8s.gcr.io/etcd-amd64:3.1.

k8s.gcr.io/kube-apiserver-amd64:v1.10.1

k8s.gcr.io/kube-controller-manager-amd64:v1.10.1

k8s.gcr.io/kube-proxy-amd64:v1.10.1

k8s.gcr.io/kube-scheduler-amd64:v1.10.1

k8s.gcr.io/pause-amd64:3.1

k8s.gcr.io/k8s-dns-kube-dns-amd64:1.14.

k8s.gcr.io/k8s-dns-dnsmasq-nanny-amd64:1.14.

k8s.gcr.io/k8s-dns-sidecar-amd64:1.14.

k8s.gcr.io/kubernetes-dashboard-amd64:v1.8.3

quay.io/coreos/flannel:v0.9.1-amd64

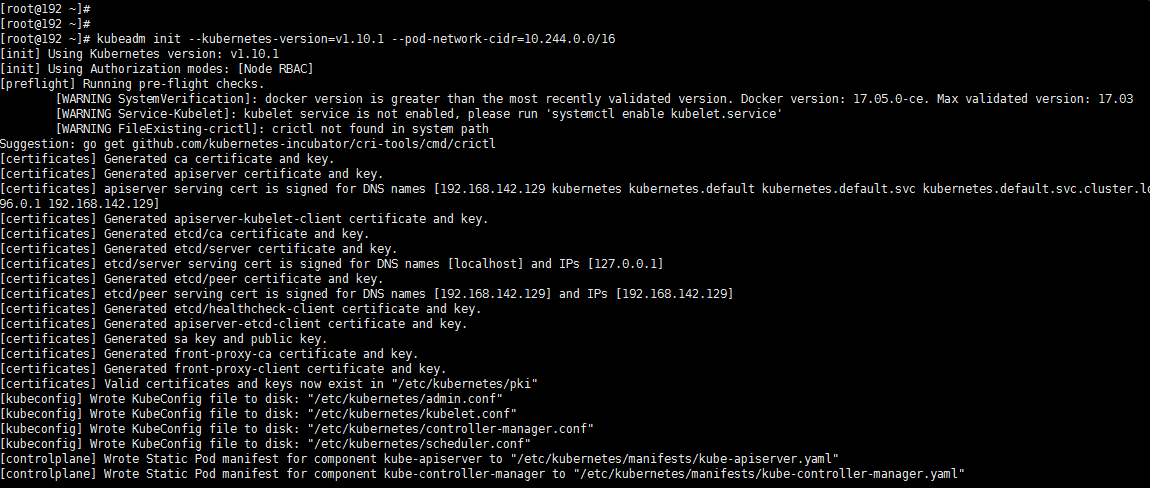

5. kubeadm init 部署master节点

只在master执行。此处选用最简单快捷的部署方案。etcd、api、controller-manager、 scheduler服务都会以容器的方式运行在master。etcd 为单点,不带证书。etcd的数据会挂载到master节点/var/lib/etcd

init部署是支持etcd 集群和证书模式的,配置方法见我1.9的文档,此处略过。

init命令注意要指定版本,和pod范围

kubeadm init --kubernetes-version=v1.10.1 --pod-network-cidr=10.244.0.0/

Your Kubernetes master has initialized successfully!

To start using your cluster, you need to run the following as a regular user:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

You should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

You can now join any number of machines by running the following on each node

as root:

kubeadm join 192.168.1.181:6443 --token wct45y.tq23fogetd7rp3ck --discovery-token-ca-cert-hash sha256:c267e2423dba21fdf6fc9c07e3b3fa17884c4f24f0c03f2283a230c70b07772f

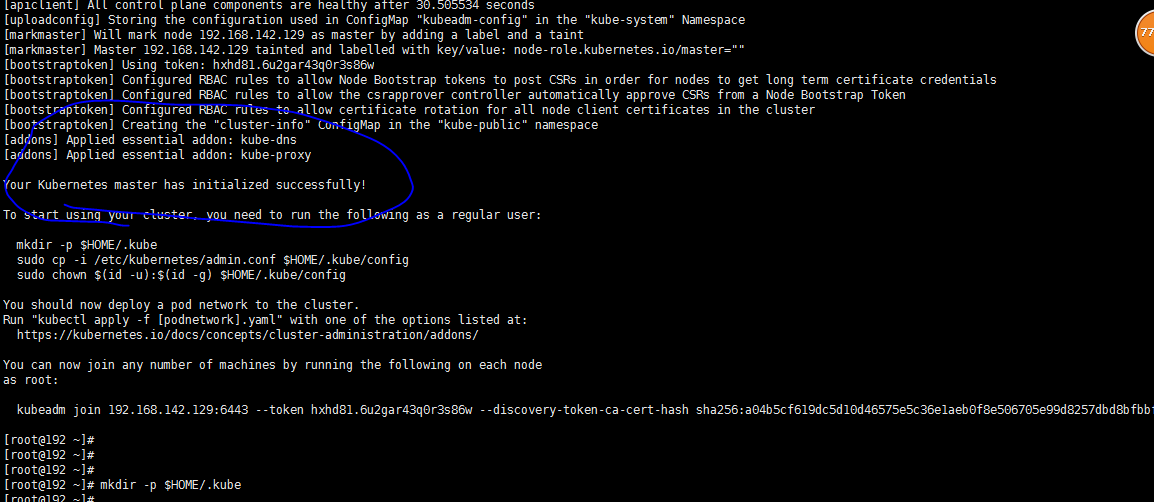

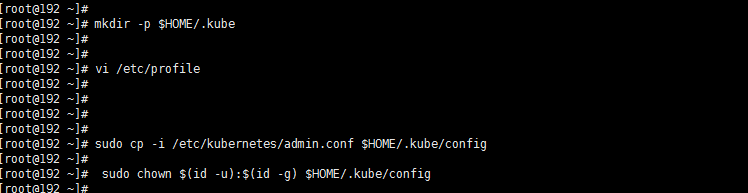

记下join的命令,后续node节点加入的时候要用到执行提示的命令,保存kubeconfig

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

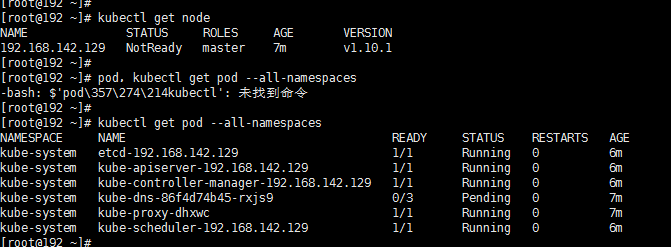

此时执行kubectl get node 已经可以看到master节点,notready是因为还未部署网络插件

[root@master1 kubernetes1.]# kubectl get node

NAME STATUS ROLES AGE VERSION

master1 NotReady master 3m v1.10.1

查看所有的pod,kubectl get pod --all-namespaces

kubedns也依赖于容器网络,此时pending是正常的

[root@master1 kubernetes1.]# kubectl get pod --all-namespaces

NAMESPACE NAME READY STATUS RESTARTS AGE

kube-system etcd-master1 / Running 3m

kube-system kube-apiserver-master1 / Running 3m

kube-system kube-controller-manager-master1 / Running 3m

kube-system kube-dns-86f4d74b45-5nrb5 / Pending 4m

kube-system kube-proxy-ktxmb / Running 4m

kube-system kube-scheduler-master1 / Running 3m

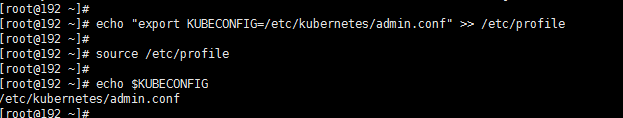

配置KUBECONFIG变量

echo "export KUBECONFIG=/etc/kubernetes/admin.conf" >> /etc/profile

source /etc/profile

echo $KUBECONFIG #应该返回/etc/kubernetes/admin.conf

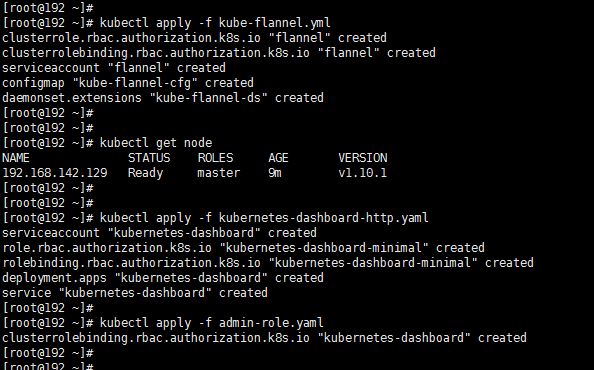

6. 部署flannel网络

k8s支持多种网络方案,flannel,calico,openvswitch

此处选择flannel。 在熟悉了k8s部署后,可以尝试其他网络方案,我另外一篇1.9部署中有介绍flannel和calico的方案,以及切换时需要的动作。

kubectl apply -f kube-flannel.yml

网络就绪后,节点的状态会变为ready[root@master1 kubernetes1.]# kubectl get node

NAME STATUS ROLES AGE VERSION

master1 Ready master 18m v1.10.1

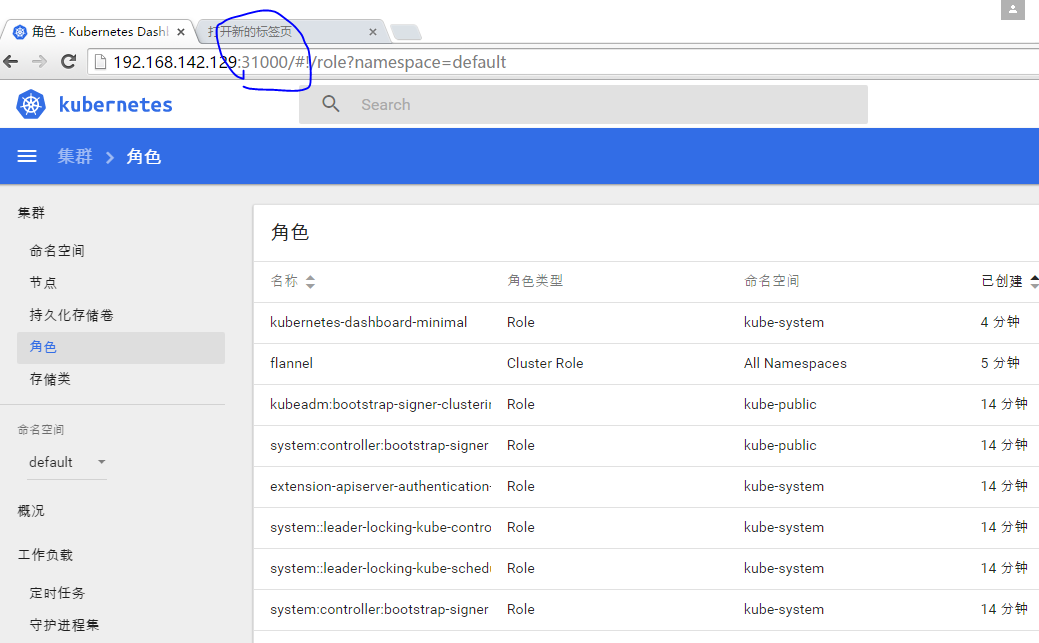

7. 部署k8s ui界面,dashboard

dashboard是官方的k8s 管理界面,可以查看应用信息及发布应用。dashboard的语言是根据浏览器的语言自己识别的

官方默认的dashboard为https方式,如果用chrome访问会拒绝。本次部署做了修改,方便使用,使用了http方式,用chrome访问正常。

一共需要导入3个yaml文件

kubectl apply -f kubernetes-dashboard-http.yaml

kubectl apply -f admin-role.yaml

kubectl apply -f kubernetes-dashboard-admin.rbac.yaml

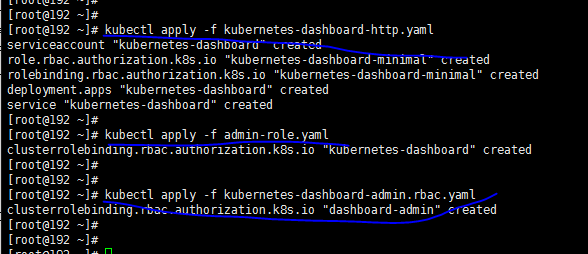

[root@master1 kubernetes1.]# kubectl apply -f kubernetes-dashboard-http.yaml

serviceaccount "kubernetes-dashboard" created

role.rbac.authorization.k8s.io "kubernetes-dashboard-minimal" created

rolebinding.rbac.authorization.k8s.io "kubernetes-dashboard-minimal" created

deployment.apps "kubernetes-dashboard" created

service "kubernetes-dashboard" created

[root@master1 kubernetes1.]# kubectl apply -f admin-role.yaml

clusterrolebinding.rbac.authorization.k8s.io "kubernetes-dashboard" created

[root@master1 kubernetes1.]# kubectl apply -f kubernetes-dashboard-admin.rbac.yaml

clusterrolebinding.rbac.authorization.k8s.io "dashboard-admin" created

创建完成后,通过 http://任意节点的IP:31000即可访问ui

8. FAQ

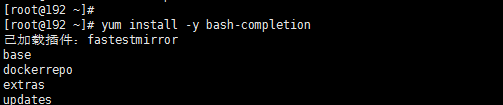

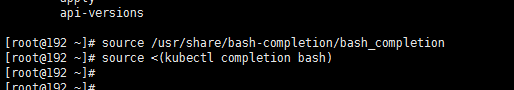

8.1 kubectl 命令补全

# yum install -y bash-completion # source /usr/share/bash-completion/bash_completion

# source <(kubectl completion bash)

就可以完成补全了

二、集群配置

步骤基本相同:请参考centos7.3 kubernetes/k8s 1.10 离线安装 (推荐离线安装)

参考文章如下:

1、 安装部署 Kubernetes 集群

参考资料:

- Using kubeadm to Create a Cluster(推荐)

- Kubernetes on bare-metal in 10 minutes

- 使用 Kubeadm 安装 Kubernetes

- 和我一步步部署 kubernetes 集群(推荐)

- Traefik-kubernetes 初试(推荐)

- Kubernetes 集群 Dashboard 插件安装

- Kubernetes Dashboard 集成 Heapster

- 升级 Dashboard

- 安装 dashboard 插件

- 安装 Kubernetes Dashboard

- 安装 heapster 插件

2、centos7.3 kubernetes/k8s 1.10 离线安装 (推荐离线安装)

k8s安装部署过程个人总结及参考文章的更多相关文章

- SCCM 2012 R2安装部署过程和问题(一)

在进行Windows Server 2012 R2虚拟化测试前,由于需要安装,部署和管理很多的服务器,自然会想到该如何提高效率和有效的管理.在Windows Server 2008的时代微软已经提供称 ...

- 免费开源的客服系统 Linux 服务器环境安装部署过程

最近因为项目需要,要找一款在线客服系统集成在 APP 中使用,而且涉及到生意开单,客服系统必须稳定可靠.另外甲方要求,必须支持 Linux 服务器环境. 我们以 Ubuntu 18.04 为例把安装部 ...

- SCCM 2012 R2安装部署过程和问题(三)

上篇 SCCM 2012 R2安装部署过程和问题(二) 个人认为对于使用SCCM 2012的最重要的经验是耐心. SCCM采用分布式部署的架构,不同的站点角色可以部署在不同的服务器上,站点角色之间的通 ...

- SCCM 2012 R2安装部署过程和问题(二)

上篇:SCCM 2012 R2安装部署过程和问题(一) 在上篇我们已经完成了SCCM 2012 R2安装前的准备,其中有许多细节,关于数据库的准备和权限的设置是需要特别注意的.那么接下来我们开始安装S ...

- k8s 安装 prometheus 过程记录

开始以为只要安装 prometheus-operator 就行了. git clone https://github.com/coreos/prometheus-operator.git cd pro ...

- 淘宝分布式 key/value 存储引擎Tair安装部署过程及Javaclient測试一例

文件夹 1. 简单介绍 2. 安装步骤及问题小记 3. 部署配置 4. Javaclient測试 5. 參考资料 声明 1. 以下的安装部署基于Linux系统环境:centos 6(64位),其他Li ...

- rocketmq安装部署过程(4.0.0版本)

准备工作 3个虚拟机节点的构成如下 : 安装步骤 操作过程 1.安装包已经上传至其中1个节点. 2.解压缩安装包 命令:unzip rocketmq-all-4.0.0-incubating-bin- ...

- VS2013安装部署过程详解

注意:缺少安装部署的小伙伴,看上一篇有详细介绍 程序在“Release”平台下编译运行没有错误 第一步:“新建”------“项目”------“其他项目类型”------“安装部署”------“I ...

- 记一次Hadoop安装部署过程

实验名称:Hadoop安装部署 一.实验环境: 虚拟机数量:3个 (1个master,2个slave:slave01,slave02) 主节点master信息: 操作系统:CentOS7.5 软件包位 ...

随机推荐

- 使用ceph-deploy进行ceph安装

ceph安装包介绍: 1.ceph-deploy: ceph的部署软件,通过该软件可以简便部署,这个软件并非整个ceph集群系统中必须的 2.ceph: ceph整个服务集群中的每个节点必须的软件.提 ...

- Vue页面加载时,触发某个函数的方法

需要在加载页面的时候调用生成验证码的click事件函数 解决方法如下,利用Vue中的mounted mounted:function(){ this.createcode();//需要触发的函数 } ...

- 高阶篇:4.1.2.1)产品总成级别的QFDII

本章目的:介绍产品总成级别的QFDII编写方法. 1.前言 这章接QFDI和QFDII总章节. 产品总成级别的QFDII,其实就是将QFDI所得到的设计要求,接着分配给产品的第一装配层级的零部件中. ...

- BT网站-IBMID.COM

最近把網站改版了,主要是更改了搜索引擎. 大家可以訪問 什么是磁力链接(IBMID.COM)(Magnet URI)? 简单的说:类似下面这样以“magnet:?”开头的字符串,就是一条“磁力链接” ...

- django 创建QueryDict类型报错

报错信息:django.core.exceptions.ImproperlyConfigured: Requested setting LOGGING_CONFIG, but settings are ...

- MVC 和 MVR 的区别分析

MVC模式中,可以将路由绑定到控制器上.MVR是一对一的.路由和控制器是一个东西. 优点是需要被迫处理路由.缺点是不能在控制器被绑定到路由之前复用控制器. [1] node.js - Differen ...

- CentOS&.NET Core初试系列

目的 对前段时间学习.NET Core的知识进行一次入门篇的总结,希望加深印象同时帮助刚学同学少走一些坑. 目录 CentOS的安装和网卡的配置 安装.NET Core SDK和发布网站 Nginx的 ...

- MySQL保留字冲突 关键词:保留字, 关键字

在Mysql中,当表名或字段名乃至数据库名和保留字冲突时,在sql语句里可以用撇号`(Tab键上方的按键)括起来. 注意,只有保留字需要``括起来,非保留字的关键字不需要. MySQL 8.0 官方文 ...

- 换个角度看Salesforce之基础配置学习笔记(一)

1. Salesforce.com与force.com的关系: Salesforce.com is build on the force.com platform seamlessly.That is ...

- Linux下日志文件监控系统Logwatch的使用记录

Linux下日志文件监控系统Logwatch的使用记录 原文:http://www.cnblogs.com/kevingrace/p/6519504.html 在维护Linux服务器时,经常需要查看系 ...