Gluon sgd

from mxnet import nd,autograd,init,gluon

from mxnet.gluon import data as gdata,loss as gloss,nn num_inputs = 2

num_examples = 1000

true_w = [2,-3.4]

true_b = 4.2 features = nd.random.normal(scale=1,shape=(num_examples,num_inputs))

labels = true_w[0]*features[:,0] + true_w[1]*features[:,1] + true_b

labels += nd.random.normal(scale=0.01,shape=labels.shape) # 造小批量数据集

dataset = gdata.ArrayDataset(features,labels)

batch_size = 10

data_iter = gdata.DataLoader(dataset,batch_size,shuffle=True) # 定义网络

net = nn.Sequential()

net.add(nn.Dense(1)) net.initialize(init.Normal(sigma=0)) # 损失函数

loss = gloss.L2Loss() # 优化算法

trainer = gluon.Trainer(net.collect_params(),'sgd',{'learning_rate':0.01}) num_epochs = 3

for epoch in range(1, num_epochs + 1):

for X, y in data_iter:

print(X)

print(y)

with autograd.record():

l = loss(net(X), y)

print(l)

l.backward()

trainer.step(batch_size)

l = loss(net(features), labels)

print('epoch %d, loss: %f' % (epoch, l.mean().asnumpy()))

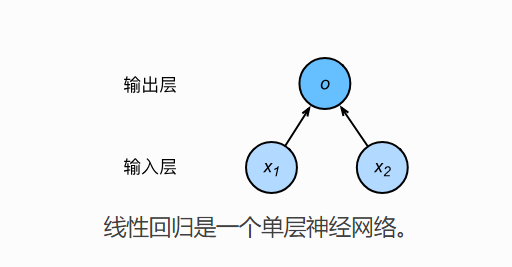

从最简单的线性回归来说,小批量随机梯度下降的时候,X,y 从迭代器中取出,也是bach_size大小的数据集,那么网络的计算,同样也是小批量的。

即代码 l = loss(net(X),y) 包含了,小批量数据集,每一个数据丢到网络中,计算出返回值以后,和真实值得损失。

Gluon sgd的更多相关文章

- 使用MxNet新接口Gluon提供的预训练模型进行微调

1. 导入各种包 from mxnet import gluon import mxnet as mx from mxnet.gluon import nn from mxnet import nda ...

- MXNet的新接口Gluon

为什么要开发Gluon的接口 在MXNet中我们可以通过Sybmol模块来定义神经网络,并组通过Module模块提供的一些上层API来简化整个训练过程.那MXNet为什么还要重新开发一套Python的 ...

- win10 + gluon + GPU

1. 下载教程 可以用浏览器下载zip格式并解压,在解压目录文件资源管理器的地址栏输入cmd进入命令行模式. 也可以 git pull https://github.com/mli/gluon-tut ...

- 机器学习笔记(6):多类逻辑回归-使用gluon

上一篇演示了纯手动添加隐藏层,这次使用gluon让代码更精减,代码来自:https://zh.gluon.ai/chapter_supervised-learning/mlp-gluon.html f ...

- 机器学习笔记(2):线性回归-使用gluon

代码来自:https://zh.gluon.ai/chapter_supervised-learning/linear-regression-gluon.html from mxnet import ...

- MXNET:权重衰减-gluon实现

构建数据集 # -*- coding: utf-8 -*- from mxnet import init from mxnet import ndarray as nd from mxnet.gluo ...

- dropout——gluon

https://blog.csdn.net/lizzy05/article/details/80162060 from mxnet import nd def dropout(X, drop_prob ...

- mxnet(gluon) 实现DQN简单小例子

参考文献 莫凡系列课程视频 增强学习入门之Q-Learning 关于增强学习的基本知识可以参考第二个链接,讲的挺有意思的.DQN的东西可以看第一个链接相关视频.课程中实现了Tensorflow和pyt ...

- Gluon 实现 dropout 丢弃法

多层感知机中: hi 以 p 的概率被丢弃,以 1-p 的概率被拉伸,除以 1 - p import mxnet as mx import sys import os import time imp ...

随机推荐

- 获取IP相关信息和文件上传

获取IP相关信息 要获取用户访问者的IP地址相关信息,可以利用依赖注入,获取IHttpConnectionFeature的实例,从该实例上可以获取IP地址的相关信息,实例如下: var connect ...

- Java并发编程之volatile关键字解析

一内存模型的相关概念 二并发编程中的三个概念 三Java内存模型 四深入剖析volatile关键字 五使用volatile关键字的场景 volatile这个关键字可能很多朋友都听说过,或许也都用过.在 ...

- [转]OLAP的12条准则

OLAP的12条准则 Multidimensional conceptual view OLAP模型必须提供多维概念视图 User-analysts would view an enterprise ...

- 告别Flash——那些年我们追过的FusionCharts

随着FusionCharts最终放弃Flash这块蛋糕,不.或者已经不能叫做蛋糕了,现在Flash图表控件就只剩下AnyChart这一个独苗了,到底Flash还能走多远?这是Flash的末路吗? 众说 ...

- 初探Spring源码之Spring Bean的生命周期

写在前面的话: 学无止境,写博客纯粹是一种乐趣而已,把自己理解的东西分享出去,不意味全是对的,欢迎指正! Spring 容器初始化过程做了什么? AnnotationConfigApplication ...

- 模拟Springboot一:(零xml配置搭建SSM项目)

在spring官网文档中无论是spring的基础文档,还是spring-mvc文档都推荐我们使用javaconfig的方式来搭建项目 间接说明 (优点:javaconfig配置>xml配置) 其 ...

- web前端开发需要具备的技能

web前端开发需要具备以下7种技能: 1.页面标记(HTML) HTML页面固定,标签不多,相对来说学起来比较容易.编写HTML代码需遵循HTML代码规范(http://www.cnblogs.com ...

- 1-3 Sass 语法、编译、调试

Sass 语法格式 这里说的 Sass 语法是 Sass 的最初语法格式,他是通过 tab 键控制缩进的一种语法规则,而且这种缩进要求非常严格.另外其不带有任何的分号和大括号.常常把这种格式称为 Sa ...

- Java中线程的实现

在Java中要想实现多线程代码有两种方法,一种是继承 Thread 类,另一种就是实现 Runnable 接口 一.继承 Thread 类 Thread 类是在 java.lang 包中定义的,一个类 ...

- vs2017源文件创建代码自动版权声明注释

原来在vs2015下用的挺好,顺便移植到2017下. 用文本打开,在其头部加上 “C:\Program Files (x86)\Microsoft Visual Studio\2017\Enterpr ...