python 爬取豆瓣的美剧

pc版大概有500条记录,mobile大概是50部,只有热门的,所以少一点

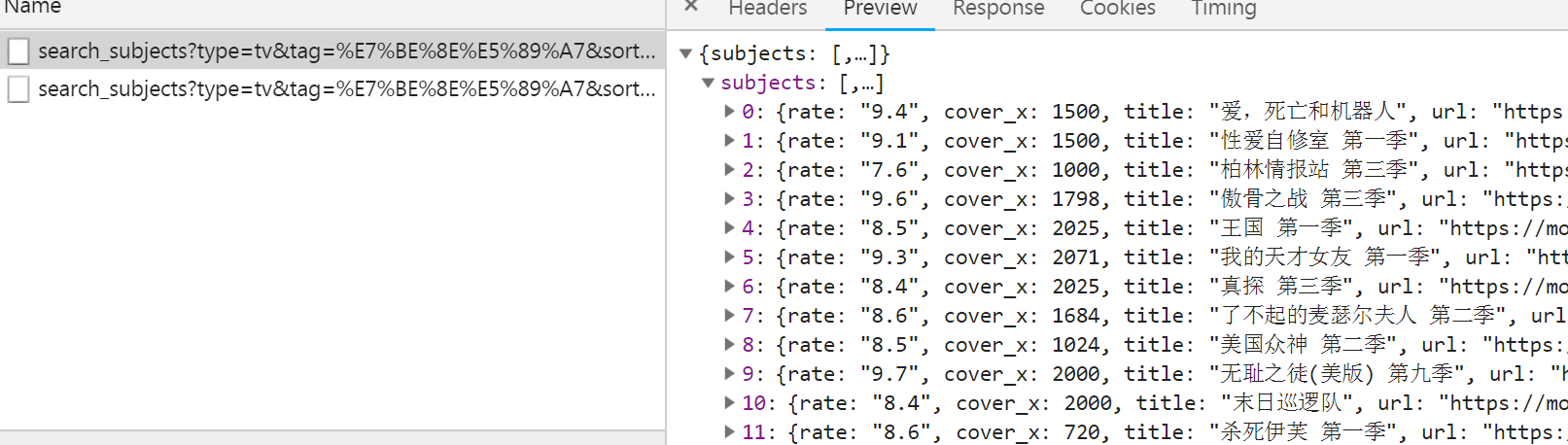

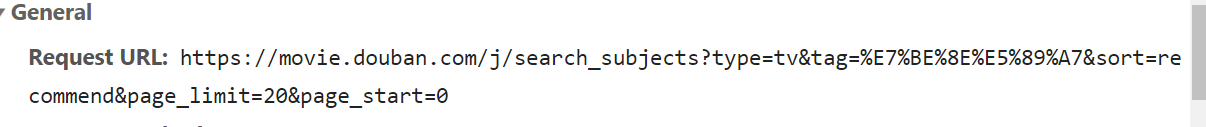

url构造很简单,主要参数就是page_limit与page_start,每翻一页,start+=20即可,tag是"美剧"编码后的结果,直接带着也可以,用unquote解码也可以,注意headers中一定要带上refer

import json

import requests

import math

import os

import shutil

from pprint import pprint

from urllib import parse class DoubanSpliderPC:

def __init__(self):

self.url = parse.unquote(

"https://movie.douban.com/j/search_subjects?type=tv&tag=%E7%BE%8E%E5%89%A7&sort=recommend&page_limit=20&page_start={}") self.headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36",

"Referer": "https://movie.douban.com/tv/"

}

self.file_dir = "./douban_american_pc.txt" def parse_url(self):

number = 0

while True:

url = self.url.format(number)

print(url)

response = requests.get(url, headers=self.headers)

response_dict = json.loads(response.content.decode())

subjects_list = response_dict["subjects"]

with open(self.file_dir, "a", encoding="utf-8") as file:

for subject in subjects_list:

file.write(json.dumps(subject, ensure_ascii=False))

file.write("\r\n")

if len(subjects_list) < 20:

break

number += 20 def run(self):

# 删除之前保存的数据

if os.path.exists(self.file_dir):

os.remove(self.file_dir)

print("文件已清空")

self.parse_url() def main():

splider = DoubanSpliderPC()

splider.run() if __name__ == '__main__':

main()

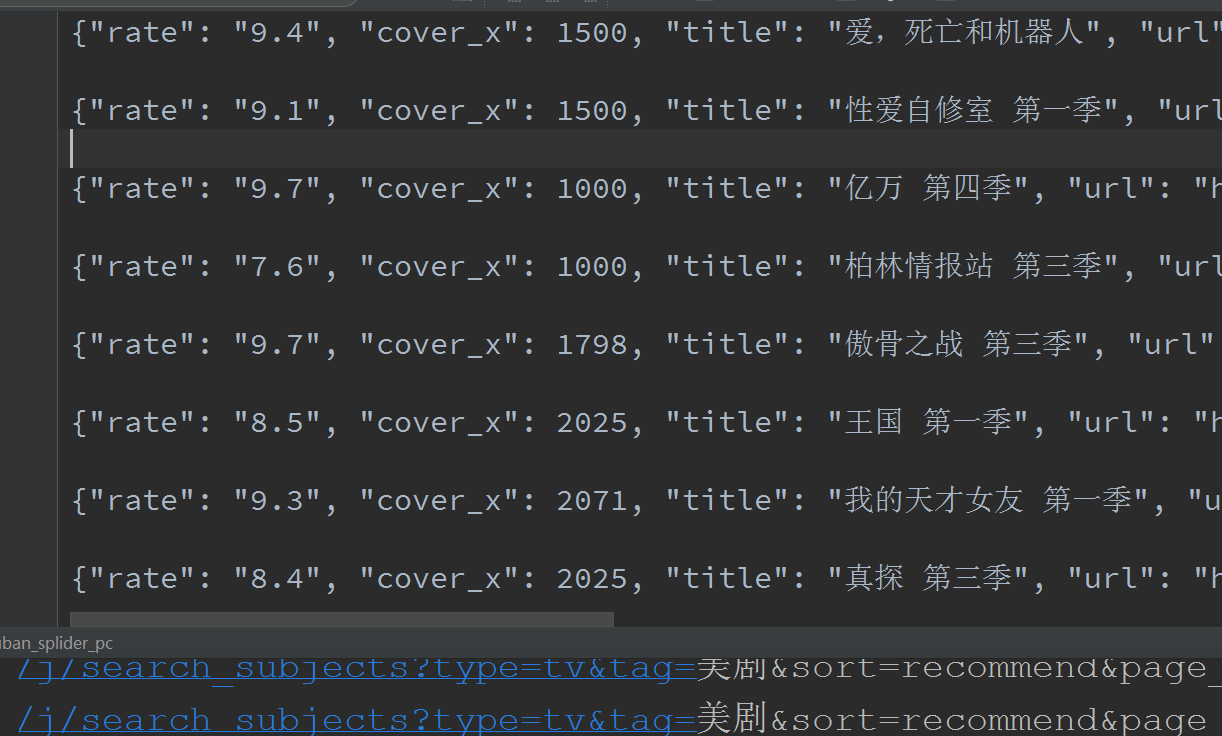

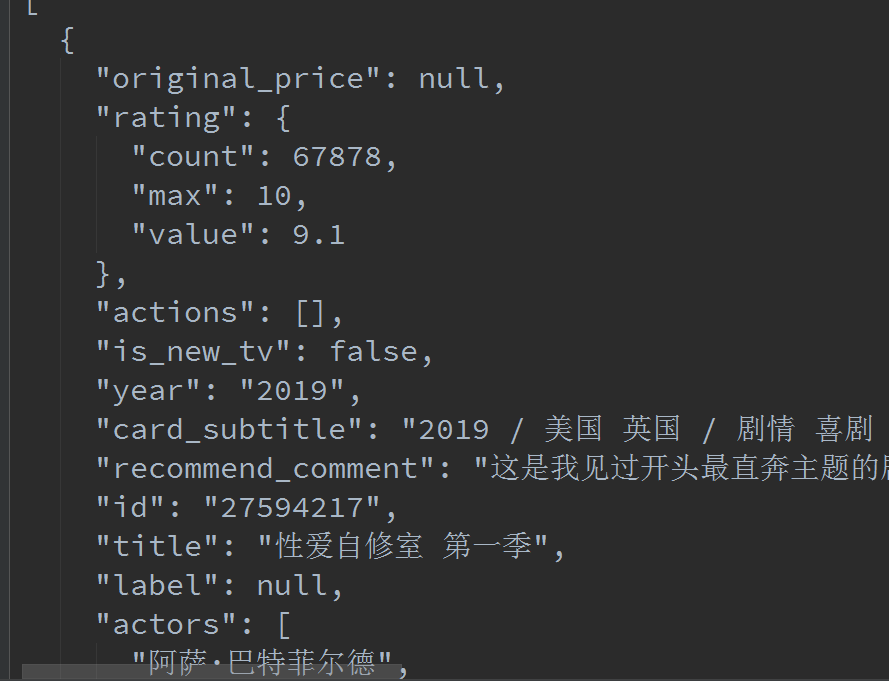

moblie类似,不过抓包的时候找那个Item就可以了

import json

import requests

import math

import os

import shutil

from pprint import pprint # 爬取豆瓣的美剧页面(手机版只有50条)

class DouBanSpliderMobile:

pageCount = 18

total = None def __init__(self):

self.first_url = "https://m.douban.com/rexxar/api/v2/subject_collection/tv_american/items?os=ios&for_mobile=1&start={}&count=18&loc_id=108288&_=1552995446961"

self.headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36",

"Referer": "https://m.douban.com/tv/american"

}

self.file_dir = "./douban_american_mobile.txt" def get_url_list(self):

url_list = []

for i in range(math.ceil(DouBanSpliderMobile.total / DouBanSpliderMobile.pageCount)):

url = self.first_url.format(i * 18)

url_list.append(url)

return url_list def parse_url(self, url):

response = requests.get(url, headers=self.headers)

response_dict = json.loads(response.content.decode())

DouBanSpliderMobile.total = int(response_dict["total"])

with open(self.file_dir, "a", encoding="utf-8") as file:

json.dump(response_dict["subject_collection_items"], file, ensure_ascii=False, indent=2) def run(self):

# 解析第一个url,获取total

self.parse_url(self.first_url.format(0))

url_list = self.get_url_list() # 删除之前保存的文件

if os.path.exists(self.file_dir):

os.remove(self.file_dir) for url in url_list:

self.parse_url(url) def main():

douban_splider = DouBanSpliderMobile()

douban_splider.run() if __name__ == '__main__':

main()

python 爬取豆瓣的美剧的更多相关文章

- Python爬取豆瓣指定书籍的短评

Python爬取豆瓣指定书籍的短评 #!/usr/bin/python # coding=utf-8 import re import sys import time import random im ...

- 利用Python爬取豆瓣电影

目标:使用Python爬取豆瓣电影并保存MongoDB数据库中 我们先来看一下通过浏览器的方式来筛选某些特定的电影: 我们把URL来复制出来分析分析: https://movie.douban.com ...

- Python爬取豆瓣《复仇者联盟3》评论并生成乖萌的格鲁特

代码地址如下:http://www.demodashi.com/demo/13257.html 1. 需求说明 本项目基于Python爬虫,爬取豆瓣电影上关于复仇者联盟3的所有影评,并保存至本地文件. ...

- Python爬取豆瓣电影top

Python爬取豆瓣电影top250 下面以四种方法去解析数据,前面三种以插件库来解析,第四种以正则表达式去解析. xpath pyquery beaufifulsoup re 爬取信息:名称 评分 ...

- python爬取豆瓣电影信息数据

题外话+ 大家好啊,最近自己在做一个属于自己的博客网站(准备辞职回家养老了,明年再战)在家里 琐事也很多, 加上自己 一回到家就懒了(主要是家里冷啊! 广东十几度,老家几度,躲在被窝瑟瑟发抖,) 由于 ...

- Python爬取豆瓣音乐存储MongoDB数据库(Python爬虫实战1)

1. 爬虫设计的技术 1)数据获取,通过http获取网站的数据,如urllib,urllib2,requests等模块: 2)数据提取,将web站点所获取的数据进行处理,获取所需要的数据,常使用的技 ...

- 零基础爬虫----python爬取豆瓣电影top250的信息(转)

今天利用xpath写了一个小爬虫,比较适合一些爬虫新手来学习.话不多说,开始今天的正题,我会利用一个案例来介绍下xpath如何对网页进行解析的,以及如何对信息进行提取的. python环境:pytho ...

- python爬取豆瓣小组700+话题加回复啦啦啦python open file with a variable name

需求:爬取豆瓣小组所有话题(话题title,内容,作者,发布时间),及回复(最佳回复,普通回复,回复_回复,翻页回复,0回复) 解决:1. 先爬取小组下,所有的主题链接,通过定位nextpage翻页获 ...

- python 爬取豆瓣电影评论,并进行词云展示及出现的问题解决办法

本文旨在提供爬取豆瓣电影<我不是药神>评论和词云展示的代码样例 1.分析URL 2.爬取前10页评论 3.进行词云展示 1.分析URL 我不是药神 短评 第一页url https://mo ...

随机推荐

- R语言-方差分析

方差分析指的是不同变量之间互相影响从而导致结果的变化 1.单因素方差分析: 案例:50名患者接受降低胆固醇治疗的药物,其中三种治疗条件使用药物相同(20mg一天一次,10mg一天两次,5mg一天四次) ...

- 1.2 Use Cases中 Commit Log官网剖析(博主推荐)

不多说,直接上干货! 一切来源于官网 http://kafka.apache.org/documentation/ Commit Log 提交日志 Kafka can serve as a kind ...

- 十分钟上手-搭建vue开发环境(新手教程)

想写一些关于vue的文章已经很久了,因为这个框架已经火了很久,在公司里用的框架都比较老旧,但怎么也得跟上前端发展变化的潮流,这不,开始使用vue开发项目了,一遍开发一边踩坑中,今天要记录的是五分钟搭建 ...

- JSP学习 —— 开篇:JSP,servlet容器,Tomcat,servlet容器之间的关系

JSP(JAVA SERVER PAGE)的缩写,其本身就是servlet的简化,是一种动态网页标准,其特点是在HTML代码中嵌入JAVA代码,JSP标签或用户标签来生成网页.至于它为什么会出现,主要 ...

- [React] Theme your application with styled-components and "ThemeProvider"

In this styled-components lesson, we set a "primary color" within a UI "theme" o ...

- Android 监听电量的状态

监控手机电量的变化和充电状态 在BatteryManager中有一个粘性广播,不需要BroadcastReceiver作为接收器,在注册时将传入null IntentFilter filter = n ...

- Java Scheduler ScheduledExecutorService ScheduledThreadPoolExecutor Example(ScheduledThreadPoolExecutor例子——了解如何创建一个周期任务)

Welcome to the Java Scheduler Example. Today we will look into ScheduledExecutorService and it's imp ...

- Altium Designer敷铜的规则设定

InPolygon 这个词是铺铜对其他网络的设置,铺铜要离其他网络远点,因为腐蚀不干净会对 电路板有影响... 问题一:: 如下图所示,现在想让敷铜与板子边界也就是keepoutlayer的间距小一点 ...

- stm32的timer

- 【例题5-1 UVA 10474 】Where is the Marble?

[链接] 我是链接,点我呀:) [题意] 在这里输入题意 [题解] 排序 用lower_bound找就可以了. ->lower_bound,如果里面所有的数字都比x小,那么它的返回值会越界! [ ...