Hive学习之七《 Sqoop import 从关系数据库抽取到HDFS》

一、什么是sqoop

Sqoop是一款开源的工具,主要用于在Hadoop(Hive)与传统的数据库(mysql、postgresql...)间进行数据的传递,可以将一个关系型数据库(例如 :MySQL ,Oracle ,Postgres等)中的数据导进到Hadoop的HDFS中,也可以将HDFS的数据导进到关系型数据库中。

二、sqoop的特点

Sqoop中一大亮点就是可以通过hadoop的mapreduce把数据从关系型数据库中导入数据到HDFS。

三、Sqoop import 命令

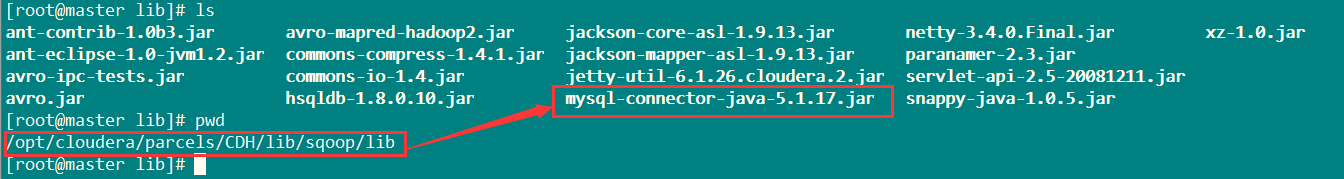

将Mysql的jdbc驱动放在/opt/cloudera/parcels/CDH/lib/sqoop/lib目录下。

如下图:

参考学习网址:

http://archive.cloudera.com/cdh5/cdh/5/sqoop-1.4.4-cdh5.1.0/SqoopUserGuide.html

命令详解:

1、基本语法

$ sqoop import (generic-args) (import-args)$ sqoop-import (generic-args) (import-args)

2、基本命令

查看网址:

http://archive.cloudera.com/cdh5/cdh/5/sqoop-1.4.4-cdh5.1.0/SqoopUserGuide.html

中的sqoop import的 Import control arguments

3、案例

方式一:

将表rpt_sale_daily中数据导入到HDFS上。

目标目录为:sqoop/rpt_sale_daily。

sqoop import --connect jdbc:mysql://master:3306/test \

--username root --password 123456 --table rpt_sale_daily \

--columns "dateid,huodong,pv,uv" \

--where "dateid='2015-08-28'" \

--target-dir sqoop/rpt_sale_daily \

-m 1

如果提示 sqoop/rpt_sale_daily 目录已经存在,执行:

hadoop fs -rmr sqoop/rpt_sale_daily

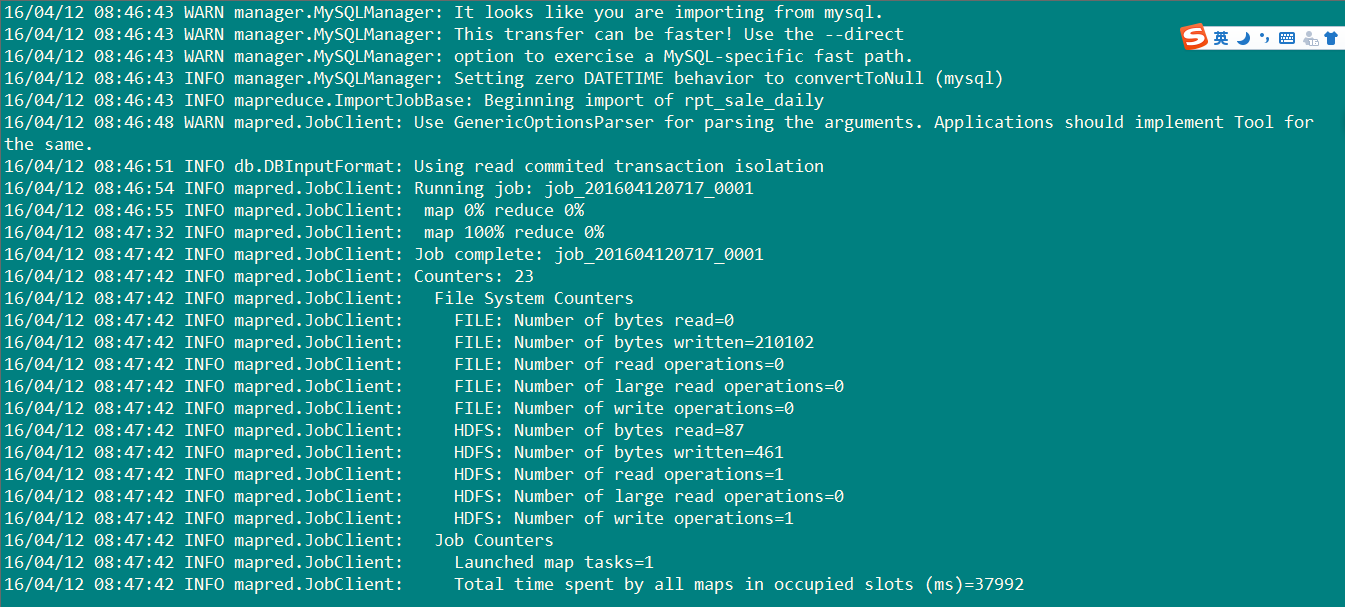

执行结果:如下图

20条数据成功导入,开始检测吧亲。

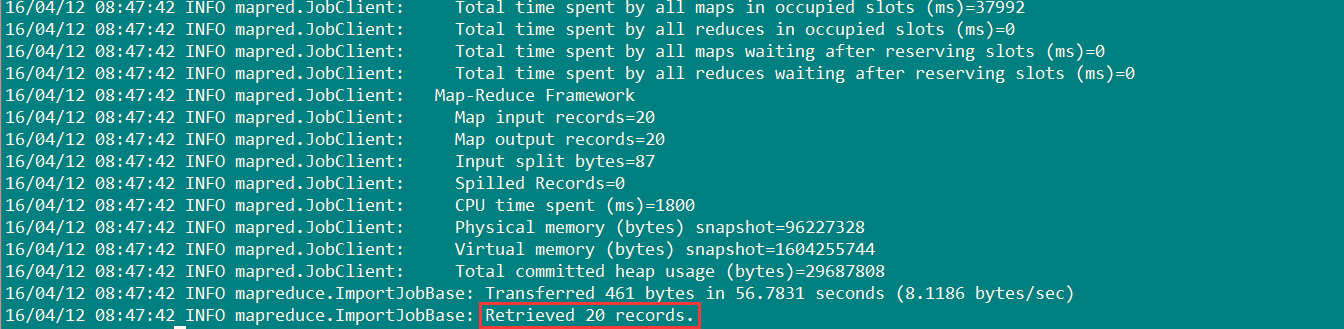

执行代码:

hadoop fs -cat sqoop/rpt_sale_daily/part-m-00000

数据如下图:

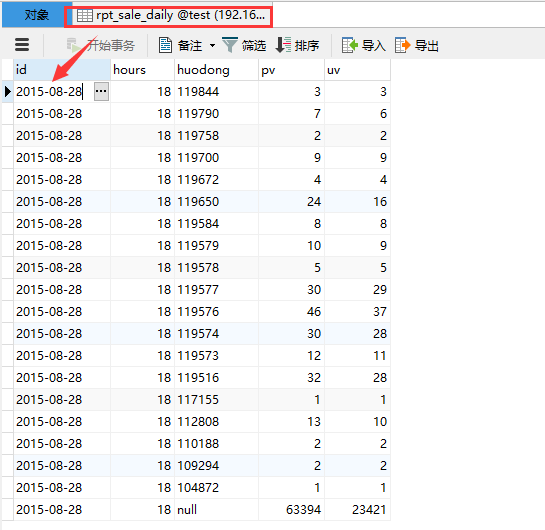

关系数据库表rpt_sale_daily里面的数据如下:

对比,数据相同,成功导入。

方式二:

通过opt文件的方式传送:

新建test.opt文件:

import

--connect

jdbc:mysql://192.168.0.115:3306/test

--username

root

--password --table

rpt_sale_daily

--columns

"id,huodong,pvv,uvv"

--where

"id='2015-08-28'"

--target-dir

sqoop/rpt_sale_daily

-m

执行指令:

sqoop options-file test.opt

执行过程和结果和方式一一样。

Hive学习之七《 Sqoop import 从关系数据库抽取到HDFS》的更多相关文章

- 【Hive学习之七】Hive 运行方式&权限管理

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk8 hadoop-3.1.1 apache-hive-3.1.1 ...

- sqoop从oracle数据库抽取数据,导入到hive

环境: hadoop-2.7.5 sqoop-1.4.7 zookeeper-3.4.10 hive-2.3.3 (使用mysql配置元数据库) jdk1.8.0_151 oracle 11.2.0. ...

- (MySQL里的数据)通过Sqoop Import Hive 里 和 通过Sqoop Export Hive 里的数据到(MySQL)

Sqoop 可以与Hive系统结合,实现数据的导入和导出,用户需要在 sqoop-env.sh 中添加HIVE_HOME的环境变量. 具体,见我的如下博客: hadoop2.6.0(单节点)下Sqoo ...

- sqoop import mysql to hive table:GC overhead limit exceeded

1. Scenario description when I use sqoop to import mysql table into hive, I got the following error: ...

- hive学习笔记之七:内置函数

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- hive学习笔记之八:Sqoop

欢迎访问我的GitHub https://github.com/zq2599/blog_demos 内容:所有原创文章分类汇总及配套源码,涉及Java.Docker.Kubernetes.DevOPS ...

- Hive学习详细版

一.概述 1.Hadoop的开发问题 只能用java语言开发,存在语言门槛 需要对Hadoop底层原理,api比较了解才能做开发 开发调试比较麻烦 2.什么是Hive Hive是基于Hadoop的一个 ...

- sqoop命令,mysql导入到hdfs、hbase、hive

1.测试MySQL连接 bin/sqoop list-databases --connect jdbc:mysql://192.168.1.187:3306/trade_dev --username ...

- sqoop import 和export的问题

sqoop import DB 2 hive(hdfs)是采用JDBC的过程,与传统hive区别在与多走了thrift server接口(稳定性待学习现在还比较模糊没做过大数据量测试),而export ...

随机推荐

- php socket 通信

Socket扩展是基于流行的BSD sockets,实现了和socket通讯功能的底层接口,它可以和客户端一样当做一个socket服务器. 想了解更通用的客户端socket接口,请看 stream_s ...

- wpa_cli和wpa_supplicant使用,配置无线AP名和密码,静态ip地址

配置静态ip方法分享:通过串口命令行输入如下命令: 1. 添加无线网络接入点(AP) 及其 密码:# wpa_cli -p /data/misc/wpa_supplicantwpa_cli v0.5. ...

- HDOJ(HDU) 2115 I Love This Game(排序排序、、、)

Problem Description Do you like playing basketball ? If you are , you may know the NBA Skills Challe ...

- [已解决问题] An error occurred while automatically activating bundle com.android.ide.eclipse.adt

可以参见stackoverflow的解决方案:http://stackoverflow.com/questions/16974349/an-error-occurred-while-automatic ...

- zoj 1760 floyd构图+Dinic最大流

题目链接:http://acm.zju.edu.cn/onlinejudge/showProblem.do?problemId=1760 #include <cstdio> #includ ...

- zoj 3462

#include <cstdio> #include <cmath> #include <algorithm> #include <iostream> ...

- Bash 字符串处理命令

字符串长度 str="abc" echo ${#str} 查找子串的位置 str="abc" str1=`expr index $str "a&quo ...

- Fluent-EDEM耦合计算颗粒流动

虽然说Fluent提供了很多方法用于处理颗粒在流体中的运动行为,然而这些方法都有其各自的适用性.DPM适用于稀薄颗粒的情况,欧拉模型.Mixture模型及DDPM模型虽然可以考虑稠密颗粒相,但并不能考 ...

- Delphi图像处理 -- RGB与HSV转换

阅读提示: <Delphi图像处理>系列以效率为侧重点,一般代码为PASCAL,核心代码采用BASM. <C++图像处理>系列以代码清晰,可读性为主,全部使用C ...

- Sql Server 2005 开发版亲測可用下载地址

sqlserver2005开发版下载地址:http://222.132.81.146/rj/cs_sql_2005_dev_all_dvd.rar建议使用迅雷下载. sql server 2005 开 ...