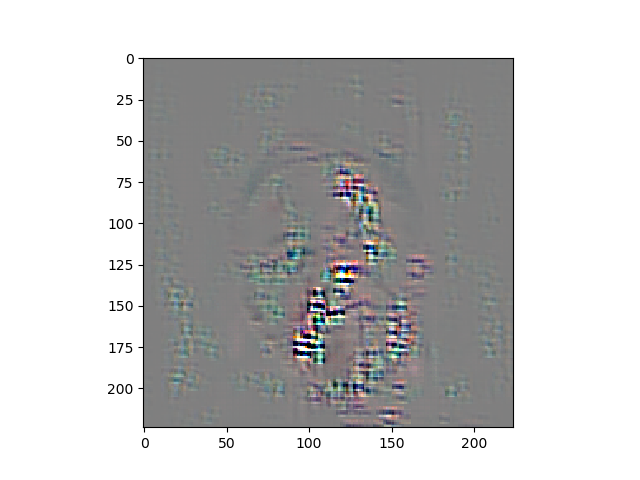

[NN] Guided Backpropgation 可视化

Pytorch Guided Backpropgation

Intro

guided backpropgation通过修改RELU的梯度反传,使得小于0的部分不反传,只传播大于0的部分,这样到第一个conv层的时候得到的梯度就是对后面relu激活起作用的梯度,这时候我们对这些梯度进行可视化,得到的就是对网络起作用的区域。(实际上可视化的是梯度)。

简单记一下。用到hook的神经网络可视化方法。

code

import torch

import torch.nn as nn

from torchvision import transforms,models

import re

from models.densenet import densenet121

from PIL import Image

import numpy as np

import matplotlib.pyplot as plt

class Guided_Prop():

def __init__(self,model):

self.model = model

self.model.eval()

self.out_img = None

self.activation_maps = []

def register_hooks(self):

def register_first_layer_hook(module,grad_in,grad_out):

self.out_img = grad_in[0] #(b,c,h,w) -> (c,h,w)

def forward_hook_fn(module,input_feature,output_feature):

self.activation_maps.append(output_feature)

def backward_hook_fn(module,grad_in,grad_out):

grad = self.activation_maps.pop()

grad[grad > 0] = 1

g_positive = torch.clamp(grad_out[0],min = 0.)

result_grad = grad * g_positive

return (result_grad,)

modules = list(self.model.features.named_children())

for name,module in modules:

if isinstance(module,nn.ReLU):

module.register_forward_hook(forward_hook_fn)

module.register_backward_hook(backward_hook_fn)

first_layer = modules[0][1]

first_layer.register_backward_hook(register_first_layer_hook)

def visualize(self,input_image):

softmax = nn.Softmax(dim = 1)

idx_tensor = torch.tensor([float(i) for i in range(61)])

self.register_hooks()

self.model.zero_grad()

out = self.model(input_image) # [[b,n],[b,n],[b,n]]

yaw = softmax(out[0])

yaw = torch.sum(yaw * idx_tensor,dim = 1) * 3 - 90.

pitch = softmax(out[1])

pitch = torch.sum(pitch * idx_tensor,dim = 1) * 3 - 90.

roll = softmax(out[2])

roll = torch.sum(roll * idx_tensor,dim = 1) * 3 - 90.

#print(yaw)

out = yaw + pitch + roll

out.backward()

result = self.out_img.data[0].permute(1,2,0) # chw -> hwc(opencv)

return result.numpy()

def normalize(I):

norm = (I-I.mean())/I.std()

norm = norm * 0.1

norm = norm + 0.5

norm = norm.clip(0, 1)

return norm

if __name__ == "__main__":

input_size = 224

model = densenet121(pretrained = False,num_classes = 61)

model.load_state_dict(torch.load("./ckpt/DenseNet/model_2692_.pkl"))

img = Image.open("/media/xueaoru/其他/ML/head_pose_work/brick/head_and_heads/test/BIWI00009409_-17_+1_+17.png")

transform = transforms.Compose([

transforms.Resize(input_size),

transforms.CenterCrop(input_size),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

])

tensor = transform(img).unsqueeze(0).requires_grad_()

viz = Guided_Prop(model)

result = viz.visualize(tensor)

result = normalize(result)

plt.imshow(result)

plt.show()

由于是多任务问题,所以直接拿结果反传,对于一般的分类问题,可以给定target来用gt用one-hot反传。

head pose estimation 的梯度可视化。

[NN] Guided Backpropgation 可视化的更多相关文章

- 吴裕雄 python神经网络 水果图片识别(3)

import osimport kerasimport timeimport numpy as npimport tensorflow as tffrom random import shufflef ...

- TF之NN:matplotlib动态演示深度学习之tensorflow将神经网络系统自动学习并优化修正并且将输出结果可视化—Jason niu

import tensorflow as tf import numpy as np import matplotlib.pyplot as plt def add_layer(inputs, in_ ...

- MySQL 慢查询日志分析及可视化结果

MySQL 慢查询日志分析及可视化结果 MySQL 慢查询日志分析 pt-query-digest分析慢查询日志 pt-query-digest --report slow.log 报告最近半个小时的 ...

- mininet之miniedit可视化操作

Mininet 2.2.0之后的版本内置了一个mininet可视化工具miniedit,使用Mininet可视化界面方便了用户自定义拓扑创建,为不熟悉python脚本的使用者创造了更简单的环境,界面直 ...

- python之gui-tkinter可视化编辑界面 自动生成代码

首先提供资源链接 http://pan.baidu.com/s/1kVLOrIn#list/path=%2F

- 学习TensorFlow,TensorBoard可视化网络结构和参数

在学习深度网络框架的过程中,我们发现一个问题,就是如何输出各层网络参数,用于更好地理解,调试和优化网络?针对这个问题,TensorFlow开发了一个特别有用的可视化工具包:TensorBoard,既可 ...

- 数据分析之---Python可视化工具

1. 数据分析基本流程 作为非专业的数据分析人员,在平时的工作中也会遇到一些任务:需要对大量进行分析,然后得出结果,解决问题. 所以了解基本的数据分析流程,数据分析手段对于提高工作效率还是非常有帮助的 ...

- AI - TensorFlow - 可视化工具TensorBoard

TensorBoard TensorFlow自带的可视化工具,能够以直观的流程图的方式,清楚展示出整个神经网络的结构和框架,便于理解模型和发现问题. 可视化学习:https://www.tensorf ...

- 【TensorFlow篇】--Tensorflow框架可视化之Tensorboard

一.前述 TensorBoard是tensorFlow中的可视化界面,可以清楚的看到数据的流向以及各种参数的变化,本文基于一个案例讲解TensorBoard的用法. 二.代码 设计一个MLP多层神经网 ...

随机推荐

- RabbitMQ入门教程(十):队列声明queueDeclare

原文:RabbitMQ入门教程(十):队列声明queueDeclare 版权声明:本文为博主原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明. 本文链接:https:// ...

- 在CentOS7上无人值守安装Zabbix4.2

#!/bin/bash # 检查操作系统版本,该脚本只能运行在 Centos .x 系统上 cat /etc/redhat-release |grep -i centos |grep '7.[[:di ...

- Smoke Testing

[Smoke Testing 释义] Smoke Testing 的概念最早源于制造业,用于测试管道.测试时,用鼓风机往管道里灌烟,看管壁外面是否有烟冒出来,以便检验管道是否有缝隙.这一测试显然比较初 ...

- python接口自动化 - Requests-3 高级用法

高级用法 本篇文档涵盖了 Requests 的一些高级特性. 会话对象 会话对象让你能够跨请求保持某些参数.它也会在同一个 Session 实例发出的所有请求之间保持 cookie, 期间使用 url ...

- decodeURI decodeURIComponent

操作 url 常用到编码与解码,一一对应就好 给力文章

- CSS布局方式

1.内边距 padding <!DOCTYPE html> <html lang="en"> <head> <meta charset=& ...

- spring之bean的自动扫描

首先看一段applicationContext.xml中的自动扫描配置 <context:component-scan base-package="org.java.test" ...

- C#文件路径操作总结

一.获取当前文件的路径 1. System.Diagnostics.Process.GetCurrentProcess().MainModule.FileName 获取模块的完整路径,包括 ...

- Registry key 'Software\JavaSoft\Java Runtime Environment\CurrentVersion' has value '1.8', but '1.7'

第一种方法:安装1.8之前安装了1.7,将1.7卸载就好了. 第二种方法:删掉Windows\System32下的java.exe, javaw.exe 就行了,但是安装的1.8的jdk会回到1.7的 ...

- .htaccess A网站单页面301到B网站单页面

.htaccess 301问题 A网站 a.com/a.html 301到 B网站 b.com/b.html RewriteRule ^a.com/a.html$ http://www.b. ...