kafka删除topic的方法及我在kafka上边的一些经验

kafka删除topic的方法

kafka删除topic的方法2014-09-02 22:50:54

0.8的官方文档提供了一个删除topic的命令:

kafka-topics.sh --delete 但是在运行时会报错找不到这个方法。

kafka-topics.sh最终是运行了kafka.admin.TopicCommand这个类,在0.8的源码中这个类中没有找到有delete topic相关的代码。

在kafka的admin包下,提供了一个DeleteTopicCommand的类,可以实现删除topic的功能。

kafka.admin.DeleteTopicCommand

其中删除topic的具体实现代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

import org.I0Itec.zkclient.ZkClientimport kafka.utils.{Utils, ZKStringSerializer, ZkUtils}....... val topic = options.valueOf(topicOpt) val zkConnect = options.valueOf(zkConnectOpt) var zkClient: ZkClient = null try { zkClient = new ZkClient(zkConnect, 30000, 30000, ZKStringSerializer) zkClient.deleteRecursive(ZkUtils.getTopicPath(topic)) //其实最终还是通过删除zk里面对应的路径来实现删除topic的功能 println("deletion succeeded!") } catch { case e: Throwable => println("delection failed because of " + e.getMessage) println(Utils.stackTrace(e)) } finally { if (zkClient != null) zkClient.close() } |

因为这个命令只会删除zk里面的信息,真实的数据还是没有删除,所以需要登录各个broker,把对应的topic的分区数据目录删除,也可能正因为这一点,delete命令才没有集成到kafka.admin.TopicCommand这个类。

本文出自 “菜光光的博客” 博客,请务必保留此出处http://caiguangguang.blog.51cto.com/1652935/1548069

-------------------------------------------------------------------------------------------------------------------------------

kafka-topics.sh --delete 但是在运行时会报错找不到这个方法。

kafka-topics.sh最终是运行了kafka.admin.TopicCommand这个类,在0.8的源码中这个类中没有找到有delete topic相关的代码。

在kafka的admin包下,提供了一个DeleteTopicCommand的类,可以实现删除topic的功能。

kafka.admin.DeleteTopicCommand

其中删除topic的具体实现代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

import org.I0Itec.zkclient.ZkClientimport kafka.utils.{Utils, ZKStringSerializer, ZkUtils}....... val topic = options.valueOf(topicOpt) val zkConnect = options.valueOf(zkConnectOpt) var zkClient: ZkClient = null try { zkClient = new ZkClient(zkConnect, 30000, 30000, ZKStringSerializer) zkClient.deleteRecursive(ZkUtils.getTopicPath(topic)) //其实最终还是通过删除zk里面对应的路径来实现删除topic的功能 println("deletion succeeded!") } catch { case e: Throwable => println("delection failed because of " + e.getMessage) println(Utils.stackTrace(e)) } finally { if (zkClient != null) zkClient.close() } |

因为这个命令只会删除zk里面的信息,真实的数据还是没有删除,所以需要登录各个broker,把对应的topic的分区数据目录删除,也可能正因为这一点,delete命令才没有集成到kafka.admin.TopicCommand这个类。

在zookeeper上删除数据:用zookeeper客户端zkClient连接zookeeper,如:

./zkCli.sh -server 192.165.1.91:12181 此处最好只连接本机的zookeeper:端口,即在集群中每台机器上单独操作!!!

连接上后,可以用命令查看zk的目录结构

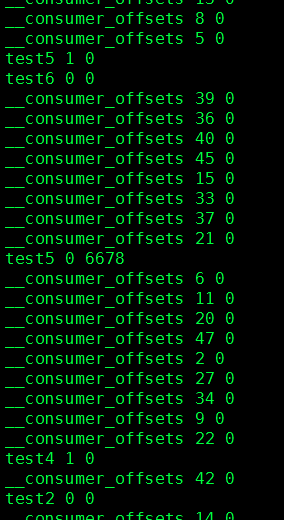

ls /brokers/topics

然后可以看到该目录下有test5目录 tab 补全 ls 发现下边有 (0,1) 字样 ,这是说test5 有俩个分区 然后以以下方式层层递减删除他...

删除方式:

delete /brokers/topics/test5/partitions/0/state

delete /brokers/topics/test5/partitions/1/state

delete /brokers/topics/test5/partitions/0

delete /brokers/topics/test5/partitions/1

delete /brokers/topics/test5/partitions

delete /brokers/topics/test5

===========停止kafka和zookeeper========================

a.查看server.properties中配置的log.dirs路径

b.进入到此路径中(如果kafka是一个集群,需要在每台机器上执行)

假定要删除的topic名称叫做:test5

vi replication-offset-checkpoint

原文为:

像我本地,是要全都删除的,直接改为:

0

同理修改

===========启动kafka和zookeeper========================此时,已修改好;

创建集群的时候要注意:kafka的日志清理

kafka将会保留所有发布的消息,不论他们是否被消费过

如果需要清理,则需要进行配置;

server.properties配置:

log.cleanup.policy=delete

日志清理策略

log.retention.hours=168 (即7天)

数据存储的最大时间超过这个时间会根据log.cleanup.policy设置的策略处理数据,也就是消费端能够多久去消费数据

log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除

log.retention.bytes=-1

topic每个分区的最大文件大小

一个topic的大小限制=分区数*log.retention.bytes

-1表示没有大小限制

log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除

log.retention.check.interval.ms=5minutes

文件大小检查的周期时间

3.kafka的分布式

一个日志的多个partition被分散在kafka集群的多个server上,并且每一个server处理来自于某个partition的数据请求。每个partition可以配置副本个数(即备份),以便容错。

(注:在创建topic时,可以指定--replication-factor参数)

每个partition都有一个server作为leader,并且有0或者多个server作为followers。leader处理对于这个partition的所有读写请求,而followers则被动的复制一切。如果leader挂掉了,一个followers则会自动的成为新的leader。每个server都会在某些partition上作为leader,而在另一些partition上作为follower,所以整个集群是非常平衡的。

(注:如果topic的repliation配置为1,则每个partition就只有唯一的一个leader,没有follower;所以要保证容错性,至少replication应该配置为2)这块我还没有闹懂,我现在的程序中是没有备份的,在另外一套系统中跑的程序入库,,然后另一套做实时展示计算;

4.kafka 的负载均衡问题 producer操作的时候,最好使用轮询的方式向topic写数据,保证topic每个partition的负载是均衡的,之前用的是默认的(随机算法),我现场用的是俩个分区,三台机器组成一个集群,结果一台机器的一个分区里边已经有10亿条数据了,集群中的另一台机器的分区中才只有8亿多一点,,,所以说最好用轮询,也有用hash的,但是为了负载均衡保证消费的高可用,(现场消费一般都是分组消费,consumer在消费的时候一般都是均衡的在broker上去取数据),,所以我个人极力鼓励用轮询来处理数据的分区的问题;省事,安全,不用去考虑负载不均衡带来的其他问题.

kafka删除topic的方法及我在kafka上边的一些经验的更多相关文章

- kafka 删除topic清空数据

原 kafka 删除topic清空数据 2018年11月20日 18:17:50 Ming! 阅读数:1391 版权声明:版权声明:本文为博主原创文章,未经博主允许不得转载. https://bl ...

- kafka删除topic及其相关数据

1.删除kafka存储目录(server.properties文件log.dirs配置,默认为"/tmp/kafka-logs")相关topic目录 2.Kafka 删除topic ...

- kafka 删除topic

两种方法: 一.修改配置文件server.properties 添加如下配置: delete.topic.enable=true 说明:官方给的文档说明“Enables delete topic. D ...

- kafka删除topic详解

1.删除topic命令 bin/kafka-topics.sh --delete --zookeeper 192.168.242.131:2181 --topic aaa 注:此命令如果要生效,还需在 ...

- kafka删除topic数据

一.概述 生产环境中,有一个topic的数据量非常大.这些数据不是非常重要,需要定期清理. 要求:默认保持24小时,某些topic 需要保留2小时或者6小时 二.清除方式 主要有3个: 1. 基于时间 ...

- kafka删除topic中的数据,适用于比较高的版本

server.properties中增加选项 delete.topic.enable=true 修改之后重启kafka 进入kafka目录,输入命令 bin/kafka-topics.sh --zoo ...

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十一)定制一个arvo格式文件发送到kafka的topic,通过Structured Streaming读取kafka的数据

将arvo格式数据发送到kafka的topic 第一步:定制avro schema: { "type": "record", "name": ...

- kafka删除topic

手动: 删除kafka存储目录(server.properties文件log.dirs配置,默认为"/tmp/kafka-logs")相关topic目录 删除zookeeper & ...

- kafka删除topic后再创建同名的topic报错(ERROR org.apache.kafka.common.errors.TopicExistsException)

[hadoop@datanode3 logs]$ kafka-topics.sh --delete --zookeeper datanode1:2181 --topic firstTopic firs ...

随机推荐

- Entity Framework 5 自定义代码生成模板 转

Entity Framework 5 发布有一定时间了,但学习资源确实不多,更何况英语差的我,看英语确实费力,不管怎么样,问题还是解决了,查看很多人写的文章(让我看的想放弃,更想找到答案),都没有到到 ...

- hexo github

win 安装nodejs,用nodejs cmd执行 npm install -g hexo hexo init blog cd blog npm install 或者新建文件夹,进去init再npm ...

- 简单的php和apache的安装

今天刚刚接触到PHP 要想深入学习一门语言 首先我们先从安装开始 对于php和apache这两个程序是比较难以安装的 好了 下面我们开始正式安装: 首先我们得准备好 apache 以及 ...

- javascript-无间缝滚动,封装

原生javascript-无间缝滚动,封装 目前支持的是竖向与横向滚动 http://lgyweb.com/marScroll/ 现在分析下无间缝实现的基本思路(竖向例子): HTML结构: 1 &l ...

- MD5算法-爬虫学习(五)

在实现爬虫的时候,我们使用Hash结构去存储我们用过的URL的时候,有些URL可能长度很长,为了更加节省空间,我们就要对URL进行压缩,帮它减减肥,这个我们介绍这个MD5算法,可以对URL进行有效的压 ...

- [Usaco2008 Open] Clear And Present Danger 寻宝之路[最短路][水]

Description 农夫约翰正驾驶一条小艇在牛勒比海上航行. 海上有N(1≤N≤100)个岛屿,用1到N编号.约翰从1号小岛出发,最后到达N号小岛.一 张藏宝图上说,如果他的路程上 ...

- [实验]通过内核Patch去掉iOS-v4.3.3的沙盒特性

环境: 1.Mac OS X 10.9.2 2.xcode 5.1.1 3.gcc 4.8 4.redsn0w 0.9.15b3 前提: 1.获取 iOS 4.3.3 的kernelcache,并解密 ...

- ASP.NET MVC 用户登录Login

ASP.NET MVC 用户登录Login一.先来看个框架例子:(这个是网上收集到的) 第一步:创建一个类库ClassLibrary831. 第二步:编写一个类实现IHttpM ...

- ibatis配置log4j输出sql日志信息

为了在开发过程更加直观,我们需要将ibatis日志打开以便观察ibatis运作的细节. ibatis采用Apache common_logging,并结合Apache log4j作为日志输出组件. 在 ...

- 利用微信公众平台实现自动回复消息—java版

最近公司需要拿微信公众平台做个东西,所以就开始了最基本学习,网上很多是php版的,对于我这个只会java,不会php的就只能在网上找点只言片语来一点一点学习了.不费话了直接贴图看效果(很简单的). 不 ...