Kafka在zookeeper中存储结构和查看方式

Zookeeper 主要用来跟踪Kafka 集群中的节点状态, 以及Kafka Topic, message 等等其他信息. 同时, Kafka 依赖于Zookeeper, 没有Zookeeper 是不能运行起来Kafka 的.

- Controller 选举:

- Controller 是一个特殊的Broker, 其负责所有Partition 的leader/follower 关系.

- Zookeeper 负责从Broker 中选举出一个作为Controller, 并确保其唯一性. 同时, 当Controller 宕机时, 选举一个新的.

- 集群 membership:

- 记录集群中都有哪些活跃着的Broker.

- Topic 配置:

- 有哪些Topic, Topic 都有哪些Partition, Replica 存放在哪里, Leader 是谁.

- 配额(0.9.0+):

- 记录每个客户能够读写的数据量.

- ACLs(0.9.0+):

- 记录对Topic 的读写控制.

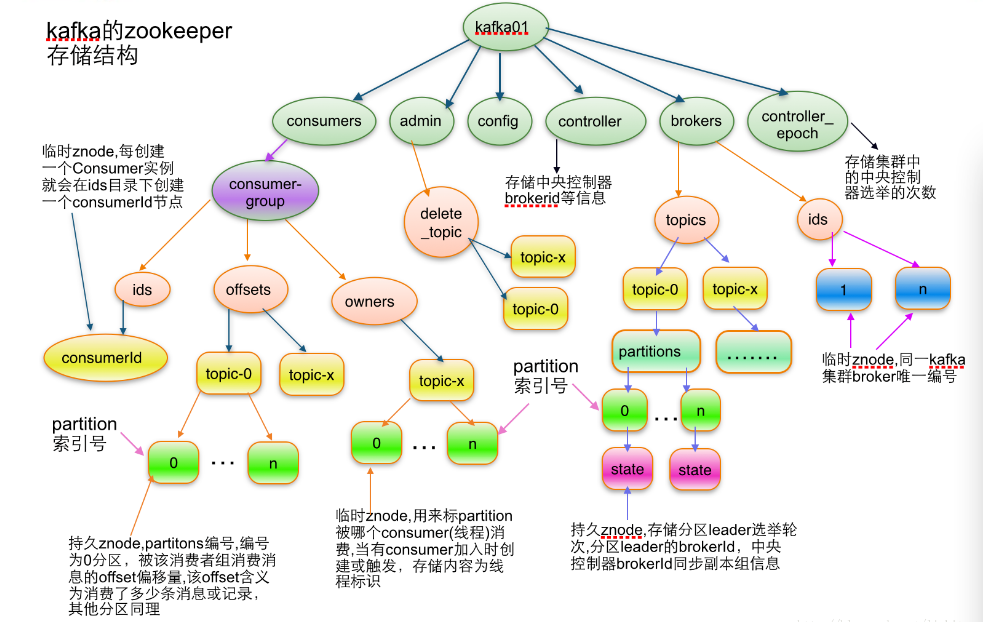

1、kafka的ZooKeeper存储结构

该图片盗自大牛的博客:http://blog.csdn.net/lizhitao/article/details/23744675

在ZK 的监视端, 运行ls / , 可以列出所有的顶级节点, 主要包含以下的节点:

- cluster.

- brokers.

- controller.

- consumer.

- config.

- isr_change_notification.

通过字面意思能够理解其记录的内容. 需要说明的是isr_change_notification 节点. 在Kafka 中, Leader 和Follower 的数据同步遵循的是"最终一致"原则, 也就是数据同步会有延迟, 但保证最终数据的一致性.

isr 是'in-sync' replicas 的缩写, 代表的是与Leader 数据已经通过过的replica, 它会作为重选Leader 时作为判断依据.

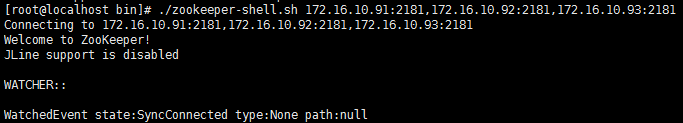

2、连接ZooKeeper

2.1 kafka自带zookeeper

进入kafka的bin目录,执行以下命令:

[root@localhost bin]# ./zookeeper-shell.sh 172.16.10.91:,172.16.10.92:,172.16.10.93:

2.2 独立安装zookeeper

服务端开启的情况下,进入客户端的命令:

{zookeeper目录}/bin/zkCli.sh

3、常用命令

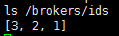

(1)查看数据:ls, ls2

【ls】会显示该节点下的子节点信息

例如:【ls /】:显示zookeeper根目录下的子节点

例如:【ls /brokers/ids】:显示集群中的Broker列表

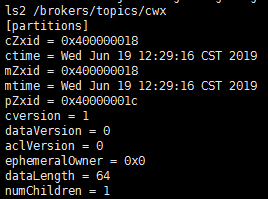

【ls2】命令会显示该节点的子节点信息和属性信息

例如:【ls2 /brokers/topics/cwx】:显示cwx主题的子节点信息和属性信息

(2)获取数据:get

get 命令会显示该节点的节点数据内容和属性信息

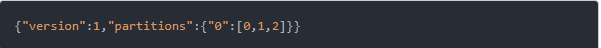

例如:【get /brokers/topics/topic-01】:可以获取topic-01 主题的值

可以看出, 该Topic 只有一个Partition

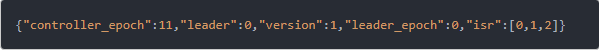

例如:【get /brokers/topics/topic-01/partitions/0/state】:获取Topic Partition 的信息

可以看出, 该Topic 有3个replica, 而且当前状态都是isr(也就是已处于最新状态). 同时, 当前的Leader 是Broker 0.

(3)获取数据:rmr

rmr 命令删除指定路径的节点

例如:【rmr /brokers/topics/test】:删除test主题

4、主要节点信息描述

4.1 topic注册信息

命令:/brokers/topics/[topic]

存储某个topic的partitions所有分配信息

Schema:

{

"version": "版本编号目前固定为数字1",

"partitions": {

"partitionId编号": [

同步副本组brokerId列表

],

"partitionId编号": [

同步副本组brokerId列表

],

.......

}

}

Example:

{

"version": ,

"partitions": {

"": [, ],

"": [, ],

"": [, ],

}

}

4.2 partition状态信息

命令:/brokers/topics/[topic]/partitions/[partitionId]/state

Schema:

{

"controller_epoch": 表示kafka集群中的中央控制器选举次数,

"leader": 表示该partition选举leader的brokerId,

"version": 版本编号默认为1,

"leader_epoch": 该partition leader选举次数,

"isr": [同步副本组brokerId列表]

}

Example:

{

"controller_epoch": ,

"leader": ,

"version": ,

"leader_epoch": ,

"isr": [, ]

}

4.3 Broker注册信息

命令:/brokers/ids/[0...N]

每个broker的配置文件中都需要指定一个数字类型的id(全局不可重复),此节点为临时znode(EPHEMERAL)

Schema:

{

"jmx_port": jmx端口号,

"timestamp": kafka broker初始启动时的时间戳,

"host": 主机名或ip地址,

"version": 版本编号默认为1,

"port": kafka broker的服务端端口号,由server.properties中参数port确定

}

Example:

{

"jmx_port": ,

"timestamp":""

"version": ,

"host": "192.168.1.148",

"port":

}

4.4 Controller epoch

命令:/controller_epoch -> int (epoch)

此值为一个数字,kafka集群中第一个broker第一次启动时为1,以后只要集群中center controller中央控制器所在broker变更或挂掉,就会重新选举新的center controller,每次center controller变更controller_epoch值就会 + 1;

4.5 Controller注册信息

命令:/controller -> int (broker id of the controller)

存储center controller中央控制器所在kafka broker的信息

Schema:

{

"version": 版本编号默认为1,

"brokerid": kafka集群中broker唯一编号,

"timestamp": kafka broker中央控制器变更时的时间戳

}

Example:

{

"version": ,

"brokerid": ,

"timestamp": ""

}

4.6 Consumer offset

命令:/consumers/[groupId]/offsets/[topic]/[partitionId] -> long (offset)

用来跟踪每个consumer目前所消费的partition中最大的offset,此znode为持久节点,可以看出offset跟group_id有关,以表明当消费者组(consumer group)中一个消费者失效,重新触发balance,其他consumer可以继续消费。

4.7 删除topics

命令:/admin/delete_topics

Schema:

{ "fields":

[ {"name": "version", "type": "int", "doc": "version id"},

{"name": "topics",

"type": { "type": "array", "items": "string", "doc": "an array of topics to be deleted"}

} ]

}

例子:

{

"version": ,

"topics": ["foo", "bar"]

}

4.8 Topic配置

命令:/config/topics/[topic_name]

{

"version": ,

"config": {

"config.a": "x",

"config.b": "y",

...

}

}

5、关闭Leader

6、关闭Zookeeper

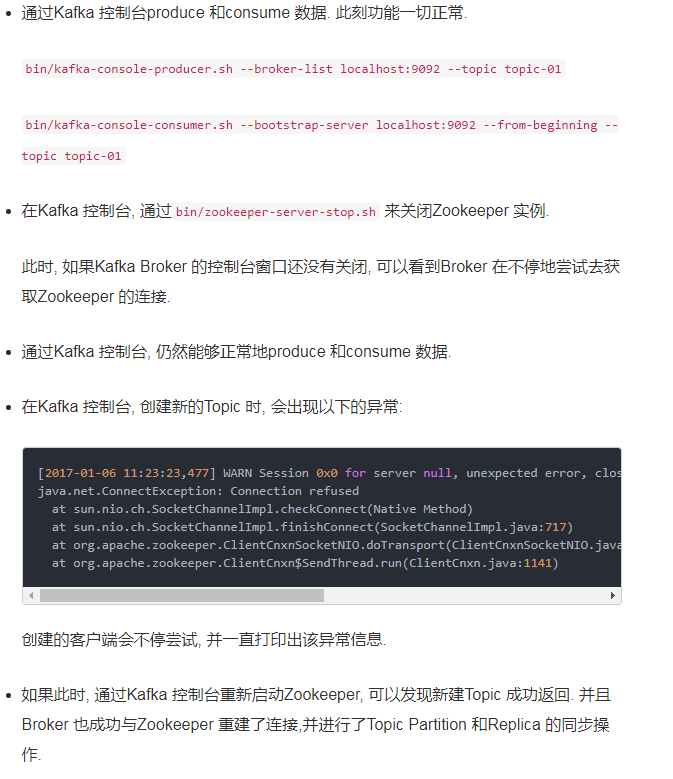

7、特别注意事项

离开了Zookeeper, Kafka 不能对Topic 进行新增操作, 但是仍然可以produce 和consume 消息.

PS: 在运行过程中, 如果先关闭掉了Zookeeper, 然后再去关闭Kafka, 会发现Kafka 后台一直结束不掉, 这是因为Kafka 会被block 在与Zookeeper 的重连过程中. 解决方法是重启Zookeeper , 然后先关闭Kafka 再关闭Zookeeper.

----------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

补充参考:

1、命令行工具的一些简单操作如下:

1. 显示根目录下、文件: ls / 使用 ls 命令来查看当前 ZooKeeper 中所包含的内容

2. 显示根目录下、文件: ls2 / 查看当前节点数据并能看到更新次数等数据

3. 创建文件,并设置初始内容: create /zk "test" 创建一个新的 znode节点“ zk ”以及与它关联的字符串

4. 获取文件内容: get /zk 确认 znode 是否包含我们所创建的字符串

5. 修改文件内容: set /zk "zkbak" 对 zk 所关联的字符串进行设置

6. 删除文件: delete /zk 将刚才创建的 znode 删除

7. 退出客户端: quit

8. 帮助命令: help

2、ZooKeeper 常用四字命令:

ZooKeeper 支持某些特定的四字命令字母与其的交互。它们大多是查询命令,用来获取 ZooKeeper 服务的当前状态及相关信息。用户在客户端可以通过 telnet 或 nc 向 ZooKeeper 提交相应的命令

1. 可以通过命令:echo stat|nc 127.0.0.1 2181 来查看哪个节点被选择作为follower或者leader

2. 使用echo ruok|nc 127.0.0.1 2181 测试是否启动了该Server,若回复imok表示已经启动。

3. echo dump| nc 127.0.0.1 2181 ,列出未经处理的会话和临时节点。

4. echo kill | nc 127.0.0.1 2181 ,关掉server

5. echo conf | nc 127.0.0.1 2181 ,输出相关服务配置的详细信息。

6. echo cons | nc 127.0.0.1 2181 ,列出所有连接到服务器的客户端的完全的连接 / 会话的详细信息。

7. echo envi |nc 127.0.0.1 2181 ,输出关于服务环境的详细信息(区别于 conf 命令)。

8. echo reqs | nc 127.0.0.1 2181 ,列出未经处理的请求。

9. echo wchs | nc 127.0.0.1 2181 ,列出服务器 watch 的详细信息。

10. echo wchc | nc 127.0.0.1 2181 ,通过 session 列出服务器 watch 的详细信息,它的输出是一个与 watch 相关的会话的列表。

11. echo wchp | nc 127.0.0.1 2181 ,通过路径列出服务器 watch 的详细信息。它输出一个与 session 相关的路径。

参考:

http://blog.csdn.net/lizhitao/article/details/23744675

Kafka在zookeeper中存储结构和查看方式的更多相关文章

- kafka在zookeeper中存储结构

1.topic注册信息 /brokers/topics/[topic] : 存储某个topic的partitions所有分配信息 Schema: { "version": ...

- apache kafka系列之在zookeeper中存储结构

1.topic注册信息 /brokers/topics/[topic] : 存储某个topic的partitions所有分配信息 Schema: { "version": ...

- kafka笔记-Kafka在zookeeper中的存储结构【转】

参考链接:apache kafka系列之在zookeeper中存储结构 http://blog.csdn.net/lizhitao/article/details/23744675 1.topic注 ...

- Kafka学习之路 (五)Kafka在zookeeper中的存储

一.Kafka在zookeeper中存储结构图 二.分析 2.1 topic注册信息 /brokers/topics/[topic] : 存储某个topic的partitions所有分配信息 [zk: ...

- Kafka(四)Kafka在zookeeper中的存储

一 Kafka在zookeeper中存储结构图 二 分析 2.1 topic注册信息 /brokers/topics/[topic] : 存储某个topic的partitions所有分配信息 [zk: ...

- 使用kafka bin目录中的zookeeper-shell.sh来查看kafka在zookeeper中的配置

cd kafka_2.11-0.10.2.1\bin\windowsecho ls /brokers/ids | zookeeper-shell.bat localhost:2181 使用kafka ...

- kafka在zookeeper中的存储结构

参考site:http://kafka.apache.org/documentation.html#impl_zookeeper 1.zookeeper客户端相关命令 在确保zookeeper服务启动 ...

- Kafka+SparkStreaming+Zookeeper(ZK存储Offset,解决checkpoint问题)

创建一个topic ./kafka-topics.sh --create --zookeeper 192.168.1.244:2181,192.168.1.245:2181,192.168.1.246 ...

- kafka之zookeeper 节点

1.zookeeper 节点 kafka 在 zookeeper 中的存储结构如下图所示:

随机推荐

- Nginx基于域名的虚拟主机

一.基于域名的虚拟主机 修改配置文件/usr/local/nginx/conf/nginx.conf 创建新的虚拟主机的根目录和默认网页index.html 重新加载nginx的配置文件 查看两个虚拟 ...

- Hbase的表结构中rowkey的设计---避免热点问题

热点问题 hbase 中的行是以 rowkey 的字典序排序的,这种设计优化了scan 操作,可以将相关的 行 以及会被一起读取的行 存取在临近位置,便于 scan . 然而,糟糕的 rowkey 设 ...

- 解决Invalid character found in the request target. The valid characters are defined in RFC 7230 and RF

通过这里的回答,我们可以知道: Tomcat在 7.0.73, 8.0.39, 8.5.7 版本后,添加了对于http头的验证. 具体来说,就是添加了些规则去限制HTTP头的规范性 参考这里 具体来说 ...

- NOIP2018 旅行 和 赛道修建

填很久以前的坑. 旅行 给一棵 n 个点的基环树,求字典序最小的DFS序. n ≤ 5000 题解 O(n2) 做法非常显然,枚举断掉环上哪条边然后贪心即可.当然我去年的骚操作只能得88分. O(n ...

- vue饿了么UI库-笔记

1. :rules="{required: true, message: '有效期不能为空'}" :rules="{type:'date',required: true, ...

- NOIP爆炸记

NOIP爆炸游记 Day 0 Day 1 T1 T2 T3 Day 2 T1 T2 T3 最后 Day 0 复习模板 + 做真题 + 方 Day 1 早上吃了一片面包,就进了考场- T1 Exm??这 ...

- 斜率优化板题 HDU 3507 Print Article

题目大意:输出N个数字a[N],输出的时候可以连续的输出,每连续输出一串,它的费用是 "这串数字和的平方加上一个常数M".n<=500000 我们设dp[i]表示输出到i的时 ...

- 守护进程daemon.c

它的特点是:•不占用控制终端(后台运行)•独立于控制终端•周期性运行 #include<stdio.h>#include<unistd.h>#include<fcntl. ...

- async、await总结

一.async用法 async作为一个关键字放到函数前面,用于表示函数是一个异步函数.异步函数也就意味着该函数的执行不会阻塞后面代码的执行. 异步函数语法很简单,就是在函数前面加上async 关键字, ...

- ImageView.ScaleType

前言 对ImageView.ScaleType,学习安卓需掌握.以官方链接:http://android.xsoftlab.net/reference/android/widget/ImageView ...