ROC曲线 Receiver Operating Characteristic

ROC曲线与AUC值

1.概述

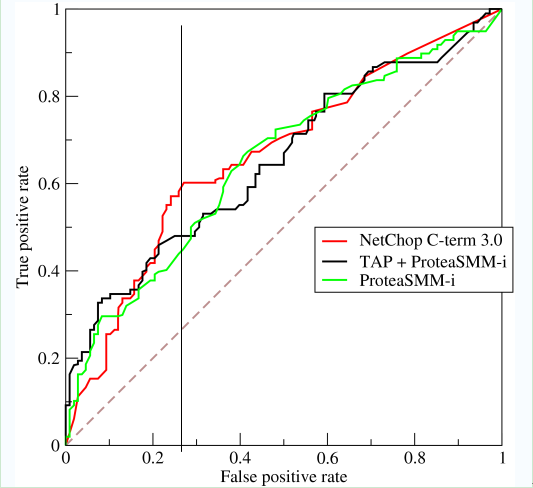

2.ROC曲线

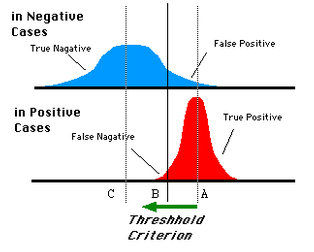

2.1ROC的动机

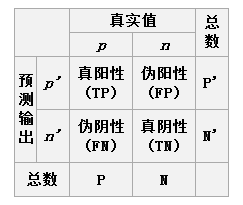

2.2ROC的定义

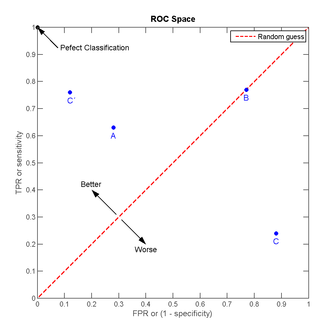

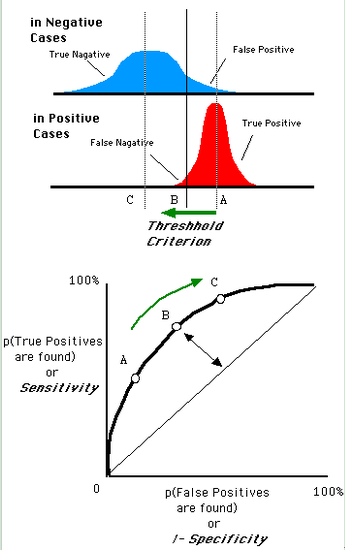

2.3ROC的图形化表示

曲线距离左上角越近,证明分类器效果越好。

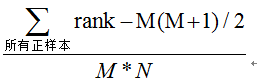

3.AUC值

3.1AUC值的定义

3.2AUC值的物理意义

3.3AUC值的计算

ROC曲线 Receiver Operating Characteristic的更多相关文章

- ROC曲线(Receiver Operating Characteristic Curve)

分类模型尝试将各个实例(instance)划归到某个特定的类,而分类模型的结果一般是实数值,如逻辑回归,其结果是从0到1的实数值.这里就涉及到如何确定阈值(threshold value),使得模型结 ...

- (原+转)ROC曲线

转自:http://baike.baidu.com/link?url=_H9luL0R0BSz8Lz7aY1Q_hew3JF1w-Zj_a51ggHFB_VYQljACH01pSU_VJtSGrGJO ...

- ROC曲线的计算

1.ROC曲线简介 在评价分类模型时,会用到ROC(receiver operating characteristic)曲线.ROC曲线可用来评价二元分类器( binary classifier)的优 ...

- 精确率、召回率、准确率与ROC曲线

精确率表示的是预测为某类样本(例如正样本)中有多少是真正的该类样本,一般用来评价分类任务模型. 比如对于一个分类模型,预测结果为A类的所有样本中包含A0个真正的A样本,和A1个不是A样本的其他类样本, ...

- ROC 曲线/准确率、覆盖率(召回)、命中率、Specificity(负例的覆盖率)

欢迎关注博主主页,学习python视频资源 sklearn实战-乳腺癌细胞数据挖掘(博主亲自录制视频教程) https://study.163.com/course/introduction.ht ...

- ROC曲线是通过样本点分类概率画出的 例如某一个sample预测为1概率为0.6 预测为0概率0.4这样画出来,此外如果曲线不是特别平滑的话,那么很可能存在过拟合的情况

ROC和AUC介绍以及如何计算AUC from:http://alexkong.net/2013/06/introduction-to-auc-and-roc/ ROC(Receiver Operat ...

- ROC曲线详解

转自https://blog.csdn.net/qq_26591517/article/details/80092679 1 ROC曲线的概念 受试者工作特征曲线 (receiver operatin ...

- ROC曲线、PR曲线

在论文的结果分析中,ROC和PR曲线是经常用到的两个有力的展示图. 1.ROC曲线 ROC曲线(receiver operating characteristic)是一种对于灵敏度进行描述的功能图像. ...

- PR曲线,ROC曲线,AUC指标等,Accuracy vs Precision

作为机器学习重要的评价指标,标题中的三个内容,在下面读书笔记里面都有讲: http://www.cnblogs.com/charlesblc/p/6188562.html 但是讲的不细,不太懂.今天又 ...

随机推荐

- vue-router,vuex

vue设置路由为了服务器渲染今天换另一种方式首先在文件夹中router建立router和routes两个js文件,router用来设置路由,routes用来建立路由代码如下: router: impo ...

- js 获取 this 的属性 obj[0].getAttribute

js 获取 this 的属性 obj[0].getAttribute

- depth: working copy\infinity\immediates\files\empty

depth: working copy\infinity\immediates\files\empty 有时间,需要整理下,svn 合并深度这四项:具体的意思.

- python 之面向对象

继承粗体文本 标签(空格分隔): 继承 什么是继承: 继承是指类与类之间的关系,是一种什么"是"什么的关系,继承的功能之一就是用来解决代买重用问题,继承是一种创建新类的方式,在py ...

- Java8中的[方法引用]“双冒号”——走进Java Lambda(四)

前面的章节我们提及到过双冒号运算符,双冒号运算就是Java中的[方法引用],[方法引用]的格式是 类名::方法名 注意是方法名哦,后面没有括号“()”哒.为啥不要括号,因为这样的是式子并不代表一定会调 ...

- python学习 day19 configparser模块 os模块 subprocess模块

上周五回顾 logging 用于记录日志 四种核心角色: 生成器Logger 过滤器Filter 处理器Handler 格式化处理器 Formatter logging.info.debug 使用默认 ...

- Windows消息循环

首先理解一句话:“Windows”向应用程序发送了一条消息.这里是指Windows调用了该程序内部的一个函数. 当UpdateWindow被调用后,新建的窗口在屏幕便完全可见了.此时,Windows会 ...

- eclipse环境的搭建(转载)

原文地址:http://hanqunfeng.iteye.com/blog/982182 此文章发表于2011年到2012年 使用eclipse真的有年头了,相信java程序员没有不知道它的,最近在给 ...

- try cache

try{ $did = DB::insert('vmi_sales_orders',array_keys($value))->values($value)->execute('newerp ...

- dedecms 5.7sp2在用type标签时出现调用无效问题

{dede:type typeid='1'}栏目{/dede:type} 无效 和 {dede:type typeid='1'}[field:typename/]{/dede:type} 有效 ...