论文笔记:Deep Attentive Tracking via Reciprocative Learning

Deep Attentive Tracking via Reciprocative Learning

NIPS18_tracking

Type:Tracking-By-Detection

本篇论文地主要创新是在将注意机制引入到目标跟踪

摘要:源自认知神经科学地视觉注意促进人类对相关的内容的感知。近些年大量工作将注意机制引入到计算机视觉系统中。对于视觉跟踪来说,面临的最大问题在于目标外表的大尺度变化。自注图通过选择性关注临时的鲁棒特征提升视觉跟踪的性能。当前的一些检测跟踪算法主要使用额外的自注模型来生成特征权重,然而分类器并没有采用自注机制。在本文章=中,我们提出一种 reciprocative learning algorithm 算法在训练深度分类器时探索视觉自注机制。该算法由前馈与反馈操作两部分来产生自注图,该图作为正则项与分类LOSS一起训练。该深度分类器习得关注目标区域特征。相关的实验结果证实了该算法达到了极佳的跟踪效果。

引言

近年来。针对不同的视觉应用由此发展出各种各样的跟踪算法,其中视觉注意在视频中目标跟踪起了很大的作用。例如基于DCF的跟踪算法用一张高斯响应特征图表示输入的特征。很多人采用经验空间权重抑制由傅里叶变换过程中的边界效应。从视觉注意角度来说,空间权重也是自注图的一种表现形式。当目标由大尺度变化时,这种空间权重自注图就无法过多的注意边界的响应,从而错误的目标定位。

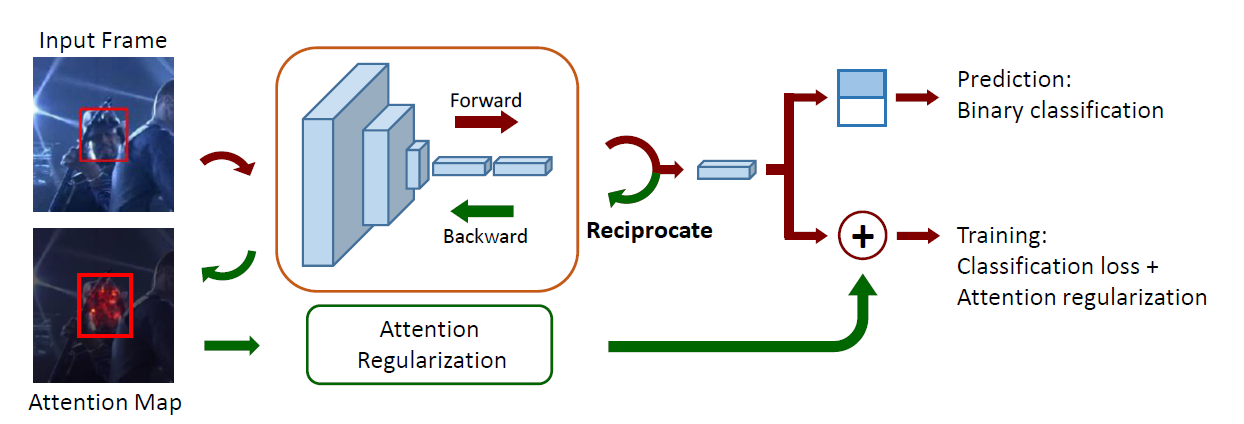

另一方面,two-stage tracking-by-detection 方法首先采集大量样本,对每一样本进行分类判断前景还是背景。视觉注意在这一方面有很大的潜能。现存的深度跟踪算法大多利用额外的注意模型来生成特征权重。自注机制需要经常以便可以学习到目标的最新特征,可以更好的将目标与背景区分。在本文中,作者直接训练一个自注分类器,整个训练过程包括前馈和反馈两步。在前馈这一步中,将图片输入网络,得到分类score;在反馈这一步中,将第一层网络的导数作为自注图(attention map),将自注图作为一个正则项作为LOSS函数中的一员进行训练。网络参数采用传统的反向传播进行更新。因此该深度分类器可以有效的学习目标相关区域的特征,同时有效地减少了背景的干扰。在测试的过程本网络的权重不进行更新,仅仅输出分类的score。

本文的主要贡献:

- 提出一个用于视觉自注的学习算法

- 将自注图作为loss函数的一项进行训练,使其关注目标的特征

- 通过与其他算法在相关数据集上的对比,我们的算法在性能上取得不错的结果

本文提出的跟踪算法训练过程

论文笔记:Deep Attentive Tracking via Reciprocative Learning的更多相关文章

- 论文阅读:Deep Attentive Tracking via Reciprocative Learning

Deep Attentive Tracking via Reciprocative Learning 2018-11-14 13:30:36 Paper: https://arxiv.org/abs/ ...

- Deep attention tracking via Reciprocative Learning

文章:Deep attention tracking via Reciprocative Learning 出自NIPS2018 文章链接:https://arxiv.org/pdf/1810.038 ...

- 论文笔记: Deep Learning based Recommender System: A Survey and New Perspectives

(聊两句,突然记起来以前一个学长说的看论文要能够把论文的亮点挖掘出来,合理的进行概括23333) 传统的推荐系统方法获取的user-item关系并不能获取其中非线性以及非平凡的信息,获取非线性以及非平 ...

- 论文笔记——Deep Residual Learning for Image Recognition

论文地址:Deep Residual Learning for Image Recognition ResNet--MSRA何凯明团队的Residual Networks,在2015年ImageNet ...

- 深度学习论文笔记-Deep Learning Face Representation from Predicting 10,000 Classes

来自:CVPR 2014 作者:Yi Sun ,Xiaogang Wang,Xiaoao Tang 题目:Deep Learning Face Representation from Predic ...

- 论文笔记-Deep Affinity Network for Multiple Object Tracking

作者: ShijieSun, Naveed Akhtar, HuanShengSong, Ajmal Mian, Mubarak Shah 来源: arXiv:1810.11780v1 项目:http ...

- 【论文笔记】多任务学习(Multi-Task Learning)

1. 前言 多任务学习(Multi-task learning)是和单任务学习(single-task learning)相对的一种机器学习方法.在机器学习领域,标准的算法理论是一次学习一个任务,也就 ...

- 论文笔记 — MatchNet: Unifying Feature and Metric Learning for Patch-Based Matching

论文:https://github.com/ei1994/my_reference_library/tree/master/papers 本文的贡献点如下: 1. 提出了一个新的利用深度网络架构基于p ...

- (论文笔记Arxiv2021)Walk in the Cloud: Learning Curves for Point Clouds Shape Analysis

目录 摘要 1.引言 2.相关工作 3.方法 3.1局部特征聚合的再思考 3.2 曲线分组 3.3 曲线聚合和CurveNet 4.实验 4.1 应用细节 4.2 基准 4.3 消融研究 5.总结 W ...

随机推荐

- H5基本标签

- OpenID Connect Core 1.0(二)ID Token

2.ID Token(ID Token) OpenID Connect主要是对OAuth 2.0 能够使得终端用户通过ID Token的数据结构进行验证.当客户端和潜在的其他请求声明,ID Token ...

- Layered Architecture 分层架构

分层的价值在于每一层都只代表程序中的某一特定方面.这种限制使每个方面的设计都更具有内聚性,更容易解释. 大多数成功的架构使用的都是包括下面这四个概念层的某个版本

- chromium之message_pump_win之二

接下来分析 MessagePumpForUI上一篇分析MessagePumpWin,可以参考chromium之message_pump_win之一 根据对MessagePumpWin的分析,Messa ...

- 离不开的微服务架构,脱不开的RPC细节(值得收藏)!!!

服务化有什么好处? 服务化的一个好处就是,不限定服务的提供方使用什么技术选型,能够实现大公司跨团队的技术解耦,如下图所示: 服务A:欧洲团队维护,技术背景是Java 服务B:美洲团队维护,用C++实现 ...

- linux 操作之压缩与解压

压缩与解压 压缩格式:zip , rar , 7z , iso , exe gzip (以下是命令操作) gzip [文件名] #压缩成gz格式 , 原来的文件消失 , 不支持目录. bzip2 - ...

- FireDAC的SQLite初探

// uses FireDAC.VCLUI.Wait 之后, 可不用添加 TFDGUIxWaitCursor TFDConnection // 数据连接 TFDQuery ...

- oracle 用户尝试登录失败锁定策略及修改

-- 修改密码的有效期策略, 永不过期SQL> ALTER PROFILE DEFAULT LIMIT PASSWORD_LIFE_TIME UNLIMITED;Profile altered ...

- Docker学习——gitlab部署

Gitlab 下载镜像 docker pull hub.c.163.com/gutenye/gitlab-ce:latest 查看镜像 docker images 启动容器 宿主机和docker的端口 ...

- java的值传递机制

一.练习:编写Java程序,将二维数组中的行列互调显示出来. 代码1为自己编写: package com.xxgpra.CH6; public class Hangliehudiao_pra4 { p ...