在centos7上安装部署hadoop2.7.3和spark2.0.0

一、安装装备

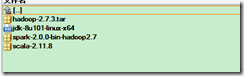

下载安装包:

vmware workstations pro 12

三台centos7.1 mini 虚拟机

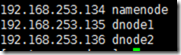

网络配置NAT网络如下:

二、创建hadoop用户和hadoop用户组

1. groupadd hadoop

2. useradd hadoop

3. 给hadoop用户设置密码

在root用户下:passwd hadoop设置新密码

三、关闭防火墙和selinux

1. yum install -y firewalld

2. systemctl stop firewalld

3. systemctl disable firewalld

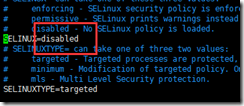

4. vi /etc/selinux/config

5.全部设置好重启虚拟机

四、三台虚拟机之间ssh互通

1. 在hadoop用户下

1. ssh-keygen -t rsa

2. ssh-copy-id -i /home/hadoop/.ssh/id_rsa.pub hadoop@虚拟机ip

3. ssh namenode/dnode1/dnode2

五、安装Java

1. 官网下载jdk1.8.rpm包

2. rpm -ivh jdk1.8.rpm

六、安装hadoop

1. 官网下载hadoop2.7.3.tar.gz

2. tar xzvf hadoop2.7.3.tar.gz

3. mv hadoop2.7.3 /usr/local/

4. chown -R hadoop:hadoop /usr/local/hadoop-2.7.3

七、环境变量配置

1.vim /home/hadoop/.bash_profile

source /home/hadoop/.bash_profile

export JAVA_HOME=/usr/java/jdk1.8.0_101export JRE_HOME=$JAVA_HOME/jreexport CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jarexport HADOOP_HOME=/usr/local/hadoop-2.7.3export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoopexport YARN_CONF_DIR=$HADOOP_HOME/etc/hadoopexport SCALA_HOME=/usr/local/scala-2.11.8export SPARK_HOME=/usr/local/spark-2.0.0PATH=$PATH:$HOME/bin:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$SCALA_HOME/bin:$SPARK_HOME/binexport PATH

八、建立hadoop相关目录

mkdir -p /home/hadoop/hd_space/tmpmkdir -p /home/hadoop/hd_space/hdfs/namemkdir -p /home/hadoop/hd_space/hdfs/datamkdir -p /home/hadoop/hd_space/mapred/localmkdir -p /home/hadoop/hd_space/mapred/systemchown -R hadoop:hadoop /home/hadoop

注意:至此,可以克隆虚拟机,不必每台都安装centos,克隆之后再建立互通

九、配置hadoop

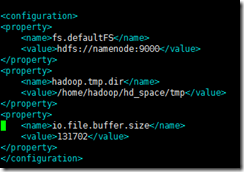

1. 配置core-site.xml

vim /usr/local/hadoop-2.7.3/etc/hadoop/core-site.xml

<configuration><property><name>fs.defaultFS</name><value>hdfs://namenode:9000</value></property><property><name>hadoop.tmp.dir</name><value>/home/hadoop/hd_space/tmp</value></property><property><name>io.file.buffer.size</name><value>131702</value></property></configuration>

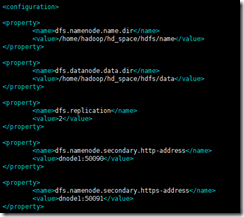

2. 配置hdfs-site.xml

<property><name>dfs.namenode.name.dir</name><value>/home/hadoop/hd_space/hdfs/name</value>?</property><property><name>dfs.datanode.data.dir</name><value>/home/hadoop/hd_space/hdfs/data</value></property><property><name>dfs.replication</name><value>2</value></property><property><name>dfs.namenode.secondary.http-address</name><value>dnode1:50090</value></property><property><name>dfs.namenode.secondary.https-address</name><value>dnode1:50091</value></property>

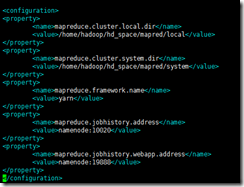

3. 配置mapred-site.xml

<configuration><property><name>mapreduce.cluster.local.dir</name><value>/home/hadoop/hd_space/mapred/local</value></property><property><name>mapreduce.cluster.system.dir</name><value>/home/hadoop/hd_space/mapred/system</value></property><property><name>mapreduce.framework.name</name><value>yarn</value></property><property><name>mapreduce.jobhistory.address</name><value>namenode:10020</value></property>?<property><name>mapreduce.jobhistory.webapp.address</name><value>namenode:19888</value></property>?</configuration>

4.配置yarn-site.xml

<configuration><!-- Site specific YARN configuration properties --><property><description>The?hostname?of?the?RM.</description><name>yarn.resourcemanager.hostname</name><value>namenode</value></property><property><description>the?valid?service?name?should?only?contain?a-zA-Z0-9_?and?can?not?start?with?numbers</description><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property>?</configuration>

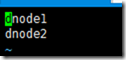

5. 配置slaves,两个数据节点dnode1,dnode2

6. 拷贝配置文件目录到另外两台数据节点

for target in dnode1 dnode2 doscp -r /usr/local/hadoop-2.7.3/etc/hadoop $target:/usr/local/hadoop-2.7.3/etcdone

十、启动hadoop

1. 用户登陆hadoop

2. 格式化hdfs

hdfs namenode -format

3. 启动dfs

start-dfs.sh

4. 启动yarn

start-yarn.sh

十一、错误解决

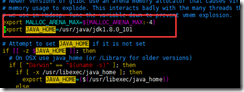

1. 出现以下环境变量JAVA_HOME找不到。

解决办法:需要重新配置/usr/local/hadoop-2.7.3/libexec/hadoop-config.sh

2. oracle数据出现以下错误解决

TNS-12555: TNS:permission denied,监听器启动不了 lsnrctl start(启动)/status(查看状态)/stop(停止)

解决办法:chown -R hadoop:hadoop /var/tmp/.oracle

chmod 777 /var/tmp/.oracle

问题:

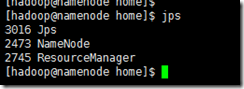

十二、客户端验证

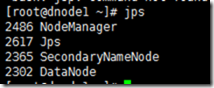

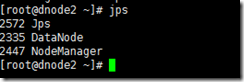

1. jps检查进程

至此,hadoop已经安装完毕

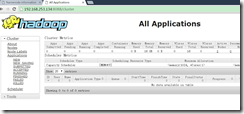

十三、测试hadoop,hadoop用户登陆

运行hadoop自带的wordcount实例

1. 建立输入文件

mkdir -p -m 755 /home/hadoop/test

cd /home/hadoop/test

echo "My first hadoop example. Hello Hadoop in input. " > testfile.txt

2. 建立目录

hadoop fs -mkdir /test

#hadoop fs -rmr /test 删除目录

3. 上传文件

hadoop fs -put testfile.txt /test

4. 执行wordcount程序

hadoop jar /usr/local/hadoop-2.7.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.3.jar wordcount /test/testfile.txt /test/output

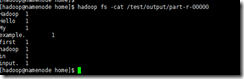

5. 查看结果

hadoop fs -cat /test/output/part-r-00000

十四、安装Spark2.0.0

1. 解压scala-2.11.8.tar.gz到/usr/local

tar xzvf scala-2.11.8

mv scala-2.11.8 /usr/local

2. 解压spark-2.0..0.tgz 到/usr/local

tar xzvf spark-2.0.0.tar.gz

mv spark-2.0.0 /usr/local

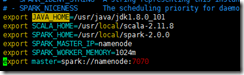

3.配置spark

cd /usr/local/spark-2.0.0/conf

vim spark-env.sh

export JAVA_HOME=/usr/java/jdk1.8.0_101export SCALA_HOME=/usr/local/scala-2.11.8export SPARK_HOME=/usr/local/spark-2.0.0export SPARK_MASTER_IP=namenodeexport SPARK_WORKER_MEMORY=1024mexport master=spark://namenode:7070

vim slaves

同步资源及配置文件到其它两个节点(hadoop用户)

for target in dnode1 dnode2 doscp -r /usr/local/scala-2.11.8 $target:/usr/localscp -r /usr/local/spark-2.0.0 $target:/usr/localdone

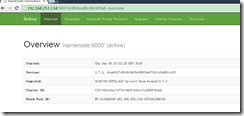

4.启动spark集群

cd $SPARK_HOME

# Start Master

./sbin/start-master.sh

# Start Workers

./sbin/start-slaves.sh

5.客户端验证

在centos7上安装部署hadoop2.7.3和spark2.0.0的更多相关文章

- Docker(2)--Centos7 上安装部署

Centos7 上安装docker Docker从1.13版本之后采用时间线的方式作为版本号,分为社区版CE和企业版EE. 社区版是免费提供给个人开发者和小型团体使用的,企业版会提供额外的收费服务,比 ...

- Centos7.5安装分布式Hadoop2.6.0+Hbase+Hive(CDH5.14.2离线安装tar包)

Tags: Hadoop Centos7.5安装分布式Hadoop2.6.0+Hbase+Hive(CDH5.14.2离线安装tar包) Centos7.5安装分布式Hadoop2.6.0+Hbase ...

- 在Centos7上安装漏洞扫描软件Nessus

本文摘要:简单叙述了在Centos7上安装Nessus扫描器的过程 Nessus 是目前全世界最多人使用的系统漏洞扫描与分析软件,Nessus的用户界面是基于Web界面来访问Nessus漏洞扫描器 ...

- CentOS7.4安装部署openstack [Liberty版] (二)

继上一篇博客CentOS7.4安装部署openstack [Liberty版] (一),本篇继续讲述后续部分的内容 一.添加块设备存储服务 1.服务简述: OpenStack块存储服务为实例提供块存储 ...

- CentOS7.4安装部署openstack [Liberty版] (一)

一.OpenStack简介 OpenStack是一个由NASA(美国国家航空航天局)和Rackspace合作研发并发起的,以Apache许可证授权的自由软件和开放源代码项目. OpenStack是一个 ...

- centos7.8 安装部署 k8s 集群

centos7.8 安装部署 k8s 集群 目录 centos7.8 安装部署 k8s 集群 环境说明 Docker 安装 k8s 安装准备工作 Master 节点安装 k8s 版本查看 安装 kub ...

- 怎么在linux上安装部署jenkins

怎么在linux上安装部署jenkins 作为一个非科班出身自学的小白,踩过很多的坑,特此留下记录 以下在虚拟机上示例 系统:linux(centos7) 操作方式:xshell连接终端操作 教程之前 ...

- 在centos7上安装Jenkins

在centos7上安装Jenkins 安装 添加yum repos,然后安装 sudo wget -O /etc/yum.repos.d/jenkins.repo http://pkg.jenkins ...

- 在 CentOS7 上安装 zookeeper-3.4.9 服务

在 CentOS7 上安装 zookeeper-3.4.9 服务 1.创建 /usr/local/services/zookeeper 文件夹: mkdir -p /usr/local/service ...

随机推荐

- 牛B三人组-快速排序-堆排序-归并排序

快速排序 随便取个数,作为标志值,这里就默认为索引位置为0的值 记录左索引和右索引,从右往左找比标志值小的,小值和左索引值交换,右索引变化,然后从左往右找比标志值大的,大值和右索引值交换,左索引变化 ...

- 哈密顿绕行世界问题---hdu2181(全排列问题)

题目链接:http://acm.hdu.edu.cn/showproblem.php?pid=2181 题意很容易理解,dfs就可以了 #include <iostream> #inclu ...

- Spark ML Pipeline简介

Spark ML Pipeline基于DataFrame构建了一套High-level API,我们可以使用MLPipeline构建机器学习应用,它能够将一个机器学习应用的多个处理过程组织起来,通过在 ...

- Spring第八发—自动装配及让Spring自动扫描和管理Bean

依赖注入–自动装配依赖对象(了解即可) 对于自动装配,大家了解一下就可以了,实在不推荐大家使用.例子: byName:按名称装配,可以根据属性的名称,在容器中寻找跟该属性名相同的bean,如果没有找到 ...

- PAT 1052 Linked List Sorting [一般]

1052 Linked List Sorting (25 分) A linked list consists of a series of structures, which are not nece ...

- 我与前端之间不得不说的三天两夜之html基础

HTML 初识 分类 cs模式 client-server bs模式 Browser-server web服务本质 from socket import * def main(): service=s ...

- hdu2328 Corporate Identity

地址:http://acm.hdu.edu.cn/showproblem.php?pid=2328 题目: Corporate Identity Time Limit: 9000/3000 MS (J ...

- [转]运动检测(前景检测)之(二)混合高斯模型GMM

转自:http://blog.csdn.net/zouxy09/article/details/9622401 因为监控发展的需求,目前前景检测的研究还是很多的,也出现了很多新的方法和思路.个人了解的 ...

- HBase1.2.6 预分区后,数据不进入预定分区的一个 bug

rowkey 如下: 19000015115042900001511504390000151150449000015115045900001511504690000151150479000015115 ...

- 验证APNS证书的有效性

openssl s_client -connect gateway.sandbox.push.apple.com:2195 -cert xxx.pem