deep_learning_Function_softmax_cross_entropy_with_logits

【TensorFlow】tf.nn.softmax_cross_entropy_with_logits的用法

在计算loss的时候,最常见的一句话就是tf.nn.softmax_cross_entropy_with_logits,那么它到底是怎么做的呢?

首先明确一点,loss是代价值,也就是我们要最小化的值

tf.nn.softmax_cross_entropy_with_logits(logits, labels, name=None)

除去name参数用以指定该操作的name,与方法有关的一共两个参数:

第一个参数logits:就是神经网络最后一层的输出,如果有batch的话,它的大小就是[batchsize,num_classes],单样本的话,大小就是num_classes

第二个参数labels:实际的标签,大小同上

具体的执行流程大概分为两步:

第一步是先对网络最后一层的输出做一个softmax,这一步通常是求取输出属于某一类的概率,对于单样本而言,输出就是一个num_classes

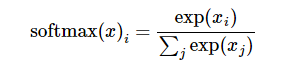

softmax的公式是:

至于为什么是用的这个公式?这里不介绍了,涉及到比较多的理论证明

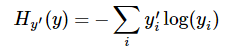

第二步是softmax的输出向量[Y1,Y2,Y3...]和样本的实际标签做一个交叉熵,公式如下:

其中 指代实际的标签中第i个的值(用mnist数据举例,如果是3,那么标签是[0,0,0,1,0,0,0,0,0,0],除了第4个值为1,其他全为0)

指代实际的标签中第i个的值(用mnist数据举例,如果是3,那么标签是[0,0,0,1,0,0,0,0,0,0],除了第4个值为1,其他全为0)

就是

就是softmax的输出向量[Y1,Y2,Y3...]

显而易见,预测

越准确,结果的值越小(别忘了前面还有负号),最后求一个平均,得到我们想要的loss

注意!!!这个函数的返回值并不是一个数,而是一个向量,如果要求交叉熵,我们要再做一步tf.reduce_sum操作,就是对向量里面所有元素求和,最后才得到 ,如果求loss,则要做一步

,如果求loss,则要做一步tf.reduce_mean操作,对向量求均值!

理论讲完了,上代码

- import tensorflow as tf

- #our NN's output

- logits=tf.constant([[1.0,2.0,3.0],[1.0,2.0,3.0],[1.0,2.0,3.0]])

- #step1:do softmax

- y=tf.nn.softmax(logits)

- #true label

- y_=tf.constant([[0.0,0.0,1.0],[0.0,0.0,1.0],[0.0,0.0,1.0]])

- #step2:do cross_entropy

- cross_entropy = -tf.reduce_sum(y_*tf.log(y))

- #do cross_entropy just one step

- cross_entropy2=tf.reduce_sum(tf.nn.softmax_cross_entropy_with_logits(logits, y_))#dont forget tf.reduce_sum()!!

- with tf.Session() as sess:

- softmax=sess.run(y)

- c_e = sess.run(cross_entropy)

- c_e2 = sess.run(cross_entropy2)

- print("step1:softmax result=")

- print(softmax)

- print("step2:cross_entropy result=")

- print(c_e)

- print("Function(softmax_cross_entropy_with_logits) result=")

- print(c_e2)

输出结果是:

- step1:softmax result=

- [[ 0.09003057 0.24472848 0.66524094]

- [ 0.09003057 0.24472848 0.66524094]

- [ 0.09003057 0.24472848 0.66524094]]

- step2:cross_entropy result=

- 1.22282

- Function(softmax_cross_entropy_with_logits) result=

- 1.2228

最后大家可以试试e^1/(e^1+e^2+e^3)是不是0.09003057,发现确实一样!!这也证明了我们的输出是符合公式逻辑的

deep_learning_Function_softmax_cross_entropy_with_logits的更多相关文章

随机推荐

- html5内容快速学习

accessKey 快捷键 <input type="text" accessType="m"/> <!-- chrome按下快捷键alt+m ...

- 菜鸟的周末_Python试水

搭建开发环境 下载安装包,打开官网,选择最新Windows Installer版本下载. 运行安装包,勾选Add Python 3.8 to Path,选择Install Now,等待安装完成,直接关 ...

- Xman冬令营writeup

做题一时爽,期末火葬场,一晚上水了三题,跪求期末不挂,老老实实去复习.祝各位表哥冬令营玩的开心. 中二的成长之路 很容易发现图片本身就是个压缩包,里面还有个图片,但是加密了所以需要我们求出压缩包的密码 ...

- Mac部分命令

报错: -bash: brew: command not found 解决: /usr/bin/ruby -e "$(curl -fsSL https://raw.githubusercon ...

- charles安装&破解

走在测试的道路上,我们总归要学习抓包,仅仅是为了更好的定位bug出现的位置.抓包工具何其之多,但是我个人推荐的是charles,主要是因为windows和ios可以同时使用,这样就可以方便不少.不废话 ...

- golang 多级json转map

func main() { jsonStr := `{"isSchemaConforming":true,"schemaVersion":0,"unk ...

- office web apps安装部署,配置https,负载均衡(三)服务器连接域控制器

前提条件:1>一台window server 2008R2 服务器 2>您已经在同一内网的另外一台服务器上安装好了域控制器文档请看我写的另外一篇文章: office web apps安装部 ...

- idea修改java编译版本

file--Settings project strustructure project strustructure

- @lazy注解

默认情况下,Spring会在应用程序上下文的启动时创建所有单例bean 主要针对单实例 Bean ,容器启动时不创建对象,仅当第一次使用Bean的时候才创建 @Lazy @Bean public Pe ...

- Ruby学习中(哈希变量/python的字典, 简单的类型转换)

一. 哈希变量(相当于Python中的字典) 详情参看:https://www.runoob.com/ruby/ruby-hash.html 1.值得注意的 (1). 创建Hash时需注意 # 创建一 ...