[原创]python+beautifulsoup爬取整个网站的仓库列表与仓库详情

from bs4 import BeautifulSoup

import requests

import os def getdepotdetailcontent(title,url):#爬取每个仓库列表的详情

r=requests.get("https://www.50yc.com"+url).content

soup = BeautifulSoup(r,"html.parser")

result = soup.find(name='div',attrs={"class":"sm-content"})#返回元素集

content = result.find_all("li")#返回元素集

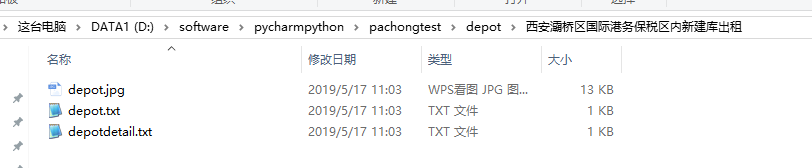

with open(os.getcwd()+"\\depot\\"+title+"\\depotdetail.txt","w") as f :

for i in content:

b = i.find("span").text

br = i.find("div").text

f .write(b.replace(" ","").replace("\n","")+br.replace(" ","")+"\n"+"****************************"+"\n")

f.close() def getdepot(page):#爬取仓库列表信息

depotlisthtml = requests.get("https://www.50yc.com/xan"+page).content

content = BeautifulSoup(depotlisthtml,"html.parser")

tags = content.find_all(name="div",attrs={"class":"bg-hover"})

for i in tags:

y = i.find_all(name="img")#返回tag标签

for m in y:

if m["src"].startswith("http"):

imgurl = m["src"]

print(imgurl)

title = i.strong.text

depotdetailurl = i.a['href']

# print(depotdetailurl)

os.mkdir(os.getcwd()+'\\depot\\'+title+'\\')

with open(os.getcwd()+'\\depot\\'+title+'\\'+"depot.jpg","wb") as d :

d.write(requests.get(imgurl).content)

with open(os.getcwd()+'\\depot\\'+title+'\\'+"depot.txt","w") as m:

m.write(i.text.replace(" ",""))

m.close()

getdepotdetailcontent(title,depotdetailurl) for i in range(1,26):#爬取每页的仓库列表与仓库详情

getdepot("/page"+str(i))

print("/page"+str(i))

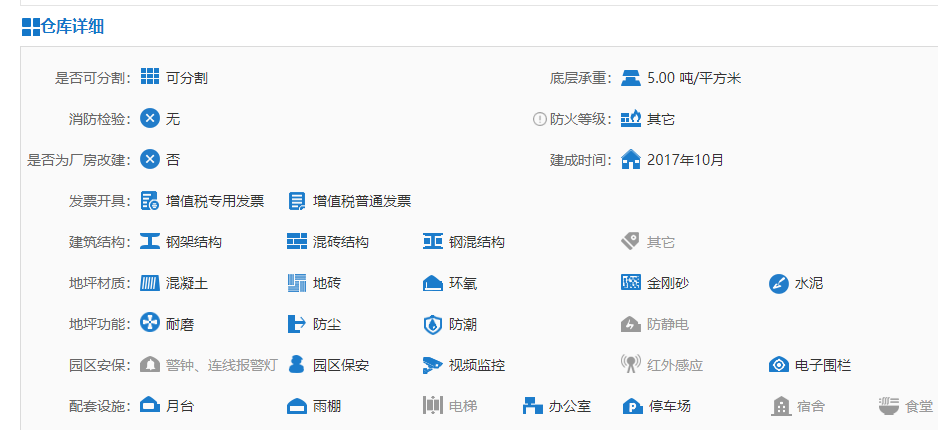

爬取内容为:

爬取结果如下:

[原创]python+beautifulsoup爬取整个网站的仓库列表与仓库详情的更多相关文章

- python爬虫--爬取某网站电影信息并写入mysql数据库

书接上文,前文最后提到将爬取的电影信息写入数据库,以方便查看,今天就具体实现. 首先还是上代码: # -*- coding:utf-8 -*- import requests import re im ...

- python爬虫--爬取某网站电影下载地址

前言:因为自己还是python世界的一名小学生,还有很多路要走,所以本文以目的为向导,达到目的即可,对于那些我自己都没弄懂的原理,不做去做过多解释,以免误人子弟,大家可以网上搜索. 友情提示:本代码用 ...

- Python爬虫学习之使用beautifulsoup爬取招聘网站信息

菜鸟一只,也是在尝试并学习和摸索爬虫相关知识. 1.首先分析要爬取页面结构.可以看到一列搜索的结果,现在需要得到每一个链接,然后才能爬取对应页面. 关键代码思路如下: html = getHtml(& ...

- Python多线程爬取某网站表情包

# 爬取网络图片import requestsfrom lxml import etreefrom urllib import requestfrom queue import Queue # 导入队 ...

- python 爬虫 爬取序列博客文章列表

python中写个爬虫真是太简单了 import urllib.request from pyquery import PyQuery as PQ # 根据URL获取内容并解码为UTF-8 def g ...

- Python 利用 BeautifulSoup 爬取网站获取新闻流

0. 引言 介绍下 Python 用 Beautiful Soup 周期性爬取 xxx 网站获取新闻流: 图 1 项目介绍 1. 开发环境 Python: 3.6.3 BeautifulSoup: ...

- 利用python的requests和BeautifulSoup库爬取小说网站内容

1. 什么是Requests? Requests是用Python语言编写的,基于urllib3来改写的,采用Apache2 Licensed 来源协议的HTTP库. 它比urllib更加方便,可以节约 ...

- python之简单爬取一个网站信息

requests库是一个简介且简单的处理HTTP请求的第三方库 get()是获取网页最常用的方式,其基本使用方式如下 使用requests库获取HTML页面并将其转换成字符串后,需要进一步解析HTML ...

- Python使用urllib,urllib3,requests库+beautifulsoup爬取网页

Python使用urllib/urllib3/requests库+beautifulsoup爬取网页 urllib urllib3 requests 笔者在爬取时遇到的问题 1.结果不全 2.'抓取失 ...

随机推荐

- vue阻止事件冒泡和默认事件

本文地址:https://www.cnblogs.com/guomin/p/9273862.html 原生js取消事件冒泡 try{ e.stopPropagation();//非IE浏览器 } ca ...

- MySQL实战45讲学习笔记:第四十五讲

一.本节概述 MySQL 里有很多自增的 id,每个自增 id 都是定义了初始值,然后不停地往上加步长.虽然自然数是没有上限的,但是在计算机里,只要定义了表示这个数的字节长度,那它就有上限.比如,无符 ...

- iOS应用卡顿分析

1.屏幕显示图像的原理 显示器按照从上到下的方式,一行行扫描,扫描完成后显示器就呈现一帧画面,随后电子枪回到初始位置继续下一次扫描.为了把显示器的显示过程和系统的视频控制器进行同步,显示器(或者其他硬 ...

- 【洛谷5438】【XR-2】记忆(数论)

[洛谷5438][XR-2]记忆(数论) 题面 洛谷 题解 很好的一道题目. 我们首先把所有数的每个质因子的出现次数模二,也就是把最大的完全平方因子给除掉.然后剩下部分一样的就可以产生\(1\)的贡献 ...

- redis 面试问题问答Top 10

1)什么是Redis? English:Redis is an open source (BSD licensed), in-memory data structure store, used as ...

- RootKit随手记(一)RootKit的驱动隐藏、读取配置、卸载安装

边学习边更新这专题,随手记录一下用到的思路,给自己看的(所以读者看可能有些懵,不好意思...) RootKit随手记(一)RootKit的驱动隐藏.读取配置.卸载安装 一.驱动隐藏 1. 隐藏原理 一 ...

- Microsoft.Practices.Unity

// // Summary: // Register a type mapping with the container. // // Parameters: // container: // Con ...

- ASP.NET MVC 中枚举生成下拉框

最近公司在开发财务系统,在工作中遇到不少的地方需要下拉框. 但是枚举框中数据的内容又来自枚举. 枚举代码如下: public class EnumDemo { public enum Value { ...

- C# 人民币大写金额转换

/// <summary> /// 转换人民币大小金额 /// </summary> /// <param name="nu ...

- 最简单取得外网IP

#coding=utf-8import urllib2import re print re.search('\d+\.\d+\.\d+\.\d+',urllib2.urlopen("http ...