NLP之TF-IDF与BM25原理探究

前言

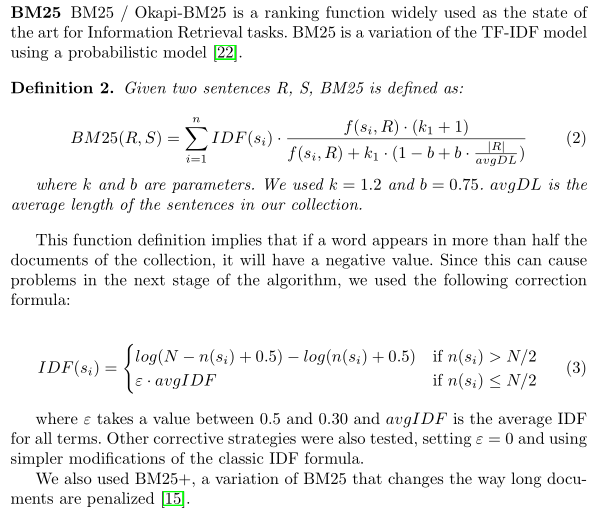

本文主要是对TF-IDF和BM25在公式推演、发展沿革方面的演述,全文思路、图片基本来源于此篇公众号推文《搜索中的权重度量利器: TF-IDF和BM25》,侵删。

一 术语

- TF: Term Frequency,词频;衡量某个指定的词语在某份【文档】中出现的【频率】

- IDF: Inverse Document Frequency,逆文档频率;一个词语【普遍重要性】的度量。

- TF-IDF = TF*IDF

一种统计方法,用以评估一字词对于一个文件集或一个语料库中的其中一份文件的重要程度。字词的重要性随着它在文件中出现的次数成正比增加,但同时会随着它在语料库中出现的频率成反比下降。TF-IDF加权的各种形式常被搜索引擎应用,作为文件与用户查询之间相关程度的度量或评级。 -----《TF-IDF 百度百科》

TFIDF的主要思想是:如果某个词或短语在一篇文章中出现的频率TF高,并且在其他文章中很少出现,则认为此词或者短语具有很好的类别区分能力,适合用来分类。

- BM25

- 应用:BM25相关度打分,基于BM25与TextRank的单文档自动文摘(经Rouge评测,效果较为优异)

bm25 是一种用来评价搜索词和文档之间相关性的算法,它是一种基于概率检索模型提出的算法

二 TF-IDF

- <1>传统的TF-IDF

- 【TF】词汇word的词频(TF)值

\[ TF_{Score} = tf = \frac{ 指定词汇word在第i份文档documents[i]中出现的次数 }{ 文档documents[i]的长度 } \] - 【IDF】词汇word的逆文档频率(IDF)值

\[ IDF_{Score} = log( \frac{ 文档集documents的总数 }{ 指定词word在文档集documents中出现过的文档总数 } ) \] - 【TF-IDF/关联度计算】词汇word与某份文档documents[j]的关联度得分(TF-IDF)

\[ TFIDF(word | docuements ) = Similarity(word | documents ) \]

\[ Similarity(word | documents ) = TF_{Score}*IDF_{Score} \] - 短语sentence与某份文档documents[j]的关联度得分(TF-IDF)

\[ sentence = [word1,word2,...,wordi,...,wordn] \]

\[ TFIDF_{_{sentence}}(word | docuements ) = TFIDF_{_{word1}} + TFIDF_{_{word2}} + ... + TFIDF_{_{wordi}} + ... + TFIDF_{_{wordn}} \]

- 【TF】词汇word的词频(TF)值

- <2>早期Lucence版的TF-IDF

- 【TF】

\[ TF_{Score} = sqrt(tf) \] - 【IDF】

\[ IDF_{Score} = log( \frac{ 文档集documents的总数 }{ 指定词word在文档集documents中出现过的文档总数 + 1 } ) \] - 【filedNorms】fieldNorms:对文本长度的归一化(Normalization)

\[ fieldNorms = (\frac{1}{sqrt(文档documents[j]的长度)}) \] - 【TF-IDF/关联度计算】

\[ TF-IDF(word | docuements ) = Similarity(word | documents ) \]

\[ Similarity(word | documents ) = TF_{Score} * IDF_{Score} * fieldNorms \]

- 【TF】

三 BM25

下一代的TF-IDF。

新版的lucence不再把TF-IDF作为默认的相关性算法,而是采用了BM25(BM是Best Matching的意思)。BM25是基于TF-IDF并做了改进的算法。

- <3>BM25

- 【TF】传统的TF值理论上是可以无限大的。而BM25与之不同,它在TF计算方法中增加了一个常量k,用来限制TF值的增长极限。

- 早期Lucence版的TF-IDF

\[ TF_{Score} = sqrt(tf) \] - BM25的TF Score(作者默认对k取值为1.2)

\[ TF_{Score} = \frac{ ((k + 1) * tf) }{ k + tf } \] 如何对待文档长度?(再优化)

\[ TF_{Score} = \frac{ ((k + 1) * tf) }{ k * (1.0 - b + b * L) + tf } \]BM25还引入了平均文档长度的概念,单个文档长度对相关性的影响力与它和平均长度的比值有关系。

BM25的TF公式里,除了k外,引入另外两个参数:L和b。

L是文档长度与平均长度的比值。如果文档长度是平均长度的2倍,则L=2。

b是一个常数,它的作用是规定L对评分的影响有多大。如果把b设置为0,则L完全失去对评分的影响力。b的值越大,L对总评分的影响力越大。加了L和b的公式如上所示。

- 早期Lucence版的TF-IDF

- 【IDF】

\[ IDF_{Score} = log( \frac{ 文档集documents的总数 }{ 指定词word在文档集documents中出现过的文档总数 + 1 } ) \] - 【TF-IDF/关联度计算】

\[ Similarity(word | documents ) = \frac{ IDF_{Score}*(k + 1)*tf } { k * (1.0 - b + b * \frac{|D|}{avgD_{l}}) + tf } \]

\[ L= \frac{|D|}{avgD_{l}} \]

\[ 其中,|D|系文档集documents的文档总数;avgD_{l}系文档集documents的平均文档长度(即 平均词汇数) \]

- 【TF】传统的TF值理论上是可以无限大的。而BM25与之不同,它在TF计算方法中增加了一个常量k,用来限制TF值的增长极限。

四 文献

- 参考文献

- 推荐文献

- 补充:推荐文献

《Variations of the Similarity Function of TextRank for Automated Summarization》

.important{ color:red;font-weight:bloder; }

NLP之TF-IDF与BM25原理探究的更多相关文章

- Elasticsearch由浅入深(十)搜索引擎:相关度评分 TF&IDF算法、doc value正排索引、解密query、fetch phrase原理、Bouncing Results问题、基于scoll技术滚动搜索大量数据

相关度评分 TF&IDF算法 Elasticsearch的相关度评分(relevance score)算法采用的是term frequency/inverse document frequen ...

- 基于TF/IDF的聚类算法原理

一.TF/IDF描述单个term与特定document的相关性TF(Term Frequency): 表示一个term与某个document的相关性. 公式为这个term在document中出 ...

- TF/IDF(term frequency/inverse document frequency)

TF/IDF(term frequency/inverse document frequency) 的概念被公认为信息检索中最重要的发明. 一. TF/IDF描述单个term与特定document的相 ...

- 信息检索中的TF/IDF概念与算法的解释

https://blog.csdn.net/class_brick/article/details/79135909 概念 TF-IDF(term frequency–inverse document ...

- tf idf公式及sklearn中TfidfVectorizer

在文本挖掘预处理之向量化与Hash Trick中我们讲到在文本挖掘的预处理中,向量化之后一般都伴随着TF-IDF的处理,那么什么是TF-IDF,为什么一般我们要加这一步预处理呢?这里就对TF-IDF的 ...

- [原] KVM 虚拟化原理探究(1)— overview

KVM 虚拟化原理探究- overview 标签(空格分隔): KVM 写在前面的话 本文不介绍kvm和qemu的基本安装操作,希望读者具有一定的KVM实践经验.同时希望借此系列博客,能够对KVM底层 ...

- [原] KVM 虚拟化原理探究 —— 目录

KVM 虚拟化原理探究 -- 目录 标签(空格分隔): KVM KVM 虚拟化原理探究(1)- overview KVM 虚拟化原理探究(2)- QEMU启动过程 KVM 虚拟化原理探究(3)- CP ...

- [原] KVM 虚拟化原理探究(6)— 块设备IO虚拟化

KVM 虚拟化原理探究(6)- 块设备IO虚拟化 标签(空格分隔): KVM [toc] 块设备IO虚拟化简介 上一篇文章讲到了网络IO虚拟化,作为另外一个重要的虚拟化资源,块设备IO的虚拟化也是同样 ...

- [原] KVM 虚拟化原理探究(5)— 网络IO虚拟化

KVM 虚拟化原理探究(5)- 网络IO虚拟化 标签(空格分隔): KVM IO 虚拟化简介 前面的文章介绍了KVM的启动过程,CPU虚拟化,内存虚拟化原理.作为一个完整的风诺依曼计算机系统,必然有输 ...

随机推荐

- SQL server 语句执行分析

- Linux系统进程的知识总结,进程与线程之间的纠葛...

来源:嵌入式ARM 当一个程序开始执行后,在开始执行到执行完毕退出这段时间内,它在内存中的部分就叫称作一个进程. Linux 是一个多任务的操作系统,也就是说,在同一时间内,可以有多个进程同时执行.我 ...

- 0009SpringBoot静态资源访问路径

访问静态资源: 静态资源需要放在哪些路径下才能被访问呢: 通过WebMvcAutoConfiguration.java中 addResourceHandlers()方法查找绑定的路径,一个是通过web ...

- git commit 详解

git commit 命令用来将本地暂存的修改提交到版本库. git commit -m '提交信息'. 我们用的比较多的应该就是-m 参数.添加提交信息. 经常手抖的同学可能会知道,git comm ...

- 彻底搞懂prototype和__proto__

prototype是函数特有的属性,是Function的静态属性:__proto__是对象特有的属性. 因为函数本身是一种对象,所以函数既有prototype属性也有__proto__属性. 当函数使 ...

- robotframework出现错误:Keyword 'AppiumLibrary.Open Application' expected 1 to 2 non-keyword arguments,got 5.

robotframework官网: http://robotframework.org/#introduction -------------- 出现的场景: 由于一开始不了解robotframewo ...

- Git Clone 的时候遇到 Filename too long 错误

在对某些仓库进行 Git Clone 的时候遇到了 Filename too long 的错误提示. 错误提示如下图: 可以有下面的一些解决办法: 可以有下面的一些解决办法: 在 Git bash 中 ...

- 【概率论】4-5:均值和中值(The Mean and the Median)

title: [概率论]4-5:均值和中值(The Mean and the Median) categories: - Mathematic - Probability keywords: - Me ...

- windows下去掉快捷方式图标的小箭头的几种方法

去掉快捷方式图标的小箭头的几种方法 第一种: 点开始菜单,点运行,输入以下命令后回车.即可解决 cmd /k reg delete "HKEY_CLASSES_ROOT\lnkfile&qu ...

- 我终于搞清楚了和String有关的那点事儿。

String,是Java中除了基本数据类型以外,最为重要的一个类型了.很多人会认为他比较简单.但是和String有关的面试题有很多,下面我随便找两道面试题,看看你能不能都答对: Q1:String s ...