Logistic Regression Using Gradient Descent -- Binary Classification 代码实现

1. 原理

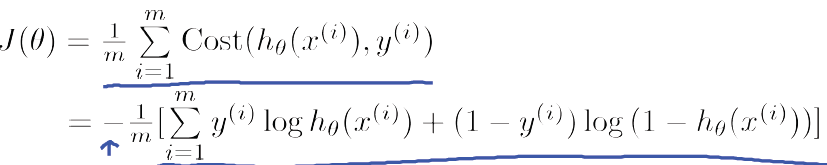

Cost function

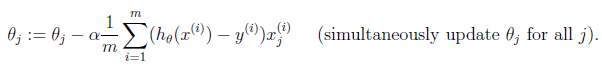

Theta

2. Python

# -*- coding:utf8 -*-

import numpy as np

import matplotlib.pyplot as plt def cost_function(input_X, _y, theta):

"""

cost function of binary classification using logistic regression

:param input_X: np.matrix input X

:param _y: np.matrix y

:param theta: np.matrix theta

"""

m = input_X.shape[0]

z = input_X * theta

h = np.asmatrix(1 / np.asarray(1 + np.exp(-z)))

J = 1.0 / m * (np.log(h) * _y.T + np.log(1 - h) * (1 - _y).T)

return J def gradient_descent(input_X, _y, theta, learning_rate=0.1,

iterate_times=3000):

"""

gradient descent of logistic regression

:param input_X: np.matrix input X

:param _y: np.matrix y

:param theta: np.matrix theta

:param learning_rate: float learning rate

:param iterate_times: int max iteration times

:return: tuple

"""

m = input_X.shape[0]

Js = [] for i in range(iterate_times):

z = input_X * theta

h = np.asmatrix(1 / np.asarray(1 + np.exp(-z)))

errors = h - _y

delta = 1.0 / m * (errors.T * input_X).T

theta -= learning_rate * delta

Js.append(cost_function(input_X, _y, theta)) return theta, Js

3. C++

#include <iostream>

#include <vector>

#include <Eigen/Dense> using namespace std;

using namespace Eigen; double cost_function(MatrixXd &input_X, MatrixXd &_y, MatrixXd &theta):

double m = input_X.rows();

ArrayXd _z = - (input_X * theta).array();

ArrayXd h = 1.0 / (1.0 + _z.exp());

double J = h.log().matrix() * _y.transpose() + \

( - h).log().matrix() * ( - _y.array()).matrix().transpose();

return J class GradientDescent{

public:

GradientDescent(MatrixXd &x, MatrixXd &y, MatrixXd &t, double r,

int i): input_X(x), _y(y), theta(t), learning_rate(r),

iterate_times(i) {}

MatrixXd theta;

vector<double> Js;

void run();

private:

MatrixXd input_X;

MatrixXd _y;

double learning_rate;

int iterate_times;

} void GradientDescent::run() {

double rows = input_X.rows();

for(int i=; i<iterate_times; ++i) {

ArrayXd _z = - (input_X * theta).array();

ArrayXd h = 1.0 / (1.0 + _z.exp());

MatrixXd errors = h.matrix() - y;

MatrixXd delta = 1.0 / rows * (errors.transpose() * input_X).transpose();

theta -= learning_rate * delta;

double J = cost_function(input_X, _y, theta);

Js.push_back(J);

}

}

Logistic Regression Using Gradient Descent -- Binary Classification 代码实现的更多相关文章

- Logistic Regression and Gradient Descent

Logistic Regression and Gradient Descent Logistic regression is an excellent tool to know for classi ...

- Linear Regression Using Gradient Descent 代码实现

参考吴恩达<机器学习>, 进行 Octave, Python(Numpy), C++(Eigen) 的原理实现, 同时用 scikit-learn, TensorFlow, dlib 进行 ...

- 斯坦福机器学习视频笔记 Week1 Linear Regression and Gradient Descent

最近开始学习Coursera上的斯坦福机器学习视频,我是刚刚接触机器学习,对此比较感兴趣:准备将我的学习笔记写下来, 作为我每天学习的签到吧,也希望和各位朋友交流学习. 这一系列的博客,我会不定期的更 ...

- 斯坦福机器学习视频笔记 Week1 线性回归和梯度下降 Linear Regression and Gradient Descent

最近开始学习Coursera上的斯坦福机器学习视频,我是刚刚接触机器学习,对此比较感兴趣:准备将我的学习笔记写下来, 作为我每天学习的签到吧,也希望和各位朋友交流学习. 这一系列的博客,我会不定期的更 ...

- 线性回归、梯度下降(Linear Regression、Gradient Descent)

转载请注明出自BYRans博客:http://www.cnblogs.com/BYRans/ 实例 首先举个例子,假设我们有一个二手房交易记录的数据集,已知房屋面积.卧室数量和房屋的交易价格,如下表: ...

- Linear Regression and Gradient Descent

随着所学算法的增多,加之使用次数的增多,不时对之前所学的算法有新的理解.这篇博文是在2018年4月17日再次编辑,将之前的3篇博文合并为一篇. 1.Problem and Loss Function ...

- Linear Regression and Gradient Descent (English version)

1.Problem and Loss Function Linear Regression is a Supervised Learning Algorithm with input matrix ...

- 【Linear Models for Binary Classification】林轩田机器学习基石

首先回顾了几个Linear Model的共性:都是算出来一个score,然后做某种变化处理. 既然Linear Model有各种好处(训练时间,公式简单),那如何把Linear Regression给 ...

- 机器学习技法:05 Kernel Logistic Regression

Roadmap Soft-Margin SVM as Regularized Model SVM versus Logistic Regression SVM for Soft Binary Clas ...

随机推荐

- 深入学习Make命令和Makefile(下)

https://www.zybuluo.com/lishuhuakai/note/209300 make是Linux下的一款程序自动维护工具,配合makefile的使用,就能够根据程序中模块的修改情况 ...

- Linux下重启mysql的时候出现 start: Job failed to start

mysql进程自己退出了,使用如下指令确认mysql进程不在了. ps -ef | grep mysql 看不到mysql进程 mysql进程不在,尽快回复服务的想法,就是重启服务 /etc/init ...

- Metrics.Net构建指标监控中心

Metrics.NET(https://github.com/etishor/Metrics.NET)是一个给CLR 提供度量工具的包,它是移植自Java的metrics,支持的平台 .NET 4.5 ...

- 关于ASP.NET Web API的ModelBinding杂谈

由于客户端调用Web API传递的数据属性命名一般偏向javascript规范,只是简单的大小写差异没有问题,但始终会有一些特殊情况.比如OAuth的请求: client_id : "val ...

- C程序设计语言习题(3-3)

编写函数expand(s1,s2), 将字符串s1中类似于a-z一类的速记符号在字符串s2中扩展为等价的完整列表abc……xyz.该函数可以处理大小写字母和数字,并可以处理a-b-c.a-z0-9与a ...

- VIM 的一些技巧

vim配置文件 ~/.vimrc 如果没有自己创建一个即可 filetype plugin indent on #打开插件 set number #显示行号 syntax on #语法高亮 set c ...

- 【CF891E】Lust 生成函数

[CF891E]Lust 题意:给你一个长度为n的序列$a_i$,对这个序列进行k次操作,每次随机选择一个1到n的数x,令$res+=\prod\limits_{i!=x}a_i$(一开始res=0) ...

- [吐槽]我为什么讨厌C++

最近在改currennt的代码,我擦擦擦,实在是忍不了了 C++最恶心的地方在于指针引用与面向对象混用!!TMD各种不匹配 举例: template <typename TDevice> ...

- iOS8新特性(2)——UIPopoverController和UIPresentationController

一.以往使用 UIPopoverController 都是只在iPad上使用 /** * UIPopoverController 只能用于iPad,上,iPhone上使用会崩溃 */ -(void)o ...

- 2018上C语言程序设计(高级)作业- 第4次作业

作业要求一 1.设计思路: 第一步:首先通过cmd进行判断 第二步:根据题目写的分别进入不同的判断函数,进行逐一判断: 2.实验代码: #include <stdio.h> #includ ...