MySQL系列:基于binlog的增量订阅与消费(一)

在一些业务场景中,像在数据分析中我们有时候需要捕获数据变化(CDC);在数据审计中,我们也往往需要知道数据从这个点到另一个点的变化;同样在实时分析中,我们有时候需要看到某个值得实时变化等。

要解决以上问题,我们可以实时解析mysql binlog日志,下面两个工具可以很好的处理这个问题:

1. canal(阿里巴巴开源项目,纯java开发)

2. python-mysql-replication(python开发)

使用场景:

1. MySQL到NoSQL的数据同步

2. MySQL到搜索引擎的复制

3. 当数据发生变化是清除数据缓存

4. 数据库审计

5. 实时数据分析

本文主要说说python-mysql-replication。

介绍

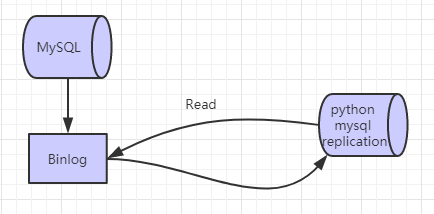

python-mysql-replication是基于MySQL复制原理实现的,把自己伪装成一个slave不断的从MySQL数据库获取binlog并解析。

当前版本(0.15)环境支持:

1. MySQL 5.5/5.6/5.7

2. Python >=2.6

3. Python 3.3/3.4/3.5/3.6(3.2不支持)

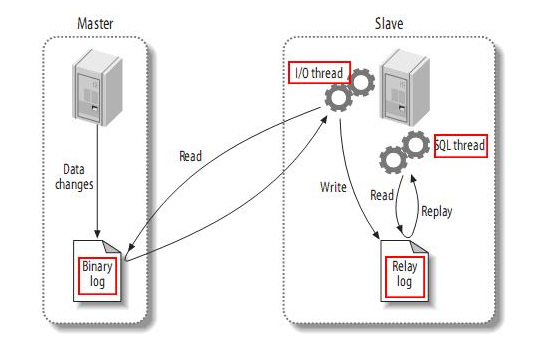

MySQL复制实现:

python-mysql-replication实现:

配置安装

安装软件

[root@mha-maxscale- ~]# pip install mysql-replication

MySQL授权

GRANT SELECT, REPLICATION SLAVE, REPLICATION CLIENT ON *.* TO 'replicator'@'192.168.3.%' IDENTIFIED BY '';

Binlog要满足如下条件

MySQL>root@(none) 09:53:38>show variables like 'log_bin';

+---------------+-------+

| Variable_name | Value |

+---------------+-------+

| log_bin | ON |

+---------------+-------+

1 row in set (0.01 sec) MySQL>show variables like 'binlog_format';

+---------------+-------+

| Variable_name | Value |

+---------------+-------+

| binlog_format | ROW |

+---------------+-------+

1 row in set (0.00 sec) MySQL>show variables like 'binlog_row_image';

+------------------+-------+

| Variable_name | Value |

+------------------+-------+

| binlog_row_image | FULL |

+------------------+-------+

1 row in set (0.00 sec)

示例代码:

[root@mha-maxscale-1 script]# cat mysql-replication.py

#!/usr/bin/env python

# -*- coding: utf-8 -*- from pymysqlreplication import BinLogStreamReader

from pymysqlreplication.row_event import (

DeleteRowsEvent,

UpdateRowsEvent,

WriteRowsEvent,

)

import sys

import json def main():

mysql_settings = {'host': '192.168.3.130',

'port': 3306, 'user': 'replicator', 'passwd': ''}

stream = BinLogStreamReader(

connection_settings=mysql_settings,

server_id=101,

blocking=True,

only_schemas=['zow'],

only_events=[DeleteRowsEvent, WriteRowsEvent, UpdateRowsEvent],

resume_stream=True,

log_file='mysql-bin.000013', log_pos=6197) for binlogevent in stream:

for row in binlogevent.rows:

event = {"schema": binlogevent.schema, "table": binlogevent.table, "log_pos": binlogevent.packet.log_pos}

if isinstance(binlogevent, DeleteRowsEvent):

event["action"] = "delete"

event["values"] = dict(row["values"].items())

event = dict(event.items())

elif isinstance(binlogevent, UpdateRowsEvent):

event["action"] = "update"

event["before_values"] = dict(row["before_values"].items())

event["after_values"] = dict(row["after_values"].items())

event = dict(event.items())

elif isinstance(binlogevent, WriteRowsEvent):

event["action"] = "insert"

event["values"] = dict(row["values"].items())

event = dict(event.items())

print json.dumps(event)

sys.stdout.flush() stream.close() if __name__ == "__main__":

main()

运行结果:

[root@mha-maxscale- script]# python mysql-replication.py

{"action": "insert", "table": "t2", "log_pos": , "values": {"tname": "hh", "id": }, "schema": "zow"}

{"log_pos": , "after_values": {"tname": "ii", "id": }, "action": "update", "table": "t2", "before_values": {"tname": "hh", "id": }, "schema": "zow"}

{"log_pos": , "after_values": {"tname": "ii", "id": }, "action": "update", "table": "t2", "before_values": {"tname": "hh", "id": }, "schema": "zow"}

{"action": "delete", "table": "t2", "log_pos": , "values": {"tname": "ii", "id": }, "schema": "zow"}

{"action": "delete", "table": "t2", "log_pos": , "values": {"tname": "ii", "id": }, "schema": "zow"}

更多例子见:https://github.com/noplay/python-mysql-replication/tree/master/examples

MySQL系列:基于binlog的增量订阅与消费(一)的更多相关文章

- canal —— 阿里巴巴mysql数据库binlog的增量订阅&消费组件

阿里巴巴mysql数据库binlog的增量订阅&消费组件canal ,转载自 https://github.com/alibaba/canal 最新更新 canal QQ讨论群已经建立,群号 ...

- MySQL数据库备份还原(基于binlog的增量备份)

MySQL数据库备份还原(基于binlog的增量备份) 一.简介 1.增量备份 增量备份 是指在一次全备份或上一次增量备份后,以后每次的备份只需备份与前一次相比增加或者被修改的文件.这就意味 ...

- CanalSharp-mysql数据库binlog的增量订阅&消费组件Canal的.NET客户端

一.前言 CanalSharp是阿里巴巴开源项目mysql数据库binlog的增量订阅&消费组件 Canal 的.NET客户端,关于什么是 Canal?又能做什么?我会在后文为大家一一介绍.C ...

- 阿里巴巴开源项目: canal 基于mysql数据库binlog的增量订阅&消费

背景 早期,阿里巴巴B2B公司因为存在杭州和美国双机房部署,存在跨机房同步的业务需求.不过早期的数据库同步业务,主要是基于trigger的方式获取增 量变更,不过从2010年开始,阿里系公司开始逐步的 ...

- 阿里巴巴开源项目: 基于mysql数据库binlog的增量订阅&消费

背景 早期,阿里巴巴B2B公司因为存在杭州和美国双机房部署,存在跨机房同步的业务需求.不过早期的数据库同步业务,主要是基于trigger的方式获取增量变更,不过从2010年开始,阿里系公司开始逐步的尝 ...

- 基于binlog的增量备份

1.1 增量备份简介 增量备份是指在一次全备份或上一次增量备份后,以后每次的备份只需备份与前一次相比增加或者被修改的文件.这就意味着,第一次增量备份的对象是进行全备后所产生的增加和修改的文件:第二次增 ...

- 阿里数据迁移DTS【otter】和阿里巴巴mysql数据库binlog的增量订阅&消费组件 【canal】

[链接]alibaba/otterhttps://github.com/alibaba/otter https://github.com/alibaba/canal

- Mysql 实现基于binlog的主从同步

工作原理 1.主节点必须启用二进制日志,记录任何修改了数据库数据的事件.2.从节点开启一个线程(I/O Thread)把自己扮演成 mysql 的客户端,通过 mysql 协议,请求主节点的二进制日志 ...

- Canal - 数据同步 - 阿里巴巴 MySQL binlog 增量订阅&消费组件

背景 早期,阿里巴巴 B2B 公司因为存在杭州和美国双机房部署,存在跨机房同步的业务需求 ,主要是基于trigger的方式获取增量变更.从 2010 年开始,公司开始逐步尝试数据库日志解析,获取增量变 ...

随机推荐

- Linux系列教程(十三)——Linux软件包管理之源码包、脚本安装包

上篇博客我们讲解了网络yum源和光盘yum源的搭建步骤,然后详细介绍了相关的yum命令,yum 最重要是解决了软件包依赖性问题.在安装软件时,我们使用yum命令将会简单方便很多.我们知道yum命令只能 ...

- Python爬虫入门:爬虫基础了解

有粉丝私信我想让我出更基础一些的,我就把之前平台的copy下来了,可以粗略看一下,之后都会慢慢出. 1.什么是爬虫 爬虫,即网络爬虫,大家可以理解为在网络上爬行的一直蜘蛛,互联网就比作一张大网,而爬虫 ...

- Struts2开发文档

struts2配置 struts2核心配置文件约束 <!DOCTYPE struts PUBLIC "-//Apache Software Foundation//DTD Struts ...

- 学Java的前景与就业,资深程序员教你怎么开始学Java!

IT行业一直是就业的热门岗位,程序员这个职业稳定性和收入比都有着不错的前景,那么学Java的前景和就业是什么样的呢?随着入行Java的准程序员越来越多,各种学习Java的流派也层出不穷!其实在编程的世 ...

- Linux服务器上安装vsftpd

1.首先判断你服务器上是否安装了vsftpd rpm -q vsftpd 2.安装vsftpd yum -y install vsftpd 3.重启vsftpd service vsftpd ...

- IpHelper根据客户端IP进行网站分流

public class IpHelper { // 核心方法:IP搜索 /// <summary> /// 查找IP所属地区,确保web.c ...

- Celery 源码解析五: 远程控制管理

今天要聊的话题可能被大家关注得不过,但是对于 Celery 来说确实很有用的功能,曾经我在工作中遇到这类情况,就是我们将所有的任务都放在同一个队列里面,然后有一天突然某个同学的代码写得不对,导致大量的 ...

- ES6中class关键字

1 .介绍 //定义类 class Point { constructor(x, y) { this.x = x; this.y = y; } toString() { return '(' + th ...

- MySql的虚拟机和Xshell5的连接过程

给大家介绍一下虚拟机和Xshell5连接的基本配置1.安装虚拟机,跟着提示一步一步安装即可,注意添加镜像文件,虚拟机就完成了.2.下载一个Xshell5,安装好之后.要修改虚拟机的网卡状态 1) ...

- markdown简述

前端开发的工具 编辑器: 1. 轻量级的,依靠插件:sublime:atom(github):vs code(miscrosaft) 2. 集成的:DW:webstorm:hbuild ...