scrapy爬取某网站,模拟登陆过程中遇到的那些坑

本节内容

在访问网站的时候,我们经常遇到有些页面必须用户登录才能访问。这个时候我们之前写的傻傻的爬虫就被ban在门外了。所以本节,我们给爬虫配置cookie,使得爬虫能保持用户已登录的状态,达到获得那些需登录才能访问的页面的目的。

由于本节只是单纯的想保持一下登陆状态,所以就不写复杂的获取页面了,还是像本教程的第一部分一样,下载个网站主页验证一下就ok了。本节github戳此处。

原理

一般情况下,网站通过存放在客户端的一个被称作cookie的小文件来存放用户的登陆信息。在浏览器访问网站的时候,会把这个小文件发往服务器,然后服务器根据这个小文件确定你的身份,然后返回给你特定的信息。

我们要做的就是尽量模拟浏览器的行为,在使用爬虫访问网站时也带上cookie来访问。

前提

前提当然是你有个账号了,目前本教程一直使用的论坛心韵论坛是我本人搭建的,已经被各种爬虫发的广告水的不要不要的了,为了本教程,仍然是开放注册并一直开着服。但不保证会一直开着,不过根据本教程的讲解,爬取别的Discuz框架论坛一般是没问题的。扯远了……

获取cookie

按照以下步骤操作

- 登陆论坛,进入主页

- 按F12进入Chrome或Firefox的开发者调试工具,选择Network选项卡

- 按F5刷新一下页面

- 选择Doc子选项卡

- 找到主页的请求和返回情况

- 找到Request Headers

- 复制出cookie

如图:

把cookie转化格式

在scrapy中,设置cookie需要是字典格式的,可是我们从浏览器Copy出来的是字符串格式的,所以我们需要写个小程序来转化一下

transCookie.py

# -*- coding: utf-8 -*-

class transCookie:

def __init__(self, cookie):

self.cookie = cookie

def stringToDict(self):

'''

将从浏览器上Copy来的cookie字符串转化为Scrapy能使用的Dict

:return:

'''

itemDict = {}

items = self.cookie.split(';')

for item in items:

key = item.split('=')[0].replace(' ', '')

value = item.split('=')[1]

itemDict[key] = value

return itemDict

if __name__ == "__main__":

cookie = "你复制出的cookie"

trans = transCookie(cookie)

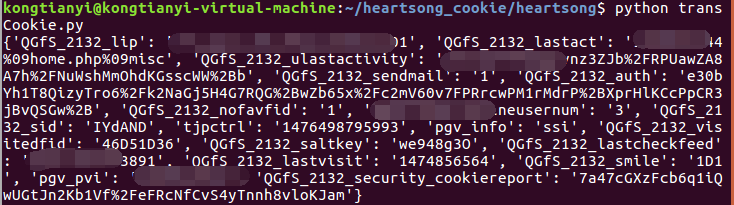

print trans.stringToDict()运行的效果如图

然后把这个字典复制出来。

给scrapy配置cookie

首先把刚才得到的cookie放到settings.py里

settings.py

# -*- coding: utf-8 -*-

BOT_NAME = 'heartsong'

SPIDER_MODULES = ['heartsong.spiders']

NEWSPIDER_MODULE = 'heartsong.spiders'

ROBOTSTXT_OBEY = False # 不遵守Robot协议

# 使用transCookie.py翻译出的Cookie字典

COOKIE = {'key1': 'value1', 'key2': 'value2'}然后编写爬虫文件

heartsong_spider.py

# -*- coding: utf-8 -*-

# import scrapy # 可以用这句代替下面三句,但不推荐

from scrapy.spiders import Spider

from scrapy import Request

from scrapy.conf import settings

class HeartsongSpider(Spider):

name = "heartsong"

allowed_domains = ["heartsong.top"] # 允许爬取的域名,非此域名的网页不会爬取

start_urls = [

# 主页,此例只下载主页,看是否有登录信息

"http://www.heartsong.top/forum.php"

]

cookie = settings['COOKIE'] # 带着Cookie向网页发请求

# 发送给服务器的http头信息,有的网站需要伪装出浏览器头进行爬取,有的则不需要

headers = {

'Connection': 'keep - alive', # 保持链接状态

'User-Agent': 'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/52.0.2743.82 Safari/537.36'

}

# 对请求的返回进行处理的配置

meta = {

'dont_redirect': True, # 禁止网页重定向

'handle_httpstatus_list': [301, 302] # 对哪些异常返回进行处理

}

# 爬虫的起点

def start_requests(self):

# 带着cookie向网站服务器发请求,表明我们是一个已登录的用户

yield Request(self.start_urls[0], callback=self.parse, cookies=self.cookie,

headers=self.headers, meta=self.meta)

# Request请求的默认回调函数

def parse(self, response):

with open("check.html", "wb") as f:

f.write(response.body) # 把下载的网页存入文件总的来说一句话,就是带着cookie发起Request请求。

运行之后会将主页保存,我们打开文件查看一下效果

小结

本节介绍了cookie的获取方法和如何给scrapy设置cookie,下节我会介绍如果带着登陆状态去回复主题帖。

scrapy爬取某网站,模拟登陆过程中遇到的那些坑的更多相关文章

- 使用webdriver+urllib爬取网页数据(模拟登陆,过验证码)

urilib是python的标准库,当我们使用Python爬取网页数据时,往往用的是urllib模块,通过调用urllib模块的urlopen(url)方法返回网页对象,并使用read()方法获得ur ...

- Python 爬取 "王者荣耀.英雄壁纸" 过程中的矛和盾

1. 前言 学习爬虫,最好的方式就是自己编写爬虫程序. 爬取目标网站上的数据,理论上讲是简单的,无非就是分析页面中的资源链接.然后下载.最后保存. 但是在实施过程却会遇到一些阻碍. 很多网站为了阻止爬 ...

- 1.scrapy爬取的数据保存到es中

先建立es的mapping,也就是建立在es中建立一个空的Index,代码如下:执行后就会在es建lagou 这个index. from datetime import datetime fr ...

- 使用Scrapy爬取图书网站信息

重难点:使用scrapy获取的数值是unicode类型,保存到json文件时需要特别注意处理一下,具体请参考链接:https://www.cnblogs.com/sanduzxcvbnm/p/1030 ...

- Scrapy 爬取某网站图片

1. 创建一个 Scrapy 项目,在命令行或者 Pycharm 的 Terminal 中输入: scrapy startproject imagepix 自动生成了下列文件: 2. 在 imagep ...

- scrapy爬取招聘网站,items转换成dict遇到的问题

pipelines代码 1 import json 2 3 class TencentJsonPipeline(object): 4 def __init__(self): 5 self.file = ...

- scrapy爬取美女图片

使用scrapy爬取整个网站的图片数据.并且使用 CrawlerProcess 启动. 1 # -*- coding: utf-8 -* 2 import scrapy 3 import reques ...

- Python网络爬虫 | Scrapy爬取妹子图网站全站照片

根据现有的知识,写了一个下载妹子图(meizitu.com)Scrapy脚本,把全站两万多张照片下载到了本地. 网站的分析 网页的网址分析 打开网站,发现网页的网址都是以 http://www.mei ...

- scrapy爬取西刺网站ip

# scrapy爬取西刺网站ip # -*- coding: utf-8 -*- import scrapy from xici.items import XiciItem class Xicispi ...

随机推荐

- CentOS下bond网卡聚合与网桥结合

需求:服务器配置bond多网卡聚合,然后KVM需要使用到网桥,那么需要做到网桥绑定到bond网卡上. 实现核心: 1.bond配置参考:https://www.cnblogs.com/EasonJim ...

- [Android Pro] Android P版本 新功能介绍和兼容性处理(三)Android Studio 3.0 ~ 3.2 其他特性

cp : https://blog.csdn.net/yi_master/article/details/80067198 1:JAVA8特性支持 1)Base64.java 在升级到as3.0之后, ...

- 通俗理解word2vec

https://www.jianshu.com/p/471d9bfbd72f 独热编码 独热编码即 One-Hot 编码,又称一位有效编码,其方法是使用N位状态寄存器来对N个状态进行编码,每个状态都有 ...

- [Canvas]空战游戏进阶 增加发射子弹 敌机中弹爆炸功能

点此下载源码. 图例: 源码: <!DOCTYPE html> <html lang="utf-8"> <meta http-equiv=" ...

- [Java] HashMap 源码简要分析

特性 * 允许null作为key/value. * 不保证按照插入的顺序输出.使用hash构造的映射一般来讲是无序的. * 非线程安全. * 内部原理与Hashtable类似. 源码简要分析 pu ...

- org.hibernate.PropertyAccessException: Null value was assigned to a property of primitive type setter of com.*.Paper.totalTime

at org.hibernate.property.BasicPropertyAccessor$BasicSetter.set(BasicPropertyAccessor.java:109) at o ...

- pid 控制算法

http://blog.csdn.net/huangkangying/article/details/78129148 https://zh.wikipedia.org/wiki/PID%E6%8E% ...

- 【阿里巴巴Java开发手册——集合处理】13.集合的稳定性(order)和有序性(sort)

有序性(sort):指遍历的结果是按照某种比较规则依次排列的. 稳定性(order):指集合每次遍历的元素的次序是一定的. 如:ArrayList是order/unsort HashMap是unord ...

- js获取过滤条件中参数的快捷方式

// window.location.href = "topupRecordController.do?exportExcel&" + encodeURI($(" ...

- 【概念原理】四种SQL事务隔离级别和事务ACID特性

摘要: SQL事务隔离级别和事务的ACID特性 事务是一组读写操作,并且具有只有所有操作都成功才算成功的特性. 事务隔离级别 SQL事务隔离级别由弱到强分别是:READ_UNCOMMITTED.R ...