K8s二进制部署单节点 etcd集群,flannel网络配置 ——锥刺股

K8s 二进制部署单节点 master ——锥刺股

k8s集群搭建:

- etcd集群

- flannel网络插件

- 搭建master组件

- 搭建node组件

1、部署etcd集群

2、Flannel 网络配置

etcd作为服务发现系统,有以下的特点:

- 简单 安装配置简单,而且提供了HTTP API进行交互,使用也很简单

- 安全: 支持SSL证书验证

- 快速: 单实例支持每秒2k+读操作

- 可靠: 采用raft算法实现分布式系统数据的可用性和一致性

etcd 默认使用2379 端口对外为客户端提供通讯,使用端口2380来进行服务器内部通讯。

etcd 再生产环境中一般推荐集群方式部署,由于etcd的leader选举机制,要求至少3台或以上奇数台。

准备签发证书环境:

CFSSL是CloudFlare 公司开源的一款PKI/TLS工具。CESSL 包含一个命令行工具和一个用于签名、验证和捆绑TLS证书的HTTP API服务。使用Go语言编写。

CFSSL使用配置文件生成证书,因此自签之前,需要生成它识别的json 格式的配置文件,CFSSL 提供了方便的命令行生成配置文件。

CFSSL用来为etcd提供TLS证书,它支持签三种类型的证书:

1、client证书,服务端连接客户端时携带的证书,用于客户端验证服务端身份,如kube-apiserver 访问etcd;

2、server证书,客户端连接服务端时携带的证书,用于服务端验证客户端身份,如etcd对外提供服务:

3、peer证书,相互之间连接时使用的证书,如etcd节点之间进行验证和通信。

这里全部都使用同一套证书认证。

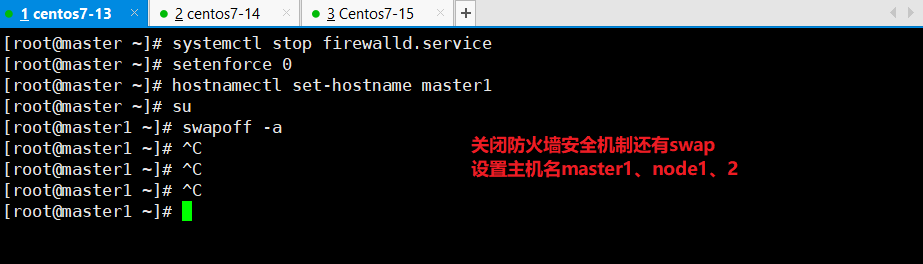

环境部署:3台都要做

systemctl stop firewalld

serenforce 0 hostnamectl set-hostname master1(node1、2)

sed -rn 's/.*swap.*/#&/p' /etc/fstab

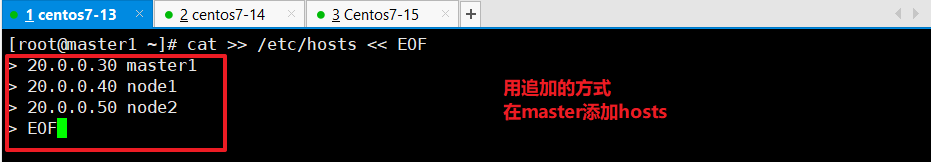

swapoff -a cat >> /etc/hosts << EOF

20.0.0.30 master1

20.0.0.40 node1

20.0.0.50 node2

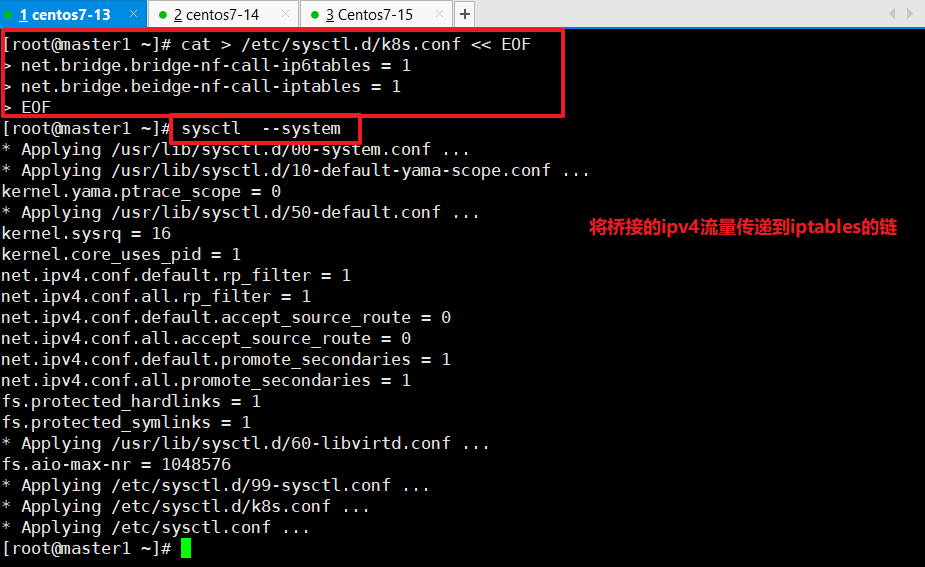

EOF cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.beidge-nf-call-iptables = 1

EOF sysctl --system

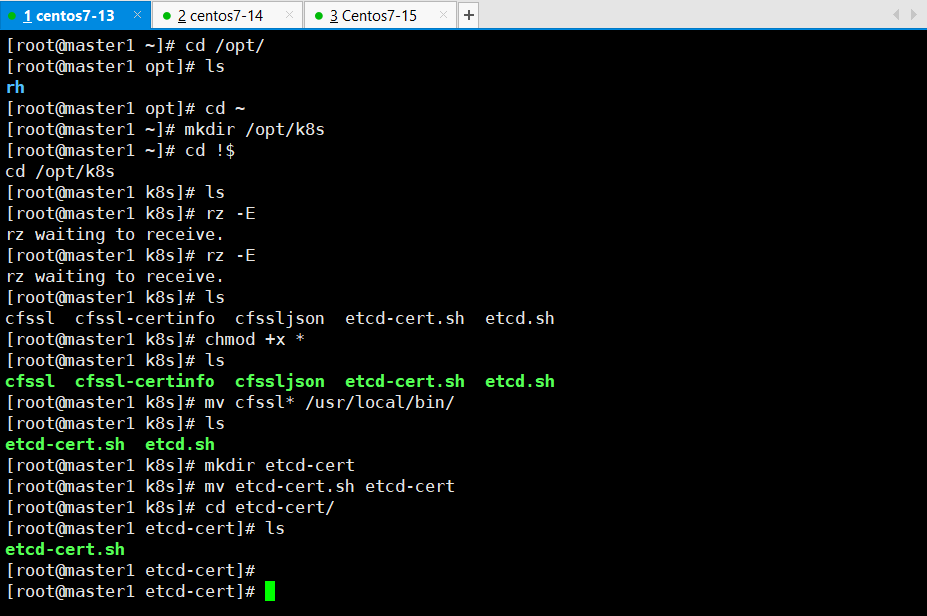

1、部署 etcd 集群:

1)、master 节点部署:

mkdir /opt/k8s

cd /opt/k8s

rz-E 把所需的软件配置穿进去

chmod +x*

mv etcd-cert.sh etcd-cert

cd etcd-cert/

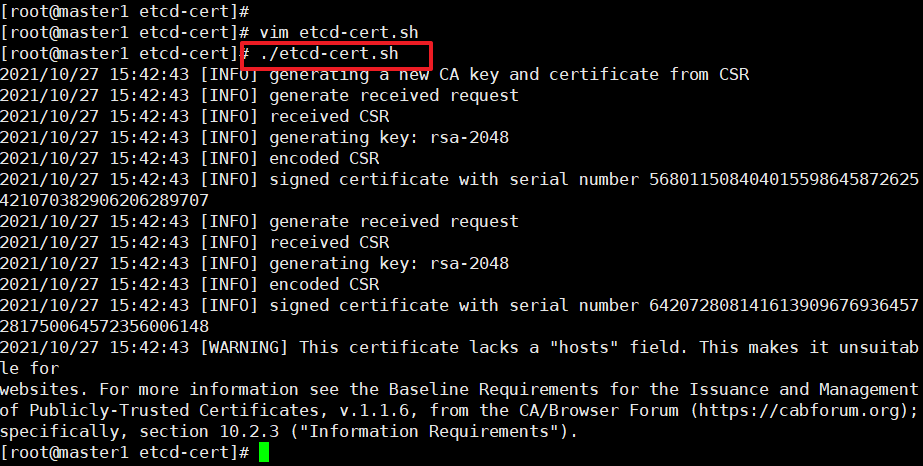

vim etcd-cert.sh 进去把ip改一下

./etcd-cert.sh

cd /opt/k8s

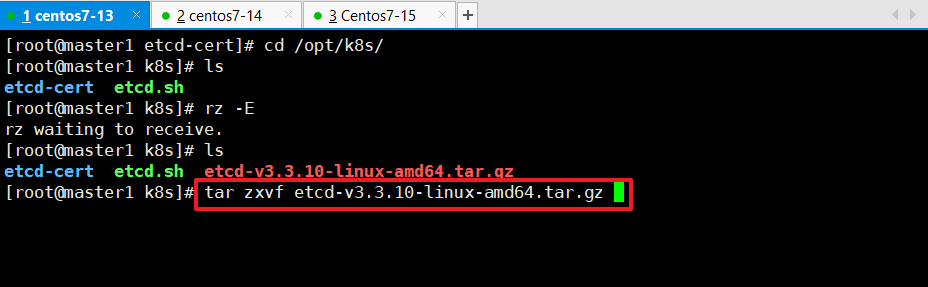

rz-E 把etcd-v3.3.10版本传进去顺便解压 ls etcd-v3.3.10-linux-amd64

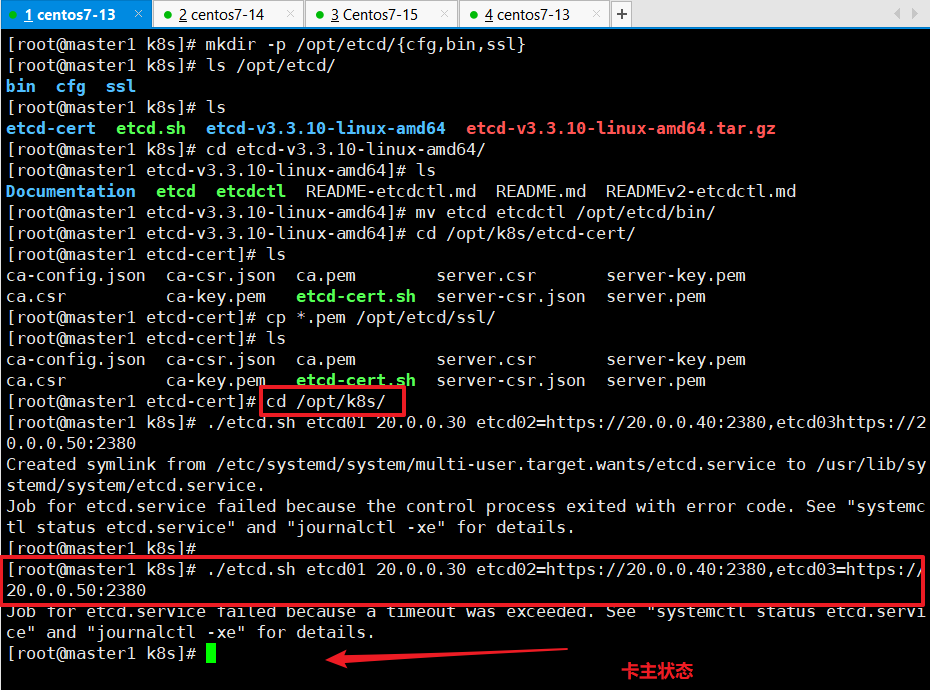

mkdir -p /opt/etcd/{cfg,bin,ssl}

cd etcd-v3.3.10-linux-amd64/

cp *.pem /opt/etcd/ssl/

cd /opt/k8s/

./etcd.sh etcd01 20.0.0.30 etcd02=https://20.0.0.40:2380,etcd03=https://20.0.0.50:2380

//进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

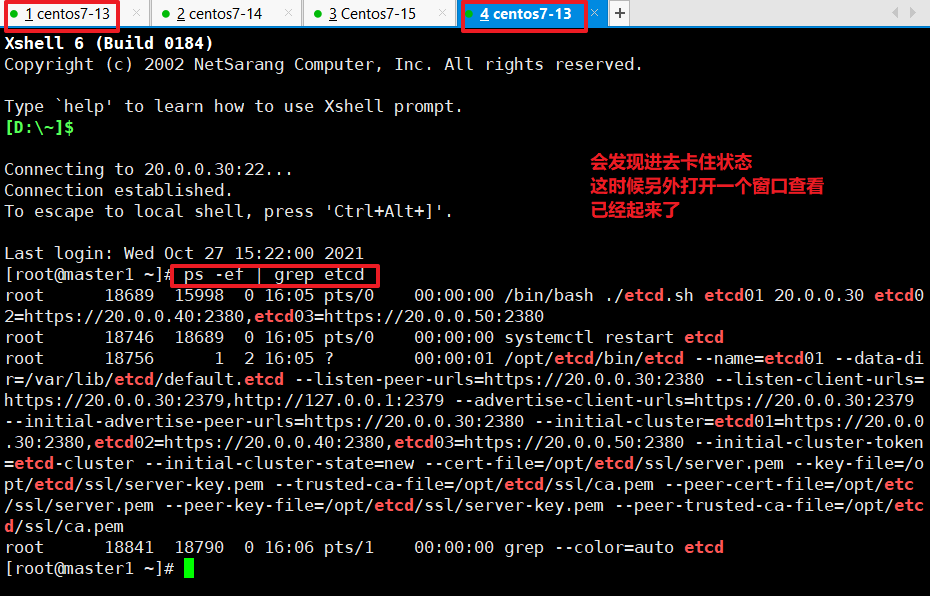

/另外打开一个窗口查看etcd进程是否正常

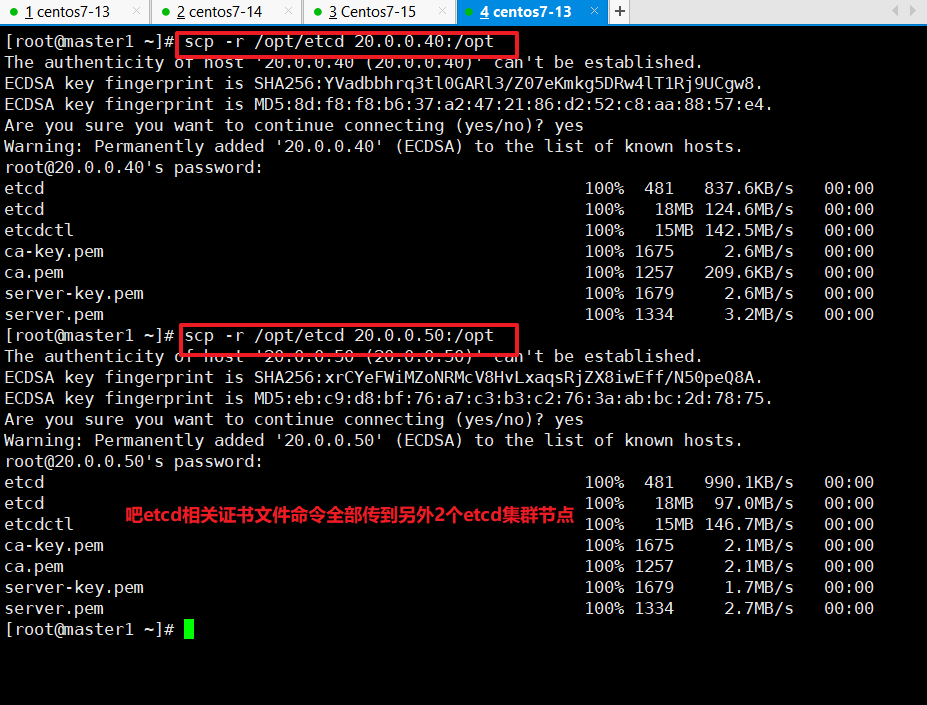

ps -ef | grep etcd 把etcd相关证书文件和命令文件全部拷贝到另外两个etcd集群节点

scp -r /opt/etcd 20.0.0.40:/opt

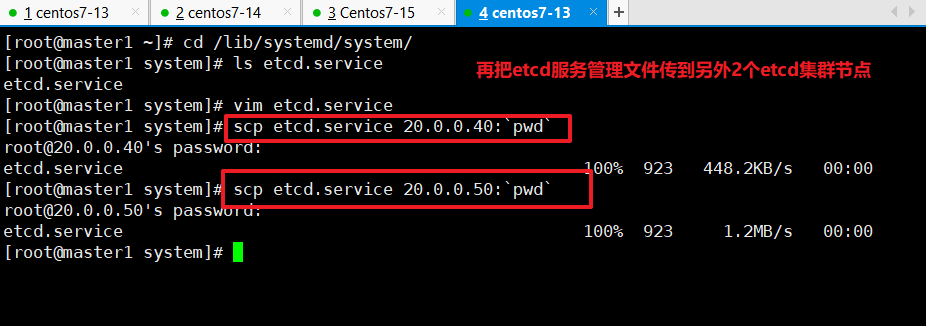

scp -r /opt/etcd 20.0.0.50:/opt 把etcd服务管理文件拷贝到另外两个etcd集群节点

scp /usr/lib/systemd/system/etcd.service root@20.0.0.40:/usr/lib/systemd/system/

scp /usr/lib/systemd/system/etcd.service root@20.0.0.50:/usr/lib/systemd/system/

2)、node1、2节点修改:

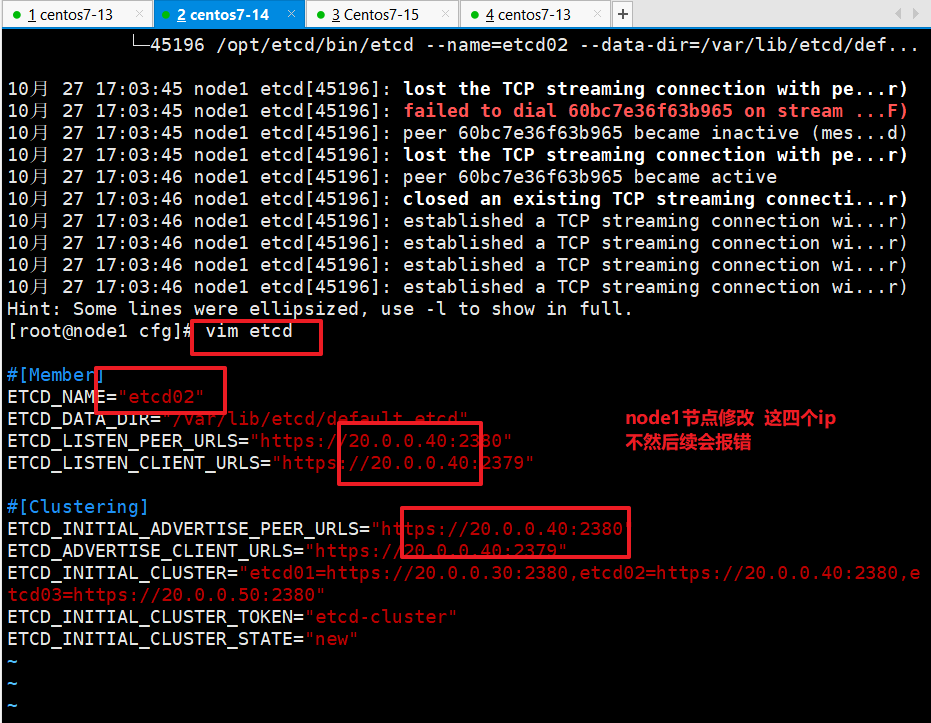

======在node1节点修改======

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://20.0.0.40:2380"

ETCD_LISTEN_CLIENT_URLS="https://20.0.0.40:2379" #[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://20.0.0.40:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://20.0.0.30:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://20.0.0.30:2380,etcd02=https://20.0.0.40:2380,etcd03=https://20.0.0.50:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

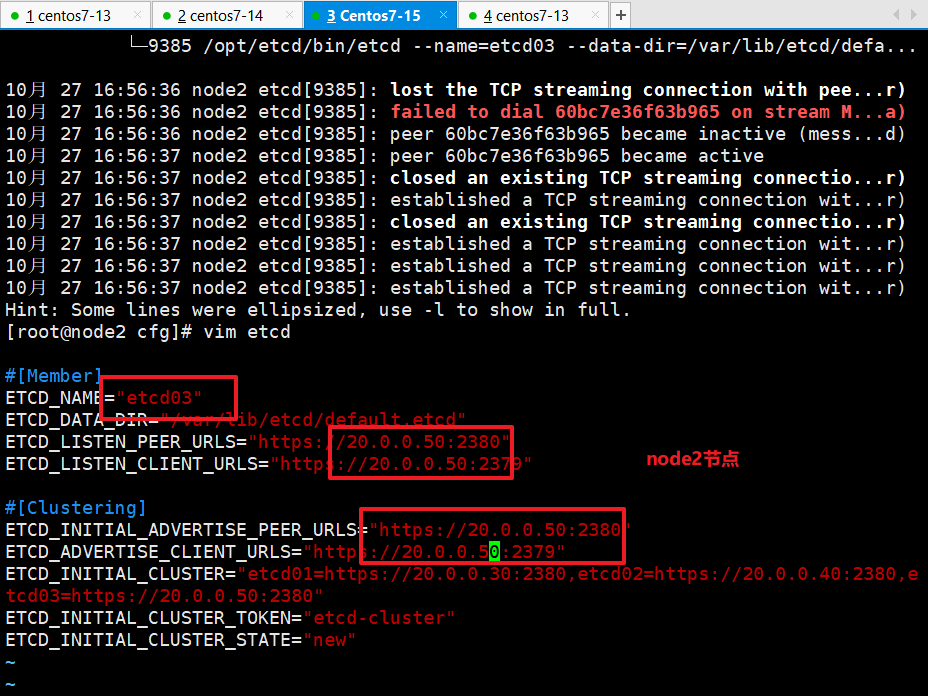

ETCD_INITIAL_CLUSTER_STATE="new" ======在node2节点修改======

cd /opt/etcd/cfg/

vim etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://20.0.0.50:2380"

ETCD_LISTEN_CLIENT_URLS="https://20.0.0.50:2379" #[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://20.0.0.50:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://20.0.0.30:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://20.0.0.30:2380,etcd02=https://20.0.0.40:2380,etcd03=https://20.0.0.50:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

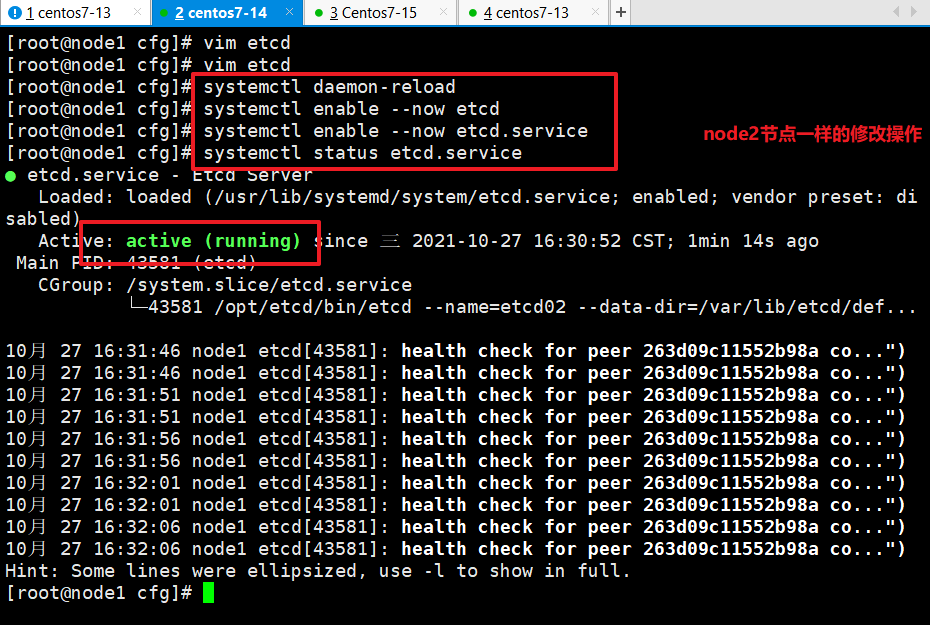

ETCD_INITIAL_CLUSTER_STATE="new" 修改完都要重载然后再查看状态

systemctl daemon-reload

systemctl enable --now etcd.service

systemctl status etcd.service

3)、在master1节点上进行启动:

首先要在master节点和node1、2节点都启动etcd

======在master1 节点上操作======

ln -s /opt/etcd/bin/etcd* /usr/1oca1/bin

进去ssl目录

cd /opt/etcd/ssl

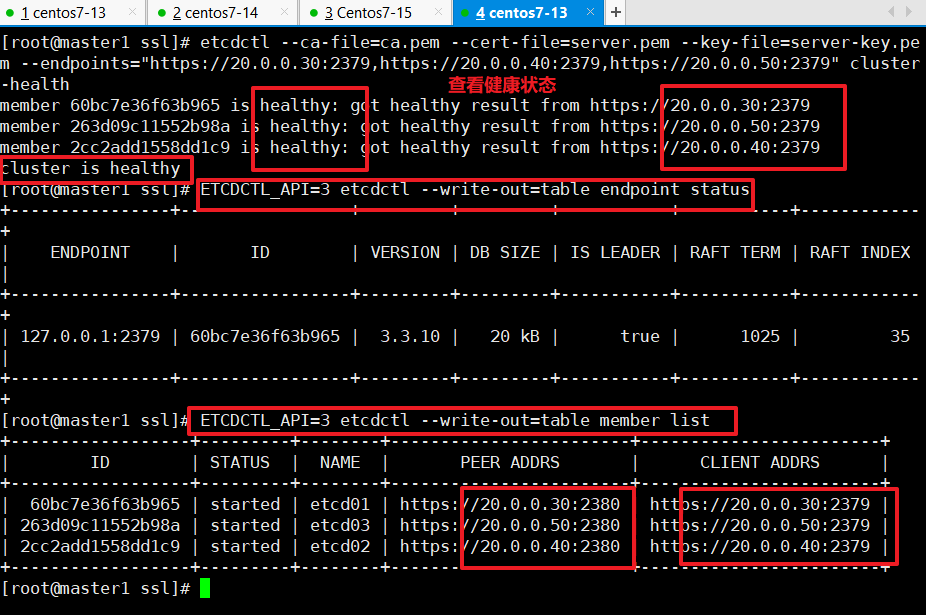

//检查etcd群集状态

etcdctl \

--ca-file=ca.pem \

--cert-file=server.pem \

--key-file=server-key.pem \

--endpoints="https://20.0.0.30:2379,https://20.0.0.40:2379,https://20.0.0.50:2379" \

cluster-health -----------------------------------------------

--cert-file:识别HTTPS端使用sSL证书文件

--key-file: 使用此SSL密钥文件标识HTTPS客户端

-ca-file:使用此CA证书验证启用https的服务器的证书

--endpoints:集群中以逗号分隔的机器地址列表

cluster-health:检查etcd集群的运行状况

----------------------------------------------- //切换到etcd3版本查看集群节点状态和成员列表

export ETCDCTL_API=3

#v2和v3命令略有不同,etcd2 和etcd3也是不兼容的,默认是v2版本

etcdctl --write-out=table endpoint status

etcdctl --write-out-table member list

export ETCDCTL_API=2

#再切回v2版本

所有node节点部署docker引擎 yum install -y yum-utils device-mapper-persistent-data lvm2 #设置阿里云镜像源

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo #安装 Docker-CE并设置为开机自动启动

yum install -y docker-ce systemctl start docker.service

systemctl enable docker.service

2、flannel网络配置:

===========flannel网络配置=============

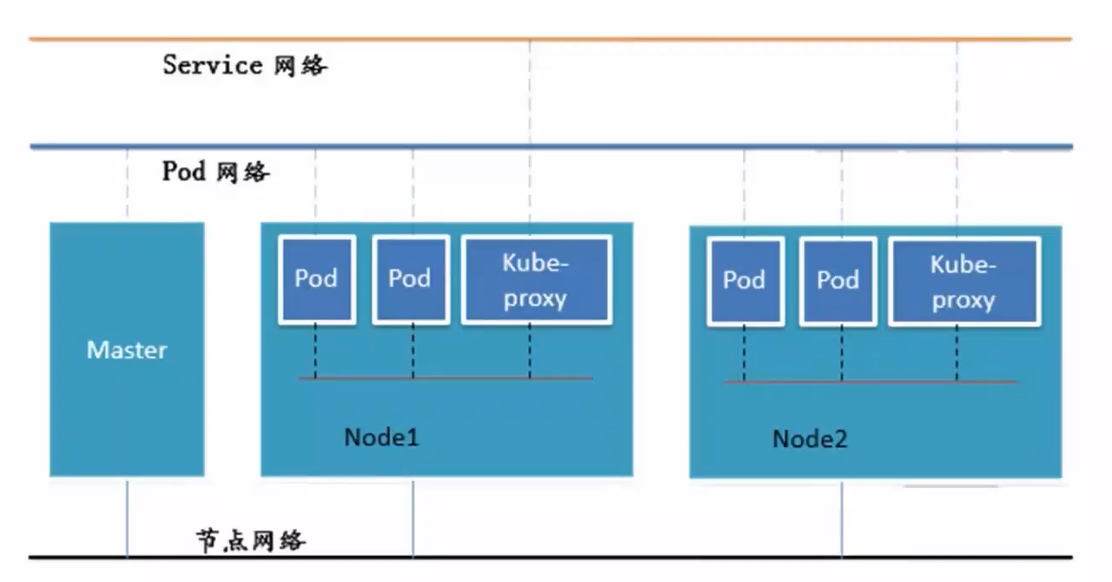

===K8S中Pod网络通信: ===

●Pod内容器与容器之间的通信

在同一个Pod内的容器(Pod内的容器是不会跨宿主机的)共享同一个网络命令空间,相当于它们在网一台机器上一样,可以用

localhost地址访间彼此的端口 ●同一个Node内Pod之间的通信

每个Pod 都有一个真实的全局IP地址,同一个Node 内的不同Pod之间可以直接采用对方Pod的IP 地址进行通信,Pod1 与

Pod2都是通过veth连接到同一个docker0 网桥,网段相同,所以它们之间可以直接通信 ●不同Node上Pod之间的通信

Pod地址与docker0 在同一网段,dockor0 网段与宿主机网卡是两个不同的网段,且不同Nodo之间的通信贝能通过宿主机的物理网卡进行 要想实现不同Node 上Pod之间的通信,就必须想办法通过主机的物理网卡IP地址进行寻址和通信。

因此要满足两个条件:

Pod 的IP不能冲突:

将Pod的IP和所在的Node的IP关联起来,通过这个关联让不同Node上Pod之间直接通过内网IP地址通信。 ===Overlay Network:===

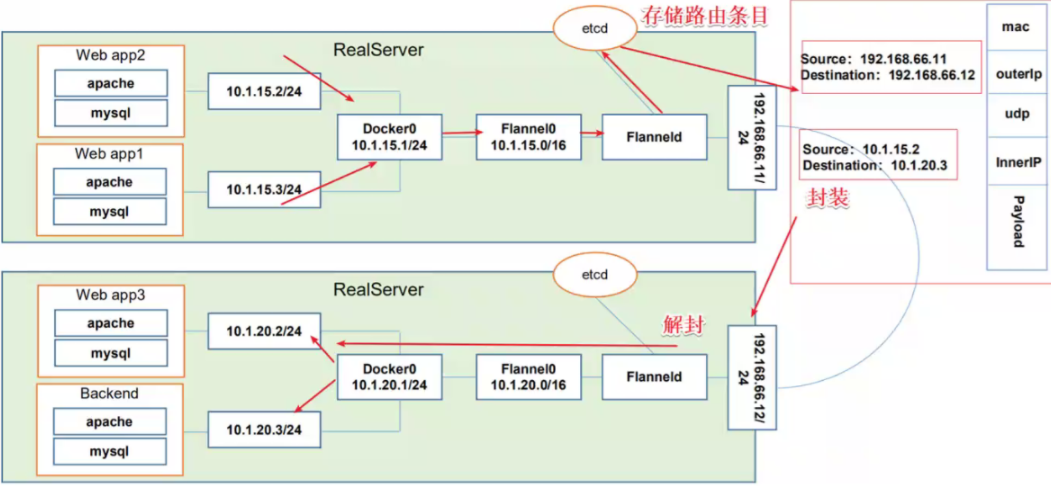

叠加网络,在二层或者三层基础网络上叠加的一种虚拟网络技术模式,该网络中的主机通过虚拟链路隧道连接起来(类似于VPN) ===VXLAN:===

将源数据包封装到UDP中,并使用基础网络的IP/MAC作为外层报文头进行封装,然后在以太网上传输,到达目的地后由隧道端点解封装并将数据发送给目标地址 ===Flannel:===

Flannel的功能是让集群中的不同节点主机创建的Docker容器都具有全集群唯一的虚拟IP地址 Flannel是Overlay 网络的一种,也是将TCP 源数据包封装在另一种网络 包里而进行路由转发和通信,目前己经支持UDP、VXLAN、AwS VPC等数据转发方式 ===ETCD之Flannel 提供说明:===

存储管理Flanne1可分配的IP地址段资源

监控ETCD中每个Pod 的实际地址,并在内存中建立维护Pod 节点路由表

Flannel工作原理:

node1上的pod1 要和node2上的pod1进行通信 1.数据从node1上的Pod1源容器中发出,经由所在主机的docker0 虚拟网卡转发到flannel0虚拟网卡; 2.再由flanneld把pod ip封装到udp中(里面封装的是源pod IP和目的pod IP); 3.根据在etcd保存的路由表信息,通过物理网卡发送给目的node2的flanneld,来进行解封装暴露出udp里的pod IP; 4.最后根据目的pod IP经flannel0虚拟网卡和docker0虚拟网卡转发到目的pod中,最后完成通信

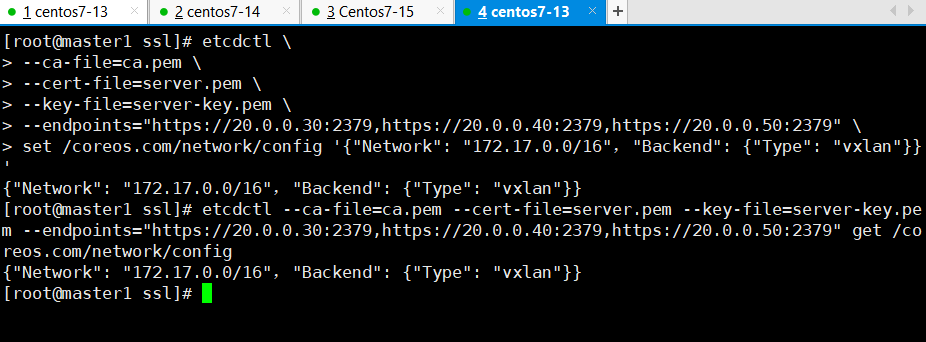

1)、在master1节点上操作添加flannel 网络配置:

======在master1 节点上操作======

//添加flannel 网络配置信息,写入分配的子网段到etcd 中,供flannel使用

cd /opt/etcd/ss1

etcdctl \

--ca-file=ca.pem \

--cert-file=server.pem \

--key-file=server-key.pem \

--endpoints="https://20.0.0.30:2379,https://20.0.0.40:2379,https://20.0.0.50:2379" \

set /coreos.com/network/config '{"Network": "172.17.0.0/16","Backend": {"Type": "vxlan"}}' //查看写入的信息

etcdctl \

--ca-file=ca.pem \

--cert-file-server.pem \

--key-file=server-key.pem \

--endpoints="https://20.0.0.30:2379,https://20.0.0.40:2379,https://20.0.0.50:2379" \

get /coreos.com/network/config ---------------------------------------------------------

set /coreos.com/network/confiq添加一条网络配置记求,这个配置将用于flannel分配给每个docker的虛拟IP地址段

get <ckey>

got /coreos.com/octwork/config获取网络配置记录,后面不用再跟参数了

Network:用于指定Flane1地址池

Backend:用于指定数据包以什么方式转发,默认为udp模式,Backend为vxlan比起预设的udp性能相对好一些

--------------------------------------------------------

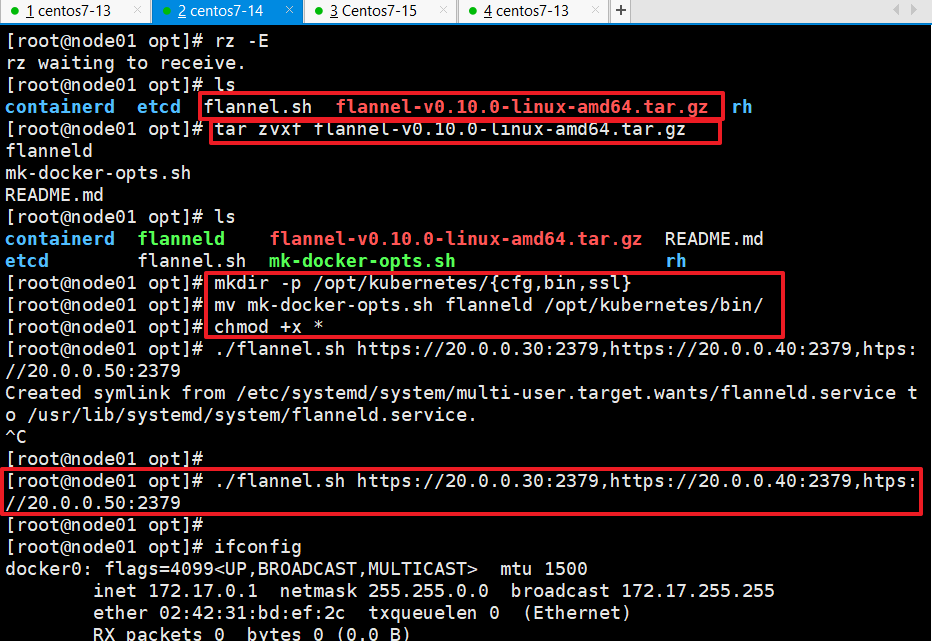

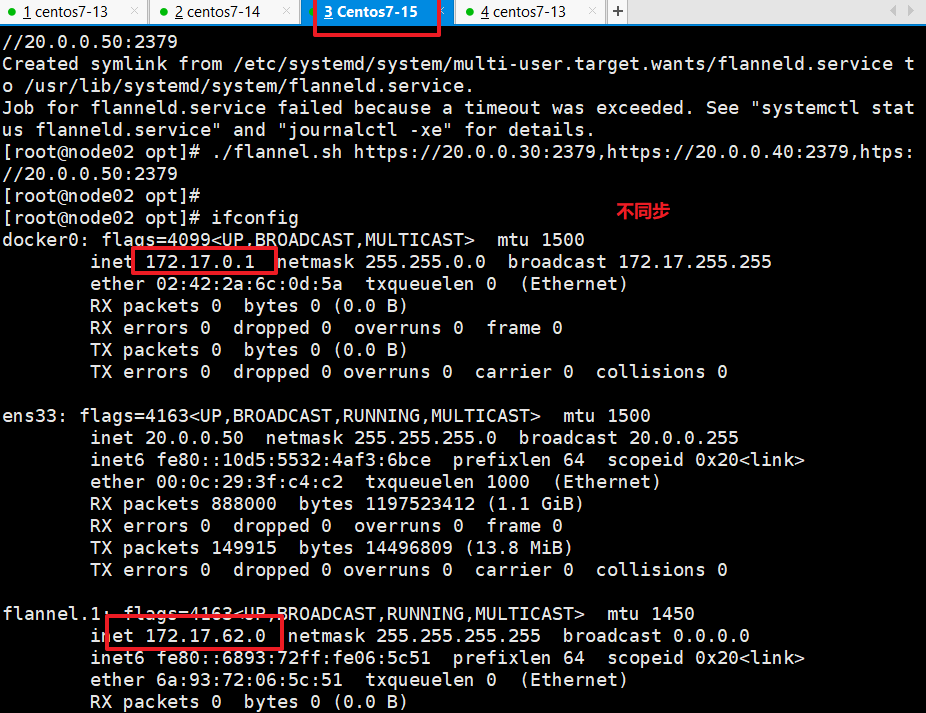

2)、在所有node节点上操作:

======在所有node节点上操作======

//上传flannel.sh 和flanne1-v0.10.0-1inux-amd64.tar.gz 到/opt 目录中,解压flannel 压缩包

cd /opt

tar zxvf flannel-v0.10.0-1inux-amd64.tar.gz

flanneld

#flanneld为主要的执行文件

mk-docker-opts.sh

#mk-docker-opts . sh脚本用于生成Docker启动参数

README.md //创建kubernetes工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ss1}

cd /opt

mv mk-docker-opts.sh flanneld /opt/kubernetes/bin/ //启动flanneld服务,开启flanne1网络功能

cd /opt

chmod +x flannel.sh

./flannel.sh https://20.0.0.30:2379,https://20.0.0.40:2379,https://20.0.0.50:2379 //flanne1启动后会生成一个docker网络相关信息配置文件/run/flannel/subnet.env,包含了docker要使用flannel通讯的相关参数

cat /run/flannel/subnet.env

DOCKER_OPT_BIP="--bip=172.17.26.1/24"

DOCKER_OPT_IPMASQ="--ip-masq= false"

DOCKER_OPT_MTU="--mtu=1450"

DOCKER_NETWORK_OPTIONS=" --bip=172.17.26.1/24 --ip-masq=false --mtu=1450"

------------------------------------------------

--bi: 指定docker 启动时的子网

--ip-masq: 设置ipmasq=false 关闭snat 伪装策略

--mtu=1450:mtu要留出50字节给外层的vxlan封包的额外开销使用

Flannel启动过程解析:

1、从etcd中获取network的配置信息

2、划分subnet, 并在etcd中进行注册

3、将子网信息记录到/run/flannel/subnet.env中

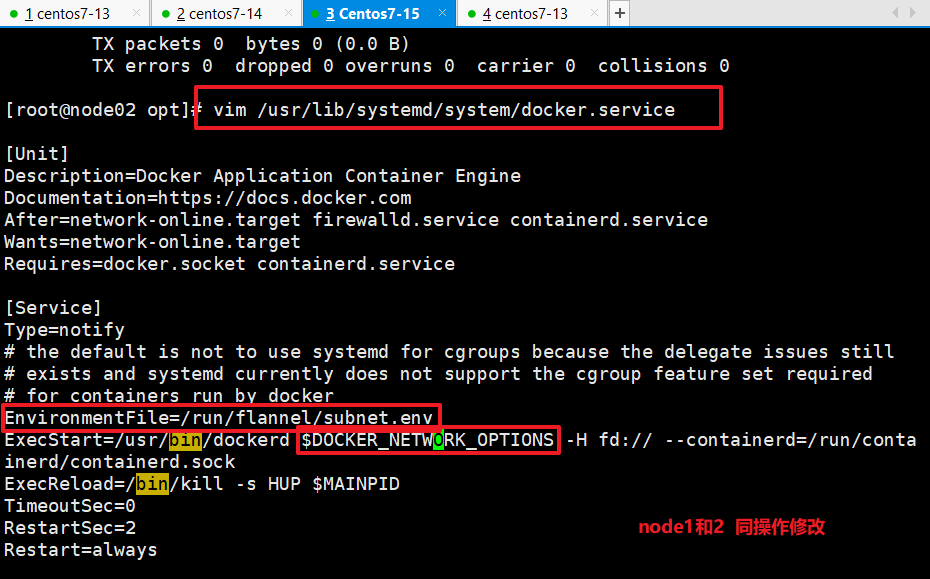

------------------------------------------------ //修改docker服务管理文件,配置docker连接flannel

vim /lib/systemd/system/docker.service

[Service]

Type=notify

# the default is not to use systemd for cgroups because the delegate issues stillt

# exists and systemd currently dges not support the cgroup feature set requi red

# for containers run by docker

EnvironmentFile=/run/flannel/subnet.env

#添加

ExecStart=/usr/bin/dockerd $DOCKER_NETWORK_OPTIONS -H fd:// --containerd=/run/containerd/containerd.sock

#修改

ExecReload=/bin/kill -s HUP $MAINPID

TimeoutSec=0

RestartSec=2

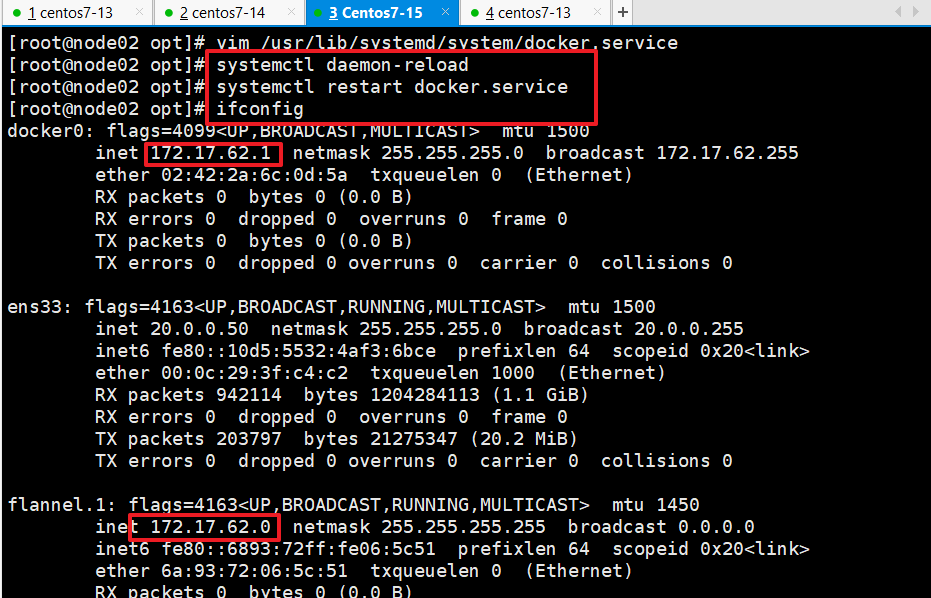

Restart=always //重启docker服务

systemctl daemon-reload

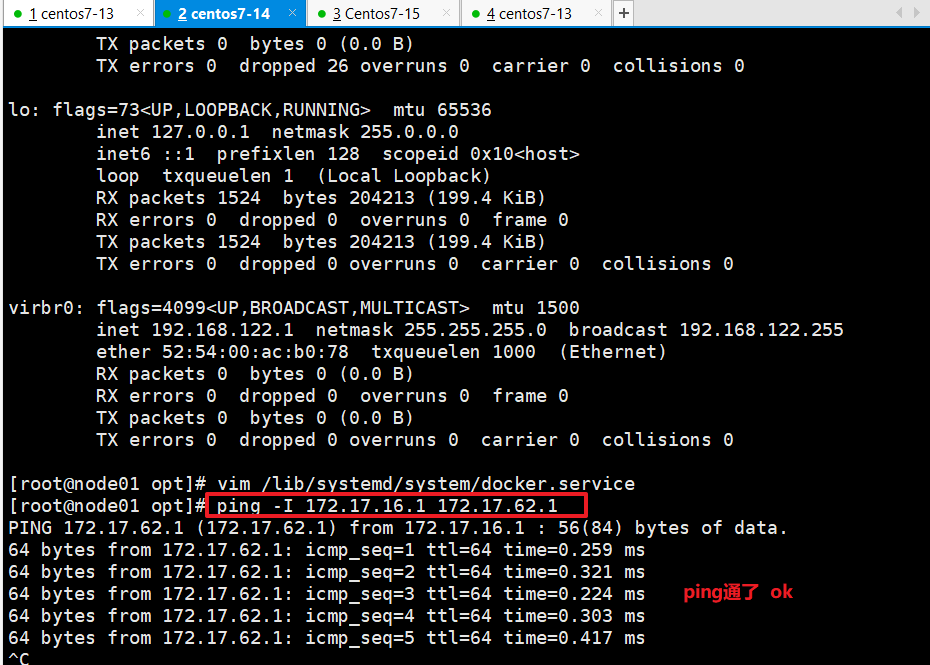

systemctl restart docker ifconfig #查看flannel网络 测试ping通对方docker0网卡 证明flannel起到路由作用

ping 172.17.38.1 docker run -it centos:7 /bin/bash #node1和node2都运行该命令 yum install net-tools -y #node1和node2都运行该命令 ifconfig //再次测试ping通两个node中的centos:7容器

总结:

flannel的工作流程

数据从源node节点的pod发出后,会经由dockero网卡转发到flannel0网卡,

在flanel0网卡有个flanneld服务会把这个数据包封装到udp报文中,然后根据自己在etcd中维护路由表

通过物理网卡转发到目标node节点,数据包到达目标node节点后会被flanneld服务解封装,

然后经由flannel0网卡和dockero网卡转发到目标pod的容器,最后完成通信

K8s二进制部署单节点 etcd集群,flannel网络配置 ——锥刺股的更多相关文章

- K8s二进制部署单节点 master组件 node组件 ——头悬梁

K8s二进制部署单节点 master组件 node组件 --头悬梁 1.master组件部署 2.node 组件部署 k8s集群搭建: etcd集群 flannel网络插件 搭建maste ...

- 使用Minikube运行一个本地单节点Kubernetes集群(阿里云)

使用Minikube运行一个本地单节点Kubernetes集群中使用谷歌官方镜像由于某些原因导致镜像拉取失败以及很多人并没有代理无法开展相关实验. 因此本文使用阿里云提供的修改版Minikube创建一 ...

- Kubernetes 二进制部署(二)集群部署(多 Master 节点通过 Nginx 负载均衡)

0. 前言 紧接上一篇,本篇文章我们尝试学习多节点部署 kubernetes 集群 并通过 haproxy+keepalived 实现 Master 节点的负载均衡 1. 实验环境 实验环境主要为 5 ...

- 来了,老弟!__二进制部署kubernetes1.11.7集群

Kubernetes容器集群管理 Kubernetes介绍 Kubernetes是Google在2014年6月开源的一个容器集群管理系统,使用Go语言开发,Kubernetes也叫K8S.K8S是Go ...

- 二进制部署Kubernetes-v1.14.1集群

一.部署Kubernetes集群 1.1 Kubernetes介绍 Kubernetes(K8S)是Google开源的容器集群管理系统,K8S在Docker容器技术的基础之上,大大地提高了容器化部署应 ...

- kubeadm 线上集群部署(一) 外部 ETCD 集群搭建

IP Hostname 192.168.1.23 k8s-etcd-01 etcd集群节点,默认关于ETCD所有操作均在此节点上操作 192.168.1.24 k8s-etcd-02 etcd ...

- 在 Linux 部署多节点 Kubernetes 集群与 KubeSphere 容器平台

KubeSphere 是在 Kubernetes 之上构建的以应用为中心的企业级容器平台,所有供为用户提供简单易用的操作界面以及向导式操作方式.同时,KubeSphere Installer 提供了 ...

- 使用k8s operator安装和维护etcd集群

关于Kubernetes Operator这个新生事物,可以参考下文来了解这一技术的来龙去脉: https://yq.aliyun.com/articles/685522?utm_content=g_ ...

- ActiveMQ的单节点和集群部署

平安寿险消息队列用的是ActiveMQ. 单节点部署: 下载解压后,直接cd到bin目录,用activemq start命令就可启动activemq服务端了. ActiveMQ默认采用61616端口提 ...

随机推荐

- Java常用的开发库推荐

我是3y,一年CRUD经验用十年的markdown程序员 今天来讲讲来给大家聊聊开发提速的东西了:工具包.Lombok和常用库 01.什么是工具包 基本上,每个项目里都有一个包,叫做utils.这个 ...

- Pytest_Hook钩子函数总结(14)

前言 pytest 的钩子函数有很多,通过钩子函数的学习可以了解到pytest在执行用例的每个阶段做什么事情,也方便后续对pytest二次开发学习.详细文档可以查看pytest官方文档https:// ...

- Struts2的jsonp接口实例

和以往写struts2程序一样,action方法跳转到一个JSP中,为了配合jsonp的跨域,要在JSP中做一个输出 JSP: <%@ page language="java" ...

- java集合【13】——— Stack源码分析走一波

前言 集合源码分析系列:Java集合源码分析 前面已经把Vector,ArrayList,LinkedList分析完了,本来是想开始Map这一块,但是看了下面这个接口设计框架图:整个接口框架关系如下( ...

- 用格里高利公式求给定精度的PI值

本题要求编写程序,计算序列部分和 4∗(1−1/3+1/5−1/7+...) ,直到最后一项的绝对值小于给定精度eps. 输入格式: 输入在一行中给出一个正实数eps. 输出格式: 在一行中按照&qu ...

- 【Java】IntelliJ IDEA 快捷键

IntelliJ IDEA 快捷键 1. Editing(编辑) 快捷键 介绍 Ctrl +Space 基本代码补全,输入字母按后列出匹配的词组 Ctrl+Shift+Space 智能代码补全,列出与 ...

- 【VictoriaMetrics】vm-select源码阅读

调用层次表格 源文件 行号 函数 说明 app/vmselect/main.go 63 main 入口 92行调用 requestHandler app/vmselect/main.go 132 -r ...

- ROS Kinetic 使用PocketSphinx进行语音识别报错

已解决,重启电脑,装环境把声卡驱动那些似乎死机了 ROS Kinetic 使用PocketSphinx进行语音识别教程 https://www.ncnynl.com/archives/201701/ ...

- 宣布与Epic Games合作,为虚幻引擎创造Cesium

Cesium中文网:http://cesiumcn.org/ | 国内快速访问:http://cesium.coinidea.com/ 没有什么能比支持史诗游戏和史诗巨无霸计划(Epic MegaGr ...

- sql中常用到的GUID

在项目的数据库中经常见到如下所示的列: 列名:**_id 数据类型:UNIQUEIDENTIFIER 默认:NEWID() ROWGUIDCOL 属性. 其实这样的列通常为表的主键,函数NEWID() ...