python爬虫——selenium+chrome使用代理

先看下本文中的知识点:

- python selenium库安装

- chrome webdirver的下载安装

- selenium+chrome使用代理

- 进阶学习

搭建开发环境:

- selenium库

- chrome webdirver

- 谷歌浏览器 >=7.9

PS:安装了的同学可以跳过了接着下一步,没安装的同学跟着我的步骤走一遍

安装selenium库

pip install selenium

安装chrome webdirver

这里要注意要配置系统环境,把chrome webdirver解压后放到python路径的Scripts目录下,跟pip在一个目录下。

这里可以教大家一个查看python安装路径的命令

# windows系统,打开cmd

where python

# linux系统

whereis python

谷歌浏览器

注意谷歌浏览器的版本要>=7.9,因为之前下载的chrome webdirver是7.9版本的。浏览器就自己安装吧。

代码样例

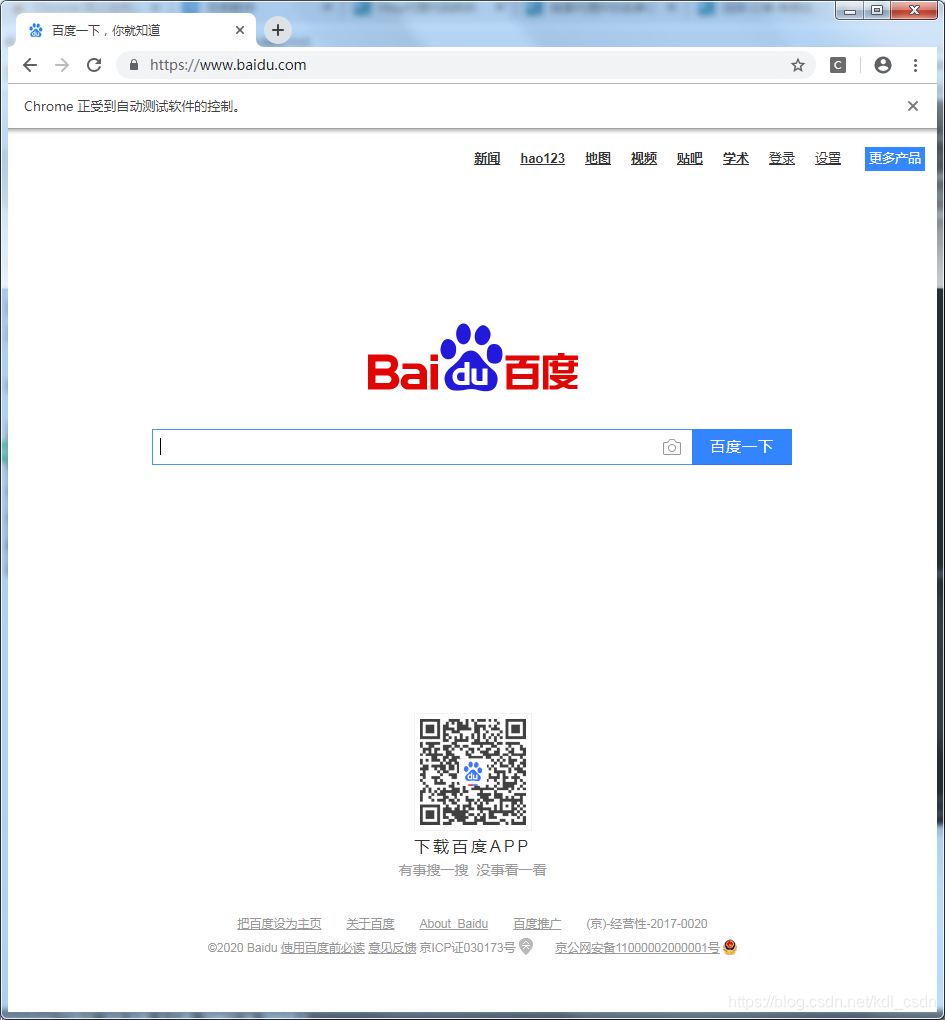

好的,现在咋们的环境都配置好了,写几行代码试下,以请求百度为例

from selenium import webdriver

# 用webdriver的chrome浏览器打开

chrome = webdriver.Chrome()

chrome.get('https://www.baidu.com')

print(chrome.page_source)

chrome.quit() #退出

运行下,先会打开chrome浏览器,然后访问百度,在打印page信息,最后关闭浏览器

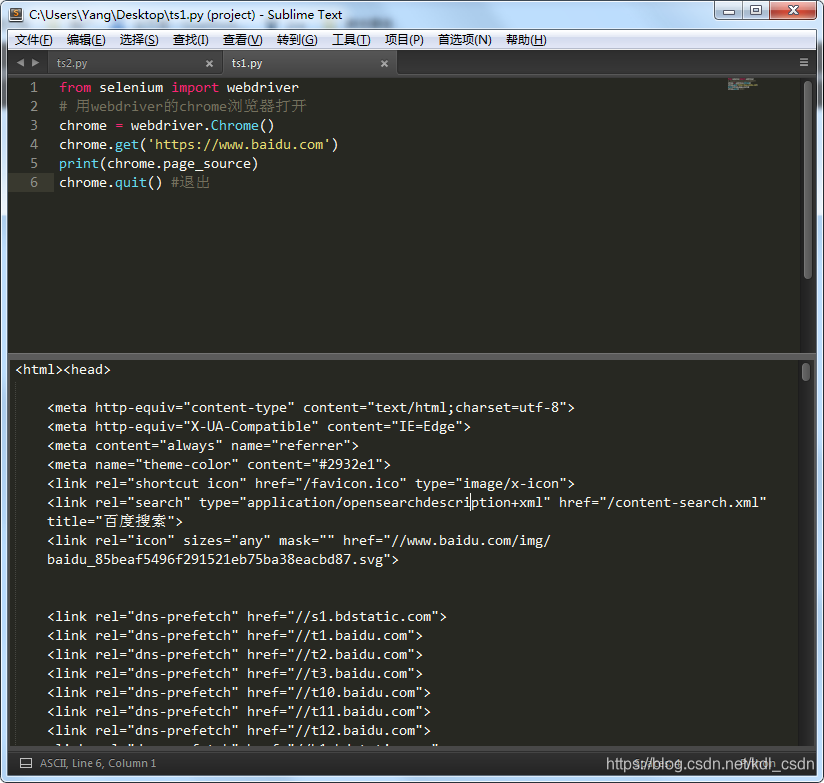

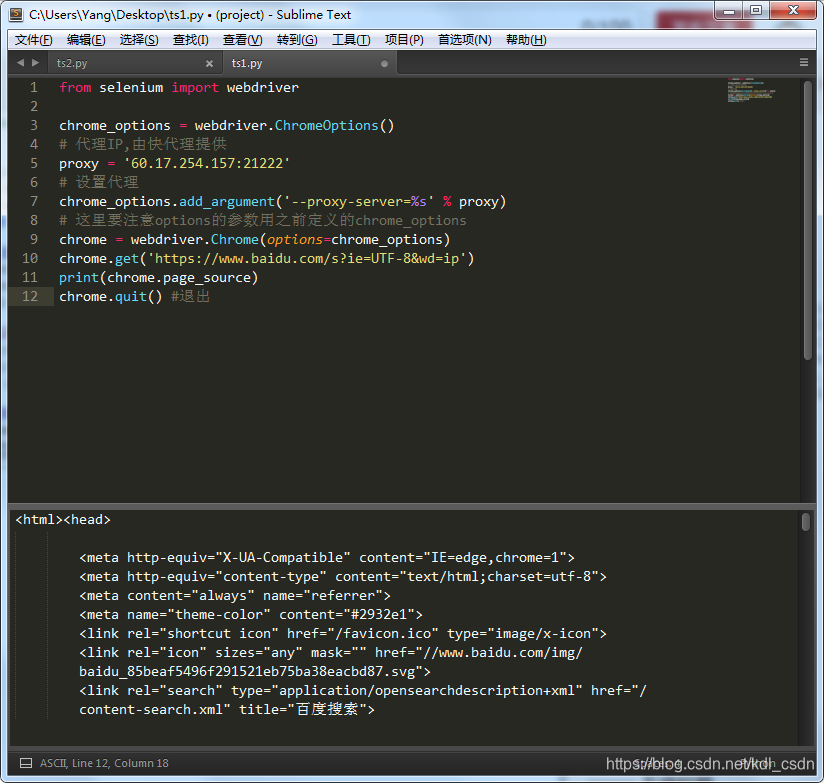

使用代理

使用代理IP去访问就得加一个参数了,代码如下

from selenium import webdriver

chrome_options = webdriver.ChromeOptions()

# 代理IP,由快代理提供

proxy = '60.17.254.157:21222'

# 设置代理

chrome_options.add_argument('--proxy-server=%s' % proxy)

# 注意options的参数用之前定义的chrome_options

chrome = webdriver.Chrome(options=chrome_options)

# 百度查IP

chrome.get('https://www.baidu.com/s?ie=UTF-8&wd=ip')

print(chrome.page_source)

chrome.quit() #退出

运行下,结果如图

扩展

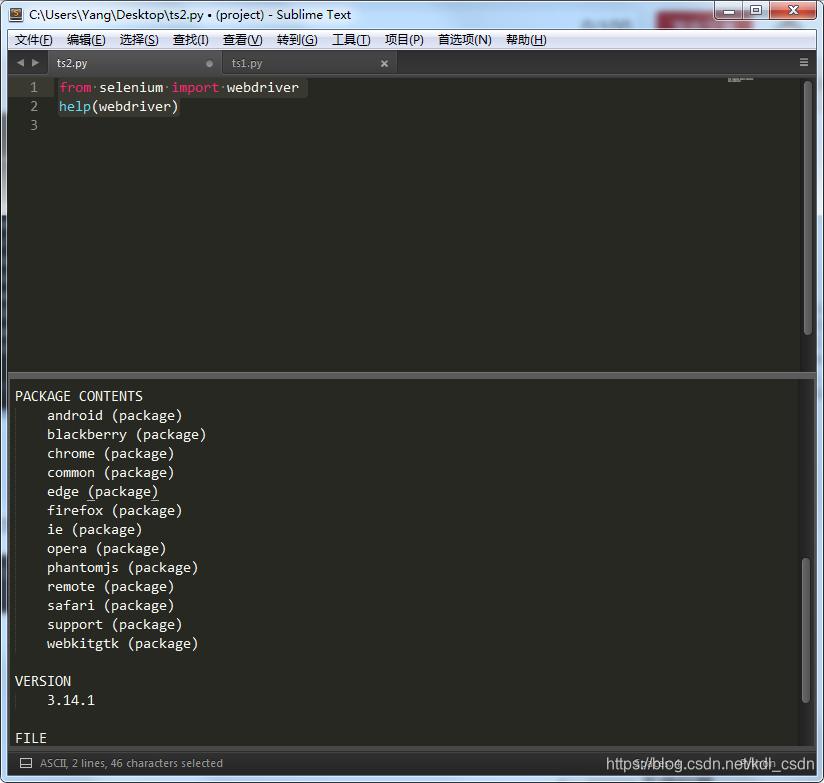

不想用谷歌浏览器啊,想用火狐怎么办。没问题啊,webdriver也支持火狐。看下webdriver的帮助文档

from selenium import webdriver

help(webdriver)

看下图,不止支持火狐firefox,谷歌chrome,ie,opera等等都支持的。

进阶学习

python爬虫——selenium+chrome使用代理的更多相关文章

- python爬虫——selenium+firefox使用代理

本文中的知识点: python selenium库安装 firefox geckodriver的下载与安装 selenium+firefox使用代理 进阶学习 搭建开发环境: selenium库 fi ...

- [Python爬虫] Selenium实现自动登录163邮箱和Locating Elements介绍

前三篇文章介绍了安装过程和通过Selenium实现访问Firefox浏览器并自动搜索"Eastmount"关键字及截图的功能.而这篇文章主要简单介绍如何实现自动登录163邮箱,同时 ...

- [Python爬虫] Selenium+Phantomjs动态获取CSDN下载资源信息和评论

前面几篇文章介绍了Selenium.PhantomJS的基础知识及安装过程,这篇文章是一篇应用.通过Selenium调用Phantomjs获取CSDN下载资源的信息,最重要的是动态获取资源的评论,它是 ...

- [Python爬虫] Selenium爬取新浪微博客户端用户信息、热点话题及评论 (上)

转载自:http://blog.csdn.net/eastmount/article/details/51231852 一. 文章介绍 源码下载地址:http://download.csdn.net/ ...

- python爬虫---selenium库的用法

python爬虫---selenium库的用法 selenium是一个自动化测试工具,支持Firefox,Chrome等众多浏览器 在爬虫中的应用主要是用来解决JS渲染的问题. 1.使用前需要安装这个 ...

- [python爬虫] Selenium常见元素定位方法和操作的学习介绍

这篇文章主要Selenium+Python自动测试或爬虫中的常见定位方法.鼠标操作.键盘操作介绍,希望该篇基础性文章对你有所帮助,如果有错误或不足之处,请海涵~同时CSDN总是屏蔽这篇文章,再加上最近 ...

- Python爬虫-selenium的使用(2)

使用selenium打开chrome浏览器百度进行搜索 12345678910111213141516171819202122232425 from selenium import webdriver ...

- [Python爬虫] Selenium获取百度百科旅游景点的InfoBox消息盒

前面我讲述过如何通过BeautifulSoup获取维基百科的消息盒,同样可以通过Spider获取网站内容,最近学习了Selenium+Phantomjs后,准备利用它们获取百度百科的旅游景点消息盒(I ...

- [python爬虫] Selenium常见元素定位方法和操作的学习介绍(转载)

转载地址:[python爬虫] Selenium常见元素定位方法和操作的学习介绍 一. 定位元素方法 官网地址:http://selenium-python.readthedocs.org/locat ...

随机推荐

- python基础六之编码

python中编码的特点: 1,各个编码之间的二进制是不能互相识别的,会产生乱码 2,文件的储存和传输是不能用Unicode的 python3的编码 在python3中字符串在内存中是用Unicode ...

- Vue 双向数据绑定v-model

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- 1471 - Defense Lines

After the last war devastated your country, you - as the king of the land of Ardenia - decided it wa ...

- junit 测试套件Suite

junit测试套件,就是可以运行一个测试类使得一个或一些测试类被junit测试运行 见代码: 测试套件类: import org.junit.runner.RunWith; import org.ju ...

- 使用git命令修改commit提交信息

很多时候我们在提交代码时可能会把commit提交信息写错了,这个时候我们就可以用到下面的git命令来修改commit提交信息 git commit --amend 输入"i"之后进 ...

- 【一起学源码-微服务】Nexflix Eureka 源码六:在眼花缭乱的代码中,EurekaClient是如何注册的?

前言 上一讲已经讲解了EurekaClient的启动流程,到了这里已经有6篇Eureka源码分析的文章了,看了下之前的文章,感觉代码成分太多,会影响阅读,后面会只截取主要的代码,加上注释讲解. 这一讲 ...

- 开发API整理(转)

附送一个 android 源码 查看地址 http://grepcode.com/project/repository.grepcode.com/java/ext/com.google.android ...

- Mysql(超级详细)

Mysql(超级详细) (黑小子-余) 一.Mysql介绍 MySQL是一个关系型数据库管理系统,由瑞典MySQL AB 公司开发,属于 Oracle 旗下产品.MySQL 是最流行的关系型数据库管理 ...

- 支撑百万级并发,Netty如何实现高性能内存管理

Netty作为一款高性能网络应用程序框架,实现了一套高性能内存管理机制 通过学习其中的实现原理.算法.并发设计,有利于我们写出更优雅.更高性能的代码:当使用Netty时碰到内存方面的问题时,也可以更高 ...

- 微服务Dubbo和SpringCloud架构设计、优劣势比较

本文主要围绕微服务的技术选型.通讯协议.服务依赖模式.开始模式.运行模式等几方面来综合比较Dubbo和Spring Cloud 这2种开发框架.架构师可以根据公司的技术实力并结合项目的特点来选择某个合 ...