Spark之开窗函数

一.简介

开窗函数row_number()是按照某个字段分组,然后取另外一个字段排序的前几个值的函数,相当于分组topN。如果SQL语句里面使用了开窗函数,那么这个SQL语句必须使用HiveContext执行。

二.代码实践【使用HiveContext】

package big.data.analyse.sparksql

import org.apache.log4j.{Level, Logger}

import org.apache.spark.sql.types.{IntegerType, StringType, StructField, StructType}

import org.apache.spark.sql.{Row, SparkSession}

/**

* Created by zhen on 2019/7/6.

*/

object RowNumber {

/**

* 设置日志级别

*/

Logger.getLogger("org").setLevel(Level.WARN)

def main(args: Array[String]) {

/**

* 创建spark入口,支持Hive

*/

val spark = SparkSession.builder().appName("RowNumber")

.master("local[2]").enableHiveSupport().getOrCreate()

/**

* 创建测试数据

*/

val array = Array("1,Hadoop,12","5,Spark,6","3,Solr,15","3,HBase,8","6,Hive,16","6,TensorFlow,26")

val rdd = spark.sparkContext.parallelize(array).map{ row =>

val Array(id, name, age) = row.split(",")

Row(id, name, age.toInt)

}

val structType = new StructType(Array(

StructField("id", StringType, true),

StructField("name", StringType, true),

StructField("age", IntegerType, true)

))

/**

* 转化为df

*/

val df = spark.createDataFrame(rdd, structType)

df.show()

df.createOrReplaceTempView("technology")

/**

* 应用开窗函数row_number

* 注意:开窗函数只能在hiveContext下使用

*/

val result_1 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 1")

result_1.show()

val result_2 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 2")

result_2.show()

val result_3 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 3")

result_3.show()

val result_4 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top > 3")

result_4.show()

}

}

三.结果【使用HiveContext】

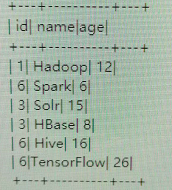

1.初始数据

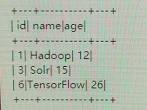

2.top<=1时

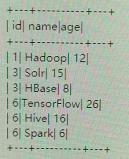

3.top<=2时

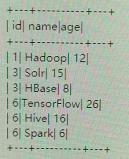

4.top<=3时

5.top>3时【分组中最大为3】

四.代码实现【不使用HiveContext】

package big.data.analyse.sparksql

import org.apache.log4j.{Level, Logger}

import org.apache.spark.sql.types.{IntegerType, StringType, StructField, StructType}

import org.apache.spark.sql.{Row, SparkSession}

/**

* Created by zhen on 2019/7/6.

*/

object RowNumber {

/**

* 设置日志级别

*/

Logger.getLogger("org").setLevel(Level.WARN)

def main(args: Array[String]) {

/**

* 创建spark入口,不支持Hive

*/

val spark = SparkSession.builder().appName("RowNumber")

.master("local[2]").getOrCreate()

/**

* 创建测试数据

*/

val array = Array("1,Hadoop,12","5,Spark,6","3,Solr,15","3,HBase,8","6,Hive,16","6,TensorFlow,26")

val rdd = spark.sparkContext.parallelize(array).map{ row =>

val Array(id, name, age) = row.split(",")

Row(id, name, age.toInt)

}

val structType = new StructType(Array(

StructField("id", StringType, true),

StructField("name", StringType, true),

StructField("age", IntegerType, true)

))

/**

* 转化为df

*/

val df = spark.createDataFrame(rdd, structType)

df.show()

df.createOrReplaceTempView("technology")

/**

* 应用开窗函数row_number

* 注意:开窗函数只能在hiveContext下使用

*/

val result_1 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 1")

result_1.show()

val result_2 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 2")

result_2.show()

val result_3 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top <= 3")

result_3.show()

val result_4 = spark.sql("select id,name,age from (select id,name,age," +

"row_number() over (partition by id order by age desc) top from technology) t where t.top > 3")

result_4.show()

}

}

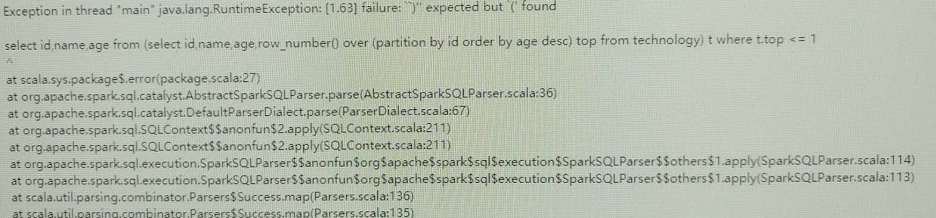

五.结果【不使用HiveContext】

Spark之开窗函数的更多相关文章

- 【Spark篇】---SparkSQL中自定义UDF和UDAF,开窗函数的应用

一.前述 SparkSQL中的UDF相当于是1进1出,UDAF相当于是多进一出,类似于聚合函数. 开窗函数一般分组取topn时常用. 二.UDF和UDAF函数 1.UDF函数 java代码: Spar ...

- Spark(十三)SparkSQL的自定义函数UDF与开窗函数

一 自定义函数UDF 在Spark中,也支持Hive中的自定义函数.自定义函数大致可以分为三种: UDF(User-Defined-Function),即最基本的自定义函数,类似to_char,to_ ...

- spark开窗函数

源文件内容示例: http://bigdata.beiwang.cn/laoli http://bigdata.beiwang.cn/laoli http://bigdata.beiwang.cn/h ...

- 【Spark-SQL学习之三】 UDF、UDAF、开窗函数

环境 虚拟机:VMware 10 Linux版本:CentOS-6.5-x86_64 客户端:Xshell4 FTP:Xftp4 jdk1.8 scala-2.10.4(依赖jdk1.8) spark ...

- SparkSQL开窗函数 row_number()

开始编写我们的统计逻辑,使用row_number()函数 先说明一下,row_number()开窗函数的作用 其实就是给每个分组的数据,按照其排序顺序,打上一个分组内行号 比如说,有一个分组20151 ...

- 开窗函数 First_Value 和 Last_Value

在Sql server 2012里面,开窗函数丰富了许多,其中带出了2个新的函数 First_Value 和 Last Value .现在来介绍一下这2个函数的应用场景. 首先分析一下First_Va ...

- Oracle开窗函数 over()(转)

copy文链接:http://blog.csdn.net/yjjm1990/article/details/7524167#,http://www.2cto.com/database/201402/2 ...

- oracle的分析函数over 及开窗函数

转:http://www.2cto.com/database/201310/249722.html oracle的分析函数over 及开窗函数 一:分析函数over Oracle从8.1.6开 ...

- 开窗函数 --over()

一个学习性任务:每个人有不同次数的成绩,统计出每个人的最高成绩. 这个问题应该还是相对简单,其实就用聚合函数就好了. select id,name,max(score) from Student gr ...

随机推荐

- Kafka集群管理工具kafka-manager

一.kafka-manager简介 kafka-manager是目前最受欢迎的kafka集群管理工具,最早由雅虎开源,用户可以在Web界面执行一些简单的集群管理操作.具体支持以下内容: 管理多个集群 ...

- 为什么java里面经常作List判断的时候,既要判断list不为null,又要判断size>0呢?

没有考虑到具体的问题上面,我们单纯的来讲: 为什么java里面经常作List判断的时候,既要判断list不为null,又要判断size>0呢? list == null 说明list没有初始化( ...

- Parcel 搭建浏览器自动刷新的 非 SPA项目

重点:parcel index.html 需要引入 index.js 否则不自动刷新

- nexus 3.x最新版下载安装和上传下载jar

注意: nexus 3.x最新版好像不用下载索引了,目前我使用一些基本功能没有索引也能耍的很6 下载 nexus最新版下载https://www.sonatype.com/download-oss-s ...

- 搭建FTP(win10版)以及基本FTP操作

参考链接:https://www.jianshu.com/p/ece21421e246 一.FTP服务器搭建 控制面板 - 程序和功能 - 启动或关闭Windows功能 启动以下功能: 搜索 “Int ...

- jenkins自动化视频地址

1.腾讯课堂的视频 http://www.ctnrs.com/study.html 我的课程所有列表 2.百度网盘里面的

- koa2 post请求ctx.request.body空获取不到的解决办法

header请求头添加Content-type: application/json

- golang xorm时区问题

mysql连接后面加 &loc=Local 否则执行sql的时间格式,存到数据库会按0时区 UTC存储

- C/C++配置

VScode 插件推荐与C/C++配置 https://www.cnblogs.com/harrypotterjackson/p/11432252.html 阅读目录 C++类 美化 git tab ...

- static示例

求生成对象的个数 class A{ private int i; private static int cnt = 0; //此处用static修饰,让cnt属于类,多个对象共用一个属性,减少内存分配 ...