Spark源码学习2

转自:http://www.cnblogs.com/hseagle/p/3673123.html

在源码阅读时,需要重点把握以下两大主线。

- 静态view 即 RDD, transformation and action

- 动态view 即 life of a job, 每一个job又分为多个stage,每一个stage中可以包含多个rdd及其transformation,这些stage又是如何映射成为task被distributed到cluster中

一、概要

本文以wordCount为例,详细说明spark创建和运行job的过程,重点是在进程及线程的创建。

二、实验环境搭建

在进行后续操作前,确保下列条件已满足。

- 下载spark binary 0.9.1

- 安装scala

- 安装sbt

- 安装java

三、启动spark-shell

3.1 单机模式运行,即local模式

local模式运行非常简单,只要运行以下命令即可,假设当前目录是$SPARK_HOME

MASTER=local bin/spark-shell

"MASTER=local"就是表明当前运行在单机模式

3.2 local cluster方式运行

local cluster模式是一种伪cluster模式,在单机环境下模拟standalone的集群,启动顺序分别如下

- 启动master

- 启动worker

- 启动spark-shell

3.3 master

$SPARK_HOME/sbin/start-master.sh

注意运行时的输出,日志默认保存在$SPARK_HOME/logs目录。

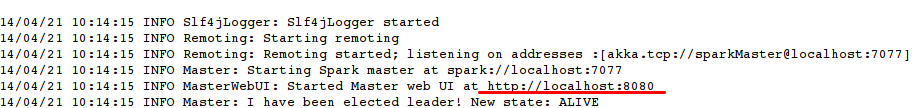

master主要是运行类 org.apache.spark.deploy.master.Master,在8080端口启动监听,日志如下图所示

3.4 修改配置

- 进入$SPARK_HOME/conf目录

- 将spark-env.sh.template重命名为spark-env.sh

- 修改spark-env.sh,添加如下内容

export SPARK_MASTER_IP=localhost

export SPARK_LOCAL_IP=localhost

3.5 运行worker

bin/spark-class org.apache.spark.deploy.worker.Worker spark://localhost:7077 -i 127.0.0.1 -c 1 -m 512M

worker启动完成,连接到master。打开maser的web ui可以看到连接上来的worker. Master WEb UI的监听地址是http://localhost:8080

3.6 启动spark-shell

MASTER=spark://localhost:7077 bin/spark-shell

如果一切顺利,将看到下面的提示信息。

Created spark context..

Spark context available as sc.

可以用浏览器打开localhost:4040来查看如下内容

- stages

- storage

- environment

- executors

wordcount

上述环境准备妥当之后,我们在sparkshell中运行一下最简单的例子,在spark-shell中输入如下代码

scala>sc.textFile("README.md").filter(_.contains("Spark")).count

上述代码统计在README.md中含有Spark的行数有多少

四、部署过程详解

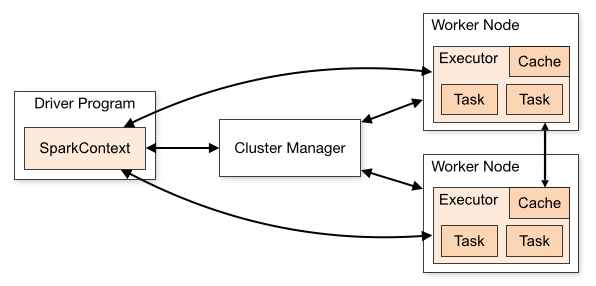

Spark布置环境中组件构成如下图所示。

- Driver Program 简要来说在spark-shell中输入的wordcount语句对应于上图的Driver Program.

- Cluster Manager 就是对应于上面提到的master,主要起到deploy management的作用

- Worker Node 与Master相比,这是slave node。上面运行各个executor,executor可以对应于线程。executor处理两种基本的业务逻辑,一种就是driver programme,另一种就是job在提交之后拆分成各个stage,每个stage可以运行一到多个task

Notes: 在集群(cluster)方式下, Cluster Manager运行在一个jvm进程之中,而worker运行在另一个jvm进程中。在local cluster中,这些jvm进程都在同一台机器中,如果是真正的standalone或Mesos及Yarn集群,worker与master或分布于不同的主机之上。

五、JOB的生成和运行

job生成的简单流程如下

- 首先应用程序创建SparkContext的实例,如实例为sc

- 利用SparkContext的实例来创建生成RDD

- 经过一连串的transformation操作,原始的RDD转换成为其它类型的RDD

- 当action作用于转换之后RDD时,会调用SparkContext的runJob方法

- sc.runJob的调用是后面一连串反应的起点,关键性的跃变就发生在此处

调用路径大致如下

- sc.runJob->dagScheduler.runJob->submitJob

- DAGScheduler::submitJob会创建JobSummitted的event发送给内嵌类eventProcessActor

- eventProcessActor在接收到JobSubmmitted之后调用processEvent处理函数

- job到stage的转换,生成finalStage并提交运行,关键是调用submitStage

- 在submitStage中会计算stage之间的依赖关系,依赖关系分为宽依赖和窄依赖两种

- 如果计算中发现当前的stage没有任何依赖或者所有的依赖都已经准备完毕,则提交task

- 提交task是调用函数submitMissingTasks来完成

- task真正运行在哪个worker上面是由TaskScheduler来管理,也就是上面的submitMissingTasks会调用TaskScheduler::submitTasks

- TaskSchedulerImpl中会根据Spark的当前运行模式来创建相应的backend,如果是在单机运行则创建LocalBackend

- LocalBackend收到TaskSchedulerImpl传递进来的ReceiveOffers事件

- receiveOffers->executor.launchTask->TaskRunner.run

代码片段executor.lauchTask

def launchTask(context: ExecutorBackend, taskId: Long, serializedTask: ByteBuffer) {

val tr = new TaskRunner(context, taskId, serializedTask)

runningTasks.put(taskId, tr)

threadPool.execute(tr)

}

说了这么一大通,也就是讲最终的逻辑处理切切实实是发生在TaskRunner这么一个executor之内,运算结果是包装成为MapStatus然后通过一系列的内部消息传递,反馈到DAGScheduler,这一个消息传递路径不是过于复杂,有兴趣可以自行勾勒

Spark源码学习2的更多相关文章

- Spark源码学习1.2——TaskSchedulerImpl.scala

许久没有写博客了,没有太多时间,最近陆续将Spark源码的一些阅读笔记传上,接下来要修改Spark源码了. 这个类继承于TaskScheduler类,重载了TaskScheduler中的大部分方法,是 ...

- Spark源码学习1.1——DAGScheduler.scala

本文以Spark1.1.0版本为基础. 经过前一段时间的学习,基本上能够对Spark的工作流程有一个了解,但是具体的细节还是需要阅读源码,而且后续的科研过程中也肯定要修改源码的,所以最近开始Spark ...

- spark源码学习-withScope

withScope是最近的发现版中新增加的一个模块,它是用来做DAG可视化的(DAG visualization on SparkUI) 以前的sparkUI中只有stage的执行情况,也就是说我们 ...

- Spark源码学习1.6——Executor.scala

Executor.scala 一.Executor类 首先判断本地性,获取slaves的host name(不是IP或者host: port),匹配运行环境为集群或者本地.如果不是本地执行,需要启动一 ...

- Spark源码学习1.5——BlockManager.scala

一.BlockResult类 该类用来表示返回的匹配的block及其相关的参数.共有三个参数: data:Iterator [Any]. readMethod: DataReadMethod.Valu ...

- Spark源码学习1.4——MapOutputTracker.scala

相关类:MapOutputTrackerMessage,GetMapOutputStatuses extends MapPutputTrackerMessage,StopMapOutputTracke ...

- Spark源码学习3

转自:http://www.cnblogs.com/hseagle/p/3673132.html 一.概要 本篇主要阐述在TaskRunner中执行的task其业务逻辑是如何被调用到的,另外试图讲清楚 ...

- Spark源码学习1

转自:http://www.cnblogs.com/hseagle/p/3664933.html 一.基本概念(Basic Concepts) RDD - resillient distributed ...

- Spark源码学习1.8——ShuffleBlockManager.scala

shuffleBlockManager继承于Logging,参数为blockManager和shuffleManager.shuffle文件有三个特性:shuffleId,整个shuffle stag ...

随机推荐

- STL的移动算法

要在自己定义类型中使用移动算法.须要在元素中提供移动赋值运算符.移动赋值运算符和std::move()详见<c++高级编程>第9章 class mystring { public: str ...

- 创建基于maven的项目模版

我们在实际工作中 ,有些项目的架构是相似的,例如基于 restful的接口项目,如果每次都重新搭建一套架构或者通过拷贝建立一个项目难免有些得不偿失,这里我们可以用maven的archtype建立项目模 ...

- Swift 3.0第1步,面向所有开发者开源

在移动开发中,Android开发一直比较受欢迎的原因之一就是其是一个开源的,有很多开源项目.代码可以用,这也是很多iOS开发者羡慕不已的地方.但值得庆贺的是,随着swift编程语言的发展,北京时间12 ...

- error1

#include<stdio.h>main(){ int a[10],i,m,n,j; for(i=3;i<10;i++) scanf("%d",&a ...

- js计时器。

<html> <head> <title> Nonove js clock 时钟 </title> <script type="text ...

- IntelliJ IDEA 14 注册码及注册码生成器

几个license: (1) key:IDEA value:61156-YRN2M-5MNCN-NZ8D2-7B4EW-U12L4 (2) key:huangweivalue:97493-G3A41- ...

- [LeetCode]题解(python):155-Min Stack

题目来源: https://leetcode.com/problems/min-stack/ 题意分析: 实现一个小的栈,包括初始化,push,pop,top,和getMin. 题目思路: 私用是用两 ...

- 复习-C语言内嵌汇编-初级(1)

打印hello world并改变变量i的值 # include <stdio.h> int main() { ; __asm__( "mov %0, #4\n" :&q ...

- 继承CWnd自绘按钮

头文件: //头文件 #pragma once // CLhsButton #define MYWM_BTN_CLICK WM_USER+3001 //关闭按钮单击响应 //tab按钮的状态 enum ...

- Doctype 严格模式与混杂模式-如何触发这两种模式,区分它们有何意义?

Doctype:(Document Type)文档类型,它位于文档中最前面的位置,处于标签之前.如果你想制作符合标准的页面,一个必不可少的关键组成部分就是DOCTYPE的声明.确定了正确的Doctyp ...