谣言检测()——《Debunking Rumors on Twitter with Tree Transformer》

论文信息

论文标题:Debunking Rumors on Twitter with Tree Transformer

论文作者:Jing Ma、Wei Gao

论文来源:2020,COLING

论文地址:download

论文代码:download

1 Introduction

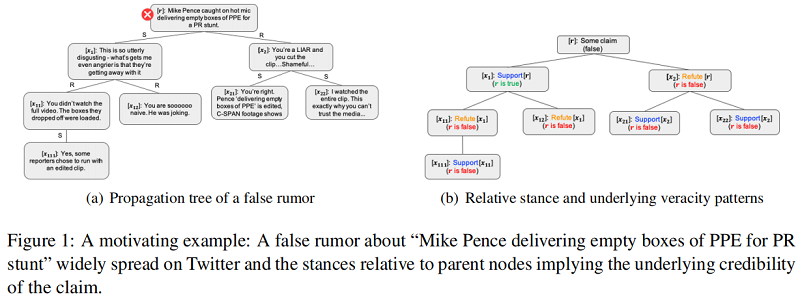

出发点:Existing conversation-based techniques for rumor detection either just strictly follow tree edges or treat all the posts fully-connected during feature learning.

创新点:Propose a novel detection model based on tree transformer to better utilize user interactions in the dialogue where post-level self-attention plays the key role for aggregating the intra-/inter-subtree stances.

例子:以 PLAN 模型为例子——一种帖子之间全连接的例子

结论:Post 之间全连接的模型只适合浅层模型,并不适合深层模型,这是由于 Post 一般只和其 Parent 相关吗,全连接导致 Post 之间的错误连接加重。

2 Tree Transformer Model

2.1 Token-Level Tweet Representation

Transformer encoder 框架:

给定一条表示为 word sequence $x_{i}=\left(w_{1} \cdots w_{t} \cdots w_{\left|x_{i}\right|}\right)$ 的推文,每个 $w_{t} \in \mathbb{R}^{d}$ 是一个 $d$ 维向量,可以用预先训练的单词嵌入初始化。我们使用多头自注意网络(MH-SAN)将每个 $w_{i}$ 映射到一个固定大小的隐藏向量中。MH-SAN 的核心思想是共同关注来自不同位置的不同表示子空间的单词。更具体地说,MH-SAN 首先将输入字序列 $x_i$ 转换为具有不同线性投影的多个子空间:

其中,$\left\{Q_{i}^{h}, K_{i}^{h}, V_{i}^{h}\right\}$ 分别为 query、key 和 value representations,$\left\{W_{Q}^{h}, W_{K}^{h}, W_{V}^{h}\right\} $ 表示与第 $h$ 个头关联的参数矩阵。然后,应用 attention function 来生成输出状态。

$O_{i}^{h}=\operatorname{softmax}\left(\frac{Q_{i}^{h} \cdot K_{i}^{h^{\top}}}{\sqrt{d_{h}}}\right) \cdot V_{i}^{h} \quad\quad\quad(2)$

其中,$\sqrt{d_{h}}$ 是 放缩因子,$d_{h}$ 表示第 $h$ 个头的子空间的维数。最后,表示的输出可以看作是所有头 $O_{i}=\left[O_{i}^{1}, O_{i}^{2}, \cdots, O_{i}^{n}\right] \in \mathbb{R}^{\left|x_{i}\right| \times d}$ 的连接,$n$ 为头数,然后是一个归一化层(layerNorm)和前馈网络(FFN)。

$\begin{array}{l}B_{i}=\operatorname{layerNorm}\left(O_{i} \cdot W_{B}+O_{i}\right) \\H_{i}=\operatorname{FFN}\left(B_{i} \cdot W_{S}+B_{i}\right)\end{array} \quad\quad\quad(3)$

其中 $H_{i}=\left[h_{1} ; \ldots ; h_{\left|x_{i}\right|}\right] \in \mathbb{R}^{\left|x_{i}\right| \times d}$ 是表示 tweet $x_i$ 中所有单词的矩阵,$W_{B}$ 和 $W_{h}$ 包含 transformation 的权值。最后,我们通过 maxpooling 所有相关 words 的向量,得到了 $x_i$ 的表示:

$s_{i}=\max -\operatorname{pooling}\left(h_{1}, \ldots, h_{\left|x_{i}\right|}\right) \quad\quad\quad(4)$

其中,$s_{i} \in \mathbb{R}^{1 \times d}$ 为 $d$ 维向量,$|\cdot|$ 为单词数。

2.2 Post-Level Tweet Representation

(1) posts are generally short in nature thus the stance expressed in each node is closely correlated with the responsive context;

(2) posts in the same subtree direct at the individual opinion expressed in the root of the subtree.

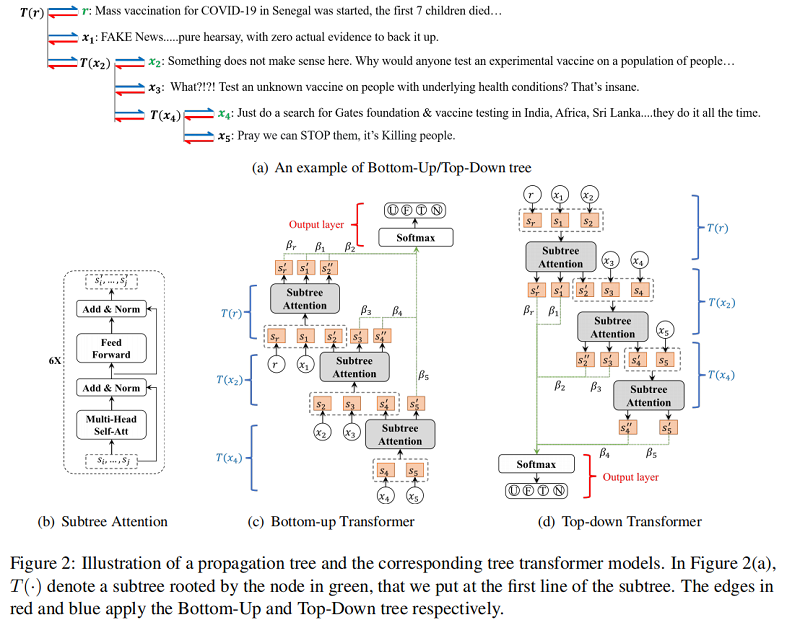

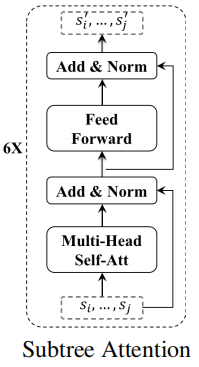

Figure 2(c) 说明了本文的 tree transformer 结构,它 cross-check 从底部子树到上部子树的 post。具体来说,给定一个有根于 $x_j$ 的子树,假设 $\mathcal{V}(j)=\left\{x_{j}, \ldots, x_{k}\right\}$ 表示子树中的节点集合,即 $x_j$ 及其直接响应节点。然后,我们在 $\mathcal{V}(j)$ 上应用一个 post-level subtree attention(a transformer-based block as shown in Figure 2(b)),以得到 $\mathcal{V}(j)$ 中每个节点的细化表示:

$\left[s_{j}^{\prime} ; \ldots ; s_{k}^{\prime}\right]=\operatorname{TRANS}\left(\left[s_{j} ; \ldots ; s_{k}\right], \Theta_{T}\right) \quad\quad\quad(5)$

其中,$TRANS (\cdot)$ 是具有如 Eq. 2-4 中所示的相似形式的 transform function,$\Theta_{T}$ 包含了 transformer 的参数。因此,$s_{*}^{\prime}$ 是基于子树的上下文得到的 $s_{*}$ 的细化表示。请注意,每个节点都可以被视为不同子树中的父节点或子节点,例如,在 Figure 2(a) 中,$x_{2}$ 可以是 $T\left(x_{2}\right)$ 的父节点,也可以是 $T(r)$ 的子节点。因此,一部分的节点在我们的 from bottom subtree to upper subtree 模型中结果两次层次细化:(1)通过与父节点相比来捕获立场 stance,(2) 通过关注邻居节点来获得较低权重的不准确信息,例如,一个父母支持一个错误的声明可能会细化如果大多数响应驳斥父节点。

Top-down transformer 的方向与 bottom-up transformer 相反,沿着信息传播的方向,其架构如 Figure 2 (d) 所示。同样的,其学习到的表示也通过捕获立场和自我纠正上下文信息得到增强。

2.3 The overall Model

为了共同捕获整个树中表达的观点,我们利用一个注意力层来选择具有准确信息的重要帖子,这是基于细化的节点表示而获得的。这将产生:

$\begin{array}{l}\alpha_{i}=\frac{\exp \left(s_{i}^{\prime} \cdot \mu^{\top}\right)}{\sum\limits_{j} \exp \left(s_{j}^{\prime} \cdot \mu^{\top}\right)} \\\tilde{s}=\sum\limits_{i} \alpha_{i} \cdot s_{i}^{\prime}\end{array}\quad\quad\quad(6)$

其中,$s_{i}^{\prime}$ 由 Bottom-Up Transformer 或 Top-Down Transformer 得到,$\mu \in \mathbb{R}^{1 \times d}$ 是注意力机制的参数。这里的 $\alpha_{i}$ 是节点 $x_i$ 的注意权值,用于生成整个树的表示 $\tilde{s}$。最后,我们使用一个全连接的输出层来预测谣言类上的概率分布。

$\hat{y}=\operatorname{softmax}\left(V_{o} \cdot \tilde{s}+b_{o}\right) \quad\quad\quad(7)$

其中,$V_{o}$ 和 $b_{o}$ 是输出层中的权值和偏差。

此外,还有一种直接的方法可以将 Bottom-Up transformer 与 Top-Down transformer 的树表示连接起来,以获得更丰富的树表示,然后将其输入上述的 $softmax (\cdot)$ 函数进行谣言预测。

我们所有的模型都经过训练,以最小化预测的概率分布和地面真实值的概率分布之间的平方误差:

$L(y, \hat{y})=\sum_{n=1}^{N} \sum_{c=1}^{C}\left(y_{c}-\hat{y}_{c}\right)^{2}+\lambda\|\Theta\|_{2}^{2} \quad\quad\quad(8)$

其中 $y_{c}$ 是 ground-truth label ,$\hat{y}_{c}$ 是类C的预测概率,$N$ 是训练的树数,C 是类的数量,$\|.\|_{2}$ 是所有模型参数 $\Theta$ 上的 $L_{2}$ 正则化项,$\lambda$ 是权衡系数。

3 Experiments

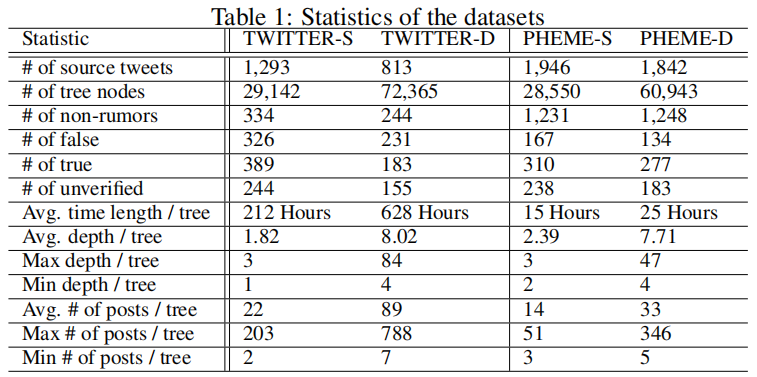

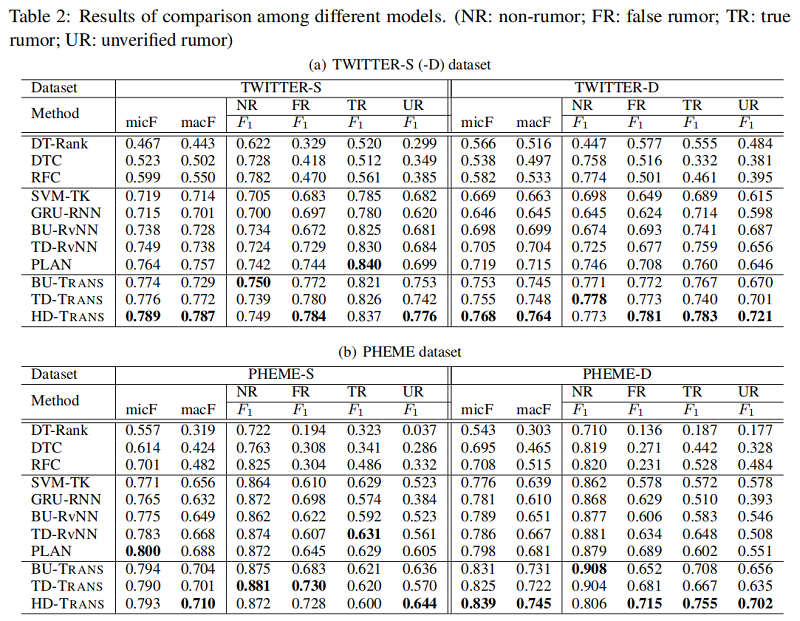

使用 TWITTER 和 PHEME 数据集进行实验,按照传播树深度将两个数据集划分为 TWITTER-S (PHEME-S)和 TWITTER-D (PHEME-D) 一共4个数据集,下表展示数据集的统计情况:

Experiment

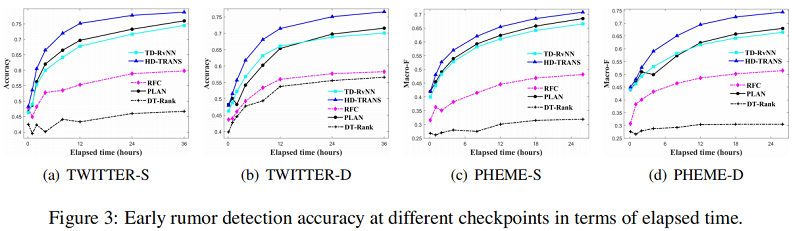

Early Rumor Detection Performance

谣言检测()——《Debunking Rumors on Twitter with Tree Transformer》的更多相关文章

- 谣言检测——《MFAN: Multi-modal Feature-enhanced Attention Networks for Rumor Detection》

论文信息 论文标题:MFAN: Multi-modal Feature-enhanced Attention Networks for Rumor Detection论文作者:Jiaqi Zheng, ...

- 论文解读(FedGAT)《Federated Graph Attention Network for Rumor Detection》

论文信息 论文标题:Federated Graph Attention Network for Rumor Detection论文作者:Huidong Wang, Chuanzheng Bai, Ji ...

- 谣言检测(ClaHi-GAT)《Rumor Detection on Twitter with Claim-Guided Hierarchical Graph Attention Networks》

论文信息 论文标题:Rumor Detection on Twitter with Claim-Guided Hierarchical Graph Attention Networks论文作者:Erx ...

- 谣言检测(PSIN)——《Divide-and-Conquer: Post-User Interaction Network for Fake News Detection on Social Media》

论文信息 论文标题:Divide-and-Conquer: Post-User Interaction Network for Fake News Detection on Social Media论 ...

- 谣言检测(PLAN)——《Interpretable Rumor Detection in Microblogs by Attending to User Interactions》

论文信息 论文标题:Interpretable Rumor Detection in Microblogs by Attending to User Interactions论文作者:Ling Min ...

- 谣言检测(RDEA)《Rumor Detection on Social Media with Event Augmentations》

论文信息 论文标题:Rumor Detection on Social Media with Event Augmentations论文作者:Zhenyu He, Ce Li, Fan Zhou, Y ...

- 谣言检测()《Rumor Detection with Self-supervised Learning on Texts and Social Graph》

论文信息 论文标题:Rumor Detection with Self-supervised Learning on Texts and Social Graph论文作者:Yuan Gao, Xian ...

- 目标检测系列 --- RCNN: Rich feature hierarchies for accurate object detection and semantic segmentation Tech report

目标检测系列 --- RCNN: Rich feature hierarchies for accurate object detection and semantic segmentation Te ...

- 谣言检测——(PSA)《Probing Spurious Correlations in Popular Event-Based Rumor Detection Benchmarks》

论文信息 论文标题:Probing Spurious Correlations in Popular Event-Based Rumor Detection Benchmarks论文作者:Jiayin ...

随机推荐

- Modbus转BACnet IP网关

BACnet是楼宇自动化和控制网络数据通信协议的缩写.它是为楼宇自动化网络开发的数据通信协议 根据1999年底互联网上楼宇自动化网络的信息,全球已有数百家国际知名制造商支持BACnet,包括楼宇自 ...

- Nginx Lua拓展模块操作Redis、Mysql

# Nginx的拓展模块 # ngx_lua模块 # 淘宝开发的ngx_lua模块通过lua解释器集成近Nginx,可以采用lua脚本实现业务逻辑,由于lua的紧凑.快速以及内建协程,所以在保证宝兵法 ...

- 【Java面试】这道互联网高频面试题难住了80%的程序员?索引什么时候失效?

"索引什么时候失效?" 面试过程中,突如其来的一个问题,是不是有点懵? 没关系,关注我,面试不迷路. 我是Mic,一个工作了14年的Java程序员. 索引失效涉及到的知识点非常多, ...

- SpringCloud之Sentinel

一. sentinel是什么? 1.概念: 分布式服务架构的流量治理组件. 2.sentinel有什么作用? 2.1 流控:QPS.线程数 2.2 熔断降级:降级-->熔断策略.时长.请求数等 ...

- 透过inode来理解硬链接和软链接

什么是inode? 每个文件都对应一个唯一的inode,inode用来存储文件的元信息,包括: 对应的文件 文件字节数 文件数据块的位置 文件的inode号码 文件的硬链接数 文件的读写权限 文件的时 ...

- HTTPS 一定是安全的吗?

大家好,我是小林. 上周有位读者在面字节时被问道这么一个问题:HTTPS 一定安全可靠吗? 这个问题的场景是这样的:客户端通过浏览器向服务端发起 HTTPS 请求时,被「假基站」转发到了一个「中间人服 ...

- Shell第一章《变量》

shell前言 什么是shell shell-'壳' 命令解释器,一种应用程序 shell语言特点 SHELL语言是指UNIX操作系统的命令语言,同时又是该命令语言的解释程序的简称. Shell本身是 ...

- UOJ#XX A+B Problem (罔烙硫)

题面 背景 题目描述 从前有个 n n n 个方格排成一行,从左至右依此编号为 1 , 2 , ⋯ , n 1,2,⋯,n 1,2,⋯,n. 有一天思考熊想给这 n n n 个方格染上黑白两色. 第 ...

- Java代码审计之不安全的Java代码

Java代码审计之不安全的Java代码 在打靶场的同时,需要想一下如果你是开发人员你会怎样去防御这种漏洞,而作为攻击方你又怎么去绕过开发人员的防御. 环境搭建 https://github.com ...

- 面试突击84:Spring 有几种事务隔离级别?

Spring 中的事务隔离级别和数据库中的事务隔离级别稍有不同,以 MySQL 为例,MySQL 的 InnoDB 引擎中的事务隔离级别有 4 种,而 Spring 中却包含了 5 种事务隔离级别. ...