Spark 倾斜连接

- 业务数据本身的特性

- Key分布不均匀

- 建表时考虑不周

- 某些SQL语句本身就有数据倾斜

【数据倾斜的解决方案】

------

------ ------

------

【SPARK 代码】

package spark

import org.apache.spark.{SparkContext, SparkConf}

/**

* Created by Liu Jinhong on 2016/5/27.

*/

object TiltJoin {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("TiltJoin").setMaster("local")

val sc = new SparkContext(conf)

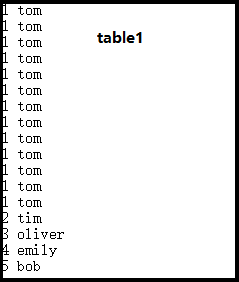

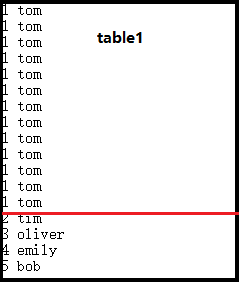

val line1 = sc.textFile("E:\\testdoc\\a.txt")

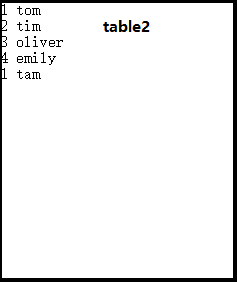

val line2 = sc.textFile("E:\\testdoc\\b.txt")

val table1 = line1.map(_.split(' ')).map(x => (x(0), x(1)))

val table2 = line2.map(_.split(' ')).map(x => (x(0), x(1)))

//对table1进行采样

val sample = table1.sample(false, 0.3, 9).map(x => (x._1, 1)).reduceByKey(_+_)

//找到table1中的倾斜数据

val maxrowKey = sample.map(x => (x._2, x._1)).sortByKey(false).take(1).toSeq(0)._2

//把table1拆分成两个表

val maxrowTable = table1.filter(_._1 == maxrowKey)

val maintable = table1.filter(_._1 != maxrowKey)

val result = sc.union(maxrowTable.join(table2), maintable.join(table2)).foreach(println(_))

}

}

【涉及到的函数】

val maxrowKey = sample.map(x => (x._2, x._1)).sortByKey(false).take(1).toSeq(0)._2

上诉代码相当于实现了按照value降序排序。

Spark 倾斜连接的更多相关文章

- Spark Streaming连接TCP Socket

1.Spark Streaming是什么 Spark Streaming是在Spark上建立的可扩展的高吞吐量实时处理流数据的框架,数据可以是来自多种不同的源,例如kafka,Flume,Twitte ...

- 【spark】连接Hbase

0.我们有这样一个表,表名为Student 1.在Hbase中创建一个表 表明为student,列族为info 2.插入数据 我们这里采用put来插入数据 格式如下 put ‘表命’,‘行键’, ...

- Spark Streaming连接Kafka的两种方式 direct 跟receiver 方式接收数据的区别

Receiver是使用Kafka的高层次Consumer API来实现的. Receiver从Kafka中获取的数据都是存储在Spark Executor的内存中的,然后Spark Streaming ...

- Spark join连接

内链接

- Spark SQL 官方文档-中文翻译

Spark SQL 官方文档-中文翻译 Spark版本:Spark 1.5.2 转载请注明出处:http://www.cnblogs.com/BYRans/ 1 概述(Overview) 2 Data ...

- 《Spark大数据处理:技术、应用与性能优化 》

基本信息 作者: 高彦杰 丛书名:大数据技术丛书 出版社:机械工业出版社 ISBN:9787111483861 上架时间:2014-11-5 出版日期:2014 年11月 开本:16开 页码:255 ...

- 《Spark大数据处理:技术、应用与性能优化》【PDF】 下载

内容简介 <Spark大数据处理:技术.应用与性能优化>根据最新技术版本,系统.全面.详细讲解Spark的各项功能使用.原理机制.技术细节.应用方法.性能优化,以及BDAS生态系统的相关技 ...

- 《Spark大数据处理:技术、应用与性能优化》【PDF】

内容简介 <Spark大数据处理:技术.应用与性能优化>根据最新技术版本,系统.全面.详细讲解Spark的各项功能使用.原理机制.技术细节.应用方法.性能优化,以及BDAS生态系统的相关技 ...

- Spark记录-SparkSql官方文档中文翻译(部分转载)

1 概述(Overview) Spark SQL是Spark的一个组件,用于结构化数据的计算.Spark SQL提供了一个称为DataFrames的编程抽象,DataFrames可以充当分布式SQL查 ...

随机推荐

- asp.net mvc 上传附件验证

1.使用验证特性 [RequiredCollection] public ICollection<IFormFile> Attachments { get; set; } 2.自定义验证特 ...

- 必须掌握的Linux命令

章节简述: 本章节讲述系统内核.Bash解释器的关系与作用,教给读者如何正确的执行Linux命令以及常见排错方法. 经验丰富的运维人员可以恰当的组合命令与参数,使Linux字符命令更加的灵活且相对减少 ...

- python3数据结构

列表 list.append(x) 把一个元素添加到列表的结尾,相当于a[len(a):]=[x] list.extend(L) 将一个给定列表中的所有元素都添加到另一个列表中,相当于a[(len): ...

- app兼容性测试的几种方案

1.统计自己的应用被使用的数据 通过友盟或Flurry等在应用嵌入,得到应用在哪些机型上被安装了,排名前十的就是测试的重点机型 2.可参考兼容性测试平台的测试结果 比如Testin或百度的MTC平台, ...

- GOPS2017全球运维大会 • 深圳站 历届金牌讲师精选亮相

GOPS2017全球运维大会 • 深圳站将于2017年4月21日-22日在深圳举行,GOPS2017报名平台:活动家! 快捷报名通道:http://www.huodongjia.com/event-2 ...

- 【Python】使用super初始化超类

初始化超类的传统方式,在子类的实例中调用超类的__init__()方法. 但是传统的方法有两个问题,比如: 问题1: class MyBaseClass: def __init__(self, val ...

- [SOJ] 畅通工程续

Description 某省自从实行了很多年的畅通工程计划后,终于修建了很多路.不过路多了也不好,每次要从一个城镇到另一个城镇时,都有许多种道路方案可以选择,而某些方案要比另一些方案行走的距离要短很多 ...

- put a favicon for github pages

put the picture "favicon.ico" in the root of your web page repo.then add the following lin ...

- 7、Objective-C中的各种遍历(迭代)方式

一.使用for循环 要遍历字典.数组或者是集合,for循环是最简单也用的比较多的方法,示例如下: //普通的for循环遍历 -(void)iteratorWithFor { //////////处理数 ...

- Linux Samba服务主配文件smb.conf中文详解

从网上找到描述比较详细的smb.conf中文解释: 服务名:smb 配置目录:/etc/sabma/ 主配置文件:/etc/sabma/smb.conf #====================== ...