Keras + LSTM 做回归demo 2

接上回, 这次做了一个多元回归

这里贴一下代码

import numpy as np

np.random.seed(1337)

from sklearn.model_selection import train_test_split

import matplotlib.pyplot as plt

import keras

from keras.models import Sequential

from keras.layers import Activation

from keras.layers import LSTM

from keras.layers import Dropout

from keras.layers import Dense

import pandas as pd

datan = 1000

# 真实参数

ori_weights = [5, -4, 3, -2, 1]

colsn = len(ori_weights)

bias = -1

ori = np.zeros((1, colsn))

ori[0] = np.asarray(ori_weights)

# 列信息

cols_name = [chr(65+i) for i in range(colsn)]

X = np.zeros((colsn, datan)) for i in range(colsn):

X[i] = np.random.normal(1, 0.1, datan)

# 真实Y

Y = np.matmul(ori, X) + bias + np.random.normal(-0.1, 0.1, (datan, ))

# 数据预览

df = pd.DataFrame(X.T, columns=cols_name)

df['Y'] = df.apply(lambda row: np.matmul(ori, [row[k] for k in df.columns] )[0]+bias, axis=1)

df['target'] = Y[0]

df.head()

X_train, X_test, Y_train, Y_test = train_test_split(X.T, Y.T, test_size=0.33, random_state=42)

neurons = 128

activation_function = 'tanh'

loss = 'mse'

optimizer="adam"

dropout = 0.01

batch_size = 12

epochs = 200

model = Sequential() model.add(LSTM(neurons, return_sequences=True, input_shape=(1, colsn), activation=activation_function))

model.add(Dropout(dropout))

model.add(LSTM(neurons, return_sequences=True, activation=activation_function))

model.add(Dropout(dropout))

model.add(LSTM(neurons, activation=activation_function))

model.add(Dropout(dropout))

model.add(Dense(output_dim=1, input_dim=1))

model.compile(loss=loss, optimizer=optimizer)

epochs = 2001

for step in range(epochs):

cost = model.train_on_batch(X_train[:, np.newaxis], Y_train)

if step % 30 == 0:

print(f'{step} train cost: ', cost)

# test

print('Testing ------------')

cost = model.evaluate(X_test[:, np.newaxis], Y_test, batch_size=40)

print('test cost:', cost)

# plotting the prediction

Y_pred = model.predict(X_test[:, np.newaxis])

#

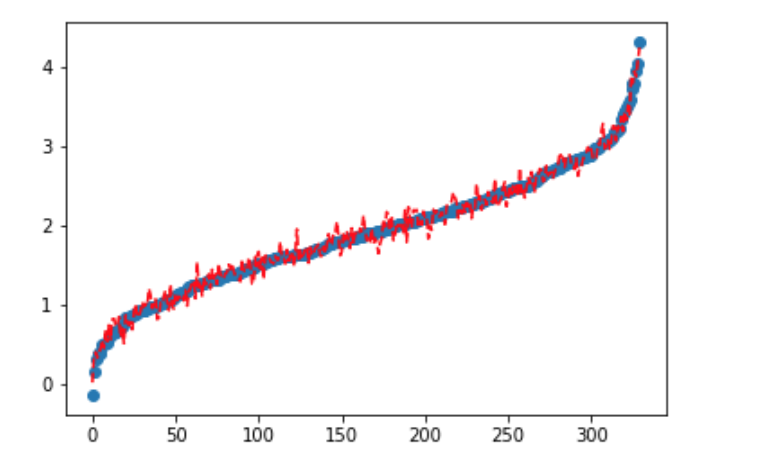

sdf = pd.DataFrame({'test':list(Y_test.T[0]), 'pred':list(Y_pred.T[0])})

sdf.sort_values(by='test', inplace=True)

#

plt.scatter(range(len(Y_test)), list(sdf.test))

plt.plot(range(len(Y_test)), list(sdf.pred), 'r--')

plt.show()

Keras + LSTM 做回归demo 2的更多相关文章

- Keras + LSTM 做回归demo

学习神经网络 想拿lstm 做回归, 网上找demo 基本三种: sin拟合cos 那个, 比特币价格预测(我用相同的代码和数据没有跑成功, 我太菜了)和keras 的一个例子 我基于keras 那个 ...

- 循环神经网络LSTM RNN回归:sin曲线预测

摘要:本篇文章将分享循环神经网络LSTM RNN如何实现回归预测. 本文分享自华为云社区<[Python人工智能] 十四.循环神经网络LSTM RNN回归案例之sin曲线预测 丨[百变AI秀]& ...

- 利用Caffe做回归(regression)

Caffe应该是目前深度学习领域应用最广泛的几大框架之一了,尤其是视觉领域.绝大多数用Caffe的人,应该用的都是基于分类的网络,但有的时候也许会有基于回归的视觉应用的需要,查了一下Caffe官网,还 ...

- [翻译]用神经网络做回归(Using Neural Networks With Regression)

本文英文原文出自这里, 这个博客里面的内容是Java开源, 分布式深度学习项目deeplearning4j的介绍学习文档. 简介: 一般来说, 神经网络常被用来做无监督学习, 分类, 以及回归. 也就 ...

- 单向LSTM笔记, LSTM做minist数据集分类

单向LSTM笔记, LSTM做minist数据集分类 先介绍下torch.nn.LSTM()这个API 1.input_size: 每一个时步(time_step)输入到lstm单元的维度.(实际输入 ...

- 使用LSTM做电影评论负面检测——使用朴素贝叶斯才51%,但是使用LSTM可以达到99%准确度

基本思路: 每个评论取前200个单词.然后生成词汇表,利用词汇index标注评论(对 每条评论的前200个单词编号而已),然后使用LSTM做正负评论检测. 代码解读见[[[评论]]]!embeddin ...

- python 做回归

1 一元线性回归 线性回归是一种简单的模型,但受到广泛应用,比如预测商品价格,成本评估等,都可以用一元线性模型.y = f(x) 叫做一元函数,回归意思就是根据已知数据复原某些值,线性回归(regre ...

- keras神经网络做简单的回归问题

咸鱼了半个多月了,要干点正经事了. 最近在帮老师用神经网络做多变量非线性的回归问题,没有什么心得,但是也要写个博文当个日记. 该回归问题是四个输入,一个输出.自己并不清楚这几个变量有什么关系,因为是跟 ...

- 用 LSTM 做时间序列预测的一个小例子(转自简书)

问题:航班乘客预测 数据:1949 到 1960 一共 12 年,每年 12 个月的数据,一共 144 个数据,单位是 1000 下载地址 目标:预测国际航班未来 1 个月的乘客数 import nu ...

随机推荐

- 【LeetCode每天一题】Rotate List(旋转链表)

Given a linked list, rotate the list to the right by k places, where k is non-negative. Example 1: I ...

- Python selenium根据class定位页面元素

在日常的网页源码中,我们基于元素的id去定位是最万无一失的,id在单个页面中是不会重复的.但是实际工作中,很多前端开发人员并未给每个元素都编写id属性.通常一段html代码如下: <div cl ...

- shell脚本报错:syntax error: unexpected end of file

解决办法1: vi test.sh :set fileformat=unix :wq 解决办法2: yum install dos2unix dos2unix my.sh 原因剖析: DOS下文件和L ...

- DetNet: A Backbone network for Object Detection 笔记

1 前言 主要贡献: (1)第一个分析微调传统ImageNet预训练模型应用于目标检测器的固有缺点 (2)提出一个名为DetNet的新的骨干结构,它通过保持空间分辨率和扩大感受野的方式来专门设计用于目 ...

- java的智能提示无法打开

第一步:选中“window”->“preference” 第二步:选中“java”,并展开 第三步:选中“Editor”,并展开 第四步:选中“Content Assist”,在右侧 ...

- HDU 1520 树形DP入门

HDU 1520 [题目链接]HDU 1520 [题目类型]树形DP &题意: 某公司要举办一次晚会,但是为了使得晚会的气氛更加活跃,每个参加晚会的人都不希望在晚会中见到他的直接上司,现在已知 ...

- H.264学习--1

1.宏块(Macro Block):一个编码图像首先要划分成多个块(4x4 像素)才能进行处理,显然宏块应该是整数个块组成,通常宏块大小为 ...

- 第一个Spring程序HelloWorld

对于初学者而言,任何理论化的讲解都比不上一个简单的HelloWorld,我们在学习Spring时也不外乎用最简单的HelloWorld程序来将这个灵活而又强大的轻量级框架推送到诸位面前.想要说明的是现 ...

- ansible批量管理

编写批量安装脚本 [root@m01 scripts]# vim install.sh for ip in $* do echo "=======start install to $ip = ...

- c++算法实现(一) - 递归和初始化

递归 写递归函数经常出错,提醒自己两个规则: 1. 一般来说递归函数中不应该出现for.while之类的循环语句, 因为递归就是循环的另外一种实现: 2. 注意基线条件,具体参考<算法图解> ...