【论文阅读】HydraPlus-Net: Attentive Deep Features for Pedestrian Analysis

转载请注明出处:https://www.cnblogs.com/White-xzx/

原文地址:https://arxiv.org/abs/1709.09930

Github: https://github.com/xh-liu/HydraPlus-Net

如有不准确或错误的地方,欢迎交流~

HP-Net是一个基于注意力机制(attention-based)的深度神经网络,将多层注意力机制图多向映射到不同的特征层。

【HP-Net Adavantage】

(1)模型能够从浅层到语义层捕获注意力;

(2)挖掘多尺度的可选注意力特征,充实最终的行人特征表示;

(3)提取出细节和局部特征来充实高层全局特征,这些特征在细粒度的行人分析任务中是非常重要的;

(4)提出多方向注意机制模块(multi-directional attention,MDA),提取多层(multiple level)特征,包含局部和全局特征,进行多层特征融合,进行细粒度的行人分析;

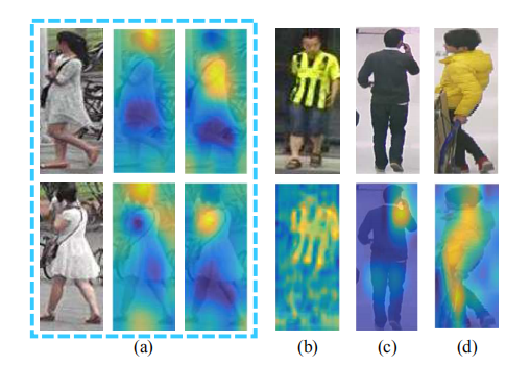

multi-level: (a)语义层:分辨相似外观行人的局部区域特征,如长短发、长短袖; (b)浅层:捕捉行人的衣服的条纹;

multi-scale: (c)(d)多尺度特征,描述行人特点 (c)小尺度特征对应‘打电话’; (d)大尺度全局理解描述‘性别’

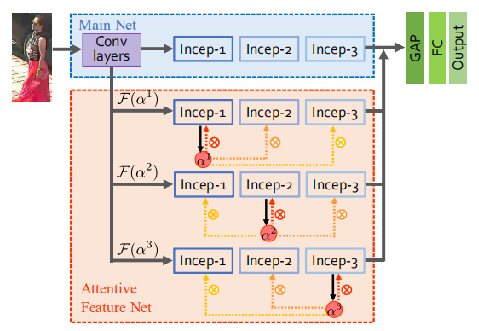

【HydraPlus-Net网络结构】

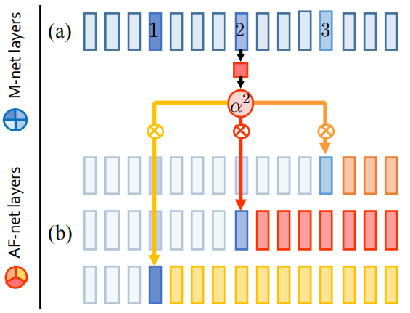

(1)Main Net(M-Net):单纯的CNN结构,论文的实现是基于inception_v2,包含三个inception block,还包含几个低层卷积层

(2)Attentive Feature Net(AF-Net):三个分支,每个分支有三个inception_v2 block和一个MDA

【Attentive Feature Network】

AF-Net包含3个MDA增强的网络分支,

AF-Net和M-Net共享卷积框架,他们的输出级联后经过全局平均池化和全连接层融合,最终的输出映射到属性logits用于属性识别,或特征向量用于再认证。

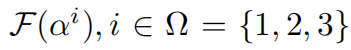

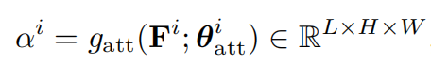

为inception i模块的输出经过1 1conv、BN、ReLU产生的注意力图,并被相乘到inception k的输出特征图,产生多层多尺度注意力特征,传送到后续的层,MDA模块的最后L个注意力特征级联作为最终特征表示,k∈{1,2,3}

为inception i模块的输出经过1 1conv、BN、ReLU产生的注意力图,并被相乘到inception k的输出特征图,产生多层多尺度注意力特征,传送到后续的层,MDA模块的最后L个注意力特征级联作为最终特征表示,k∈{1,2,3}

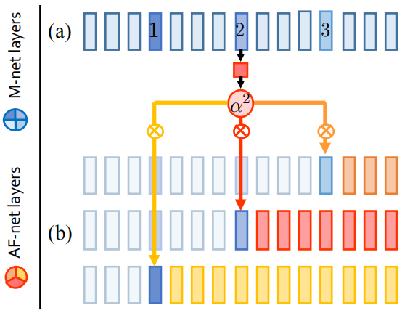

【Attention Mechanism 注意力机制】

传统基于注意力的模型,将注意力图返回输入到原相同的模块(右图红线),通过应用注意力图到相邻的模块来扩展此机制;HP-Net应用不同的注意力图到多个模块(下图b),在相同的空间分布下融合多层特征。

【Multi-level Attention Map 多层注意力图】

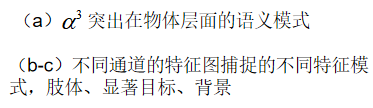

不同模块学习得到注意力图在尺度和细节上差异非常大,如下图(a),高层通常更粗糙、更聚焦语义区域(特定物体),如 ,低层捕获局部特征和细节(边缘和纹理),如

,低层捕获局部特征和细节(边缘和纹理),如  。因此,使用MDA模块融合不同层注意力特征,可以收集不同层的语义信息,提供更多可选特征表达。

。因此,使用MDA模块融合不同层注意力特征,可以收集不同层的语义信息,提供更多可选特征表达。

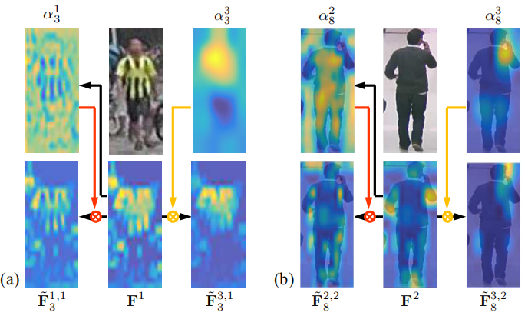

上图为每个输入图像提取某level的L = 8 attention channels 的特征图,不同MDA作用下,多级注意力特征的定性演示

(a)浅层属性,如上衣类型,需要低层注意力连接,纹理 -> T-Shirt (b)语义或目标级别的属性,如手机,需要高层注意力连接

【Stage-wise Training 分阶段训练】

①训练M-Net,提取基本特征;

②将M-Net复制三次,得到AF-Net的三个分支,每个MDA模块有三个子分支组成,即临近的三个不同的inception blocks,依次微调每个blocks,即共有9个blocks需要微调;

③微调完成后,固定AF-Net和M-Net,训练全局平均池化层(GAP)和全连接层(FC);

④输出层:属性识别使用交叉熵损失函数,行人ReID使用softmax函数。

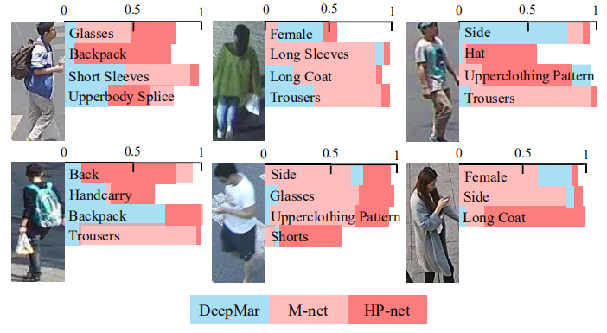

【实验结果】

【论文阅读】HydraPlus-Net: Attentive Deep Features for Pedestrian Analysis的更多相关文章

- 论文阅读 | Towards a Robust Deep Neural Network in Text Domain A Survey

摘要 这篇文章主要总结文本中的对抗样本,包括器中的攻击方法和防御方法,比较它们的优缺点. 最后给出这个领域的挑战和发展方向. 1 介绍 对抗样本有两个核心:一是扰动足够小:二是可以成功欺骗网络. 所有 ...

- [论文阅读] ImageNet Classification with Deep Convolutional Neural Networks(传说中的AlexNet)

这篇文章使用的AlexNet网络,在2012年的ImageNet(ILSVRC-2012)竞赛中获得第一名,top-5的测试误差为15.3%,相比于第二名26.2%的误差降低了不少. 本文的创新点: ...

- 论文解读第三代GCN《 Deep Embedding for CUnsupervisedlustering Analysis》

Paper Information Titlel:<Semi-Supervised Classification with Graph Convolutional Networks>Aut ...

- 论文解读DEC《Unsupervised Deep Embedding for Clustering Analysis》

Junyuan Xie, Ross B. Girshick, Ali Farhadi2015, ICML1243 Citations, 45 ReferencesCode:DownloadPaper: ...

- 论文解读GCN 1st《 Deep Embedding for CUnsupervisedlustering Analysis》

论文信息 Tittle:<Spectral Networks and Locally Connected Networks on Graphs> Authors:Joan Bruna.Wo ...

- BERT 论文阅读笔记

BERT 论文阅读 BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding 由 @快刀切草莓君 ...

- Deep Reinforcement Learning for Dialogue Generation 论文阅读

本文来自李纪为博士的论文 Deep Reinforcement Learning for Dialogue Generation. 1,概述 当前在闲聊机器人中的主要技术框架都是seq2seq模型.但 ...

- 【医学图像】3D Deep Leaky Noisy-or Network 论文阅读(转)

文章来源:https://blog.csdn.net/u013058162/article/details/80470426 3D Deep Leaky Noisy-or Network 论文阅读 原 ...

- 论文阅读:Face Recognition: From Traditional to Deep Learning Methods 《人脸识别综述:从传统方法到深度学习》

论文阅读:Face Recognition: From Traditional to Deep Learning Methods <人脸识别综述:从传统方法到深度学习> 一.引 ...

随机推荐

- C++11 自动推导auto

C++11 自动推导auto C++11中引入的auto主要有两种用途:自动类型推导和返回值占位. auto在C++98中的标识临时变量的语义,由于使用极少且多余,在C++11中已被删除.前后两个标准 ...

- 前端学习 -- Css -- 文档流

文档流 文档流处在网页的最底层,它表示的是一个页面中的位置, 我们所创建的元素默认都处在文档流中 元素在文档流中的特点 块元素 块元素在文档流中会独占一行,块元素会自上向下排列. 块元素在文档流中默认 ...

- 51nod1462 树据结构(树链剖分+线段树)

这题好久之前就被学长安利了...一直没写珍藏在收藏夹一个不为人知的角落233 这题怎么做...我们来数形结合,横坐标为$t_i$被加的次数(可看作时间$t$),纵坐标为$v_i$,那么$t_i$实际上 ...

- 迭代器Iterator与ConcurrentModificationException详解

背景:一直以来对迭代器的问题理解不是很透彻,特别是迭代器和异常ConcurrentModificationException之间的联系.通过debug,详细了解其底层的具体实现过程. 简介 Itera ...

- ByteBuffer的allocate与allocateDirect2013-01-11

在Java中当我们要对数据进行更底层的操作时,通常是操作数据的字节(byte)形式,这时常常会用到ByteBuffer这样一个类.ByteBuffer提供了两种静态实例方式: public sta ...

- jq给单选框 radio添加或删除选中状态

$("#div1 :radio").removeAttr("checked");//删除目标div下所有单选框的选中状态 $("#div1 :radi ...

- HDU 6153 扩展kmp

A Secret Time Limit: 2000/1000 MS (Java/Others) Memory Limit: 256000/256000 K (Java/Others)Total ...

- RabbitMQ服务主机名更改导致消息队列无法连接

RabbitMQ服务主机名更改导致消息队列无法连接 在多节点环境中,RabbitMQ服务使用一个独立节点部署.在此环境下,如果修改了RabbitMQ节点的主机名,则需要更新RabbitMQ用户才能保证 ...

- What does -1 mean in numpy reshape?

The criterion to satisfy for providing the new shape is that 'The new shape should be compatible wit ...

- 鸟哥的Linux私房菜——第十二章:档案的压缩与打包

视频链接: 土豆:http://www.tudou.com/programs/view/GncwT0FJKsQ B站(推荐):http://www.bilibili.com/video/av98857 ...