EM算法(4):EM算法证明

目录

EM算法(4):EM算法证明

1. 概述

上一篇博客我们已经讲过了EM算法,EM算法由于其普适性收到广泛关注,高频率地被运用在各种优化问题中。但是EM算法为什么用简单两步就能保证使得问题最优化呢?下面我们就给出证明。

2. 证明

现在我们已经对EM算法有所了解,知道其以两步(E-step和M-step)为周期,迭代进行,直到收敛为止。那问题就是,在一个周期内,目标函数的值是否增加了?如果能保证其每个周期都在增加的话,那么其必然收敛到一个局部最大值处。这就是我们EM算法所需要证明的,即:

$p(\mathbf{X};\theta^{(i+1)}) \geqslant p(\mathbf{X};\theta^{(i)})$

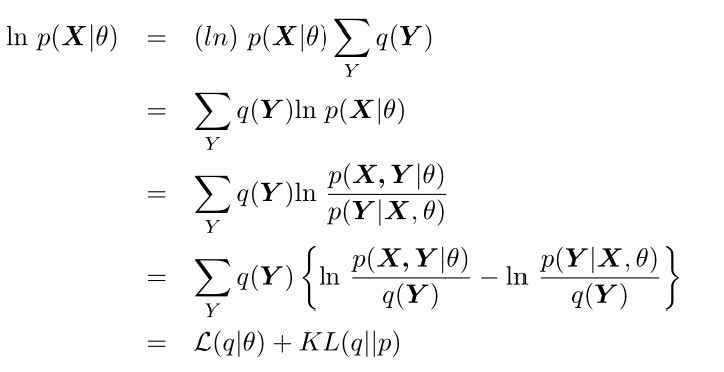

首先假设Y的分布为$q(\mathbf{Y})$,则有$\sum_Yq(\mathbf{Y}) = 1$,则:

现在假设在EM算法第i个周期结束,因为KL(q||p)不小于零,那么其最小时就为0,即$q(\mathbf{Y})=p(\mathbf{Y}|\mathbf{X},\theta^{(i)})$时。

在E-step时,我们计算$Q(\theta^{(i+1)}|\theta^{(i)})$,我们发现:

在M-step时,我们找到一个$\theta^{(i+1)}$,使得$Q(\theta|\theta^{(i)})$最大,即也是使得$\mathcal{L}(q|\theta)$最大。同时,因为此时$p(\mathbf{X,Y}|\theta^{(i+1)}) \neq p(\mathbf{X,Y}|\theta^{(i)}) = q(\mathbf{Y})$,那么KL(q||p)也会大于零。那么相对于第i个EM周期结束时的目标函数的值,现在其两个和项的值都是非减的,那么很容易得到:

$p(\mathbf(X)|\theta^{(i+1)}) \geqslant p(\mathbf{X}|\theta^{(i)})$

EM算法(4):EM算法证明的更多相关文章

- 【EM算法】EM(转)

Jensen不等式 http://www.cnblogs.com/jerrylead/archive/2011/04/06/2006936.html 回顾优化理论中的一些概念.设f是定义域为实数的函数 ...

- K-means聚类算法与EM算法

K-means聚类算法 K-means聚类算法也是聚类算法中最简单的一种了,但是里面包含的思想却不一般. 聚类属于无监督学习.在聚类问题中,给我们的训练样本是,每个,没有了y. K-means算法是将 ...

- EM算法浅析(二)-算法初探

EM算法浅析,我准备写一个系列的文章: EM算法浅析(一)-问题引出 EM算法浅析(二)-算法初探 一.EM算法简介 在EM算法之一--问题引出中我们介绍了硬币的问题,给出了模型的目标函数,提到了这种 ...

- EM相关两个算法 k-mean算法和混合高斯模型

转自http://www.cnblogs.com/jerrylead/archive/2011/04/06/2006924.html http://www.cnblogs.com/jerrylead/ ...

- 从决策树学习谈到贝叶斯分类算法、EM、HMM --别人的,拷来看看

从决策树学习谈到贝叶斯分类算法.EM.HMM 引言 最近在面试中,除了基础 & 算法 & 项目之外,经常被问到或被要求介绍和描述下自己所知道的几种分类或聚类算法(当然,这完全 ...

- 从决策树学习谈到贝叶斯分类算法、EM、HMM

从决策树学习谈到贝叶斯分类算法.EM.HMM (Machine Learning & Recommend Search交流新群:172114338) 引言 log ...

- Python实现机器学习算法:EM算法

''' 数据集:伪造数据集(两个高斯分布混合) 数据集长度:1000 ------------------------------ 运行结果: ---------------------------- ...

- MM 算法与 EM算法概述

1.MM 算法: MM算法是一种迭代优化方法,利用函数的凸性来寻找它们的最大值或最小值. MM表示 “majorize-minimize MM 算法” 或“minorize maximize MM 算 ...

- 机器学习经典算法之EM

一.简介 EM 的英文是 Expectation Maximization,所以 EM 算法也叫最大期望算法. 我们先看一个简单的场景:假设你炒了一份菜,想要把它平均分到两个碟子里,该怎么分? 很少有 ...

- 机器学习优化算法之EM算法

EM算法简介 EM算法其实是一类算法的总称.EM算法分为E-Step和M-Step两步.EM算法的应用范围很广,基本机器学习需要迭代优化参数的模型在优化时都可以使用EM算法. EM算法的思想和过程 E ...

随机推荐

- [wxWidgets] 1. 安装及"hello world"程序

关于wxWidgets的优越已经在它的官方网站有所阐述,本文不再赘述. 本系列主要记录学习这个软件包过程中遇到的问题以及心得. 1. 安装 从源码安装虽然大多时候不是一件轻松的过程,但是基于以下两个 ...

- MyBatis入门学习教程-Mybatis3.x与Spring4.x整合

一.搭建开发环境 1.1.使用Maven创建Web项目 执行如下命令: mvn archetype:create -DgroupId=me.gacl -DartifactId=spring4-myba ...

- Java与C++程序在编译和运行上的区别

Java.C++都属于高级语言,而计算机能认识执行的只是机器码(即二进制),所以高级语言都必须经过直接或间接的转换成汇编以后,才能运行: 对于C/C++这类高级计算机语言,它们的编译器(例如Unix下 ...

- Software Development Principle

Every great piece of software begins with customer's big idea. As a professional softeware developer ...

- jQuery的编码标准和最佳实践

不知道在哪里看到了这篇关于jQuery编码的文章,挺实用的,恰好最近在研究jQuery的基础知识,今天打开收藏夹来翻译一下,原文的英语不难,但是内容很实用,可能有大神已经翻译过了,大家看精华就行了. ...

- mac 下打开多个Eclipse

在Mac下只能打开一个Eclipse工具. 使用下面命令,在控制台中输入,可以打开多个Eclipse. open -n xx/xx/eclipse.app 例子: open -n /Users/use ...

- archlinux 打印机驱动安装

#安装驱动# pacman -S cups ghostscript gsfonts gutenprint#启动服务# systemctl start/enable org.cups.cupsd.ser ...

- lighttpd配置

1.lighttpd.conf server.modules = ( "mod_access", "mod_alias", "mod_compress ...

- mac 10.9 安装 gevent

安装步骤: Gevent依赖libevent和greenlet,需要分别安装. 1,安装 macport (如已安装,可以跳过) 2,通过终端 键入: sudo port install libeve ...

- Python-0 简述

#1 应用广泛: 豆瓣 youtube 云存储相关 #2 初步学习内容: