sparksql 操作hive

写在前面:hive的版本是1.2.1spark的版本是1.6.x

http://spark.apache.org/docs/1.6.1/sql-programming-guide.html#hive-tables 查看hive和spark版本对应情况

SparkSQL操作Hive中的表数据

spark可以通过读取hive的元数据来兼容hive,读取hive的表数据,然后在spark引擎中进行sql统计分析,从而,通过sparksql与hive结合实现数据分析将成为一种最佳实践。详细实现步骤如下:

1、启动hive的元数据服务

hive可以通过服务的形式对外提供元数据读写操作,通过简单的配置即可

编辑 $HIVE_HOME/conf/hive-site.xml,增加如下内容:

<property>

<name>hive.metastore.uris</name>

<value>thrift:// hdp-node-01:9083</value>

</property>

启动hive metastore

[hadoop@hdp-node-01 ~]${HIVE_HOME}/bin/hive --service metastore 1>/dev/null 2>&1 &

查看 metastore:

[hadoop@hdp-node-01 ~] jobs

[1]+ Running hive --service metastore &

2、spark配置

将hive的配置文件拷贝给spark

将 $HIVE_HOME/conf/hive-site.xml copy $SPARK_HOME/conf/

将mysql的jdbc驱动包拷贝给spark

将 $HIVE_HOME/lib/mysql-connector-java-5.1.12.jar copy或者软链到$SPARK_HOME/lib/

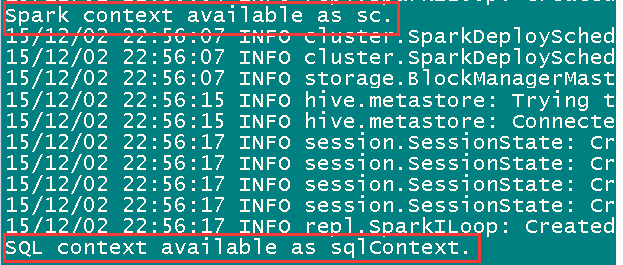

3、启动spark-sql的shell交互界面

spark-sql已经集成在spark-shell中,因此,只要启动spark-shell,就可以使用spakr-sql的shell交互接口:

[hadoop@hdp-node-01 spark] bin/spark-shell --master spark://hdp-node-01:7077

或者,可以启动spark-sql界面,使用起来更方便

[hadoop@hdp-node-01 spark] bin/spark-sql --master spark://hdp-node-01:7077

就可以使用hivesql了

由于在console中会打印很多info级别日志,所以可以改变spark的日志级别

4、在交互界面输入sql进行查询

注:以下所用到的库和表,都是已经在hive中存在的库和表

如果在spark-shell中执行sql查询,使用sqlContext对象调用sql()方法

scala> sqlContext.sql("select remote_addr from dw_weblog.t_ods_detail group by remote_addr").collect.foreach(println)

如果是在spark-sql中执行sql查询,则可以直接输入sql语句

scala> show databases

scala> use dw_weblog

scala> select remote_addr from dw_weblog.t_ods_detail group by remote_addr

5、在IDEA中编写代码使用hive-sql

如下所示:

val hiveContext = new HiveContext(sc)

import hiveContext.implicits._

import hiveContext.sql

//指定库

sql("use dw_weblog")

//执行标准sql语句

sql("create table sparksql as select remote_addr,count(*) from t_ods_detail group by remote_addr")

……

综上所述,sparksql类似于hive,可以支持sql语法来对海量数据进行分析查询,跟hive不同的是,hive执行sql任务的底层运算引擎采用mapreduce运算框架,而sparksql执行sql任务的运算引擎是spark core,从而充分利用spark内存计算及DAG模型的优势,大幅提升海量数据的分析查询速度

源码

最后:

sparksql 如果连接报错可能的原因是hive元数据库的编码不是utf8的,

alter database hive character set latin1;

ALTER TABLE hive.* DEFAULT CHARACTER SET latin1;

sparksql 执行创建表的时候报错

org.apache.spark.sql.execution.QueryExecutionException: FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.DDLTask. MetaException(message:file:/user/hive/warehouse/student2 is not a directory or unable to create one)

可能是没有启动hive元数据服务

sparksql 操作hive的更多相关文章

- 关于sparksql操作hive,读取本地csv文件并以parquet的形式装入hive中

说明:spark版本:2.2.0 hive版本:1.2.1 需求: 有本地csv格式的一个文件,格式为${当天日期}visit.txt,例如20180707visit.txt,现在需要将其通过spar ...

- Spark之 使用SparkSql操作Hive的Scala程序实现

依赖 <dependency> <groupId>org.apache.spark</groupId> <artifactId>spark-hive_2 ...

- SparkSQL与Hive on Spark的比较

简要介绍了SparkSQL与Hive on Spark的区别与联系 一.关于Spark 简介 在Hadoop的整个生态系统中,Spark和MapReduce在同一个层级,即主要解决分布式计算框架的问题 ...

- 【完美解决】Spark-SQL、Hive多 Metastore、多后端、多库

[完美解决]Spark-SQL.Hive多 Metastore.多后端.多库 [完美解决]Spark-SQL.Hive多 Metastore.多后端.多库 SparkSQL 支持同时连接多种 Meta ...

- hive on spark VS SparkSQL VS hive on tez

http://blog.csdn.net/wtq1993/article/details/52435563 http://blog.csdn.net/yeruby/article/details/51 ...

- SparkSQL与Hive on Spark

SparkSQL与Hive on Spark的比较 简要介绍了SparkSQL与Hive on Spark的区别与联系 一.关于Spark 简介 在Hadoop的整个生态系统中,Spark和MapR ...

- 大数据学习day25------spark08-----1. 读取数据库的形式创建DataFrame 2. Parquet格式的数据源 3. Orc格式的数据源 4.spark_sql整合hive 5.在IDEA中编写spark程序(用来操作hive) 6. SQL风格和DSL风格以及RDD的形式计算连续登陆三天的用户

1. 读取数据库的形式创建DataFrame DataFrameFromJDBC object DataFrameFromJDBC { def main(args: Array[String]): U ...

- SparkSQL读取Hive中的数据

由于我Spark采用的是Cloudera公司的CDH,并且安装的时候是在线自动安装和部署的集群.最近在学习SparkSQL,看到SparkSQL on HIVE.下面主要是介绍一下如何通过SparkS ...

- 基于CDH5.x 下面使用eclipse 操作hive 。使用java通过jdbc连接HIVESERVICE 创建表

基于CDH5.x 下面使用eclipse 操作hive .使用java通过jdbc连接HIVESERVICE 创建表 import java.sql.Connection; import java.s ...

随机推荐

- SQL Server之RAID简介

一: RAID简介 RAID(Redundant Array of Independent Disk 独立冗余磁盘阵列)是一项数据保护策略. 二: RAID的几种常用级别 1. RAID 0: 通过并 ...

- CSS经验分享:如何书写可维护的CSS代码01

转自:http://www.cnblogs.com/hxling/archive/2013/02/21/2920520.html 一.在样式表开头添加一个注释块,用以描述这个样式表的创建日期.创建者. ...

- SQLServer 之 聚合函数

一.聚合函数介绍 1.聚合函数最常用的: (1) COUNT:求个数 count函数用于计算满足条件的数据项数,返回int数据类型的值. [1] 语法结构:COUNT( {[[ all | disti ...

- mysql表utf-8 字符串入库编码异常

分析:http://www.myexception.cn/mysql/639943.html 解决方法:http://blog.sina.com.cn/s/blog_3f78232201011o26. ...

- Unity WP8开发环境

Unity WP8开发环境 VS2012旗舰版: 安装WP SDK8.0出错提示: 根据当前系统时钟或签名文件中的时间戳验证时要求的证书不在有效期内 解决办法: 方法一:把操作系统的时间日期调整到 ...

- Python 多重循环

# coding=gbk LOL1 = ['OMG', 'EDG', '皇族'] LOL2 = ['韩国', '欧洲', '美国'] for l1 in LOL1: for l2 in LOL2: p ...

- Unity3D入门工具介绍(一)

1.UnitySetup-4.1.2.exe安装包 2unity.pro.4.1.2.patch-MPT.exeUnity3D破解补丁 关于Unity3d 可以看下这个 http://book.2c ...

- 【转】MVC4验证用户登录特性实现方法

在开发过程中,需要用户登陆才能访问指定的页面这种功能,微软已经提供了这个特性. // 摘要: // 表示一个特性,该特性用于限制调用方对操作方法的访问. [AttributeUsage(Attribu ...

- android源码如何起步与阅读方法

显然Eclipse不是阅读Android源码的好工具,不流畅,搜索低效,继承性关系/调用关系都无法有效查看.推荐Source Insight,在这个工具帮助下,你才可以驾驭巨大数量的Android 源 ...

- 【jquery操作cookie】JQuery中$.cookie()方法的使用(同名cookie会覆盖)

jquery.cookie.js插件: <script type="text/javascript" src="js/jquery-1.6.2.min.js&quo ...