python爬西刺代理

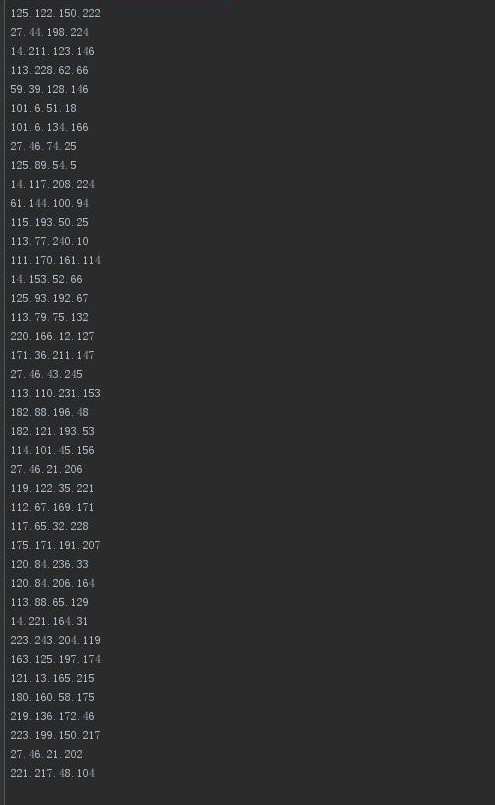

爬IP代码

import requests

import re

import dauk

from bs4 import BeautifulSoup

import time

def daili():

print('[+]极速爬取代理IP,默认为99页')

for b in range(1,99):

url="http://www.xicidaili.com/nt/{}".format(b)

header={'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:58.0) Gecko/20100101 Firefox/48.0'}

r=requests.get(url,headers=header)

gsx=BeautifulSoup(r.content,'html.parser')

for line in gsx.find_all('td'):

sf=line.get_text()

dailix=re.findall('(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)',str(sf))

for g in dailix:

po=".".join(g)

print(po)

with open ('采集到的IP.txt','a') as l:

l.write(po+'\n') daili() def dailigaoni():

print('[+]极速爬取代理IP,默认为99页')

for i in range(1,99):

url="http://www.xicidaili.com/nn/{}".format(i)

header={'User-Agent':'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}

r=requests.get(url,headers=header)

bks=r.content

luk=re.findall('(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)',str(bks))

for g in luk:

vks=".".join(g)

print(vks)

with open('采集到的IP.txt','a') as b:

b.write(vks+'\n')

dailigaoni() def dailihtp():

print('[+]极速爬取代理IP,默认为99页')

for x in range(1,99):

header="{'User-Agent':'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}"

url="http://www.xicidaili.com/wn/{}".format(x)

r=requests.get(url,headers=header)

gs=r.content

bs=re.findall('(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)',gs)

for kl in bs:

kgf=".".join(kl)

print(kgf)

with open ('采集到的IP.txt','a') as h:

h.write(kgf)

dailihtp() def dailihttps():

print('[+]极速爬代理IP,默认为99页')

for s in range(1,99):

url="http://www.xicidaili.com/wt/{}".format(s)

header={'User-Agent':'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}

r=requests.get(url,headers=header)

kl=r.content

lox=re.findall('(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)\.(25[0-5]|2[0-4]\d|[0-1]\d{2}|[1-9]?\d)',kl)

for lk in lox:

los=".".join(lk)

print(los)

with open('采集到的IP.txt','a') as lp:

lp.write(los)

dailihttps()

端口代码

import requests

import re

from bs4 import BeautifulSoup def daili():

print('[+]极速爬取代理IP端口,默认为99页')

for b in range(1, 99):

url = "http://www.xicidaili.com/nt/{}".format(b)

header = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:58.0) Gecko/20100101 Firefox/48.0'}

r = requests.get(url, headers=header)

gsx = BeautifulSoup(r.content, 'html.parser')

for line in gsx.find_all('td'):

sf = line.get_text()

dailix = re.findall(

'<td>([0-9]|[1-9]\d{1,3}|[1-5]\d{4}|6[0-5]{2}[0-3][0-5])</td>',

str(sf))

for g in dailix:

po = ".".join(g)

print(po )

with open('采集到的端口.txt.txt', 'a') as l:

l.write(po + '\n') daili() def dailigaoni():

print('[+]极速爬取代理IP的端口,默认为99页')

for i in range(1, 99):

url = "http://www.xicidaili.com/nn/{}".format(i)

header = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}

r = requests.get(url, headers=header)

bks = r.content

luk = re.findall(

'<td>([0-9]|[1-9]\d{1,3}|[1-5]\d{4}|6[0-5]{2}[0-3][0-5])</td>',

str(bks))

for g in luk:

vks = ".".join(g)

print(vks)

with open('采集到的端口.txt.txt', 'a') as b:

b.write(vks + '\n') dailigaoni() def dailihtp():

print('[+]极速爬取代理IP,默认为99页')

for x in range(1, 99):

header = "{'User-Agent':'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}"

url = "http://www.xicidaili.com/wn/{}".format(x)

r = requests.get(url, headers=header)

gs = r.content

bs = re.findall(

'<td>([0-9]|[1-9]\d{1,3}|[1-5]\d{4}|6[0-5]{2}[0-3][0-5])</td>',

gs)

for kl in bs:

kgf = ".".join(kl)

print(kgf)

with open('采集到的端口.txt.txt', 'a') as h:

h.write(kgf) dailihtp() def dailihttps():

print('[+]极速爬代理IP的端口,默认为99页')

for s in range(1, 99):

url = "http://www.xicidaili.com/wt/{}".format(s)

header = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1 Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36'}

r = requests.get(url, headers=header)

kl = r.content

lox = re.findall(

'<td>([0-9]|[1-9]\d{1,3}|[1-5]\d{4}|6[0-5]{2}[0-3][0-5])</td>',

kl)

for lk in lox:

los = ".".join(lk)

print(los)

with open('采集到的端口.txt', 'a') as lp:

lp.write(los) dailihttps()

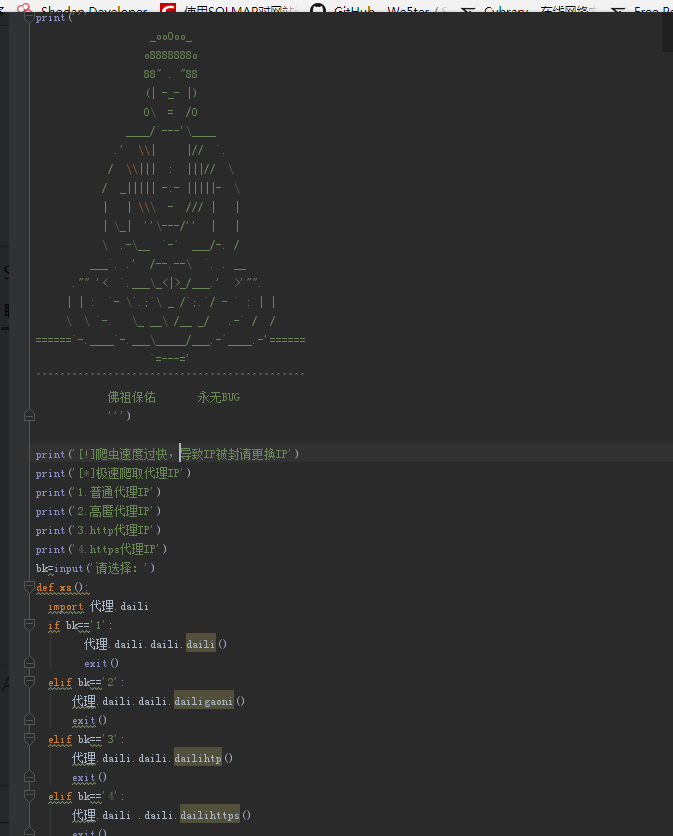

调用代码

print('''

_ooOoo_

o8888888o

88" . "88

(| -_- |)

O\ = /O

____/`---'\____

.' \\| |// `.

/ \\||| : |||// \

/ _||||| -:- |||||- \

| | \\\ - /// | |

| \_| ''\---/'' | |

\ .-\__ `-` ___/-. /

___`. .' /--.--\ `. . __

."" '< `.___\_<|>_/___.' >'"".

| | : `- \`.;`\ _ /`;.`/ - ` : | |

\ \ `-. \_ __\ /__ _/ .-` / /

======`-.____`-.___\_____/___.-`____.-'======

`=---='

^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

佛祖保佑 永无BUG

''')

print('[!]爬虫速度过快,导致IP被封请更换IP')

print('[*]极速爬取代理IP')

print('1.普通代理IP')

print('2.高匿代理IP')

print('3.http代理IP')

print('4.https代理IP')

bk=input('请选择:')

def xs():

import 代理.daili

import 代理.dauk

if bk=='1':

代理.daili.daili.daili()

代理.dauk.daili()

exit()

elif bk=='2':

代理.daili.daili.dailigaoni()

代理.dauk.dailigaoni()

exit()

elif bk=='3':

代理.daili.daili.dailihtp()

代理.dauk.dailihtp()

exit()

elif bk=='4':

代理.daili .daili.dailihttps()

代理.dauk.dailihttps()

exit()

elif bk=='q':

exit()

else:

print('[-]没有找到你要的选项')

xs()

2018-02-17

python爬西刺代理的更多相关文章

- 代理IP爬取和验证(快代理&西刺代理)

前言 仅仅伪装网页agent是不够的,你还需要一点新东西 今天主要讲解两个比较知名的国内免费IP代理网站:西刺代理&快代理,我们主要的目标是爬取其免费的高匿代理,这些IP有两大特点:免费,不稳 ...

- 使用XPath爬取西刺代理

因为在Scrapy的使用过程中,提取页面信息使用XPath比较方便,遂成此文. 在b站上看了介绍XPath的:https://www.bilibili.com/video/av30320885?fro ...

- Scrapy爬取西刺代理ip流程

西刺代理爬虫 1. 新建项目和爬虫 scrapy startproject daili_ips ...... cd daili_ips/ #爬虫名称和domains scrapy genspider ...

- python scrapy 爬取西刺代理ip(一基础篇)(ubuntu环境下) -赖大大

第一步:环境搭建 1.python2 或 python3 2.用pip安装下载scrapy框架 具体就自行百度了,主要内容不是在这. 第二步:创建scrapy(简单介绍) 1.Creating a p ...

- Python四线程爬取西刺代理

import requests from bs4 import BeautifulSoup import lxml import telnetlib #验证代理的可用性 import pymysql. ...

- python+scrapy 爬取西刺代理ip(一)

转自:https://www.cnblogs.com/lyc642983907/p/10739577.html 第一步:环境搭建 1.python2 或 python3 2.用pip安装下载scrap ...

- 手把手教你使用Python爬取西刺代理数据(下篇)

/1 前言/ 前几天小编发布了手把手教你使用Python爬取西次代理数据(上篇),木有赶上车的小伙伴,可以戳进去看看.今天小编带大家进行网页结构的分析以及网页数据的提取,具体步骤如下. /2 首页分析 ...

- python3爬虫-通过requests爬取西刺代理

import requests from fake_useragent import UserAgent from lxml import etree from urllib.parse import ...

- 极简代理IP爬取代码——Python爬取免费代理IP

这两日又捡起了许久不碰的爬虫知识,原因是亲友在朋友圈拉人投票,点进去一看发现不用登陆或注册,觉得并不复杂,就一时技痒搞一搞,看看自己的知识都忘到啥样了. 分析一看,其实就是个post请求,需要的信息都 ...

随机推荐

- 后台操作日志,插入数据获取的该数据主键ID为null

代码如下: @Override public void saveTopicResource(TopicResourceModel model, Integer userId) { TopicResou ...

- Mybatis输入和输出映射(parameterType和resultType的区别)

parameterType resultType ...

- Device Drivers Should Not Do Power Management

有人对现有的电源管理提出了意见,认为驱动程序不应该做电源管理,paper地址在这里: http://www.ruf.rice.edu/~mobile/publications/xu2014apsys. ...

- mysql查询结果带上序号

select (@i:=@i+1) as rownum,t1.id ","from mega_user t1,(select @i:=0) t2 order by t1.gold ...

- 【Java】抽象类和接口

一.抽象类和抽象方法 1.什么是抽象类 普通类是一个完善的功能类,可以直接产生实例化对象,并且在普通类中可以包含有构造方法.普通方法.static方法.常量和变量等内容. 但是普通类中不能有抽象方法, ...

- c#中绝对路径和相对路径

文件操作涉及一个非常重要的概念——文件路径.文件路径是指用来标识系统中文件存放位置的字符串.如:D:\\test.txt,表示在D盘根目录下存入test.txt文件. 文件路径分为绝对路径和相对路径. ...

- MySQL 福利彩票业务 如何存储毫秒微秒

朋友在做福利彩票业务,遇到一个存储毫秒微秒数据的需求,问我mysql里面有何解决方案.我脑中一搜索,以前没有关注到,于是去官网查看,找到11.3.6 Fractional Seconds in Tim ...

- MySQL 进入 导入

命令行进入时 不能用 ‘;’ 结尾

- python学习之面向对象(下)

该篇主要是针对面向对象的细讲,包括类的多重继承,方法的重写,析构函数,回收机制进行讲解 #该类主要是讲述python面象对象的一些特征,包括继承,方法的重写,多态,垃圾回收 class person( ...

- 设计模式之访问者(visitor)模式

在患者就医时,医生会根据病情开具处方单,很多医院都会存在以下这个流程:划价人员拿到处方单之后根据药品名称和数量计算总价,而药房工作人员根据药品名称和数量准备药品,如下图所示. 在软件开发中,有时候也需 ...