Tensorflow中神经网络的激活函数

激励函数的目的是为了调节权重和误差。

relu

max(0,x)

relu6

min(max(0,x),6)

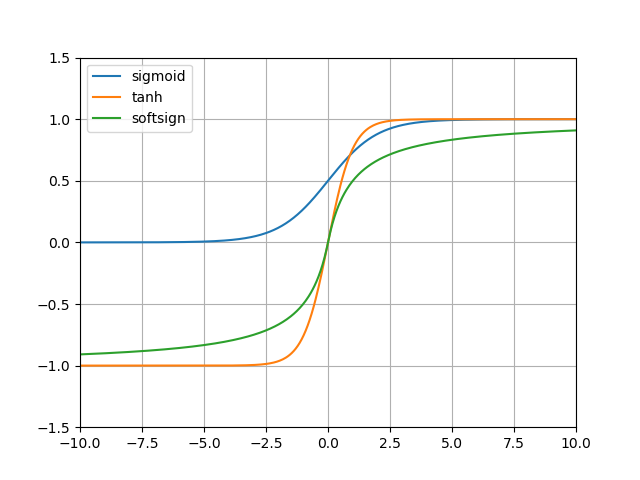

sigmoid

1/(1+exp(-x))

tanh

((exp(x)-exp(-x))/(exp(x)+exp(-x))

双曲正切函数的值域是(-1,1)

softsign

x/(abs(x)+1)

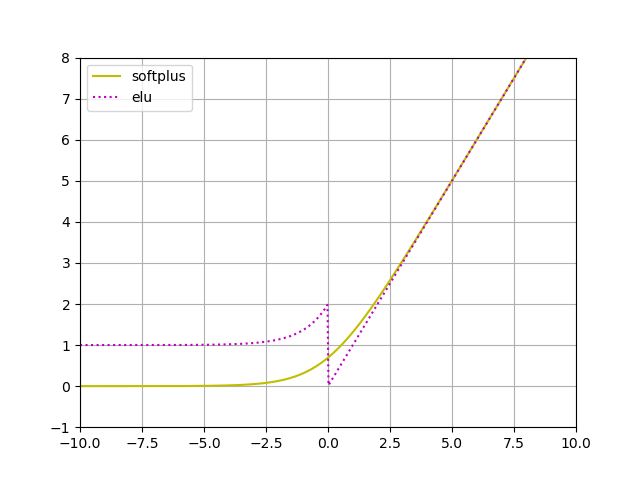

softplus

log(exp(x)+1)

elu

(exp(x)+1)if x<0 else x

import math

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt x = np.linspace(-10, 10, 500) relu = list(map(lambda m: max(0, m), x))

relu6 = list(map(lambda m: min(max(0, m), 6), x))

sigmoid = 1 / (np.exp(-x) + 1)

tanh = (np.exp(x) - np.exp(-x)) / (np.exp(x) + np.exp(-x))

softsign = x / (np.abs(x) + 1)

softplus = np.log(np.exp(x) + 1)

elu = list(map(lambda m: math.exp(m) + 1 if m < 0 else m, x)) data = {

'relu': relu,

'relu6': relu6,

'sigmoid': sigmoid,

'tanh': tanh,

'softsign': softsign,

'softplus': softplus,

'elu': elu

}

df = pd.DataFrame(data, index=x)

# print(df) df[["relu", "relu6"]].plot(

kind="line", grid=True,

style={"relu": "y-", "relu6": "r:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["softplus", "elu"]].plot(

kind="line", grid=True,

style={"softplus": "y-", "elu": "m:"},

yticks=np.linspace(-1, 8, 10),

xlim=[-10, 10], ylim=[-1, 8]) df[["sigmoid", "tanh", "softsign"]].plot(

kind="line", grid=True,

yticks=np.linspace(-1.5, 1.5, 7),

xlim=[-10, 10], ylim=[-1.5, 1.5]) plt.show()

Tensorflow中神经网络的激活函数的更多相关文章

- SELU︱在keras、tensorflow中使用SELU激活函数

arXiv 上公开的一篇 NIPS 投稿论文<Self-Normalizing Neural Networks>引起了圈内极大的关注,它提出了缩放指数型线性单元(SELU)而引进了自归一化 ...

- 深度学习原理与框架-Tensorflow卷积神经网络-cifar10图片分类(代码) 1.tf.nn.lrn(局部响应归一化操作) 2.random.sample(在列表中随机选值) 3.tf.one_hot(对标签进行one_hot编码)

1.tf.nn.lrn(pool_h1, 4, bias=1.0, alpha=0.001/9.0, beta=0.75) # 局部响应归一化,使用相同位置的前后的filter进行响应归一化操作 参数 ...

- 笔记+R︱信用风险建模中神经网络激活函数与感知器简述

每每以为攀得众山小,可.每每又切实来到起点,大牛们,缓缓脚步来俺笔记葩分享一下吧,please~ --------------------------- 本笔记源于CDA-DSC课程,由常国珍老师主讲 ...

- 在 TensorFlow 中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- tensorflow中使用mnist数据集训练全连接神经网络-学习笔记

tensorflow中使用mnist数据集训练全连接神经网络 ——学习曹健老师“人工智能实践:tensorflow笔记”的学习笔记, 感谢曹老师 前期准备:mnist数据集下载,并存入data目录: ...

- 在TensorFlow中实现文本分类的卷积神经网络

在TensorFlow中实现文本分类的卷积神经网络 Github提供了完整的代码: https://github.com/dennybritz/cnn-text-classification-tf 在 ...

- Pytorch_第九篇_神经网络中常用的激活函数

神经网络中常用的激活函数 Introduce 理论上神经网络能够拟合任意线性函数,其中主要的一个因素是使用了非线性激活函数(因为如果每一层都是线性变换,那有啥用啊,始终能够拟合的都是线性函数啊).本文 ...

- (转)一文学会用 Tensorflow 搭建神经网络

一文学会用 Tensorflow 搭建神经网络 本文转自:http://www.jianshu.com/p/e112012a4b2d 字数2259 阅读3168 评论8 喜欢11 cs224d-Day ...

- 使用TensorFlow中的Batch Normalization

问题 训练神经网络是一个很复杂的过程,在前面提到了深度学习中常用的激活函数,例如ELU或者Relu的变体能够在开始训练的时候很大程度上减少梯度消失或者爆炸问题.但是却不能保证在训练过程中不出现该问题, ...

随机推荐

- Caffe-SSD相关源码说明和调试记录

1 对Blob的理解及其操作: Blob是一个四维的数组.维度从高到低分别是: (num_,channels_,height_,width_) 对于图像数据来说就是:图片个数,彩色通道个数, ...

- elementUI tree组件获取当前选择所有选中(check)和半选中(indeterminate)的节点

网上查了半天,一大堆都说要改源码的,最后发现有方法不用改源码的 获取方法如下 this.$refs.tree.getCheckedKeys().concat(this.$refs.tree.getHa ...

- PDF.js实现个性化PDF渲染(文本复制)

我肥来啦

- 未能加载文件或程序集“SuperMap.Data.dll”

重新配置的新的开发环境,使用的是原来的工程文件,编译通过,运行报错:"未能加载文件或程序集"SuperMap.Data.dll"或它的某一个依赖项.找不到指定的模块&qu ...

- DockerSwarm获取Token与常用命令

一.Token相关 Join tokens是允许一个节点加入集群的密钥.有两种可用的不同的join tokens,一个是用作worker角色,另一个是用作manager角色.在执行swarm join ...

- Python数据预处理:机器学习、人工智能通用技术(1)

Python数据预处理:机器学习.人工智能通用技术 白宁超 2018年12月24日17:28:26 摘要:大数据技术与我们日常生活越来越紧密,要做大数据,首要解决数据问题.原始数据存在大量不完整.不 ...

- 如何给TableView、CollectionView添加动效

// // ViewController.m // tableViewAnimation // // Created by 冯敏 on 2018/3/13. // Copyright © 2018年 ...

- Dropping TSO features since no CSUM feature

今天在虚拟机中练习docker的时候突然linux系统反复重启,一下子没有发现原因,不断打开虚拟机还是自动会关机,一下子很纳闷. 打开计算机里,一看原来虚拟机所在磁盘空间满了.怪不得 出现这个问题,清 ...

- JAVA8 之 Stream sorted() 示例

下面代码以自然序排序一个listlist.stream().sorted() 自然序逆序元素,使用Comparator 提供的reverseOrder() 方法list.stream().sorted ...

- IDEA使用笔记(九)——设置文件注释

方式一:后写文件描述信息 1:设置——如下图所示 2:验证——创建个类试试 3:验证——结果如下 4:其他,所有注释模版中包含 #parse("File Header.java") ...