HBase集群部署与基础命令

HBase 集群部署

安装 hbase 之前需要先搭建好 hadoop 集群和 zookeeper 集群。hadoop 集群搭建可以参考:https://www.cnblogs.com/javammc/p/16545146.html

- 解压到安装目录

tar -zxvf hbase-1.3.1-bin.tar.gz

我解压到了/opt/lagou/servers/hbase-1.3.1 目录。

- 修改配置文件

- 把 hadoop 中配置的 core-site.xml、hdfs-site.xml 拷贝到 hbase 下的 conf 目录下

ln -s /opt/lagou/servers/hadoop-2.9.2/etc/hadoop/core-site.xml /opt/lagou/servers/hbase-1.3.1/conf/core-site.xml

ln -s /opt/lagou/servers/hadoop-2.9.2/etc/hadoop/hdfs-site.xml /opt/lagou/servers/hbase-1.3.1/conf/hdfs-site.xml

- 修改 hbase-env.sh

#添加java环境变量

export JAVA_HOME=/opt/module/jdk1.8.0_231

#指定使用外部的zk集群

export HBASE_MANAGES_ZK=FALSE

- 修改 hbase-site.xml

<configuration>

<!-- 指定hbase在HDFS上存储的路径 -->

<property>

<name>hbase.rootdir</name>

<value>hdfs://linux2:9000/hbase</value>

</property>

<!-- 指定hbase是分布式的 -->

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<!-- 指定zk的地址,多个用“,”分割 -->

<property>

<name>hbase.zookeeper.quorum</name>

<value>linux2:2181,linux3:2181,linux4:2181</value>

</property>

</configuration>

- 修改 regionservers

linux2

linux3

linux4

- 在 hbase 的 conf 目录下创建文件 backup-masters

内容如下:

linux2

- 在每个节点上配置环境变量,vi /etc/profile

export HBASE_HOME=/opt/lagou/servers/hbase-1.3.1

export PATH=$PATH:$HBASE_HOME/bin

执行命令使配置生效

source /etc/profile

- 将 hbase-1.3.1 目录分发到其他 2 个节点

scp -r hbase-1.3.1 linux3:/opt/lagou/servers/

scp -r hbase-1.3.1 linux4:/opt/lagou/servers/

- 启动集群

#启动命令

start-hbase.sh

#停止命令

stop-hbase.sh

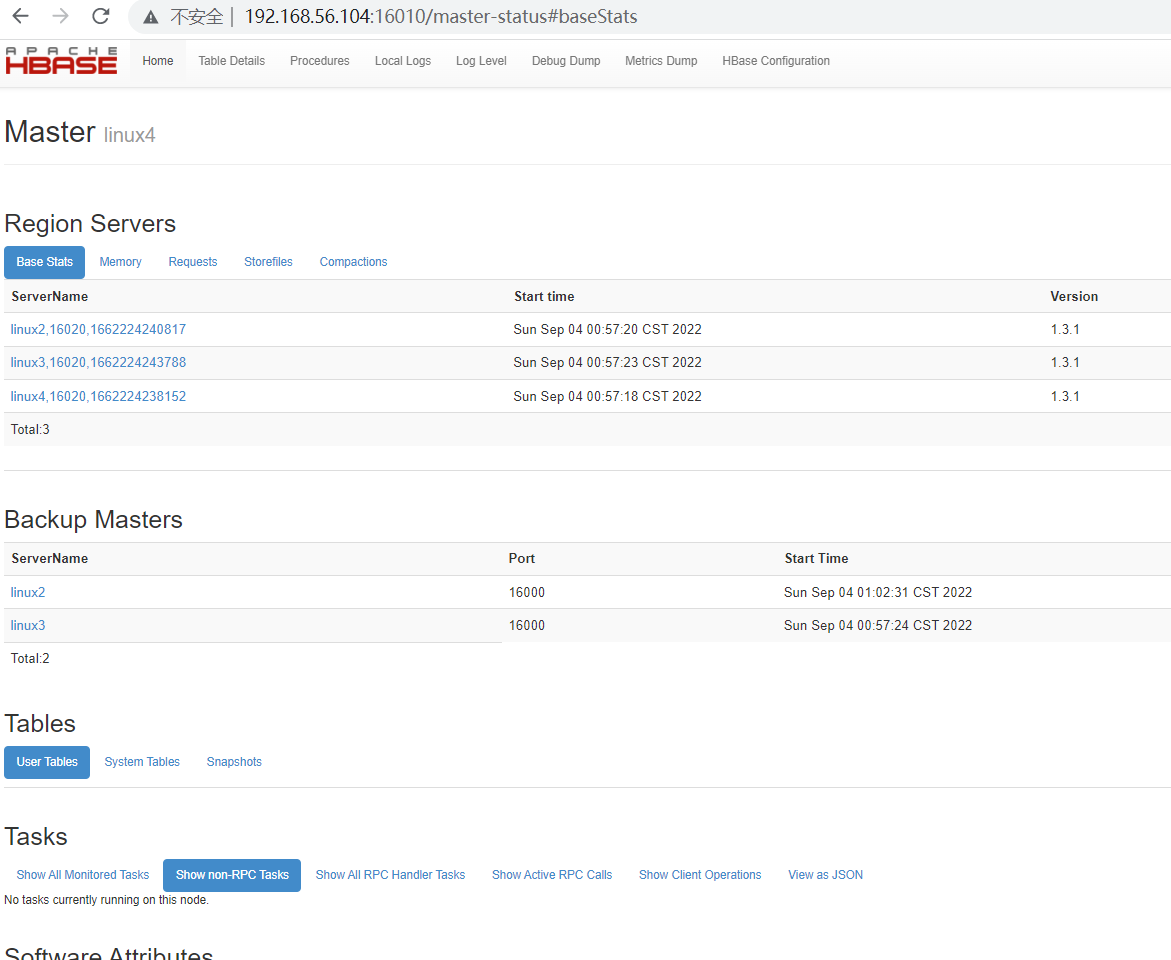

- 启动完成后,可以访问地址:

HMaster 的 ip:16010

HBase shell 基本操作

- 进入 HBase 客户端命令操作界面

hbase shell

shell 命令行里如果输错了命令,删除需要使用 Ctrl+Backspace

- 查看帮助命令

help

- 查看当前数据库里有哪些表

list

- 创建一个 user 表,包含 user_info、extra_info 两个列族

create 'user','base_info','extra_info'

#或者指定版本

create 'user2',{NAME => 'base_info',VERSIONS => '3'},{NAME => 'extra_info',VERSIONS => '3'}

- 添加数据

- 向 user 表中 row key 为 rk1,列族 base_info 的 name 列上插入值'xiaowang'

put 'user','rk1','base_info:name','xiaowang'

- 向 user 表中 row key 为 rk1,列族为 base_info 的 age 列插入值 30

put 'user','rk1','base_info:age',30

- 向 user 表中 row key 为 rk1,列族为 extra_info 的 address 列插入值'shanghai'

put 'user','rk1','extra_info:address','shanghai'

- 查询数据

- 查询 user 表中 row key 为 rk1 的所有信息

get 'user','rk1'

- 查询 user 表中 row key 为 rk1 的 base_info 列族的所有信息

get 'user','rk1','base_info'

- 查询 user 表中指定列族,指定字段的值

get 'user','rk1','base_info:name','base_info:age'

- 查询 user 表中多个列族的信息

get 'user','rk1','base_info','extra_info'

- 根据 rowkey 和列值进行查询

get 'user','rk1',{FILTER => "ValueFilter (=,'binary:shanghai')"}

- 根据 row key 和列名进行模糊查询

查询出列名:address

get 'user','rk1',{FILTER => "QualifierFilter (=,'substring:add')"}

- 查询表中所有数据

scan 'user'

- 查询表中列族为 base_info 的信息

scan 'user',{COLUMNS => 'base_info'}

# Scan时可以设置是否开启Raw模式,开启Raw模式会返回包括已添加删除标记但是未实际删除的数据

# VERSIONS指定查询的最大版本数

scan 'user',{COLUMNS => 'base_info',RAW => true, VERSIONS=> 3}

- 查询 user 表中列族为 base_info、extra_info,且列名中含 add 字符的数据

scan 'user',{COLUMNS => ['base_info','extra_info'],FILTER => "(QualifierFilter(=,'substring:add'))"}

- rowkey 的范围值查询

scan 'user',{COLUMNS => 'base_info',STARTROW => 'rk1',ENDROW => 'rk3'}

- 指定 rowkey 模糊查询

查询 user 表中 row key 以 rk 开头的数据

scan 'user' ,{FILTER =>"PrefixFilter('rk')"}

- 更新数据

更新操作同插入操作一模一样,只不过有数据就更新,没数据就添加

- 更新数据值

将 user 表中 rowkey 为 rk1 的 base_info 列族下的 name 修改为 xiaoliao

put 'user','rk1','base_info:name','xiaoliao'

- 删除数据和表

- 指定 rowkey 以及列名进行删除

delete 'user','rk2','base_info:name'

- 指定 rowkey 以及列名、时间戳进行删除

delete 'user','rk2','base_info:age',1662245345710

- 删除列族

alter 'user','delete' => 'extra_info'

- 清空表数据

truncate 'user'

- 删除表

#先disable,再drop,否则会报错

disable 'user'

drop 'user'

HBase集群部署与基础命令的更多相关文章

- Hbase集群部署及shell操作

本文详述了Hbase集群的部署. 集群部署 1.将安装包上传到集群并解压 scp hbase-0.99.2-bin.tar.gz mini1:/root/apps/ tar -zxvf hbase-0 ...

- HBase 集群部署

前提条件:hadoop及zookeeper机群已经搭建好. 配置hbase集群步骤: 1.配置hbase集群,要修改3个文件 注意:要把hadoop的hdfs-site.xml和core-site. ...

- Hbase集群部署

1.安装Hadoop集群 这个之前已经写过 2.安装Zookeeper 这个之前也已经写过 3.下载hbase,放到master机器,解压 4.修改hbase-env.sh,添加Java地址 expo ...

- Kubernetes集群部署及简单命令行操作

三个阶段部署docker:https://www.cnblogs.com/rdchenxi/p/10381631.html 环境准备 [root@master ~]# hostnamectl set- ...

- HBase集群部署脚本

#!/bin/bash # Sync HBASE_HOME across the cluster. Must run on master using HBase owner user. HBASE_H ...

- HBase集成Zookeeper集群部署

大数据集群为了保证故障转移,一般通过zookeeper来整体协调管理,当节点数大于等于6个时推荐使用,接下来描述一下Hbase集群部署在zookeeper上的过程: 安装Hbase之前首先系统应该做通 ...

- Hadoop及Zookeeper+HBase完全分布式集群部署

Hadoop及HBase集群部署 一. 集群环境 系统版本 虚拟机:内存 16G CPU 双核心 系统: CentOS-7 64位 系统下载地址: http://124.202.164.6/files ...

- Storm集群部署及单词技术

1. 集群部署的基本流程 集群部署的流程:下载安装包.解压安装包.修改配置文件.分发安装包.启动集群 注意: 所有的集群上都需要配置hosts vi /etc/hosts 192.168.239.1 ...

- 2.Storm集群部署及单词统计案例

1.集群部署的基本流程 2.集群部署的基础环境准备 3.Storm集群部署 4.Storm集群的进程及日志熟悉 5.Storm集群的常用操作命令 6.Storm源码下载及目录熟悉 7.Storm 单词 ...

随机推荐

- 运行时应用自我保护(RASP):应用安全的自我修养

应用程序已经成为网络黑客想要渗透到企业内部的绝佳目标. 因为他们知道如果能发现并利用应用程序的漏洞,他们就有超过三分之一的机会成功入侵. 更重要的是,发现应用程序漏洞的可能性也很大. Contrast ...

- HDFS存储目录分析

一.介绍 HDFS metadata以树状结构存储整个HDFS上的文件和目录,以及相应的权限.配额和副本因子(replication factor)等.本文基于Hadoop2.6版本介绍HDFS Na ...

- NC14326 Rails

NC14326 Rails 题目 题目描述 There is a famous railway station in PopPush City. Country there is incredibly ...

- 使用supervisor设置应用开机自启

安装supervisor: sudo apt install supervisor -y 创建配置文件: sudo vim /etc/supervisor/conf.d/frpc.conf frpc. ...

- SpringBoot数据库管理 - 用Liquibase对数据库管理和迁移?

Liquibase是一个用于用于跟踪.管理和应用数据库变化的开源工具,通过日志文件(changelog)的形式记录数据库的变更(changeset),然后执行日志文件中的修改,将数据库更新或回滚(ro ...

- rust中的ref

理解Rust的引用与借用(好文链接) #![feature(core_intrinsics)] fn print_type_of<T>(_: T) { println!("{}& ...

- 【定时功能】消息的定时发送-基于RocketMQ

一.功能介绍 要实现一个消息的定时发送功能,也就是让消息可以在某一天某一个时间具体节点进行发送.而我们公司的业务场景是类似短信的业务,而且数量不小,用户会进行号码.消息内容.定时发送时间等信息的提交. ...

- javascript相邻节点元素获取

<script> window.onload = function () { var myLinkItem = document.getElementById('linkItem'); v ...

- js for和while两种99乘法表

<script type="text/javascript"> for(var i=1; i<=9; i++) { for(var j=1; j<=i;j+ ...

- SQLServer查询进程与死锁语句

查询当前进程信息: SELECTSPID = er.session_id,Status = ses.status,[Login] = ses.login_name,Host = ses.host_na ...