[论文理解] CapsuleNet

CapsuleNet

前言

找了很多资料,终于把整个流程搞懂了,其实要懂这个运算并不难,难的对我来说是怎么用代码实现,也找了github上的一些代码来看,对我来说都有点冗长,变量分布太远导致我脑袋炸了,所以我就在B站找视频看看有没有代码讲解,算是不负苦心吧,终于把实现部分解决了。

不写论文解读,因为原文实在太难读了,这个老外的英文我基本上每看一句都要取查翻译,很难受,而且网上的教程、解析非常非常之多,所以我留个代码,以后看一下就能想起来了。

Capsule是干什么的

capsule是换了一种神经元的表达方式,原来每个神经元我们是用一个scalar来表示的,现在在capsule中我们中vector来表示一个神经元。这样做的好处是可以多维度描述一个神经元,而在capsue中,我们用vector的模长来表示概率,其他每个维度可以表征神经元的属性。比如某个维度表征特征的朝向,当特征朝向改变时,神经元的模长并没有改变,而是该维度的值改变了,这是一个很好的理解。

这部分网上资料简直太多了,上面说的只是我个人的见解,可以看看别人的版本。

Capsule代码怎么写

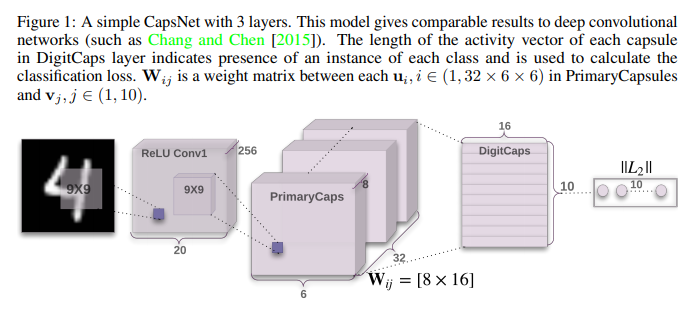

网络的结构图还是得贴一张

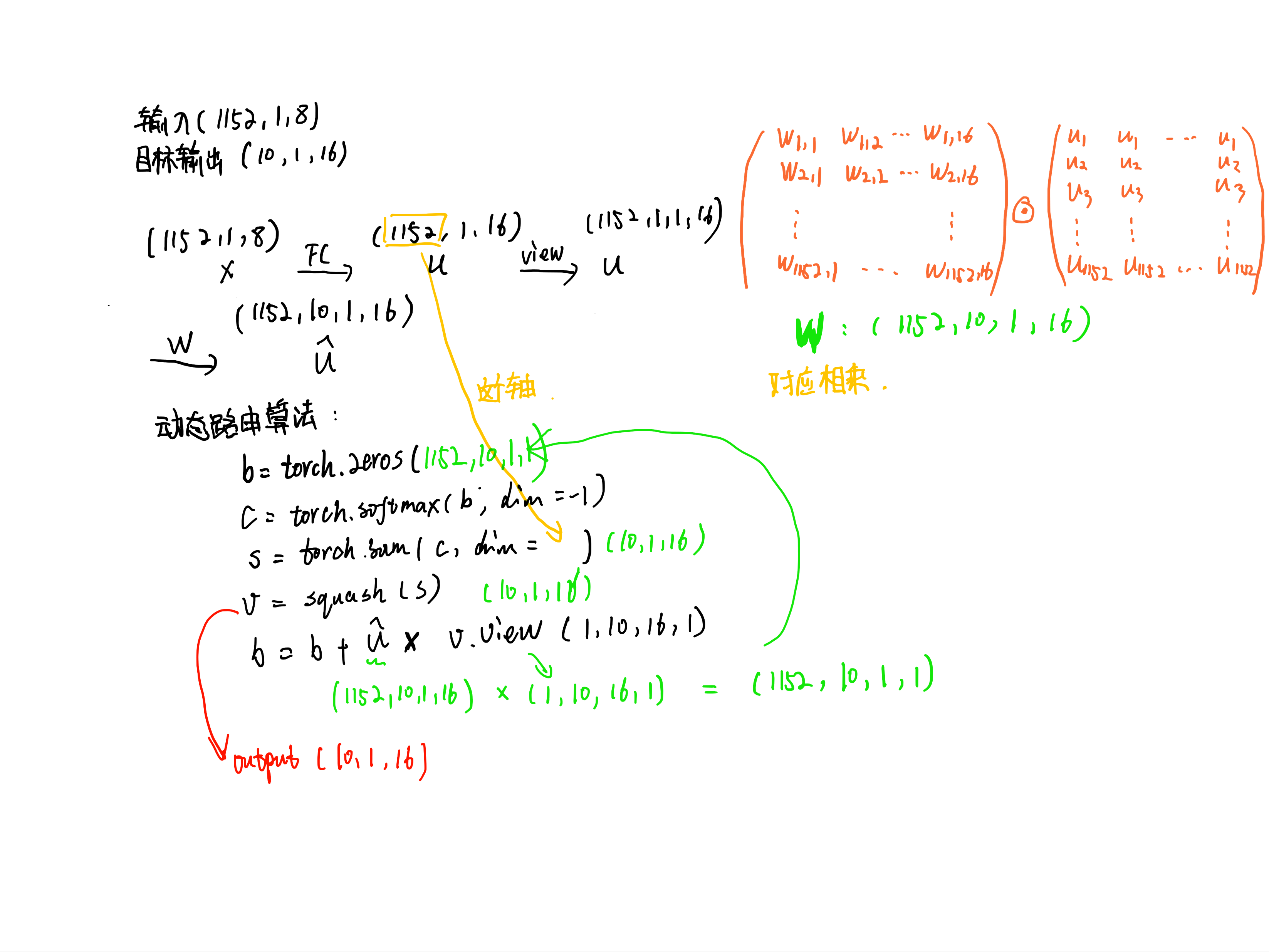

整体网络分三层,第一层卷积层,将(3,28,28)的输入映射到(256,20,20),第二层称为primary_caps,拿32个filter分8次卷积,得到(32,6,6,8)的输出,然后reshape成(1152,1,8)这里就是为了后面vector in vector out做准备了。

这里表达的意思就是有1152个capsule,每个capsule里有1个8维的vector,老有意思了。

然后就是后面digit_caps层了,我们目标vector应该是(10,1,16),输入是(1152,1,8),所以我们在这里思考作者是如何得到这样的映射关系的。

利用动态路由算法,我们成功得到的v。

好,结束。重建的代码我就不写了。

附上总代码:

import torchimport torch.nn as nnfrom torchsummary import summaryfrom torch.autograd import Variableclass CapsuleLayer(nn.Module):def __init__(self,routing = False):super(CapsuleLayer,self).__init__()self.routing = routingdef create_conv(unit_idx):conv_unit = nn.Conv2d(256,32,kernel_size = 9,stride = 2)self.add_module("conv_unit_{}".format(unit_idx),conv_unit)return conv_unitself.conv_units = [create_conv(i) for i in range(8)]self.w = Variable(torch.randn(1,1152,10,16))self.fc = nn.Linear(8,16)def forward(self,x):if self.routing:return self.use_routing(x)else:return self.no_routing(x)@staticmethoddef squash(x):f = torch.sum(x**2,dim =2,keepdim = True)return f / (1 + f) / (x / torch.sqrt(f))def use_routing(self,x):# (-1,8,32*6*6)x = x.transpose(1,2).view(-1,32*6*6,1,8)x = self.fc(x)w = torch.cat([self.w] * x.size(0), dim = 0)u = w * x # (b,1152,10,8)b = Variable(torch.zeros(x.size(0),x.size(1),10,1,1))for iter in range(3):c = torch.softmax(u,dim = -1)s = torch.sum(c,dim = 1,keepdim = True)v = self.squash(s).view(-1,1,10,16,1)b = b + u.view(x.size(0),1152,10,1,16) @ v.view(x.size(0),1,10,16,1)return v.view(x.size(0),10,16)def no_routing(self,x):u = [self.conv_units[i](x) for i in range(8)]# every u (-1,32,6,6)# (-1,8,32,6,6)u = torch.stack(u,dim =1)u = u.view(-1,8,32*6*6)return self.squash(u)class CapsuleNet(nn.Module):def __init__(self):super(CapsuleNet,self).__init__()self.conv = nn.Sequential(nn.Conv2d(1,256,kernel_size = 9,stride = 1),nn.ReLU())self.pri_caps = CapsuleLayer()self.digit_caps = CapsuleLayer(routing = True)def forward(self,x):x = self.conv(x) # (-1,256,20,20)x = self.pri_caps(x)x = self.digit_caps(x)return xif __name__ == "__main__":x = torch.randn(2,1,28,28)net = CapsuleNet()y = net(x)print(y.size())

[论文理解] CapsuleNet的更多相关文章

- [论文理解]关于ResNet的进一步理解

[论文理解]关于ResNet的理解 这两天回忆起resnet,感觉残差结构还是不怎么理解(可能当时理解了,时间长了忘了吧),重新梳理一下两点,关于resnet结构的思考. 要解决什么问题 论文的一大贡 ...

- [论文理解] CornerNet: Detecting Objects as Paired Keypoints

[论文理解] CornerNet: Detecting Objects as Paired Keypoints 简介 首先这是一篇anchor free的文章,看了之后觉得方法挺好的,预测左上角和右下 ...

- R-FCN论文理解

一.R-FCN初探 1. R-FCN贡献 提出Position-sensitive score maps来解决目标检测的位置敏感性问题: 区域为基础的,全卷积网络的二阶段目标检测框架: 比Faster ...

- YOLO V3论文理解

YOLO3主要的改进有:调整了网络结构:利用多尺度特征进行对象检测:对象分类用Logistic取代了softmax. 1.Darknet-53 network在论文中虽然有给网络的图,但我还是简单说一 ...

- YOLO V2论文理解

概述 YOLO(You Only Look Once: Unified, Real-Time Object Detection)从v1版本进化到了v2版本,作者在darknet主页先行一步放出源代码, ...

- ssd算法论文理解

这篇博客主要是讲下我在阅读ssd论文时对论文的理解,并且自行使用pytorch实现了下论文的内容,并测试可以用. 开篇放下论文地址https://arxiv.org/abs/1512.02325,可以 ...

- [论文理解]Deep Residual Learning for Image Recognition

Deep Residual Learning for Image Recognition 简介 这是何大佬的一篇非常经典的神经网络的论文,也就是大名鼎鼎的ResNet残差网络,论文主要通过构建了一种新 ...

- [论文理解] Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks

Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks 简介 Faster R-CNN是很经典的t ...

- [论文理解]Selective Search for Object Recognition

Selective Search for Object Recognition 简介 Selective Search是现在目标检测里面非常常用的方法,rcnn.frcnn等就是通过selective ...

随机推荐

- 【Java面试题】解释内存中的栈(stack)、堆(heap)和静态存储区的用法

Java面试题:解释内存中的栈(stack).堆(heap)和静态存储区的用法 堆区: 专门用来保存对象的实例(new 创建的对象和数组),实际上也只是保存对象实例的属性值,属性的类型和对象本身的类型 ...

- mybatis postgresql insert后返回自增id

在使用mybatis + postgresql,我们有时在插入数据时需要返回自增id的值,此时在插入时,可以按照以下例子来编写mapper文件 <insert id="insertUs ...

- ThinkPHP5框架缺陷导致远程命令执行(POC整合帖)

摘要 近日thinkphp团队发布了版本更新https://blog.thinkphp.cn/869075 ,其中修复了一处getshell漏洞. 影响范围 5.x < 5.1.31<= ...

- oracle重置dba用户密码

1.进入sqlplus里面: [oracle@master ~]$ sqlplus / as sysdba SQL*Plus: Release 12.1.0.2.0 Production on Tue ...

- xml_dom4j

1.用dom4j解析文件 package Xml3; import java.io.File; import java.util.Iterator; import org.dom4j.Attribut ...

- docker_Ubuntu16.04下安装cuda

经过一上午的研究,终于配置好docker环境,并成功安装cuda9.0. (1)下载安装文件.首先去英伟达官网下载cuda安装包:https://developer.nvidia.com/cuda-t ...

- java代码调用exe(cmd命令)

public class ShellCommand{ public static void execCmd(String cmd, boolean wait) { execC ...

- vim快速到行尾

快速到行尾A,或者End键(挨着Home键) 快速到第一行gg 快速到行首Home键,数字键的上面

- golang之运算符

目录 一.golang之运算符 1. 算术运算符 2. 关系运算符 3. 逻辑运算符 4. 位运算符 5. 赋值运算符 一.golang之运算符 Go 语言内置的运算符有:(比python少了一个成员 ...

- JAVA笔记5-package和import

1.基本介绍 为便于管理大型软件系统中数目众多的类,解决类的命名冲突问题,Java引入包(package)机制,提供类的多重类命名空间.在实际项目开发中任何类都应该定义在包中. (1)package语 ...