DNN的BP算法Python简单实现

BP算法是神经网络的基础,也是最重要的部分。由于误差反向传播的过程中,可能会出现梯度消失或者爆炸,所以需要调整损失函数。在LSTM中,通过sigmoid来实现三个门来解决记忆问题,用tensorflow实现的过程中,需要进行梯度修剪操作,以防止梯度爆炸。RNN的BPTT算法同样存在着这样的问题,所以步数超过5步以后,记忆效果大大下降。LSTM的效果能够支持到30多步数,太长了也不行。如果要求更长的记忆,或者考虑更多的上下文,可以把多个句子的LSTM输出组合起来作为另一个LSTM的输入。下面上传用Python实现的普通DNN的BP算法,激活为sigmoid.

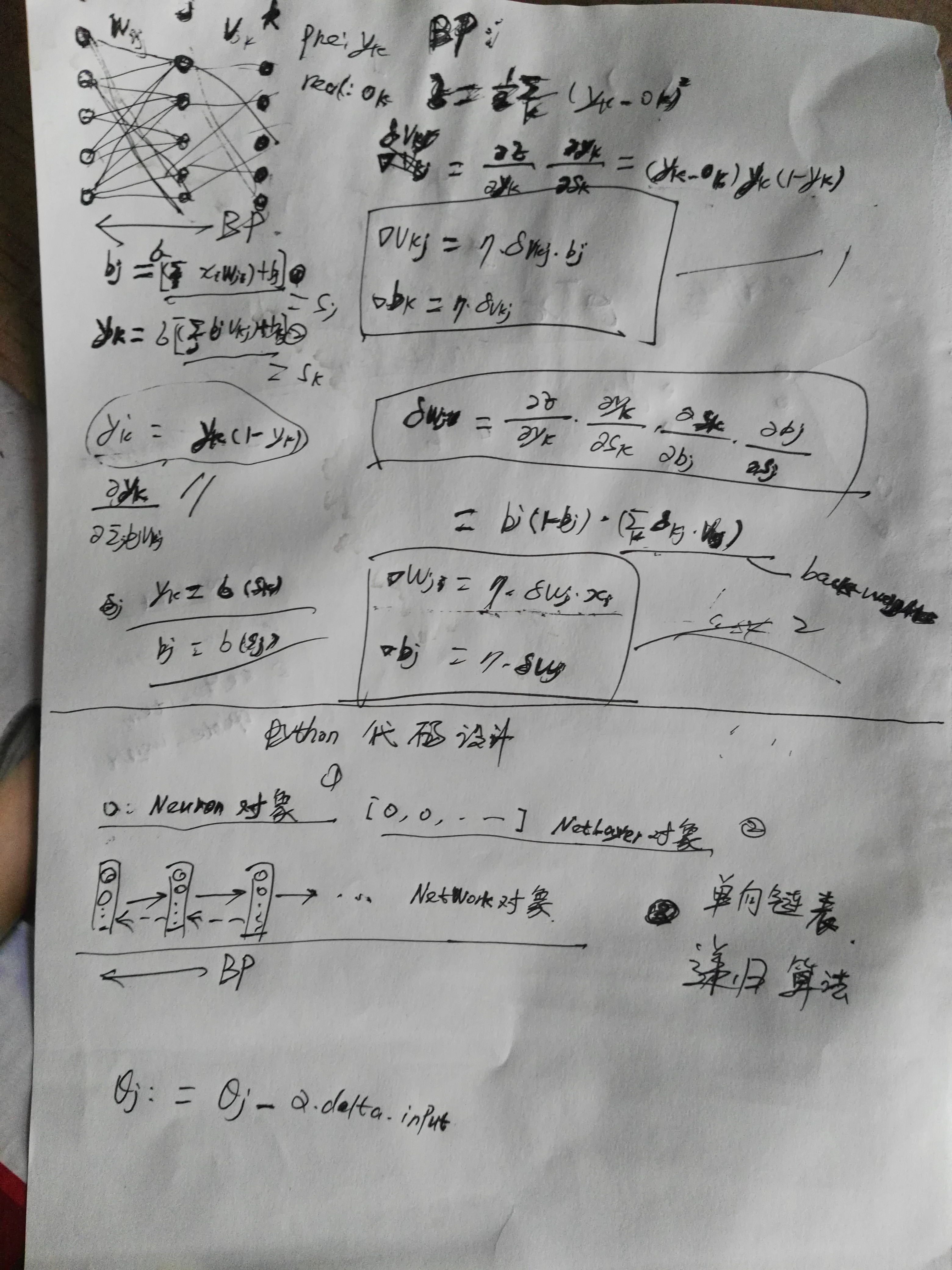

字迹有些潦草,凑合用吧,习惯了手动绘图,个人习惯。后面的代码实现思路是最重要的:每个层有多个节点,层与层之间单向链接(前馈网络),因此数据结构可以设计为单向链表。实现的过程属于典型的递归,递归调用到最后一层后把每一层的back_weights反馈给上一层,直到推导结束。上传代码(未经过优化的代码):

测试代码:

import numpy as np

import NeuralNetWork as nw if __name__ == '__main__':

print("test neural network") data = np.array([[1, 0, 0, 0, 0, 0, 0, 0],

[0, 1, 0, 0, 0, 0, 0, 0],

[0, 0, 1, 0, 0, 0, 0, 0],

[0, 0, 0, 1, 0, 0, 0, 0],

[0, 0, 0, 0, 1, 0, 0, 0],

[0, 0, 0, 0, 0, 1, 0, 0],

[0, 0, 0, 0, 0, 0, 1, 0],

[0, 0, 0, 0, 0, 0, 0, 1]]) np.set_printoptions(precision=3, suppress=True) for i in range(10):

network = nw.NeuralNetWork([8, 20, 8])

# 让输入数据与输出数据相等

network.fit(data, data, learning_rate=0.1, epochs=150) print("\n\n", i, "result")

for item in data:

print(item, network.predict(item))

#NeuralNetWork.py

# encoding: utf-8

#NeuralNetWork.py

import numpy as np; def logistic(inX):

return 1 / (1+np.exp(-inX)) def logistic_derivative(x):

return logistic(x) * (1 - logistic(x)) class Neuron:

'''

构建神经元单元,每个单元都有如下属性:1.input;2.output;3.back_weight;4.deltas_item;5.weights.

每个神经元单元更新自己的weights,多个神经元构成layer,形成weights矩阵

'''

def __init__(self,len_input):

#输入的初始参数,随机取很小的值(<0.1)

self.weights = np.random.random(len_input) * 0.1

#当前实例的输入

self.input = np.ones(len_input)

#对下一层的输出值

self.output = 1.0

#误差项

self.deltas_item = 0.0

# 上一次权重增加的量,记录起来方便后面扩展时可考虑增加冲量

self.last_weight_add = 0 def calculate_output(self,x):

#计算输出值

self.input = x;

self.output = logistic(np.dot(self.weights,self.input))

return self.output def get_back_weight(self):

#获取反馈差值

return self.weights * self.deltas_item def update_weight(self,target = 0,back_weight = 0,learning_rate=0.1,layer="OUTPUT"):

#更新权重

if layer == "OUTPUT":

self.deltas_item = (target - self.output) * logistic_derivative(self.input)

elif layer == "HIDDEN":

self.deltas_item = back_weight * logistic_derivative(self.input) delta_weight = self.input * self.deltas_item * learning_rate + 0.9 * self.last_weight_add #添加冲量

self.weights += delta_weight

self.last_weight_add = delta_weight class NetLayer:

'''

网络层封装,管理当前网络层的神经元列表

''' def __init__(self,len_node,in_count):

'''

:param len_node: 当前层的神经元数

:param in_count: 当前层的输入数

'''

# 当前层的神经元列表

self.neurons = [Neuron(in_count) for _ in range(len_node)];

# 记录下一层的引用,方便递归操作

self.next_layer = None def calculate_output(self,inX):

output = np.array([node.calculate_output(inX) for node in self.neurons])

if self.next_layer is not None:

return self.next_layer.calculate_output(output)

return output def get_back_weight(self):

return sum([node.get_back_weight() for node in self.neurons]) def update_weight(self,learning_rate,target):

layer = "OUTPUT"

back_weight = np.zeros(len(self.neurons))

if self.next_layer is not None:

back_weight = self.next_layer.update_weight(learning_rate,target)

layer = "HIDDEN"

for i,node in enumerate(self.neurons):

target_item = 0 if len(target) <= i else target[i]

node.update_weight(target = target_item,back_weight = back_weight[i],learning_rate=learning_rate,layer=layer)

return self.get_back_weight() class NeuralNetWork:

def __init__(self, layers):

self.layers = []

self.construct_network(layers)

pass def construct_network(self, layers):

last_layer = None

for i, layer in enumerate(layers):

if i == 0:

continue

cur_layer = NetLayer(layer, layers[i - 1])

self.layers.append(cur_layer)

if last_layer is not None:

last_layer.next_layer = cur_layer

last_layer = cur_layer def fit(self, x_train, y_train, learning_rate=0.1, epochs=100000, shuffle=False):

'''''

训练网络, 默认按顺序来训练

方法 1:按训练数据顺序来训练

方法 2: 随机选择测试

:param x_train: 输入数据

:param y_train: 输出数据

:param learning_rate: 学习率

:param epochs:权重更新次数

:param shuffle:随机取数据训练

'''

indices = np.arange(len(x_train))

for _ in range(epochs):

if shuffle:

np.random.shuffle(indices)

for i in indices:

self.layers[0].calculate_output(x_train[i])

self.layers[0].update_weight(learning_rate, y_train[i])

pass def predict(self, x):

return self.layers[0].calculate_output(x)

DNN的BP算法Python简单实现的更多相关文章

- 神经网络(BP)算法Python实现及简单应用

首先用Python实现简单地神经网络算法: import numpy as np # 定义tanh函数 def tanh(x): return np.tanh(x) # tanh函数的导数 def t ...

- 【深度学习】BP反向传播算法Python简单实现

转载:火烫火烫的 个人觉得BP反向传播是深度学习的一个基础,所以很有必要把反向传播算法好好学一下 得益于一步一步弄懂反向传播的例子这篇文章,给出一个例子来说明反向传播 不过是英文的,如果你感觉不好阅读 ...

- 决策树(Decision Tree)算法 python简单实现

"" """ import numpy as np from math import log import operator import json ...

- BP算法从原理到python实现

BP算法从原理到实践 反向传播算法Backpropagation的python实现 觉得有用的话,欢迎一起讨论相互学习~Follow Me 博主接触深度学习已经一段时间,近期在与别人进行讨论时,发现自 ...

- 关于BP算法在DNN中本质问题的几点随笔 [原创 by 白明] 微信号matthew-bai

随着deep learning的火爆,神经网络(NN)被大家广泛研究使用.但是大部分RD对BP在NN中本质不甚清楚,对于为什这么使用以及国外大牛们是什么原因会想到用dropout/sigmoid ...

- 神经网络BP算法C和python代码

上面只显示代码. 详BP原理和神经网络的相关知识,请参阅:神经网络和反向传播算法推导 首先是前向传播的计算: 输入: 首先为正整数 n.m.p.t,分别代表特征个数.训练样本个数.隐藏层神经元个数.输 ...

- 神经网络中 BP 算法的原理与 Python 实现源码解析

最近这段时间系统性的学习了 BP 算法后写下了这篇学习笔记,因为能力有限,若有明显错误,还请指正. 什么是梯度下降和链式求导法则 假设我们有一个函数 J(w),如下图所示. 梯度下降示意图 现在,我们 ...

- BP算法在minist数据集上的简单实现

BP算法在minist上的简单实现 数据:http://yann.lecun.com/exdb/mnist/ 参考:blog,blog2,blog3,tensorflow 推导:http://www. ...

- 基于BP神经网络的简单字符识别算法自小结(C语言版)

本文均属自己阅读源代码的点滴总结.转账请注明出处谢谢. 欢迎和大家交流.qq:1037701636 email:gzzaigcn2009@163.com 写在前面的闲话: 自我感觉自己应该不是一个非常 ...

随机推荐

- php 安装imap报错“configure: error: utf8_mime2text() has new signature”解决

环境:php官方docker镜像 php:7.2-apache 安装IMAP扩展模块执行命令:docker-php-ext-install imap 报错信息:configure: error: ut ...

- Java自学-接口与继承 Object类

Java中的超类 Object 步骤 1 : Object类是所有类的父类 声明一个类的时候,默认是继承了Object public class Hero extends Object package ...

- 换个语言学一下 Golang (11)——使用包和测试

Go天生就是为了支持良好的项目管理体验而设计的. 包 在软件工程的实践中,我们会遇到很多功能重复的代码,比如去除字符串首尾的空格.高质量软件产品的特点就是它的部分代码是可以重用的,比如你不必每次写个函 ...

- python基础--初始数据结构

目录: 一.知识点1.IDE 集成开发环境2.字符格式化输出3.数据运算4.循环loop5.数据类型6.列表与元组 二.例子1.输入名字.年龄.工作.薪水,进行格式化的输出.2.for语句实现输入密码 ...

- Vue相关知识点记录

1.安装 vue不支持ie8以下版本(无法模拟ECMAScript5特性),支持所有兼容ECMAScript5的浏览器. 浏览器安装Vue Devtools, 可以在更友好的界面中审查和调试Vue应用 ...

- python的new与init

基于文章:Why is init() always called after new()? 特别说明: 这篇文章的灵感来源于stackoverflow的一个提问,准确说,我只是做了些知识梳理的工作,对 ...

- css3中的calc的使用

最近在布局的时候遇到一个问题,在页面中的左侧是侧边栏,右边是内容区域,内容区域中有一个固定定位的标签页,在设置固定定位的标签设置宽度的时候应该是内容区域的宽度,而固定定位的时候相对于是窗口的宽度,所以 ...

- Axios 各种请求方式传递参数(非axios api 请求方式)

get delete 方法较为不同 get请求方式将需要入参的数据作为 params 属性的值,最后整体作为参数传递 delete请求方式将将需要入参的数据作为 data 属性的值,最后整体作为参数传 ...

- Vue-使用计时器实现跑马灯效果

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- 【Iterm2】如何解决iterm2窗口自动隐藏的问题

一.问题描述 当我们使用Iterm2的Hotkey Windom功能时,通过快捷键唤起Iterm2窗口后,然后鼠标在iterm2窗口之外触发点击操作就会让 iterm2窗口自动隐藏.. 这样有时候会觉 ...